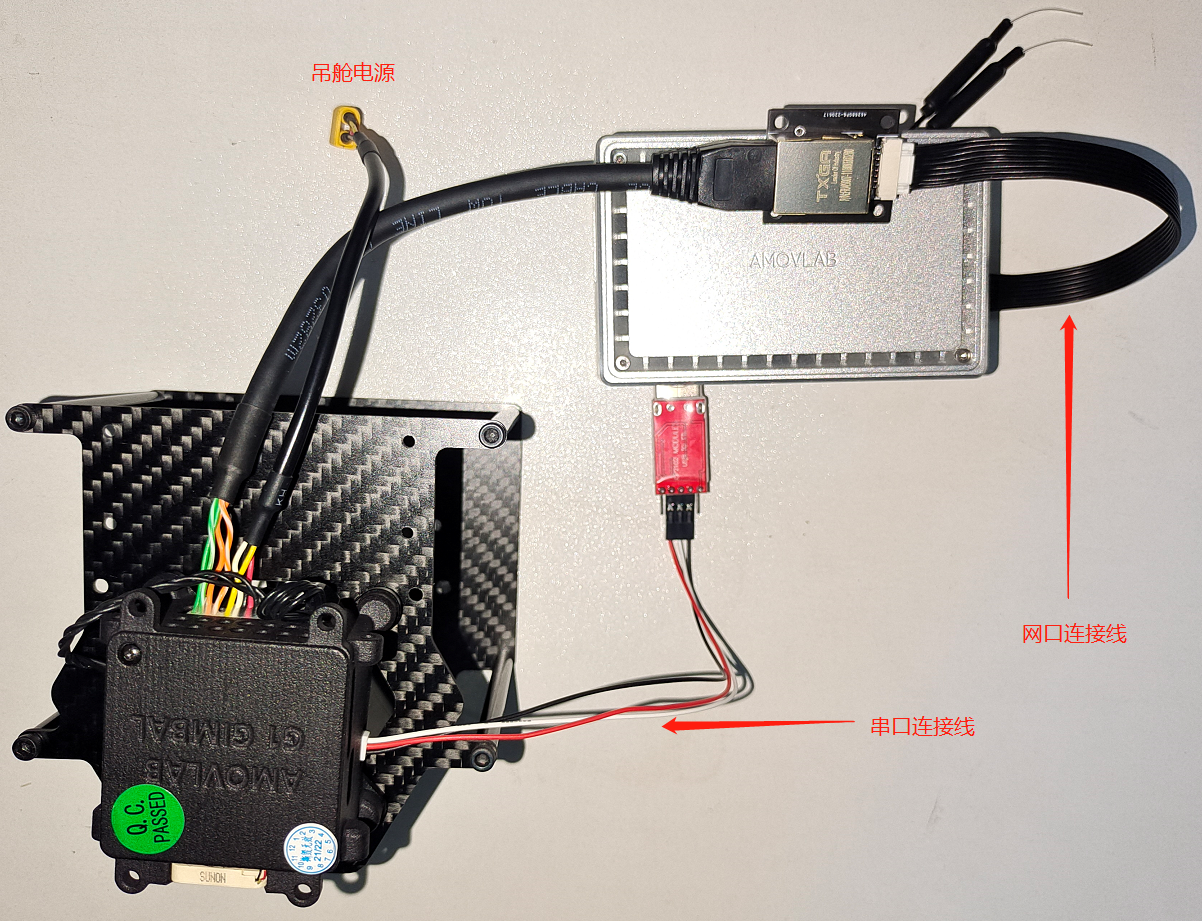

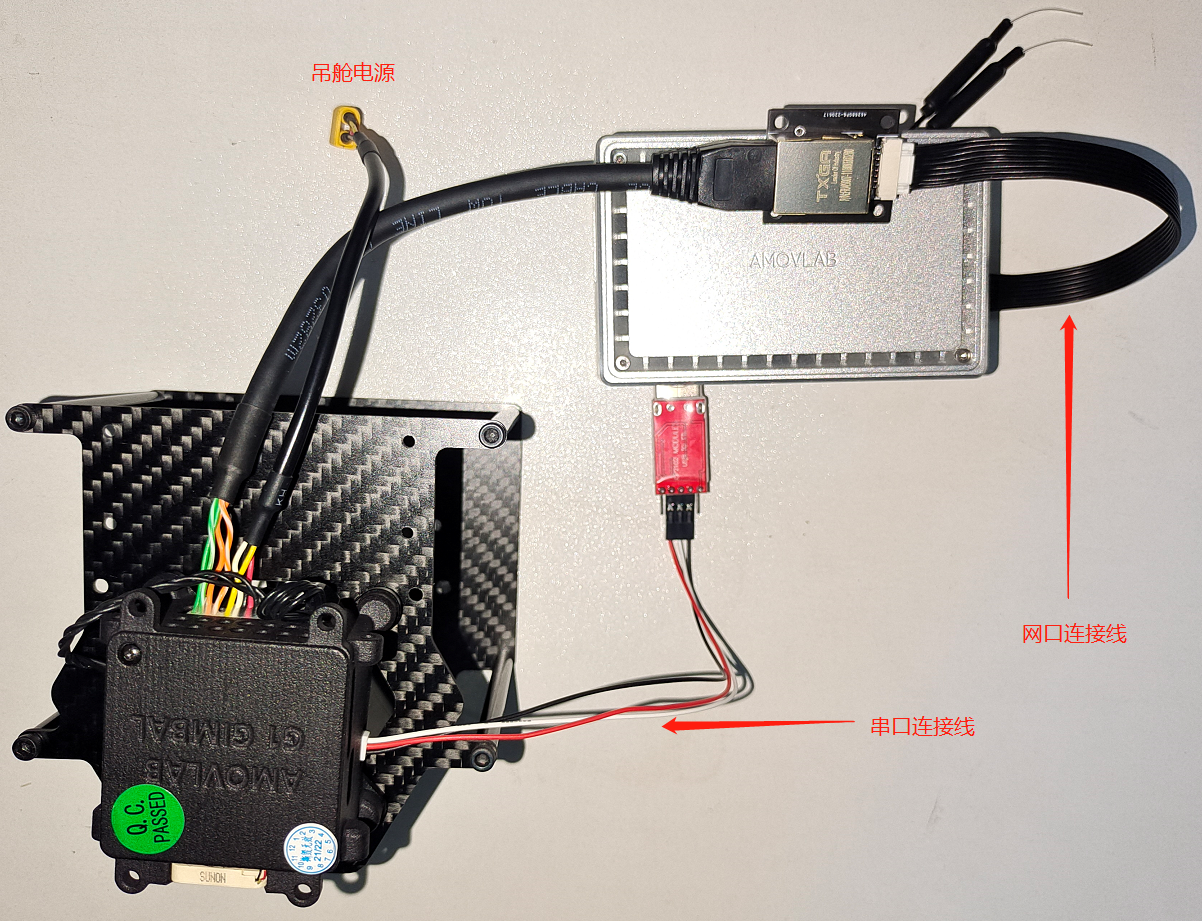

- G1吊舱

- AllSpark机载计算机 (使用手册)

- 显示器(NoMachine也可以)

- 相关连接线

- 默认已经调节好PID参数,如果需要调节PID,请在在

/home/amov/amov_gimbal_developer_kit/src/amov_gimbal_control/cfg文件夹中,有一个AMOV_PID.cfg配置文件,修改默认值即可修改吊舱PID值

#gen.add(参数名称, 参数类型, 位掩码, 参数描述, 默认值, 最小值, 最大值)

gen.add( "pitchKp", double_t, 0, "pitch Kp parameter", 0.0, 0, 5)

gen.add( "pitchKi", double_t, 0, "pitch Ki parameter", 0.0, 0, 5)

gen.add( "pitchKd", double_t, 0, "pitch Kd parameter", 0.0, 0, 5)

gen.add( "yawKp", double_t, 0, "yaw Kp parameter", 0.0, 0, 5)

gen.add( "yawKi", double_t, 0, "yaw Ki parameter", 0.0, 0, 5)

gen.add( "yawKd", double_t, 0, "yaw Kd parameter", 0.0, 0, 5)

- 启动AllSpark机载计算机

- 在AllSpark桌面上找到DeepSort图标

- 双击图标运行算法程序

- 当视野中出现目标目标会被框选为绿色框

- 鼠标左键点击绿色框,被点击的框会变为绿色

- 同时,吊舱会让视野中心对准目标,从而实现跟踪目标物体的效果

- 鼠标右键点击空白处,取消跟踪

- 建议:由于COCO是通用数据集,未经过特别数据集训练,对车辆和人的检测效果会更佳

- 亦可以使用Promethus的模型训练方法:模型训练

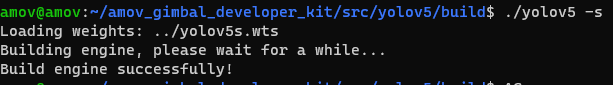

- 接下来将

COCO数据集的yoloV5模型为例子

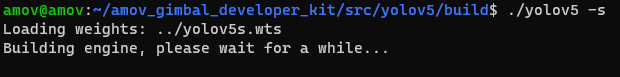

- 使用终端进入到

/home/amov/amov_gimbal_developer_kit/src/yolov5目录下

- 使用

mkdir builld&&cd build命令,新建build文件夹并进入build文件夹中

- 使用

cmake ..命令进行配置cmake ,然后使用make命令进行编译

- 输入如下命令

python3 gen_wts.py,将会生成yolov5s.wts文件

- 然后将

yolov5s.wts文件复制到build文件夹中

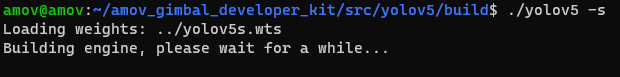

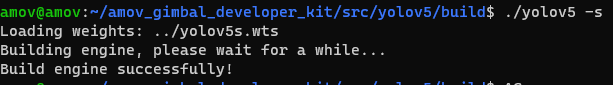

- 通过输入

cd build进入build文件夹中,执行命令./yolov5 -s ,将会生成yolov5s.engine文件

- 将

yolov5s.engine文件复制到/home/amov/amov_gimbal_developer_kit/src/vision/deepsort/resources进行替换yolov5s.engine

- 然后就可以使用TensorRT模型进行推理了