Prometheus-自主无人机开源项目

提示

Prometheus使用手册为Prometheus-v2版本,我们推荐大家使用Prometheus-v2,并且Prometheus-v1已不再维护,如需使用Prometheus-v1请前往 Prometheus仿真环境配置:Ubuntu 了解相关内容

Prometheus简介

Prometheus是希腊神话中最具智慧的神明之一,希望本项目能为无人机研发带来无限的智慧与光明。

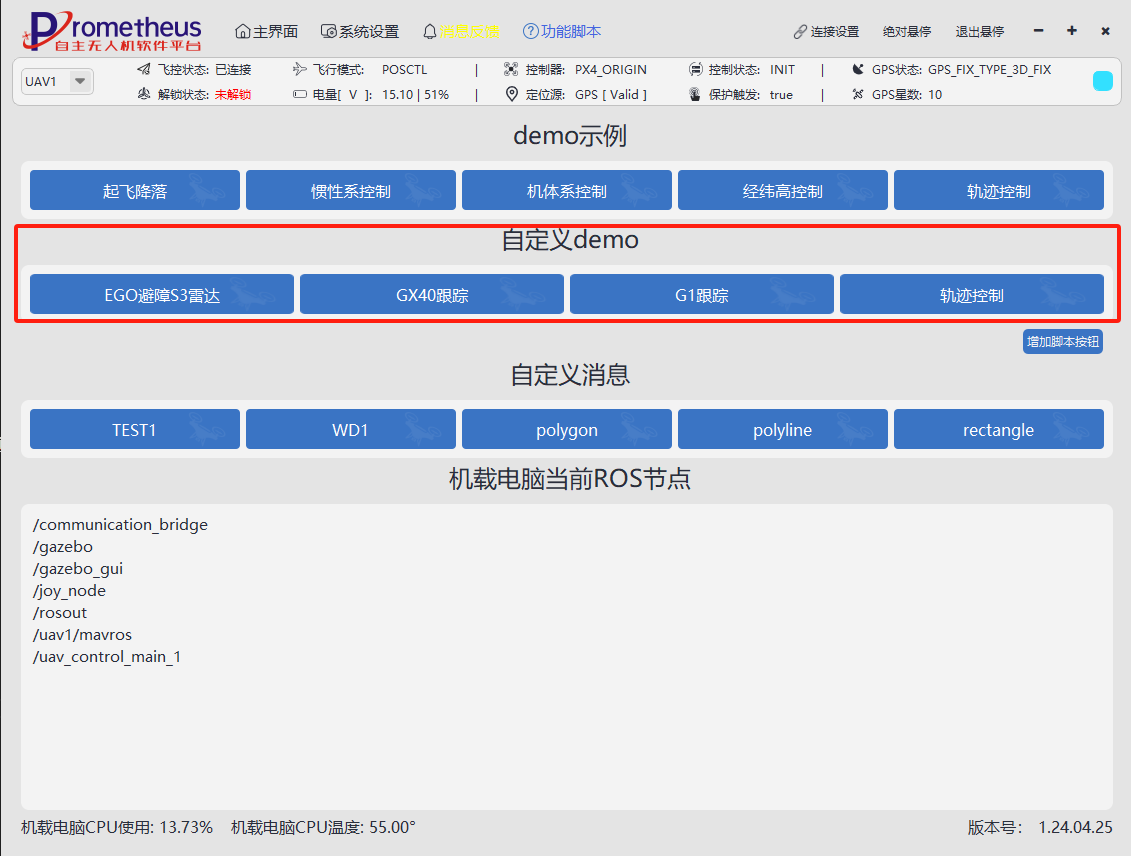

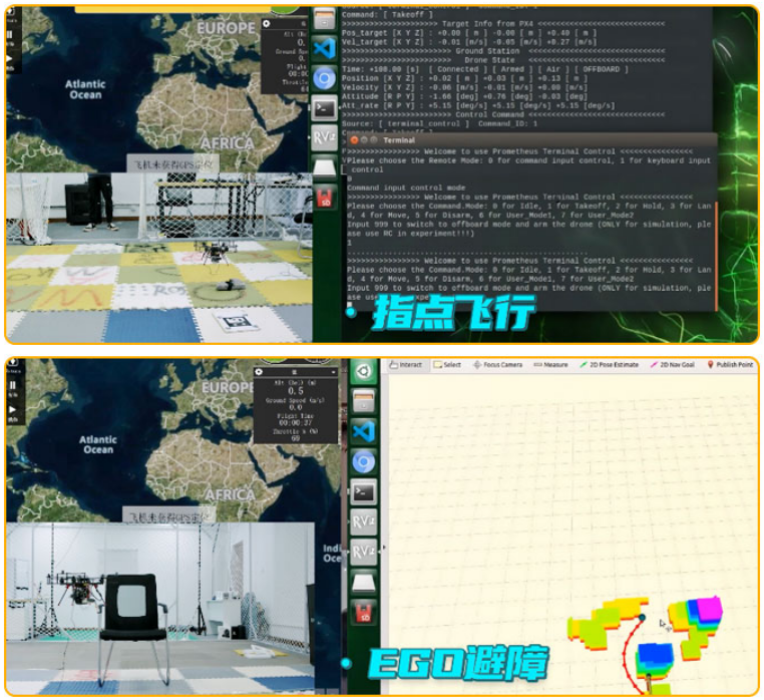

Prometheus是一套开源的自主无人机软件系统平台,为无人机的智能与自主飞行提供全套解决方案。本项目基于PX4开源飞控固件和ROS机器人操作系统,旨在为无人机开发者配套成熟可用的机载电脑端软件系统,提供更加简洁快速的开发体验。目前已集成控制、规划及目标检测等研究方向,提供多个功能demo,并配套有Amovlab仿真组件。

Prometheus项目由阿木实验室运营维护,阿木实验室提供Prometheus项目配套硬件

为什么要用Prometheus?

代码开源

Prometheus项目绝大部分代码都是开源的,并且代码都有比较完善的中文注释,能够帮助大家更好地进行二次开发。

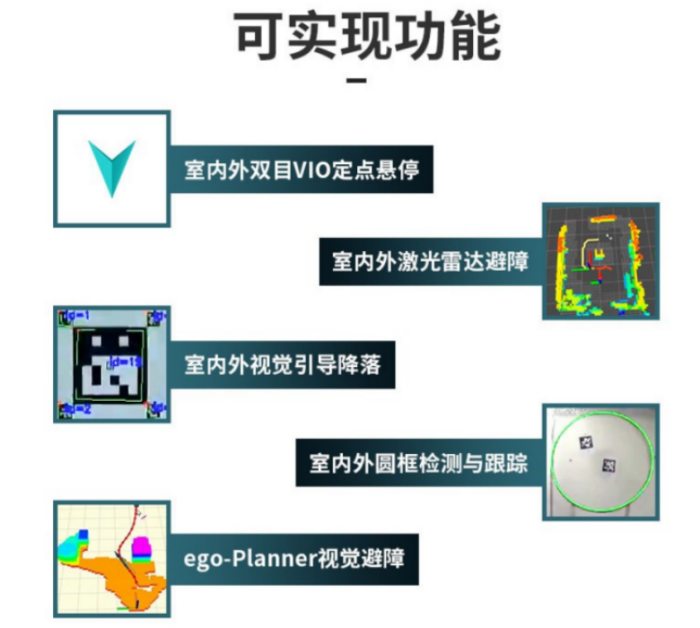

功能丰富

目前已集成控制、规划以及目标检测等功能模块,涉及无人机绝大部分研究方向。

稳定易用

-

所有功能模块均在不同无人机机型、不同场景下经过大量测试,并且所有功能模块均配备有无人机安全保护系统,确保无人机飞行稳定性

-

在功能设计上尽可能减少操作步骤,几乎所有功能操作都可以实现“一键式”操作,确保功能易用性

-

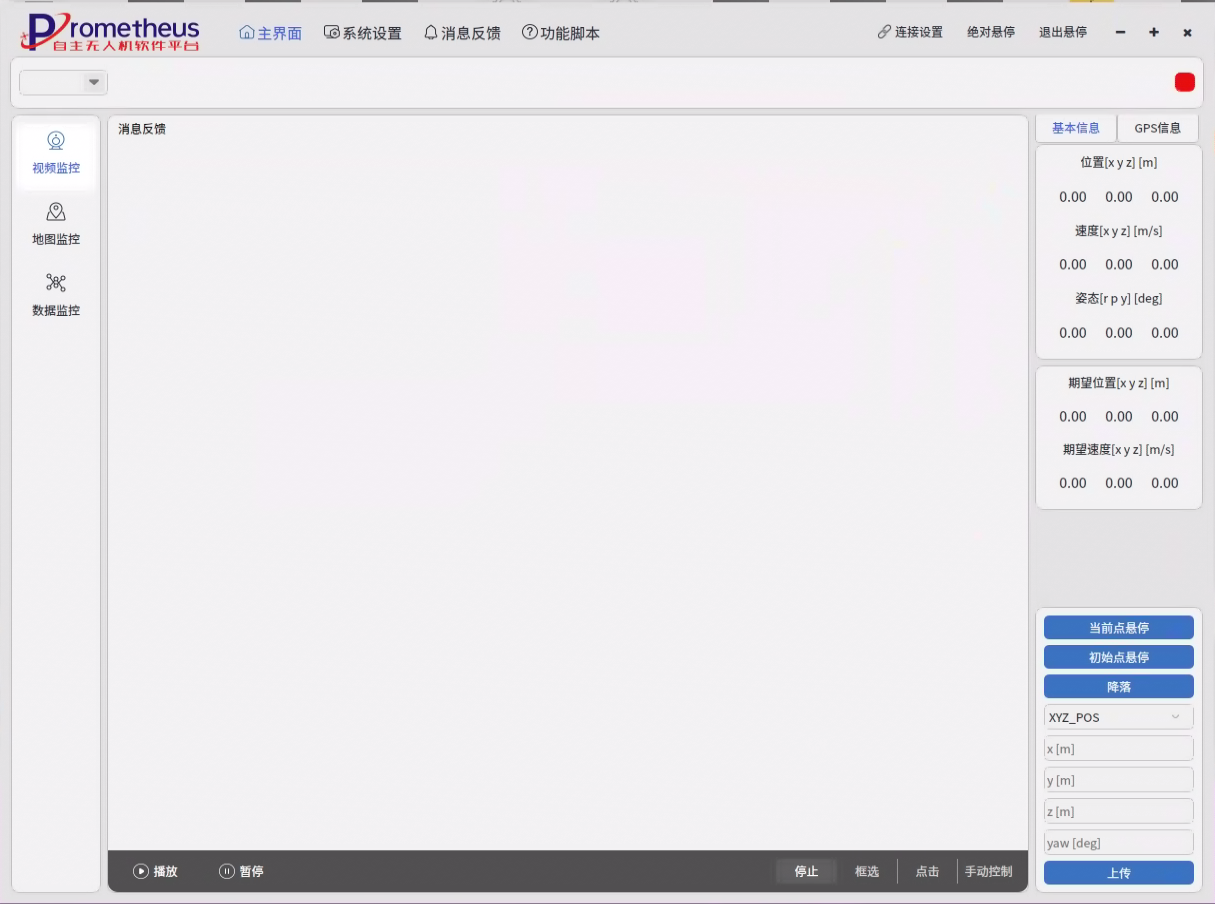

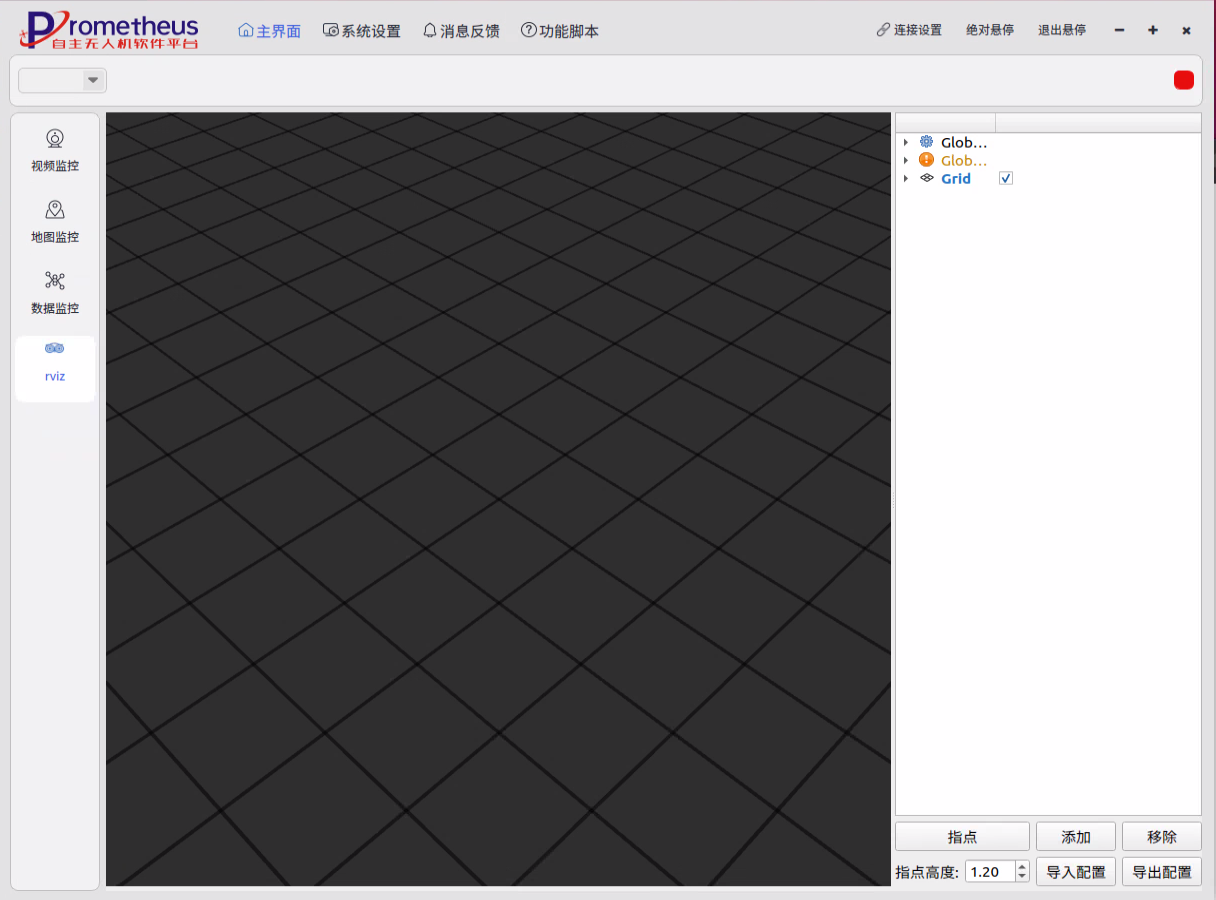

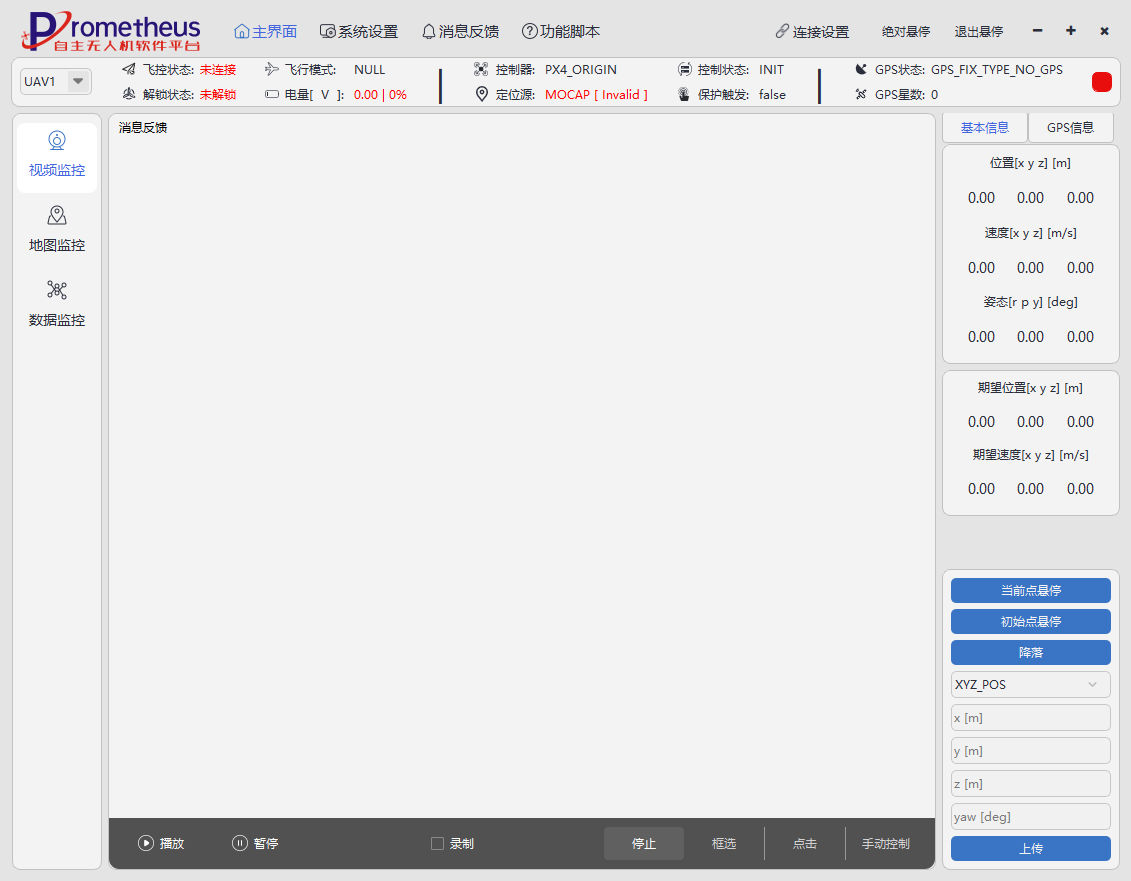

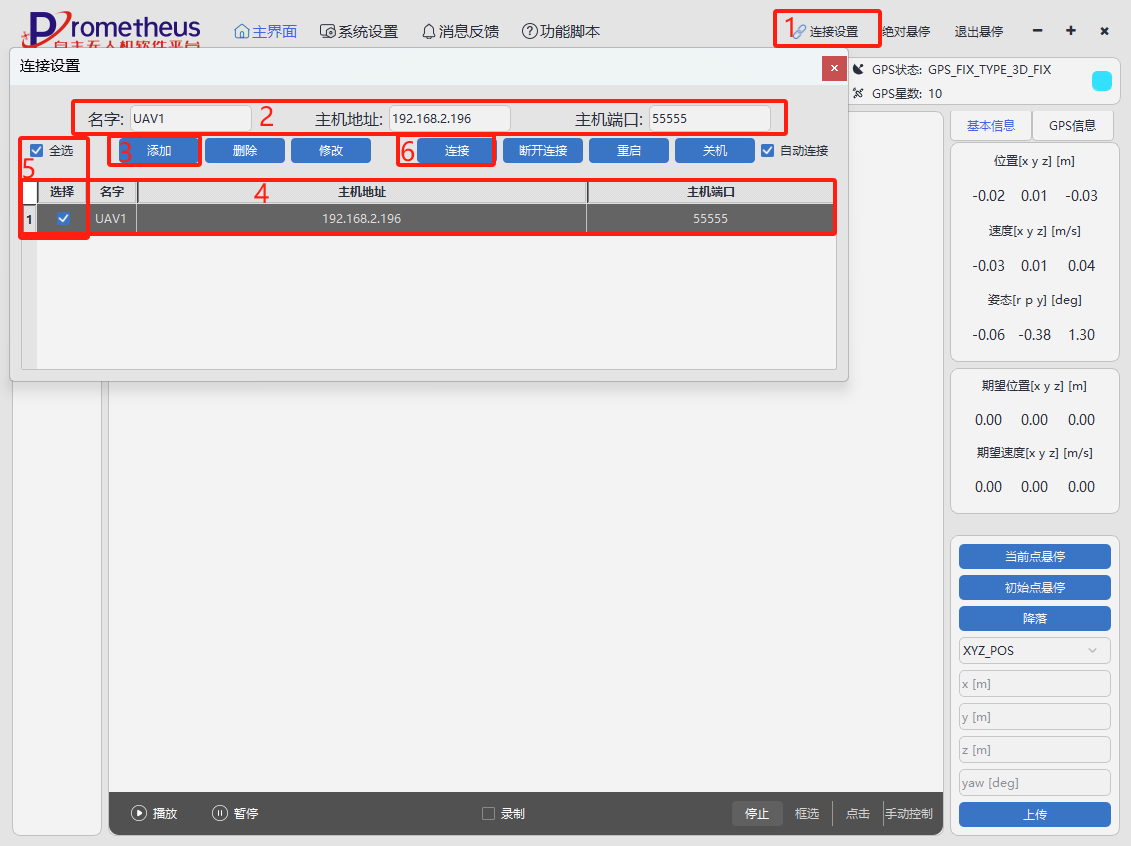

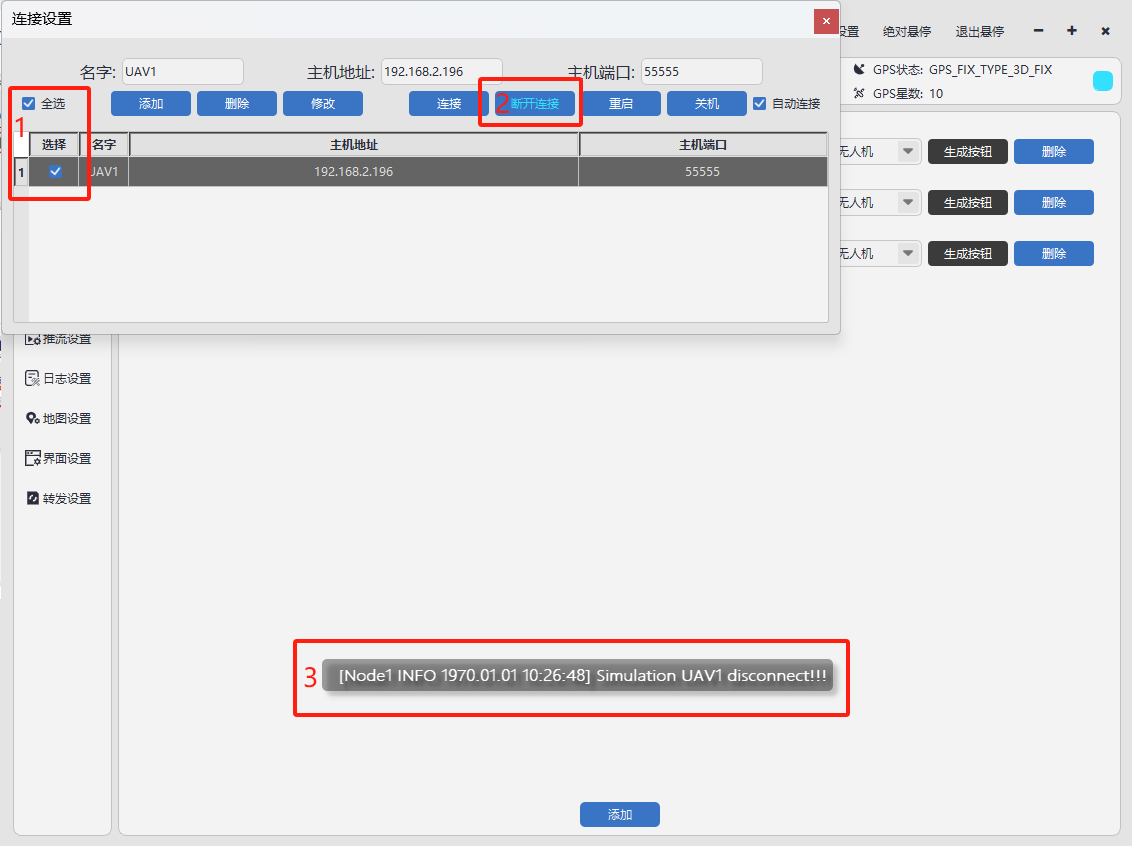

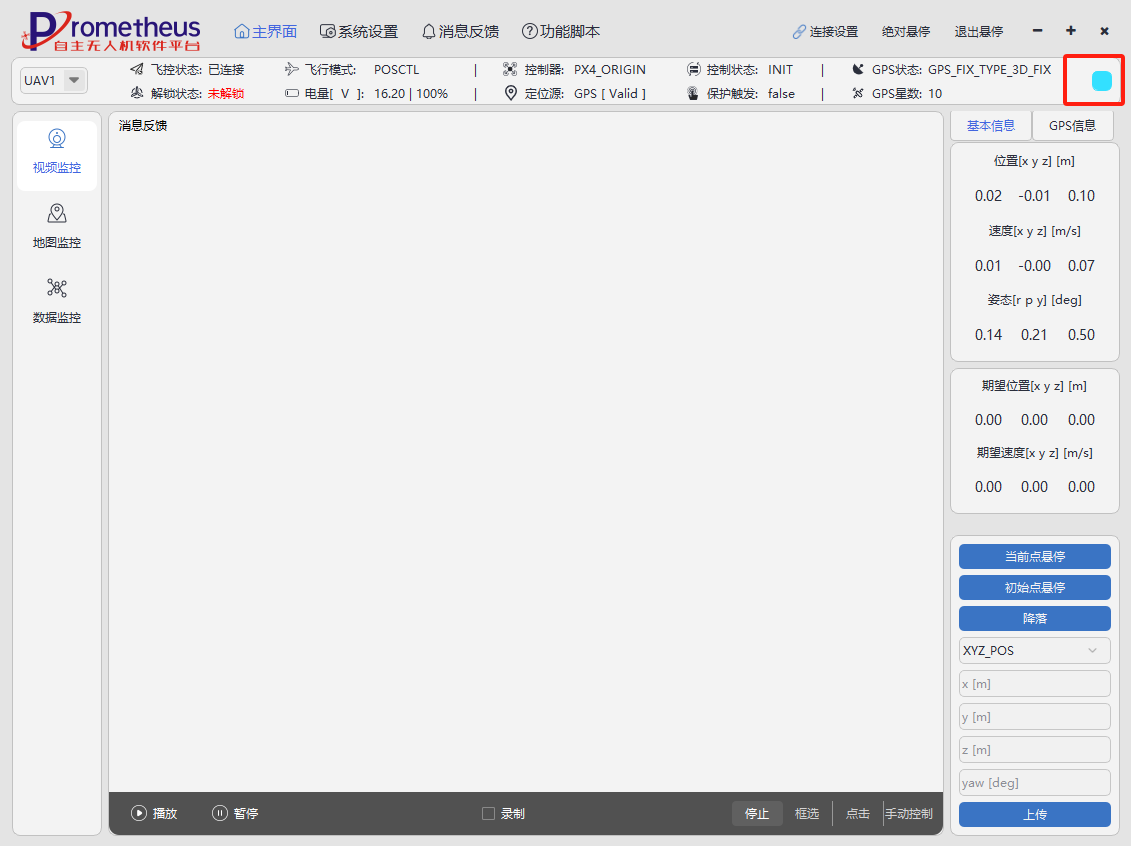

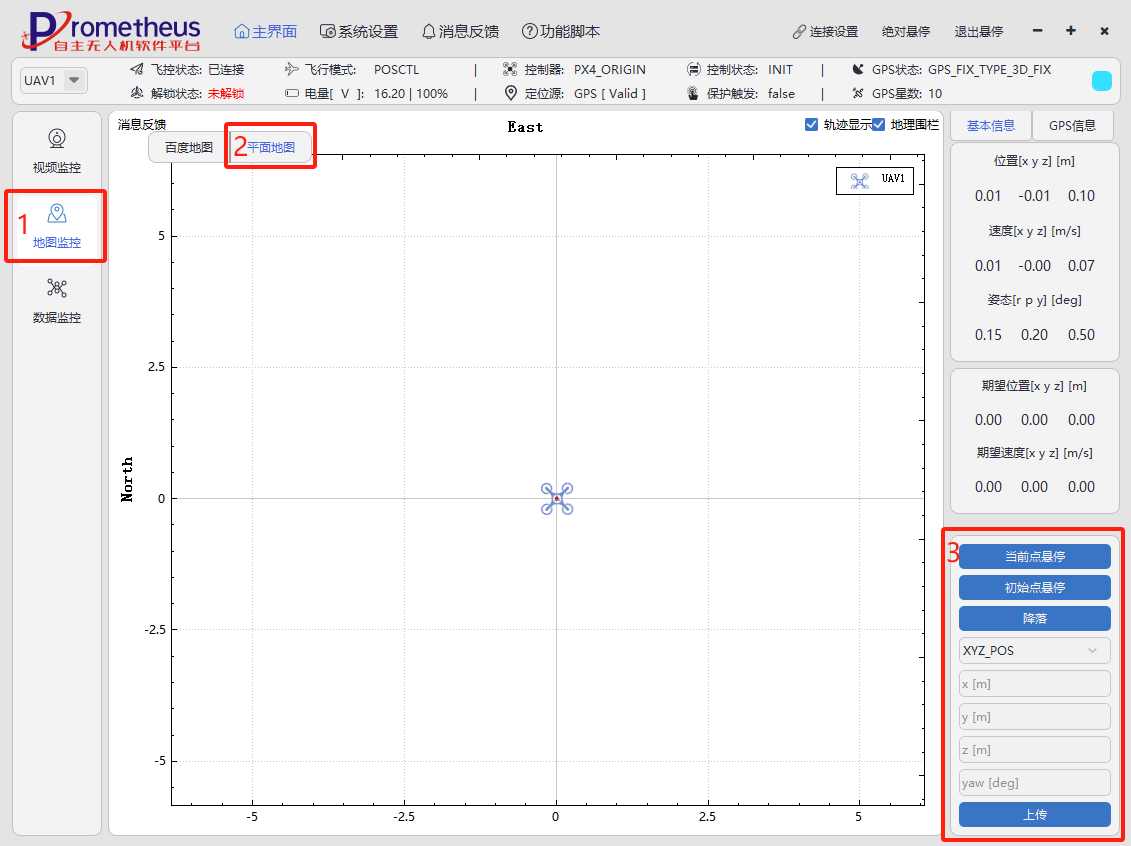

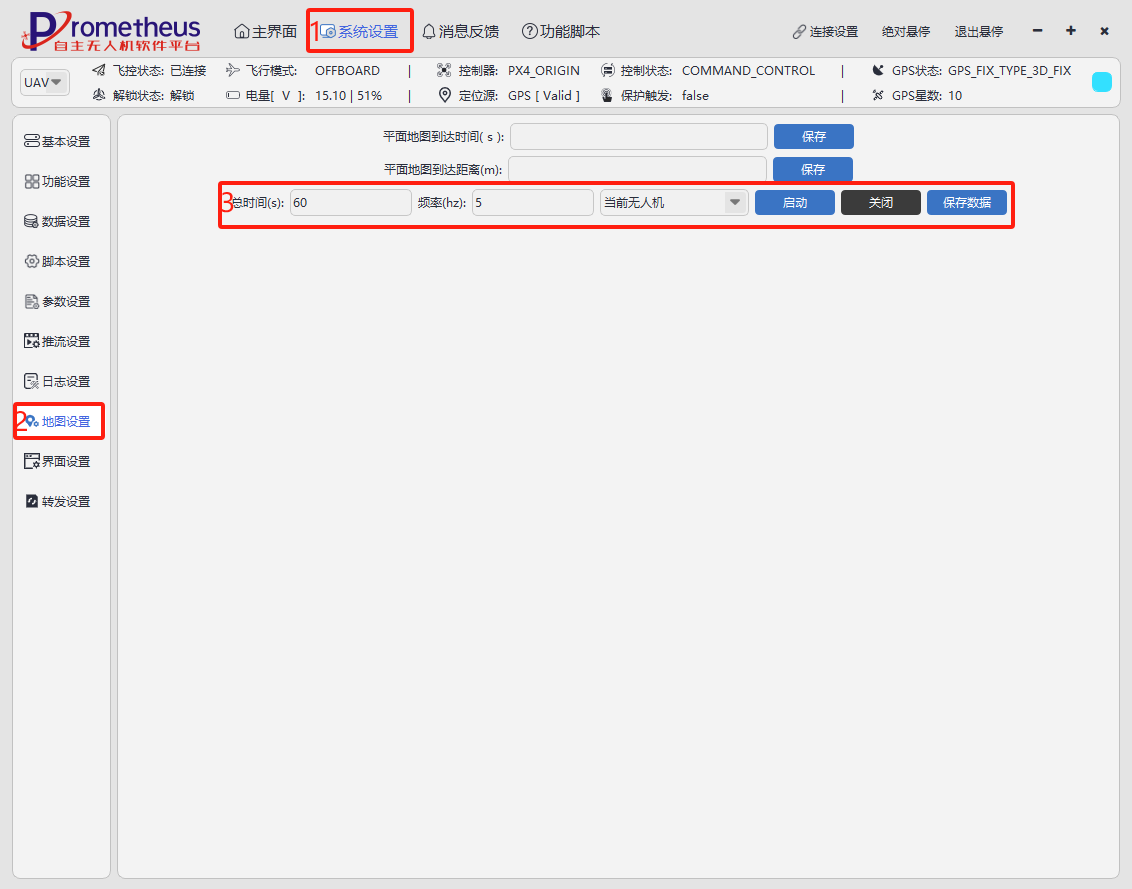

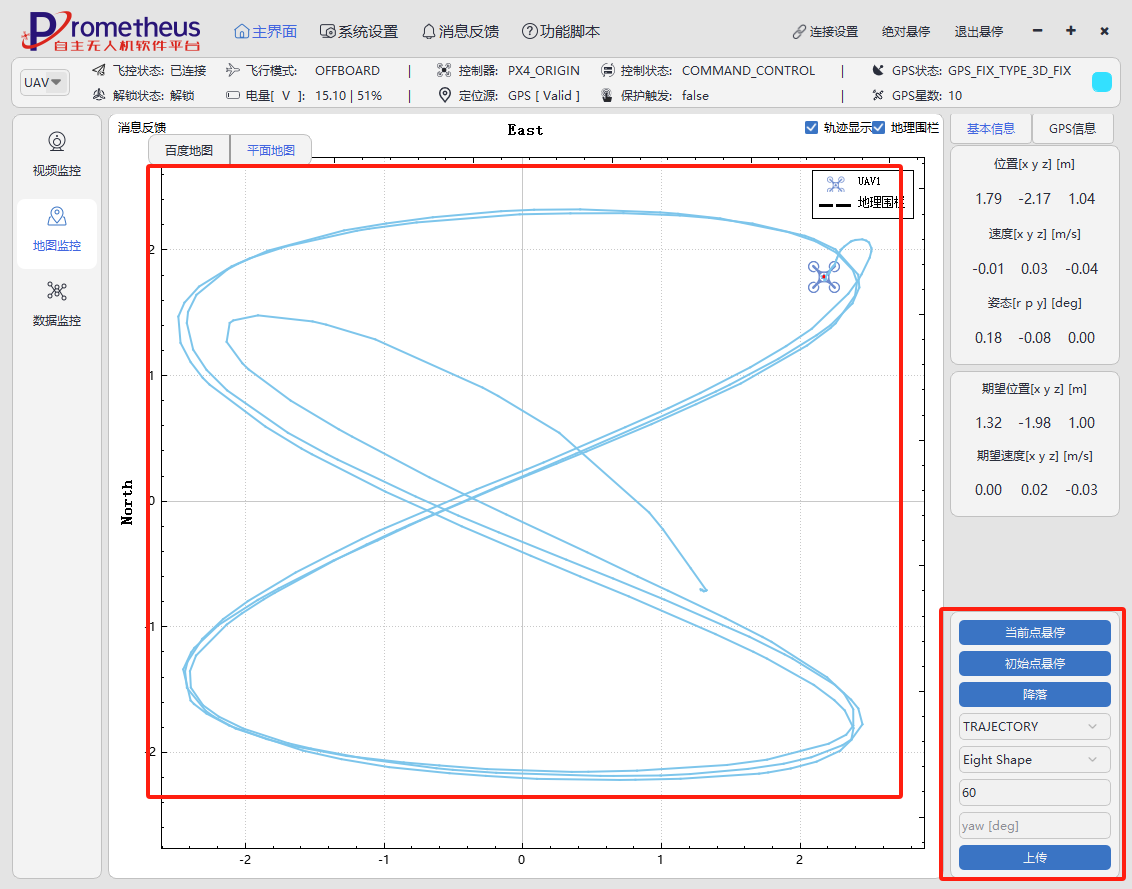

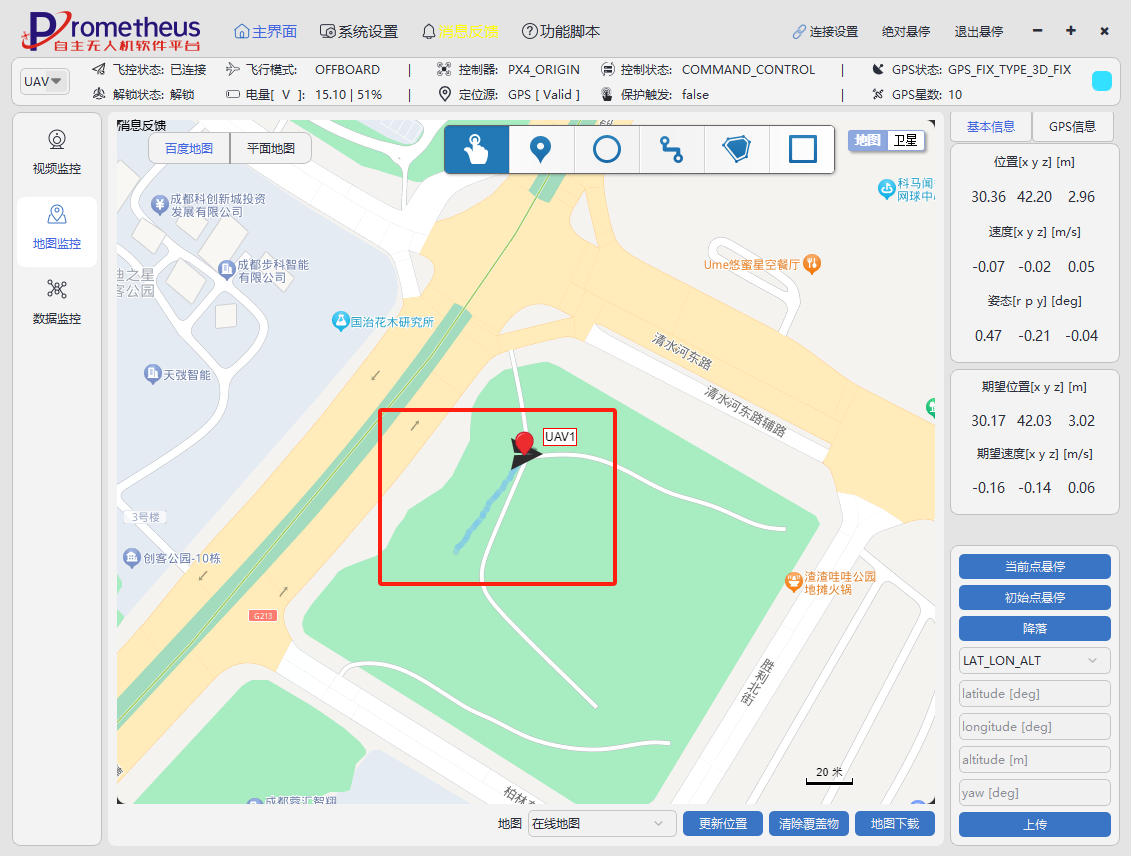

配备有Prometheus地面站,能够支持图形化界面操作

-

提供turtorial_demo模块,该模块拥有更全面的注释,能够帮助用户快速了解Prometheus二次开发接口,上手Prometheus二次开发

配套齐全

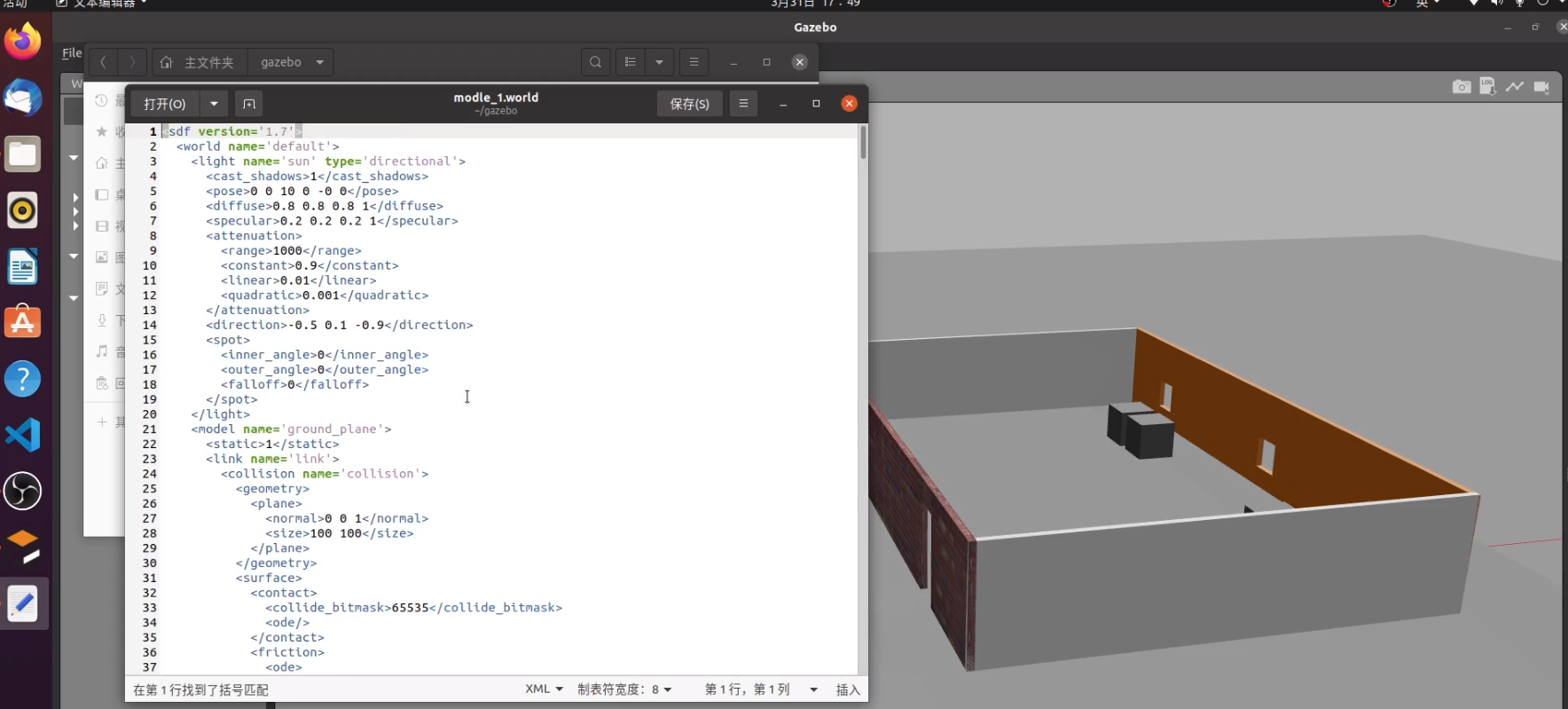

Amovlab仿真组件

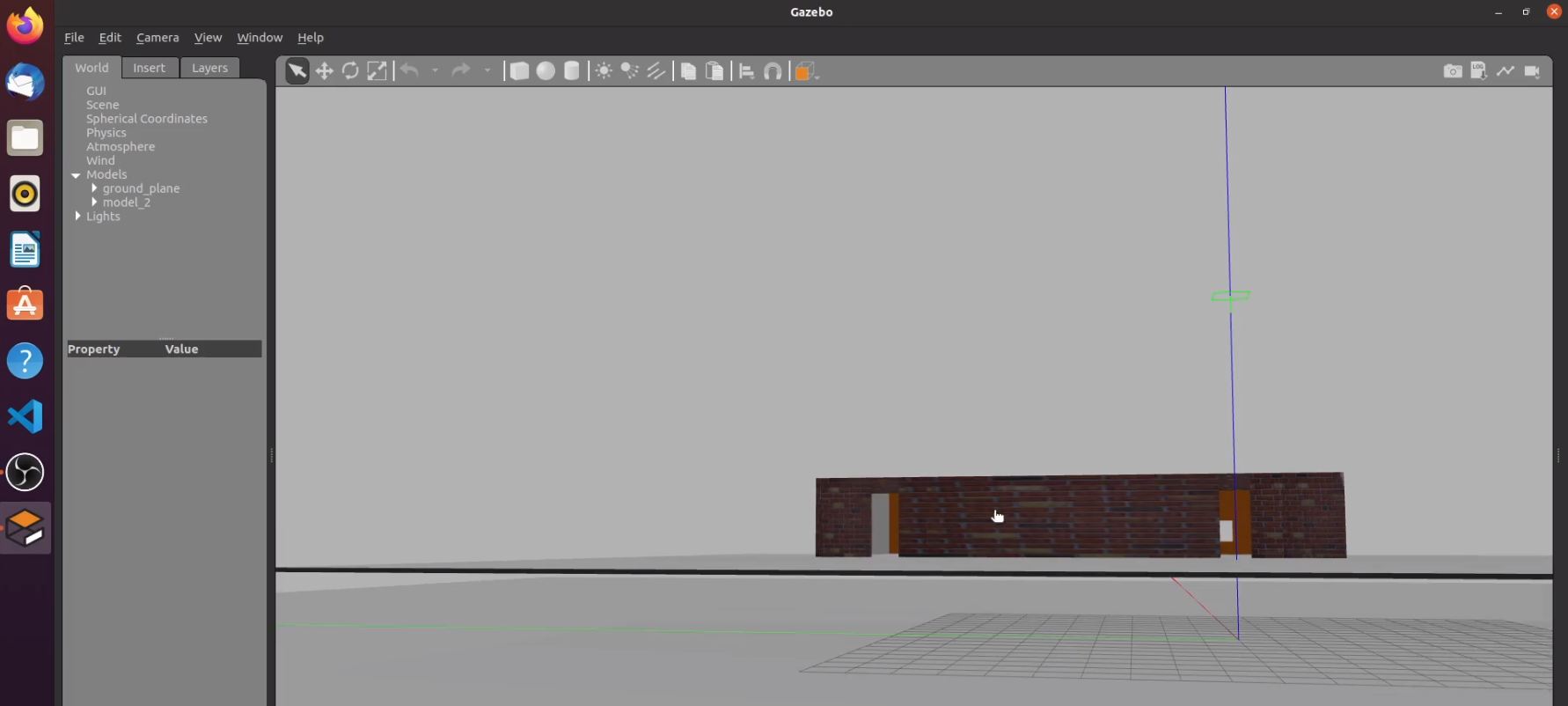

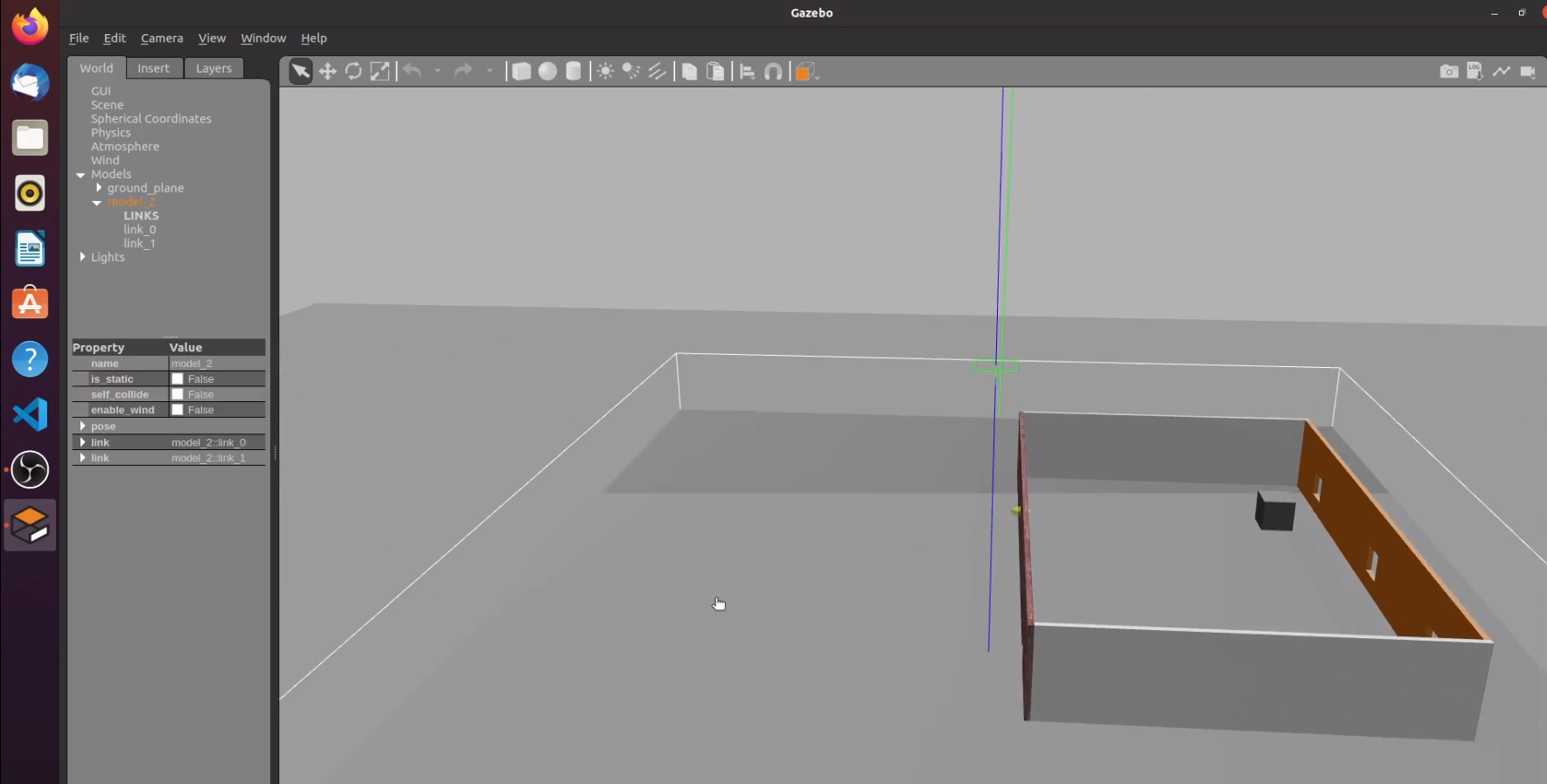

基于Gazebo/PX4/ROS的仿真系统,Prometheus项目所有功能均能够在Amovlab仿真组件上复现,支持二次开发。

仿真镜像系统

提供搭建好Prometheus项目以及相关依赖环境的Ubuntu镜像系统。

配套硬件

仿真镜像系统mini主机、搭载有Prometheus项目的三种不同大小机型产品(p230/p450/p600),适合各种应用场景下的二次开发无人机平台。

Prometheus使用手册

完善的Prometheus使用手册,帮助用户熟悉Prometheus,搭建Prometheus仿真系统以及熟悉Prometheus二次开发接口。

Prometheus配套课程

全面的Prometheus二次开发课程,针对无人机开发者,从零到一掌握无人机开发的基础知识。

Prometheus社区

-

由阿木实验室维护的阿木社区-Prometheus问答专区,在学习使用Prometheus过程中遇到的相关问题都可以在里面进行讨论沟通,Prometheus项目组成员也会定期在论坛里答疑

-

Prometheus微信交流群,需要进Prometheus微信群可扫描下方微信二维码加阿木实验室-嘉月微信联系

-

不定期的直播、线上培训、线下培训等活动,能够更好地帮助大家更好地沟通交流

-

Prometheus校园赞助计划:奖励使用Prometheus进行实验并发表相关论文的学生科研工作者

提示

建议初次查看Prometheus使用手册的用户先阅览Prometheus使用手册概述,先简单了解Prometheus使用手册包含哪些具体内容。

Prometheus使用手册概述

Prometheus-wiki分为以下内容板块

-

本章内容为Prometheus项目概述,通过阅览本章内容,可快速了解Prometheus项目整体情况以及相关内容

-

本章讲解如何快速搭建Prometheus项目仿真环境,分别介绍了使用Ubuntu原生系统以及使用虚拟机两种方式

-

本章讲解Prometheus项目仿真基础知识,主要包含仿真系统框架、仿真功能介绍以及遥控器使用相关说明

-

本章讲解Prometheus无人机控制子模块,包含整个子模块介绍以及功能demo讲解

-

本章讲解Prometheus目标检测子模块,包含整个子模块介绍以及功能demo讲解

-

本章讲解Prometheus路径规划子模块,包含整个子模块介绍以及功能demo讲解

-

本章讲解Prometheus真机教程相关内容,以Z410无人机为例,讲解如何在真机中部署Prometheus项目

-

本章讲解与Prometheus项目其余相关内容,包括Ubuntu、PX4、ROS以及其余相关内容

配套硬件

淘宝Prometheus专区:点击购买

京东Prometheus专区:点击购买

客服咨询(皓月):17360174433(微信同号)

仿真镜像系统mini主机

预装Prometheus、PX4、ROS、Gazebo、MAVROS开发环境,可快速上手仿真开发。京东链接 。

-

特点:

1.搭配8G内存和128G硬盘。

2.拥有HDMI、DP、USB3.0、TypeC等多种接口。

3.已预装Prometheus自主无人机开源项目的官方仿真镜像。

P230

Prometheus230(简称P230)是一款专为科研工作者及无人机开发者设计的无人机实验室平台,适用于室内环境,提供控制、SLAM、室内定位、视觉避障、路径规划等功能demo。京东链接 。

-

特点:

1.内置基于PX4-ROS的控制模块和SLAM、自主决策、编队、避障等多种算法。

2.搭载Pixhawk4 Mini开源飞控与英伟达Jetson Xavier NX边缘AI计算机。

3.预装基于PX4+ROS的Prometheus自主无人机机载系统。

4.配置Intel RealSense D435i深度相机。

5.可通过内置的VINS-Fusion和EGO-Planner等算法。

6.可实现室内定点飞行、路径规划和自主避障等功能。

7.可广泛应用于室内环境下的无人机编队。

8.支持接入主流的MOCAP动作捕捉和UWB等外部定位系统,通过ROS组网实现室内的编队飞行。

P450

Prometheus450(简称P450)是一款专为科研工作者及无人机开发者设计的无人机实验平台,兼容室内外环境,提供控制、SLAM、室内/室外定位、激光雷达/视觉避障、目标检测、路径规划等功能demo。京东链接 。

.png)

.png)

-

特点:

-

基于Pixhawk V4开源飞控架构,通过内走线设计集成了高性能旋翼动力系统。

-

可轻易实现室内/室外的简易飞行控制。

-

搭载Nvidia Jetson Xavier NX机载计算机。

-

内置ROS(机器人操作系统)环境下的无人机控制程序与多种前沿算法。

-

可一键实现目标识别、激光SLAM、视觉避障等功能。

-

采用3D打印外壳&轻量化碳管机架的设计,提高了传感器的搭载量。

-

高拓展性的二次开发平台,支持使用者自行加装其他设备,满足不同的研发需求。

-

所有功能及相关算法均通过开源项目Prometheus发布了源代码与仿真脚本,真正做到到手即飞,即刻开发!

-

P600

Prometheus600(简称P600)是一款专为科研工作者及无人机开发者设计的无人机实验平台,适用于室外环境,提供控制、室外定位、激光雷达避障、目标检测、目标追踪、圆叉降落等功能demo。京东链接 。

.png)

.png)

.png)

.png)

-

特点:

-

全机身内走线+内置飞控的设计,预留三层拓展空间,可自由地加装适配PX4飞控或ROS的传感器。

-

可搭载云台吊舱、激光雷达与图数传一体组网链路等挂载设备。

-

实现基于视觉的目标识别、框选追踪、激光雷达避障、室外指点飞行等功能。

-

具备超视距多机组网+图数传通信的能力。

-

内置基于Pixhawk V5深度优化的飞控核心,贴合开发者使用习惯。

-

可选配10倍变焦光电吊舱、激光雷达与图数传一体组网链路。

-

支持复现Prometheus中的KCF框选追踪、A*全局规划、激光雷达SLAM和YOLO通用目标识别等算法。

-

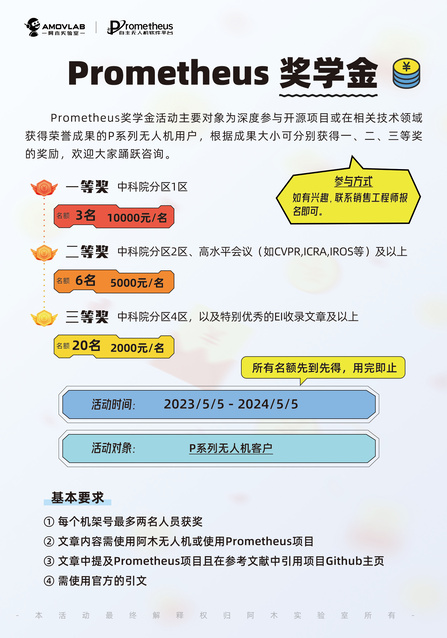

Prometheus校园赞助计划

赞助示例

-

题目:拦截非合作机动四旋翼的最优末速控制制导律

-

期刊:中科院分区2区 - 机器人领域顶刊《Journal of Field Robotics》

-

作者:陶宏,林德福,何绍溟,宋韬,金忍

-

作者单位:北京理工大学无人自主控制研究所

-

通讯作者:宋韬

Prometheus项目组

高校科研团队

-

戚煜华(项目创始人):中山大学博士后,本科及博士毕业于北京理工大学,在自主无人机平台搭建及二次开发方面经验丰富。参与多项航空航天科研院所无人 机相关项目,曾获得2017年国际微小型无人机比赛第三名,已在铂贝学院开设PX4自主无人机线下培训课程10次,累计培训学员300余人次。 目前在International Journal of Systems Science及Robotics and Autonomous Systems等SCI期刊上发表论文4篇,会议论文3篇。主要研究方向为:无人机控制、自主避障等。

-

金忍(目标检测):北京理工大学博士后/博士,多年从事机器视觉、无人机视觉的开发及教学工作,曾作为视觉组队长参加2017与2020年穆罕默德·本·扎耶德国际机器人挑战赛(MBZIRC),两次获得冠军。目前在Journal of Field Robotics等SCI期刊上发表论文3篇,会议论文2篇。擅长数据驱动算法编写、性能优化、实时计算等,研究兴趣主要包括深度学习,目标检测与跟踪,迁移学习,目标定位与姿态估计。

-

祝洋(控制方向):西南交通大学助理教授,博士毕业于电子科技大学,长期以理论与工程紧密结合的方式开展无人机、运动体和集群的(多源)抗干扰控制技术 研究、验证与应用。目前已在TIM、IJRNC等期刊发表SCI论文5篇(其中包括IJRNC封面论文一篇),会议论文6篇(其中两篇分别获得ICCA2018和GNCC2018两个会议的Best Paper Finalist) 。负责Prometheus Matlab工具包模块。

-

江涛(路径规划):重庆大学讲师,北京理工大学博士,具有多年无人机系统、控制和导航算法开发经验。参与过多项航空航天科研院所无人机相关项目,曾获得2017年穆罕默德·本·扎耶德国际机器人挑战赛(MBZIRC)冠军。目前在Journal of the Franklin Institute等SCI期刊上发表无人机自主控制论文7篇。主要研究方向包括:无人机自主控制、移动机器人规划和定位建图等。

-

李春雨(SLAM):北京理工大学在读博士,具有丰富的竞赛经验及仿真系统的开发经验,负责阿木实验室Prometheus系列无人机的视觉导航及仿真部分的开发。主要研究兴趣包括:无人机状态估计、无人机高机动自主飞行等

阿木实验室研发团队

-

王根(阿木实验室研发总监):参与PX4开源技术的推广与培训,累计培训学员近千人,主要研究方向:嵌入式驱动开发、PX4系统二次开发与控制调参、ROS系统二次开发与产品落地。参与Prometheus项目飞控端的适配与开发工作。

-

弋鑫(控制算法工程师):在控制算法工程师开源飞控及自主无人机二次开发方面经验丰富,参与多个航空航天院校及科研院所自主无人机项目。目前主要负责P系列无人机开发与维护,负责无人机控制模块、路径规划模块、gazebo仿真模块的开发与测试。

-

李博(控制算法工程师):多年从事研究无人车、类人型机器人、无人机以及编队集群等系统开发相关工作,参与多个无人车以及集群相关项目,行业经验丰富。目前负责阿木实验室无人车以及集群相关开发、维护及测试工作。负责Prometheus集群控制模块的开发与测试。

-

张灵(软件工程师):参与过多个机器人相关的项目,负责其中的通信以及地面站开发工作;目前在阿木实验室负责P系列无人机、R系列无人车的通信模块和地面站的开发、维护及调试工作。负责Prometheus集群地面站的开发与测试。

-

王明(视觉算法工程师):参与过多项与深度学习相关的计算机视觉,自然语言处理工作,负责阿木实验室的P系列无人机的视觉算法的落地,P600无人机的软件开发,维护及调试,以及AirSim仿真的推进。负责Prometheus视觉模块的开发与测试。

-

李科衡(视觉算法工程师):参与过多项机器人竞赛以及和机器人相关的项目,负责阿木实验室吊舱开发、维护及调试,主要研究方向:目标检测、目标追踪、视频编解码(Deepstream)。参与Prometheus目标追踪模块的开发与测试。

-

张子超 (结构工程师):从事多年无人机、无人车、消费级电子产品结构及外观设计,在产品设计领域有丰富的经验,参与过多款阿木实验室无人机产品的研发。负责Prometheus项目中无人机、无人车产品外观与结构的设计。

-

龙飞宇(无人车工程师):哈尔滨工业大学校友,ROS经验丰富。参与过多项机器人竞赛及其项目。目前负责阿木实验室Rhea无人车项目开发、维护与落地以及刘锦涛博士智能机器人集群项目的工程落地。负责Rhea无人车控制、无人车教学模块的开发与测试。

开源License及版权声明

Apache License Version 2.0, January 2004 http://www.apache.org/licenses/

TERMS AND CONDITIONS FOR USE, REPRODUCTION, AND DISTRIBUTION

-

Definitions.

"License" shall mean the terms and conditions for use, reproduction, and distribution as defined by Sections 1 through 9 of this document.

"Licensor" shall mean the copyright owner or entity authorized by the copyright owner that is granting the License.

"Legal Entity" shall mean the union of the acting entity and all other entities that control, are controlled by, or are under common control with that entity. For the purposes of this definition, "control" means (i) the power, direct or indirect, to cause the direction or management of such entity, whether by contract or otherwise, or (ii) ownership of fifty percent (50%) or more of the outstanding shares, or (iii) beneficial ownership of such entity.

"You" (or "Your") shall mean an individual or Legal Entity exercising permissions granted by this License.

"Source" form shall mean the preferred form for making modifications, including but not limited to software source code, documentation source, and configuration files.

"Object" form shall mean any form resulting from mechanical transformation or translation of a Source form, including but not limited to compiled object code, generated documentation, and conversions to other media types.

"Work" shall mean the work of authorship, whether in Source or Object form, made available under the License, as indicated by a copyright notice that is included in or attached to the work (an example is provided in the Appendix below).

"Derivative Works" shall mean any work, whether in Source or Object form, that is based on (or derived from) the Work and for which the editorial revisions, annotations, elaborations, or other modifications represent, as a whole, an original work of authorship. For the purposes of this License, Derivative Works shall not include works that remain separable from, or merely link (or bind by name) to the interfaces of, the Work and Derivative Works thereof.

"Contribution" shall mean any work of authorship, including the original version of the Work and any modifications or additions to that Work or Derivative Works thereof, that is intentionally submitted to Licensor for inclusion in the Work by the copyright owner or by an individual or Legal Entity authorized to submit on behalf of the copyright owner. For the purposes of this definition, "submitted" means any form of electronic, verbal, or written communication sent to the Licensor or its representatives, including but not limited to communication on electronic mailing lists, source code control systems, and issue tracking systems that are managed by, or on behalf of, the Licensor for the purpose of discussing and improving the Work, but excluding communication that is conspicuously marked or otherwise designated in writing by the copyright owner as "Not a Contribution".

"Contributor" shall mean Licensor and any individual or Legal Entity on behalf of whom a Contribution has been received by Licensor and subsequently incorporated within the Work.

-

Grant of Copyright License. Subject to the terms and conditions of this License, each Contributor hereby grants to You a perpetual, worldwide, non-exclusive, no-charge, royalty-free, irrevocable copyright license to reproduce, prepare Derivative Works of, publicly display, publicly perform, sublicense, and distribute the Work and such Derivative Works in Source or Object form.

-

Grant of Patent License. Subject to the terms and conditions of this License, each Contributor hereby grants to You a perpetual, worldwide, non-exclusive, no-charge, royalty-free, irrevocable (except as stated in this section) patent license to make, have made, use, offer to sell, sell, import, and otherwise transfer the Work, where such license applies only to those patent claims licensable by such Contributor that are necessarily infringed by their Contribution(s) alone or by combination of their Contribution(s) with the Work to which such Contribution(s) was submitted. If You institute patent litigation against any entity (including a cross-claim or counterclaim in a lawsuit) alleging that the Work or a Contribution incorporated within the Work constitutes direct or contributory patent infringement, then any patent licenses granted to You under this License for that Work shall terminate as of the date such litigation is filed.

-

Redistribution. You may reproduce and distribute copies of the Work or Derivative Works thereof in any medium, with or without modifications, and in Source or Object form, provided that You meet the following conditions:

-

You must give any other recipients of the Work or Derivative Works a copy of this License; and

-

You must cause any modified files to carry prominent notices stating that You changed the files; and

-

You must retain, in the Source form of any Derivative Works that You distribute, all copyright, patent, trademark, and attribution notices from the Source form of the Work, excluding those notices that do not pertain to any part of the Derivative Works; and

-

If the Work includes a "NOTICE" text file as part of its distribution, then any Derivative Works that You distribute must include a readable copy of the attribution notices contained within such NOTICE file, excluding those notices that do not pertain to any part of the Derivative Works, in at least one of the following places: within a NOTICE text file distributed as part of the Derivative Works; within the Source form or documentation, if provided along with the Derivative Works; or, within a display generated by the Derivative Works, if and wherever such third-party notices normally appear. The contents of the NOTICE file are for informational purposes only and do not modify the License. You may add Your own attribution notices within Derivative Works that You distribute, alongside or as an addendum to the NOTICE text from the Work, provided that such additional attribution notices cannot be construed as modifying the License.

You may add Your own copyright statement to Your modifications and may provide additional or different license terms and conditions for use, reproduction, or distribution of Your modifications, or for any such Derivative Works as a whole, provided Your use, reproduction, and distribution of the Work otherwise complies with the conditions stated in this License.

-

-

Submission of Contributions. Unless You explicitly state otherwise, any Contribution intentionally submitted for inclusion in the Work by You to the Licensor shall be under the terms and conditions of this License, without any additional terms or conditions. Notwithstanding the above, nothing herein shall supersede or modify the terms of any separate license agreement you may have executed with Licensor regarding such Contributions.

-

Trademarks. This License does not grant permission to use the trade names, trademarks, service marks, or product names of the Licensor, except as required for reasonable and customary use in describing the origin of the Work and reproducing the content of the NOTICE file.

-

Disclaimer of Warranty. Unless required by applicable law or agreed to in writing, Licensor provides the Work (and each Contributor provides its Contributions) on an "AS IS" BASIS, WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied, including, without limitation, any warranties or conditions of TITLE, NON-INFRINGEMENT, MERCHANTABILITY, or FITNESS FOR A PARTICULAR PURPOSE. You are solely responsible for determining the appropriateness of using or redistributing the Work and assume any risks associated with Your exercise of permissions under this License.

-

Limitation of Liability. In no event and under no legal theory, whether in tort (including negligence), contract, or otherwise, unless required by applicable law (such as deliberate and grossly negligent acts) or agreed to in writing, shall any Contributor be liable to You for damages, including any direct, indirect, special, incidental, or consequential damages of any character arising as a result of this License or out of the use or inability to use the Work (including but not limited to damages for loss of goodwill, work stoppage, computer failure or malfunction, or any and all other commercial damages or losses), even if such Contributor has been advised of the possibility of such damages.

-

Accepting Warranty or Additional Liability. While redistributing the Work or Derivative Works thereof, You may choose to offer, and charge a fee for, acceptance of support, warranty, indemnity, or other liability obligations and/or rights consistent with this License. However, in accepting such obligations, You may act only on Your own behalf and on Your sole responsibility, not on behalf of any other Contributor, and only if You agree to indemnify, defend, and hold each Contributor harmless for any liability incurred by, or claims asserted against, such Contributor by reason of your accepting any such warranty or additional liability.

END OF TERMS AND CONDITIONS

Copyright 2022 AMOVLAB

Licensed under the Apache License, Version 2.0 (the "License"); you may not use this file except in compliance with the License. You may obtain a copy of the License at

http://www.apache.org/licenses/LICENSE-2.0

Unless required by applicable law or agreed to in writing, software distributed under the License is distributed on an "AS IS" BASIS, WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied. See the License for the specific language governing permissions and limitations under the License.

快速上手

本章将讲解如何快速搭建Prometheus仿真环境

提示

Prometheus仿真环境搭建出现相关问题或异常可以前往Prometheus配置常见问题处理 查询相关解决办法,如果没有,可前往阿木社区-Prometheus问答专区或Prometheus微信交流群提问

本教程提供Ubuntu系统下载搭建Prometheus仿真环境以及使用Prometheus仿真镜像系统两种安装方式,任选其中一种方式安装即可。

Ubuntu系统下载搭建Prometheus仿真环境教程除使用手册有介绍外,还搭配有视频教程(如下),用户可参考文档结合视频学习。 Matlab-Gazebo联合仿真展示

提示

虽然使用虚拟机和Prometheus仿真镜像系统能够快速搭建环境,但我们仍然建议大家能够从0到1搭建整个Prometheus环境,这对于后面的开发是非常有意义的。也能够让大家能够对整个Prometheus系统能有更深入地理解。

旧版本Prometheus删除

-

如果已经安装过旧版本的Prometheus项目(指在2022年7月20日之前已完成Prometheus项目的安装),建议先删除Prometheus以及prometheus_px4,然后按照本教程进行安装。

-

.bashrc中prometheus以及prometheus_px4相关环境变量需删除,重新按照本教程添加相关环境变量。

运行第一次仿真

仿真运行依赖于遥控器,需要通过USB数据线将遥控器与仿真电脑进行连接。

如需购买遥控器请点击遥控器购买链接

如果使用其他遥控器,只要数据流能符合目前的程序设计也是可以的。可以查看仿真中的遥控器使用说明中遥控器通道以及含义进行对比。

输入以下命令启动仿真功能测试脚本文件。

# 请将示例中的{your prometheus path}替换为prometheus的安装路径

cd ${your prometheus path}/Prometheus/Scripts/simulation/px4_gazebo_sitl_test

# 第一次使用时需要给脚本文件添加可执行权限

chmod +x px4_sitl_*

# 启动室外无人机仿真启动脚本

./px4_sitl_outdoor.sh

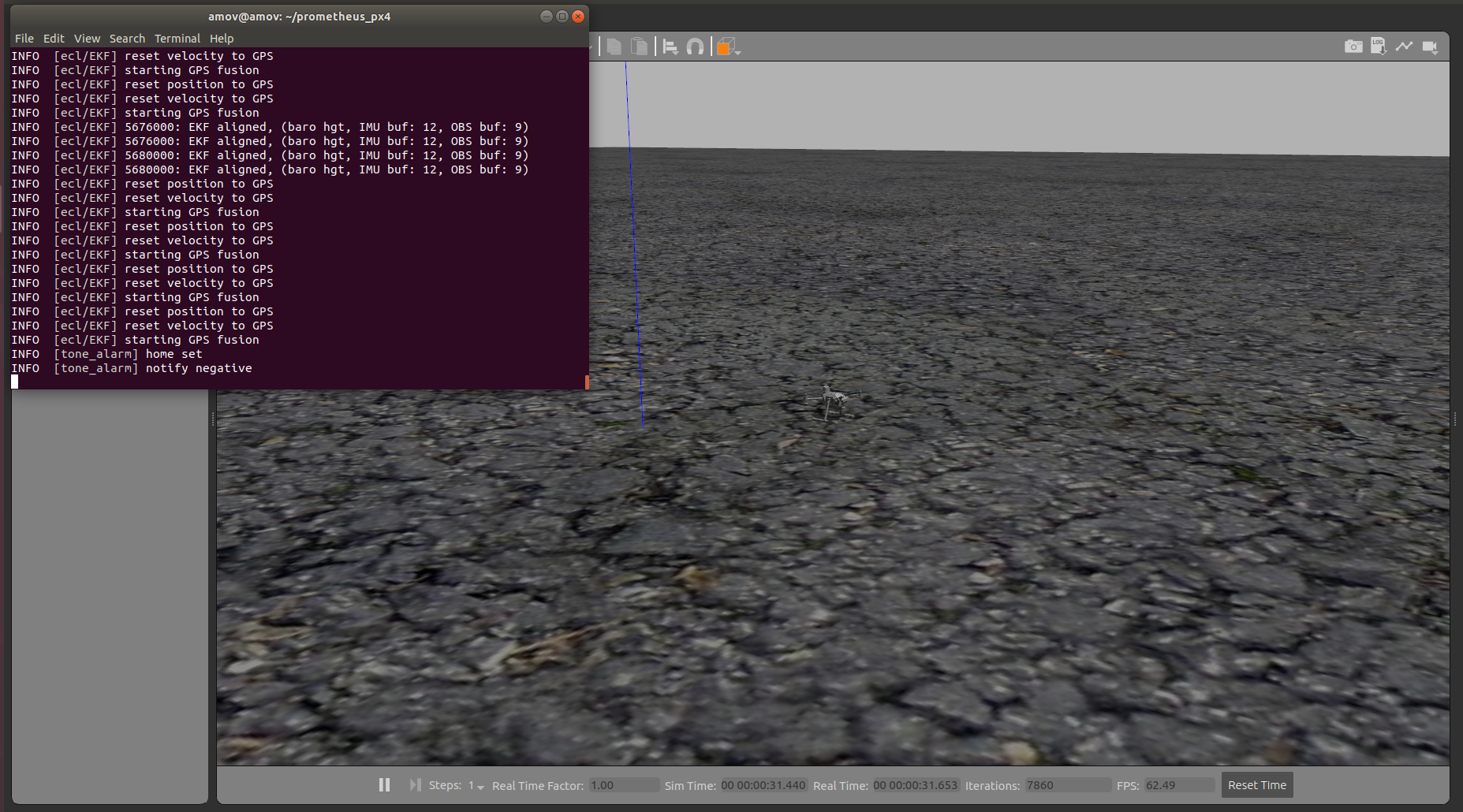

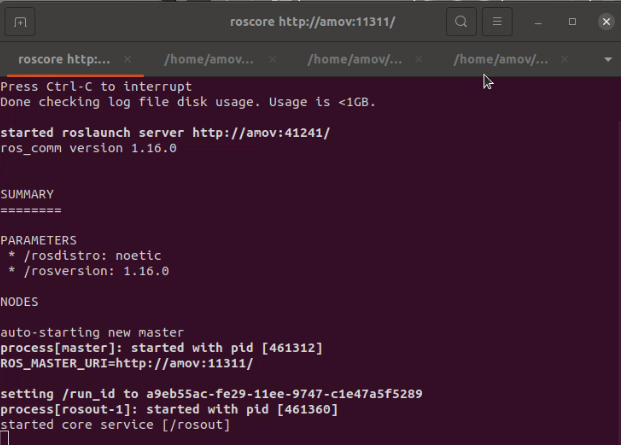

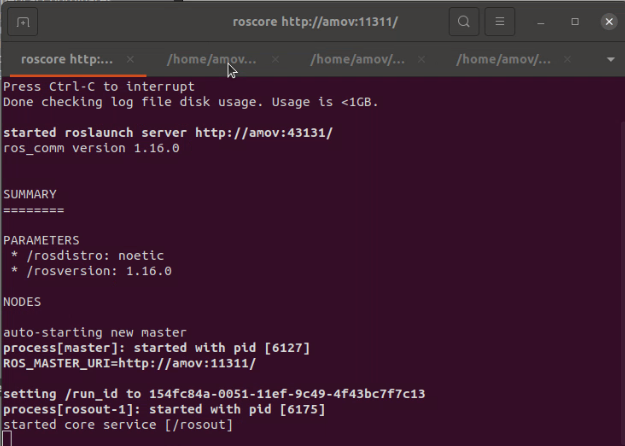

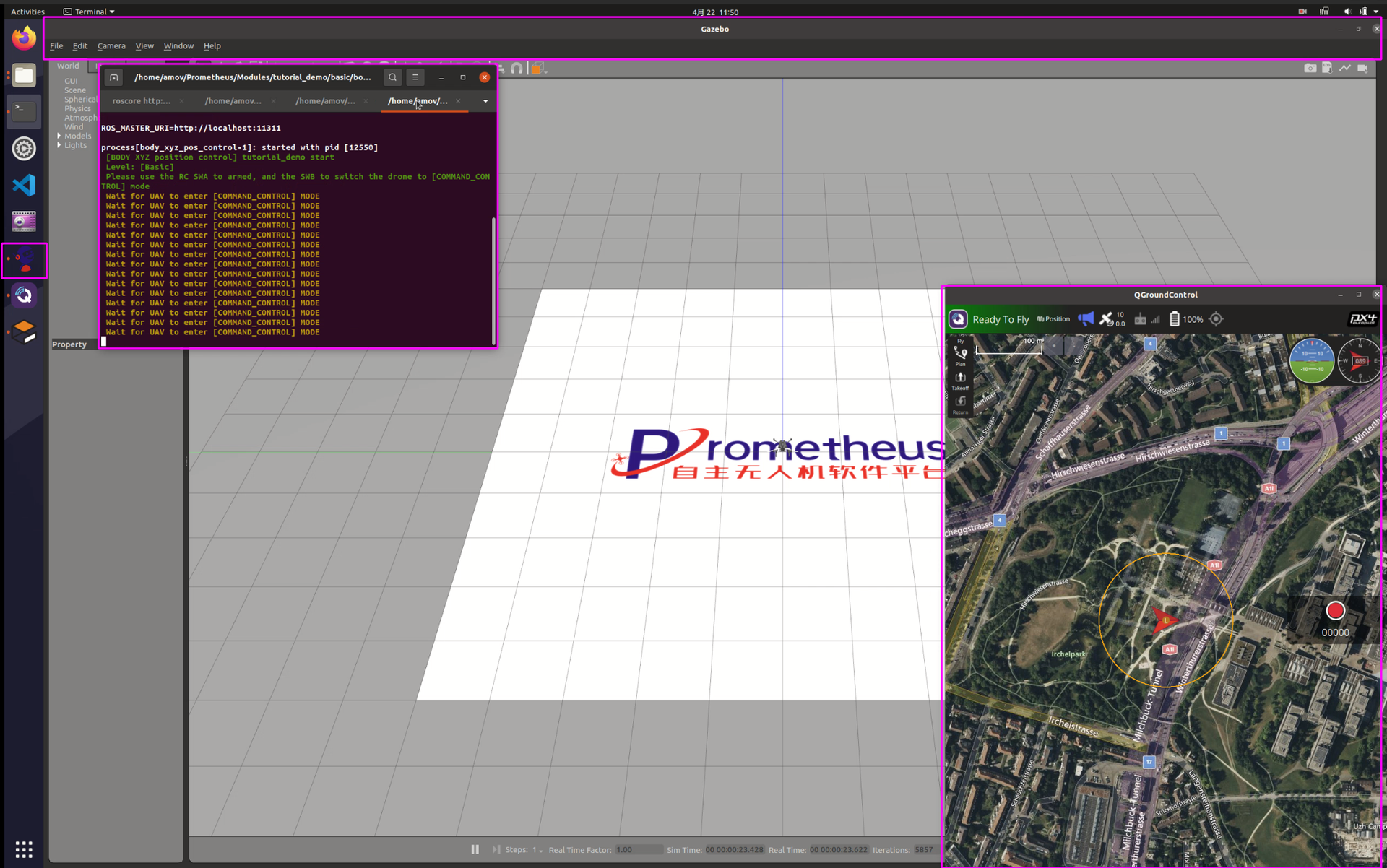

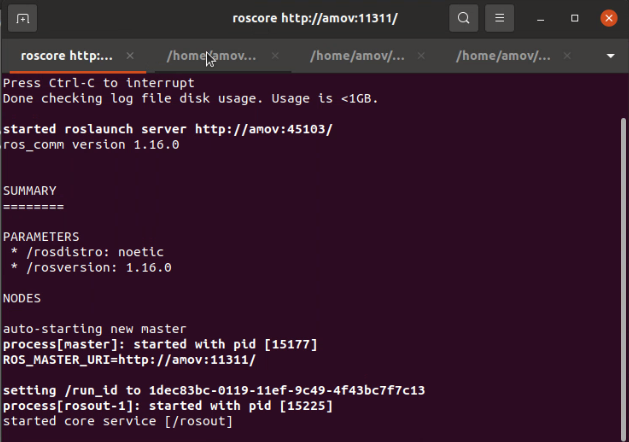

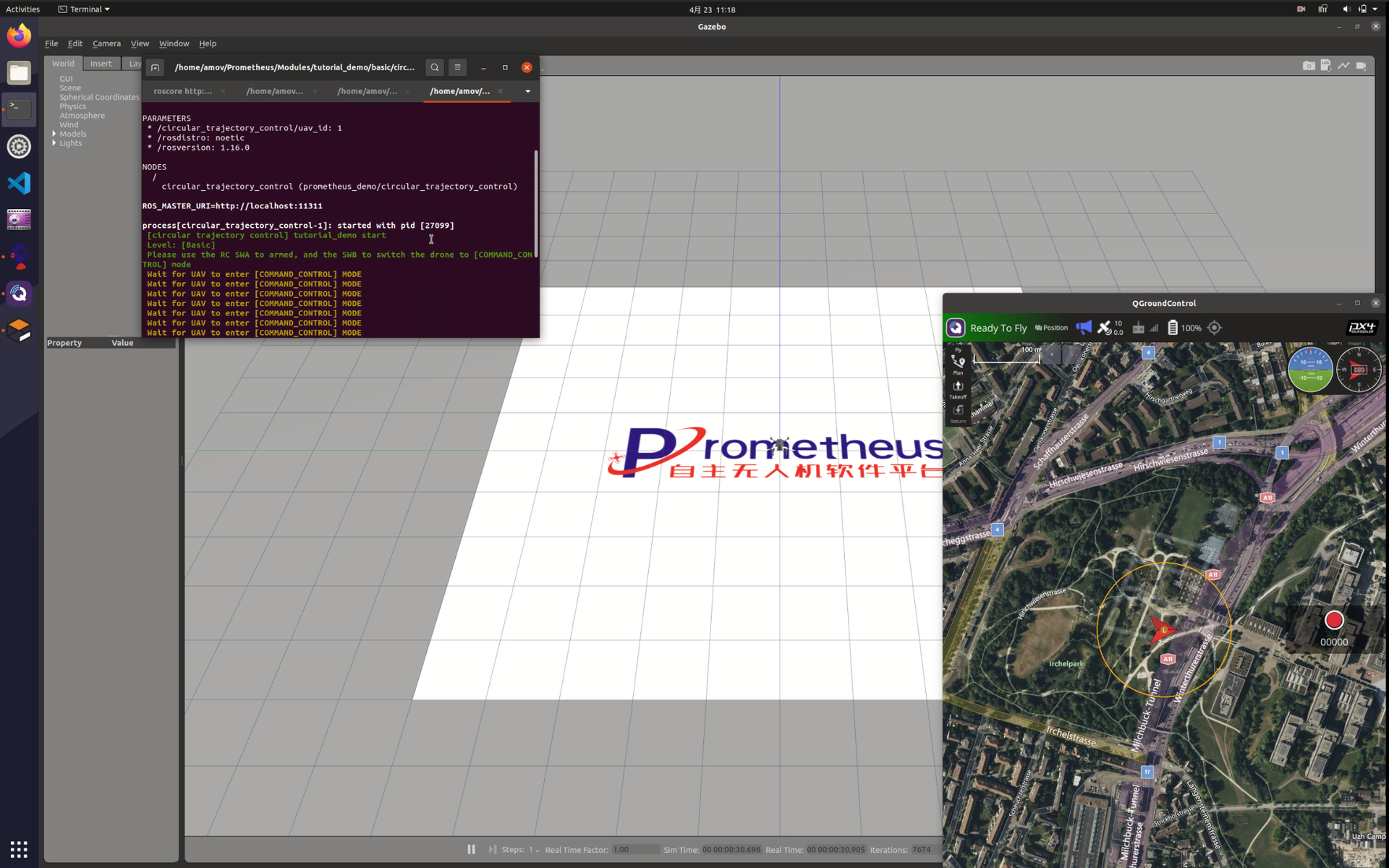

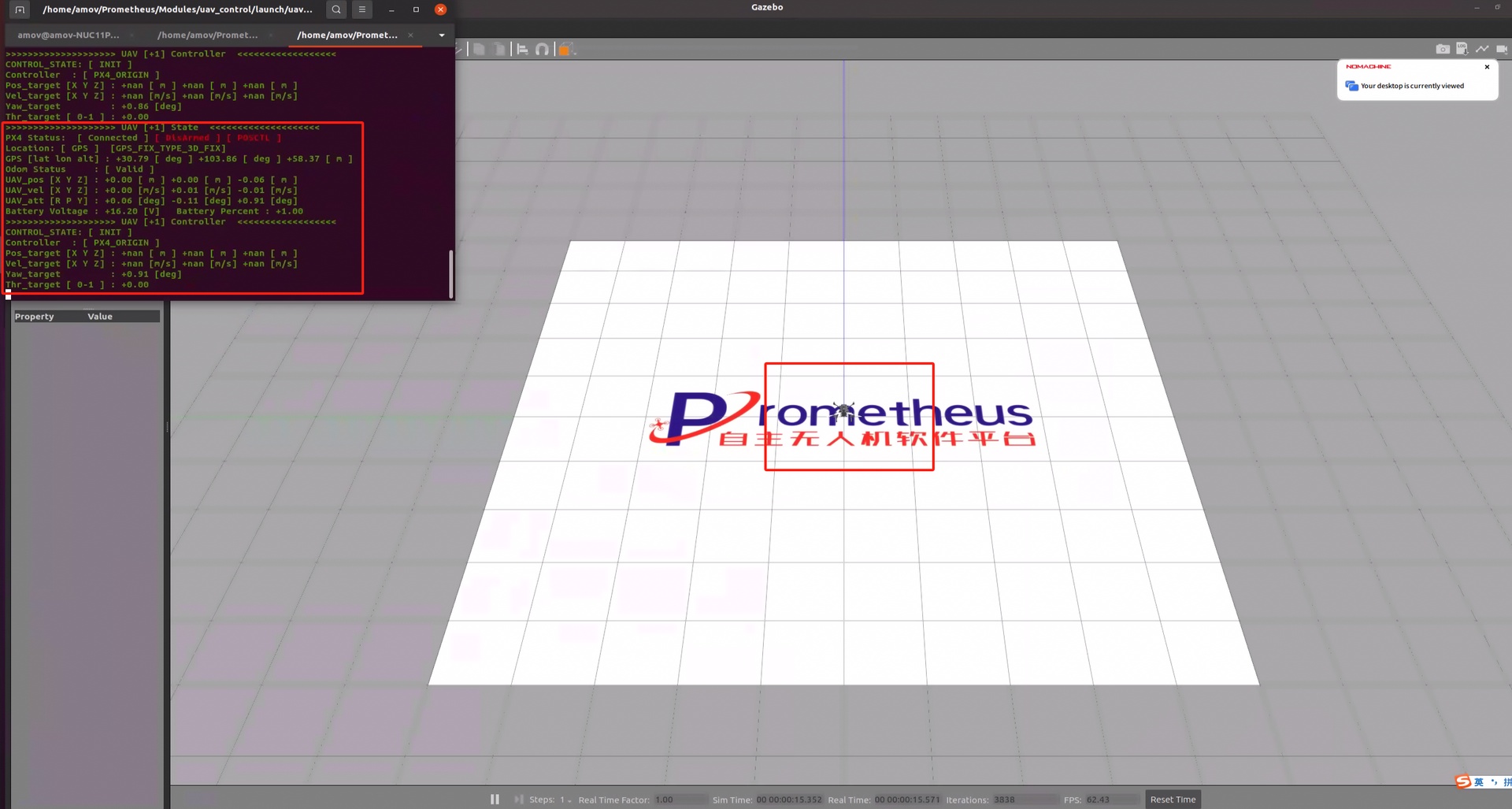

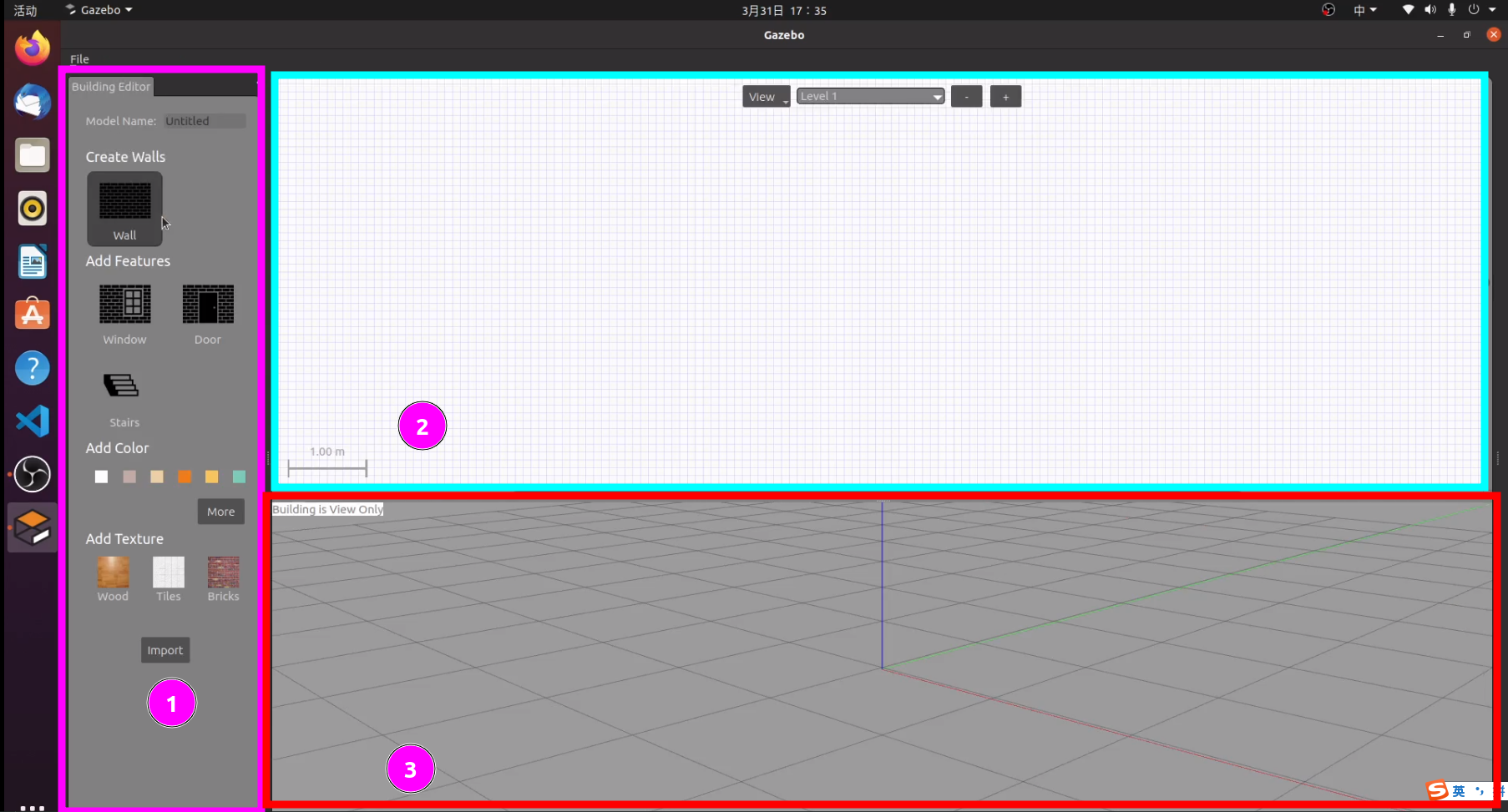

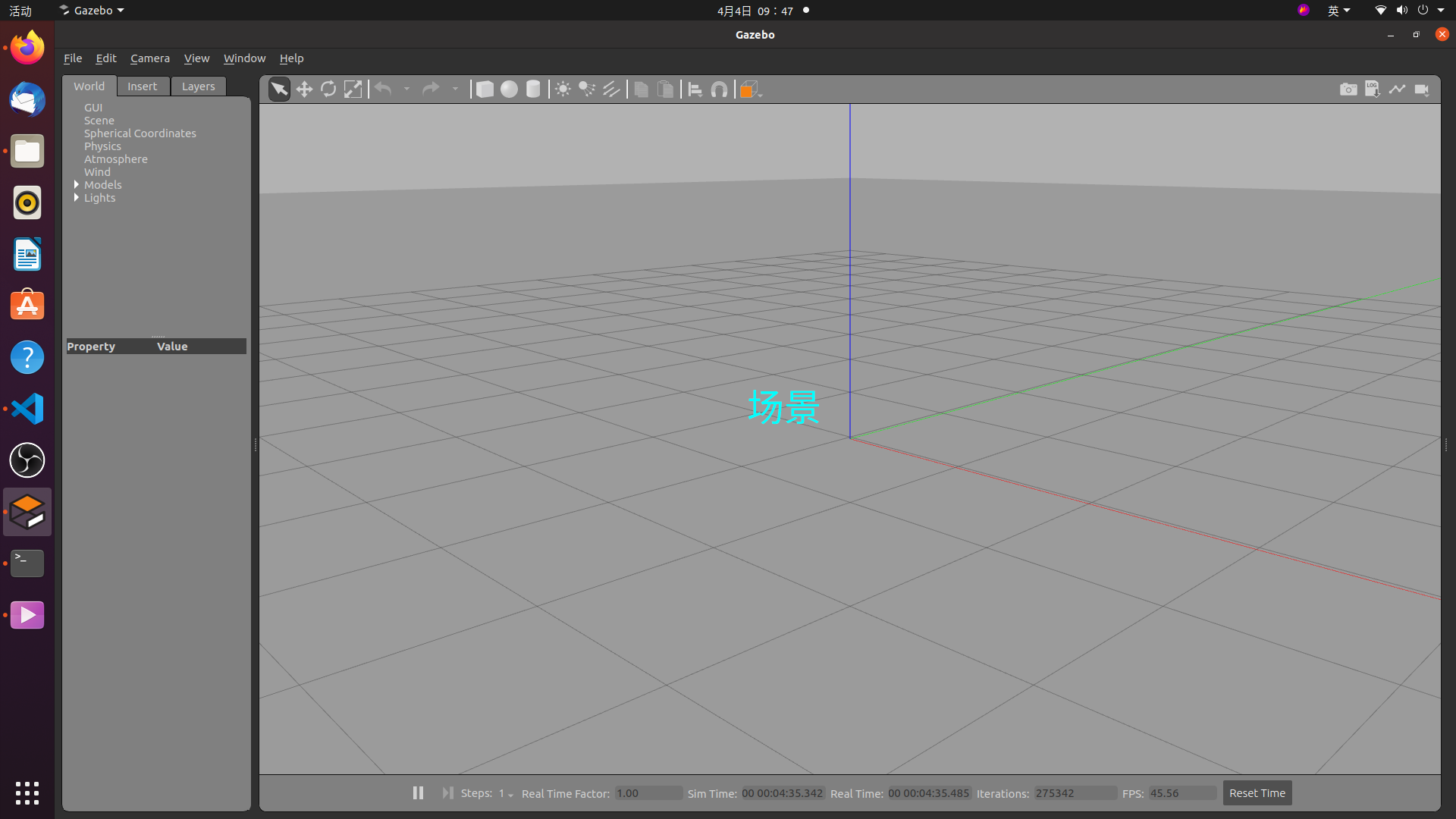

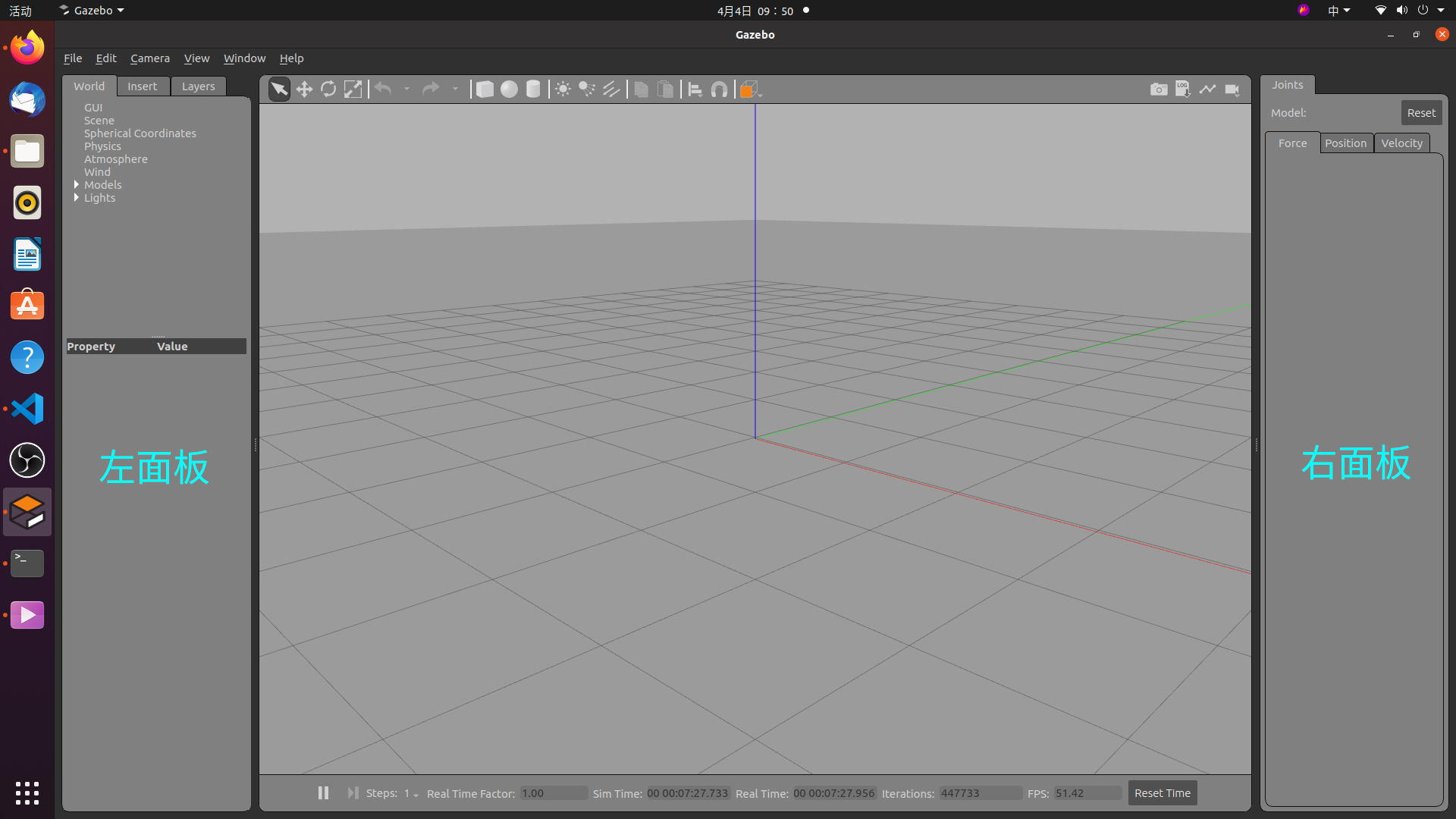

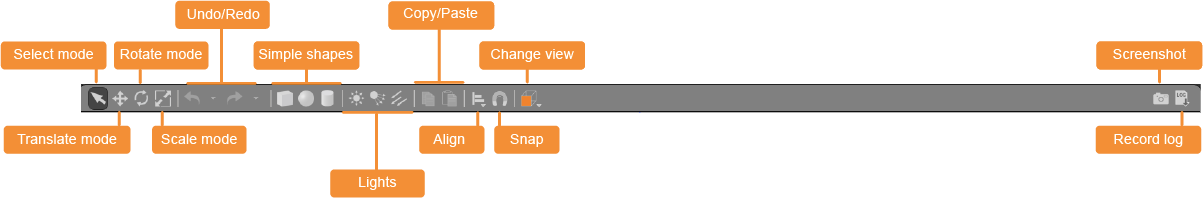

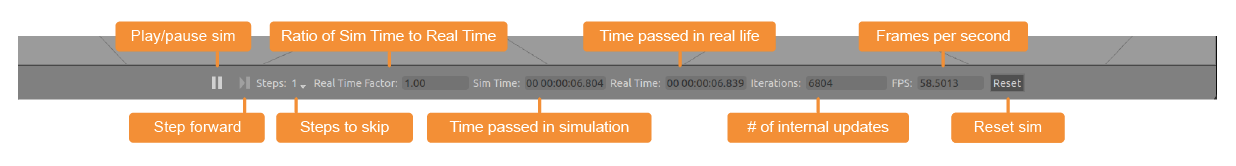

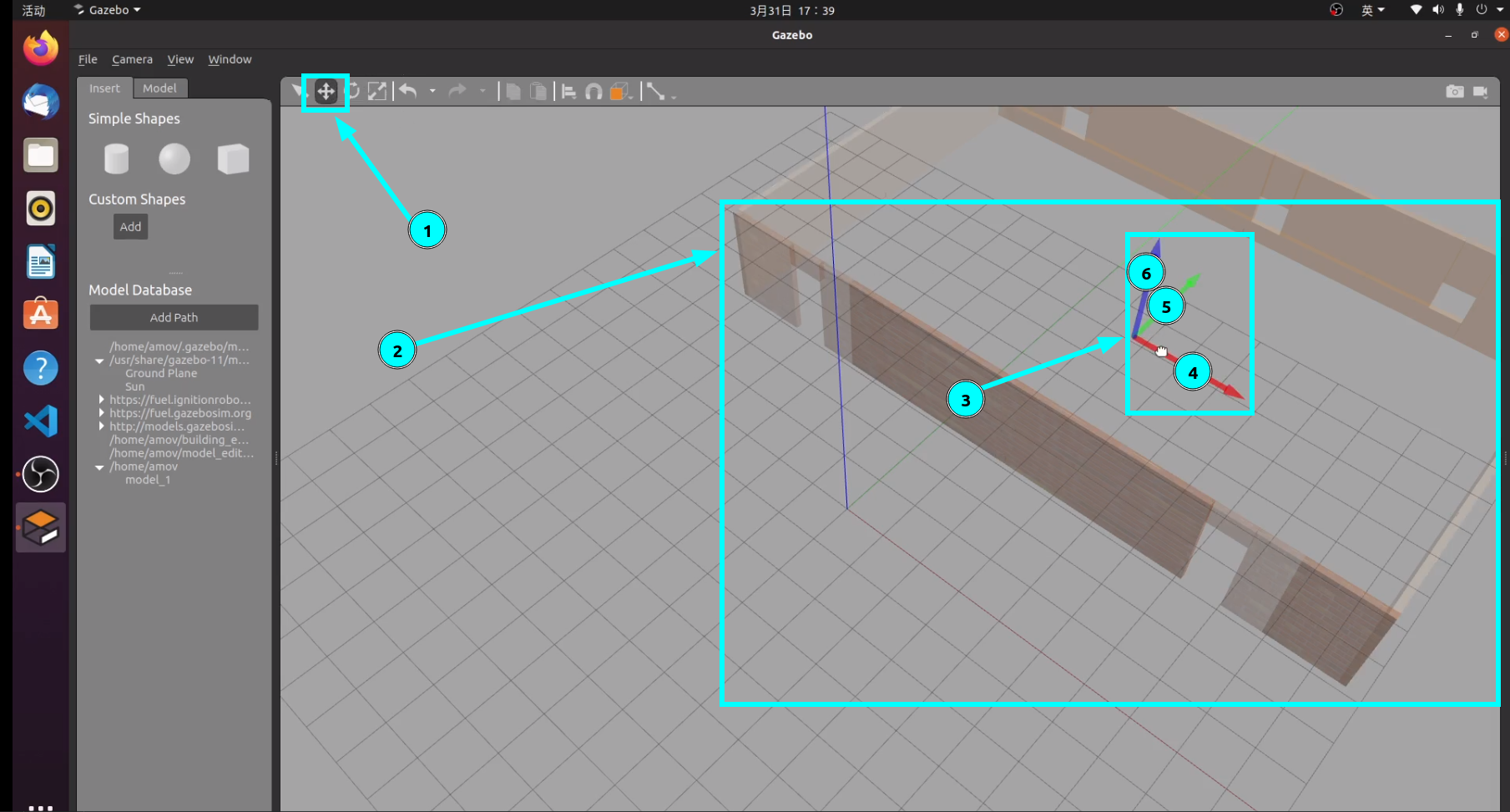

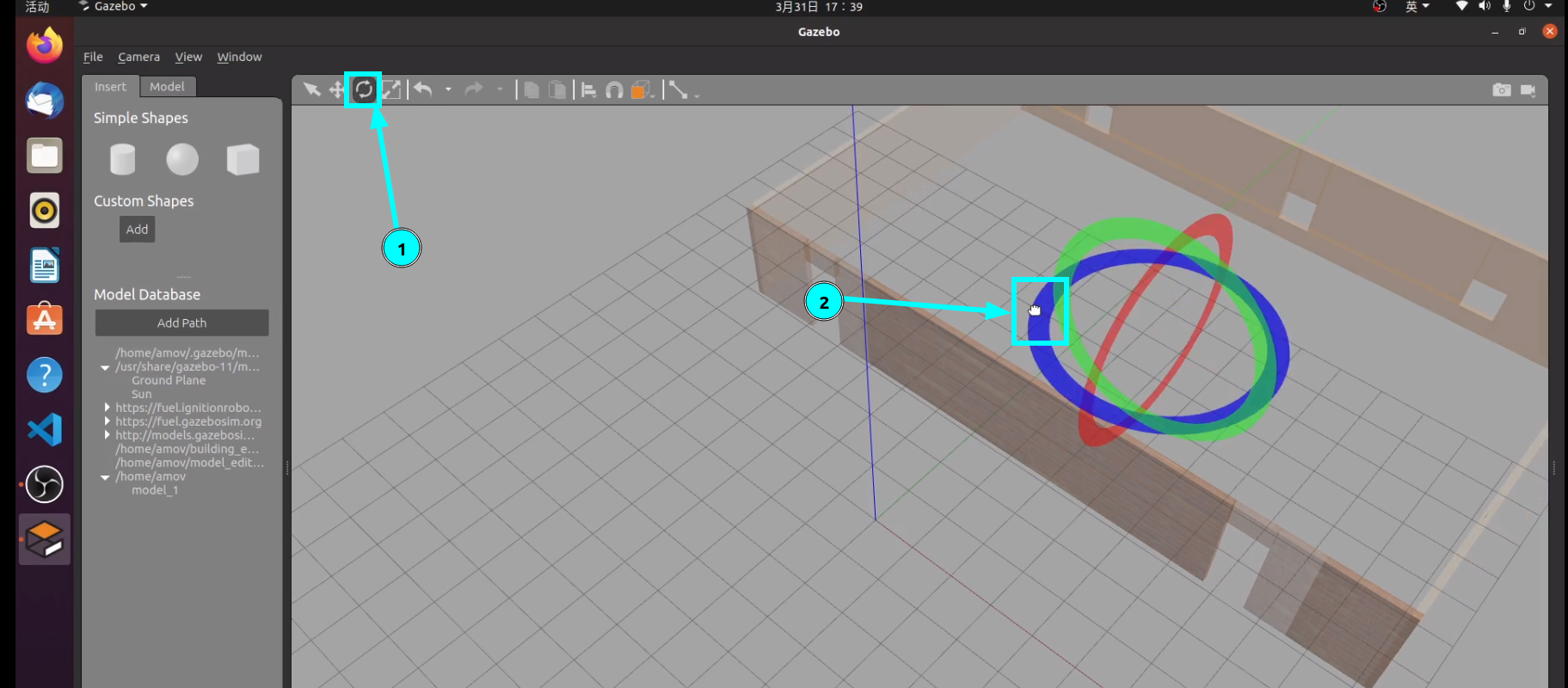

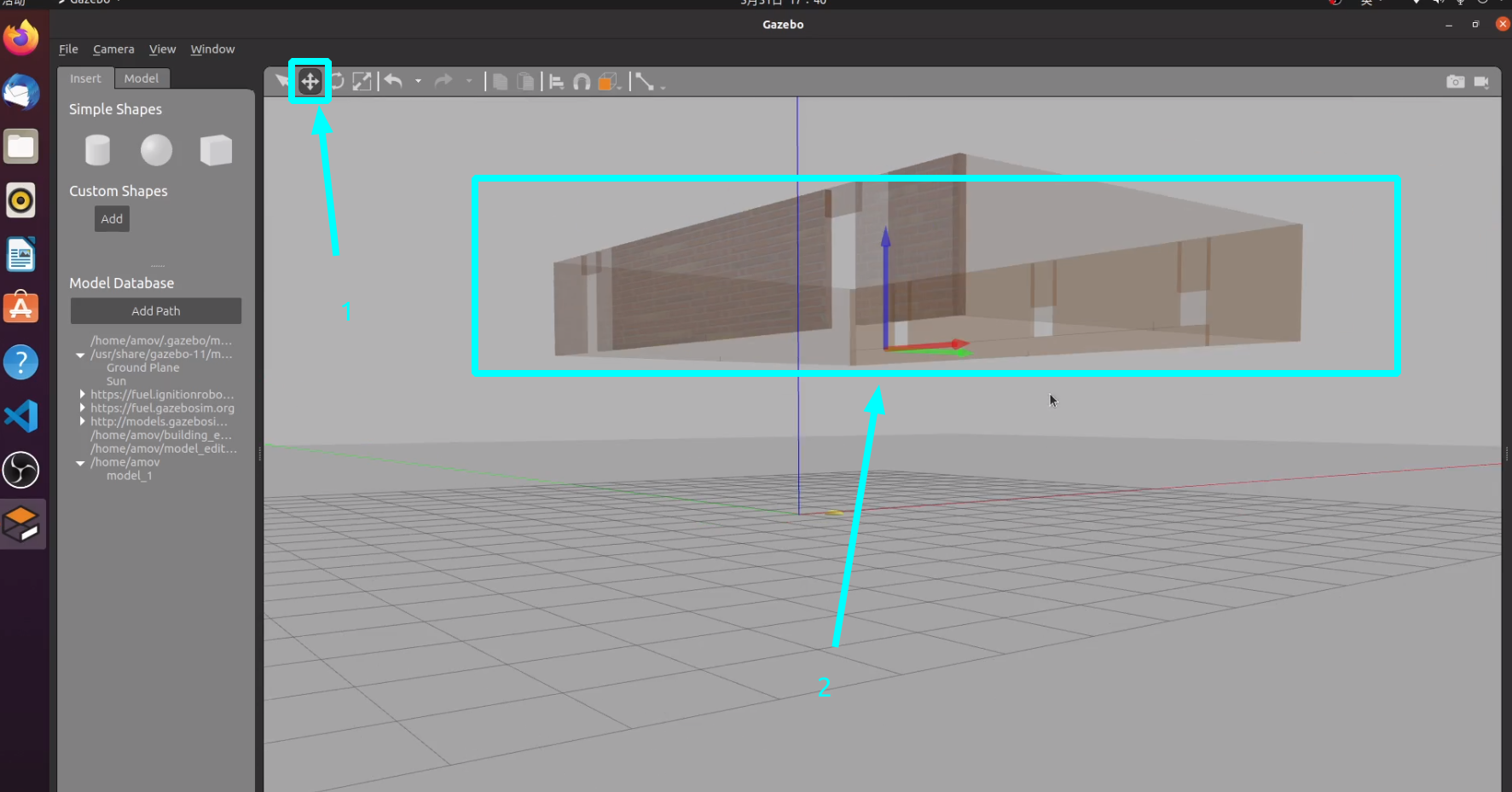

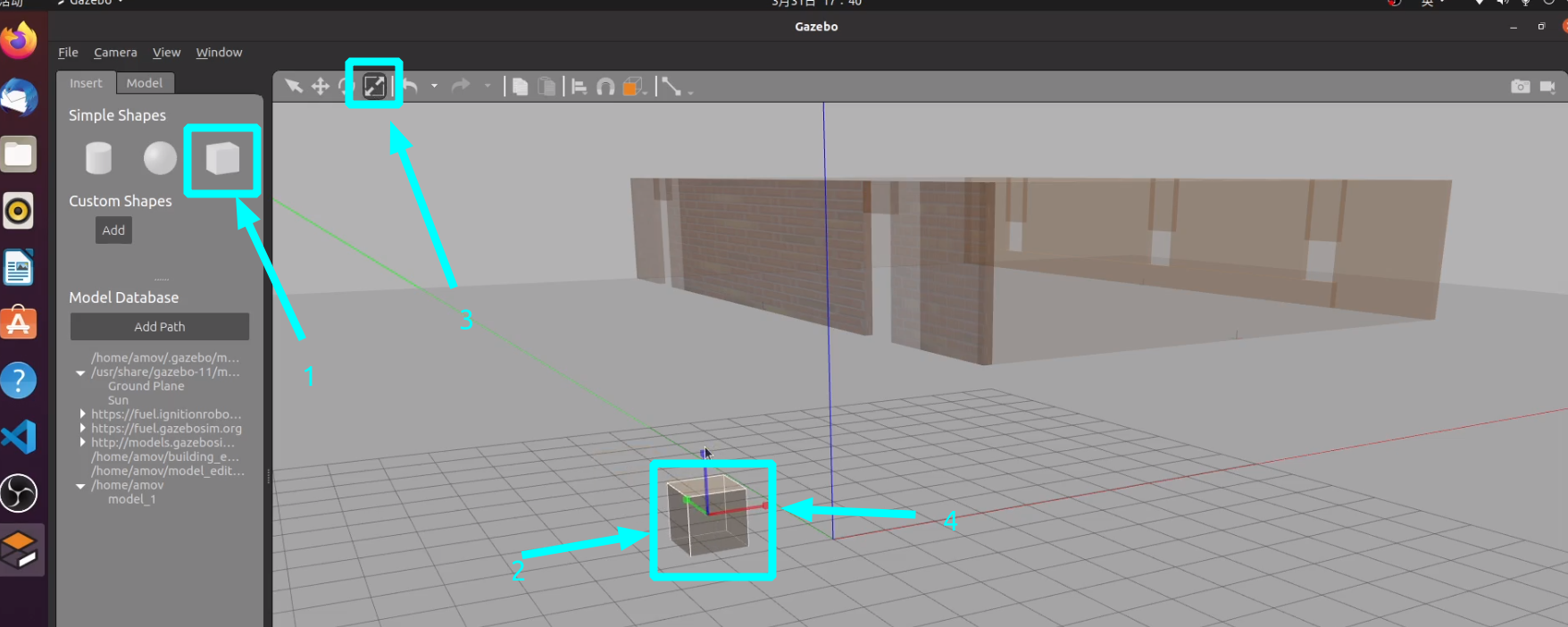

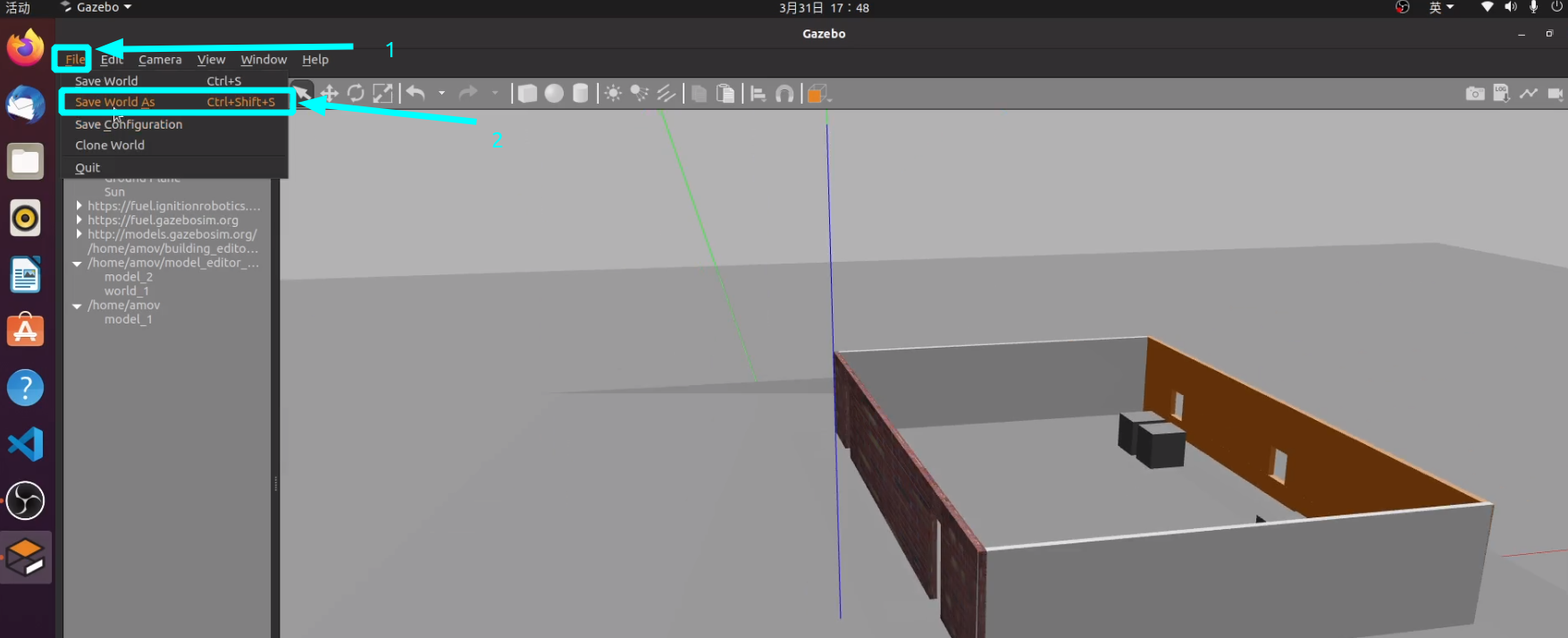

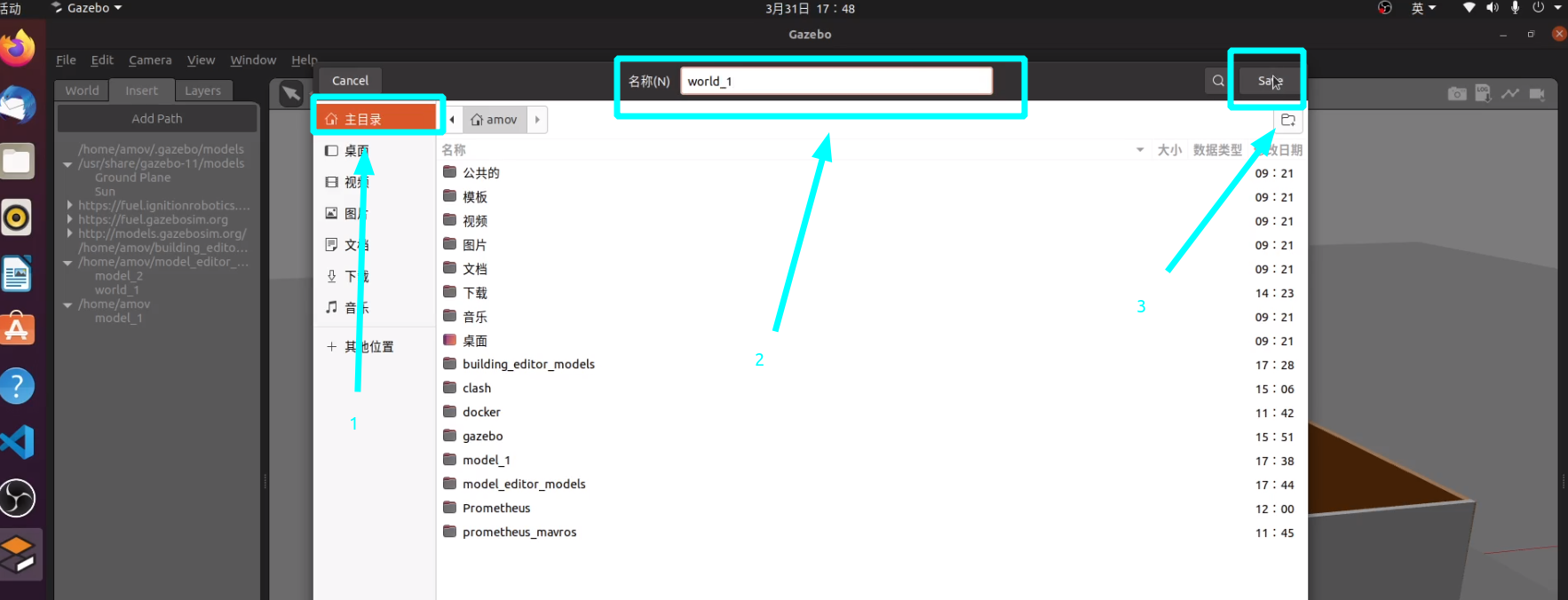

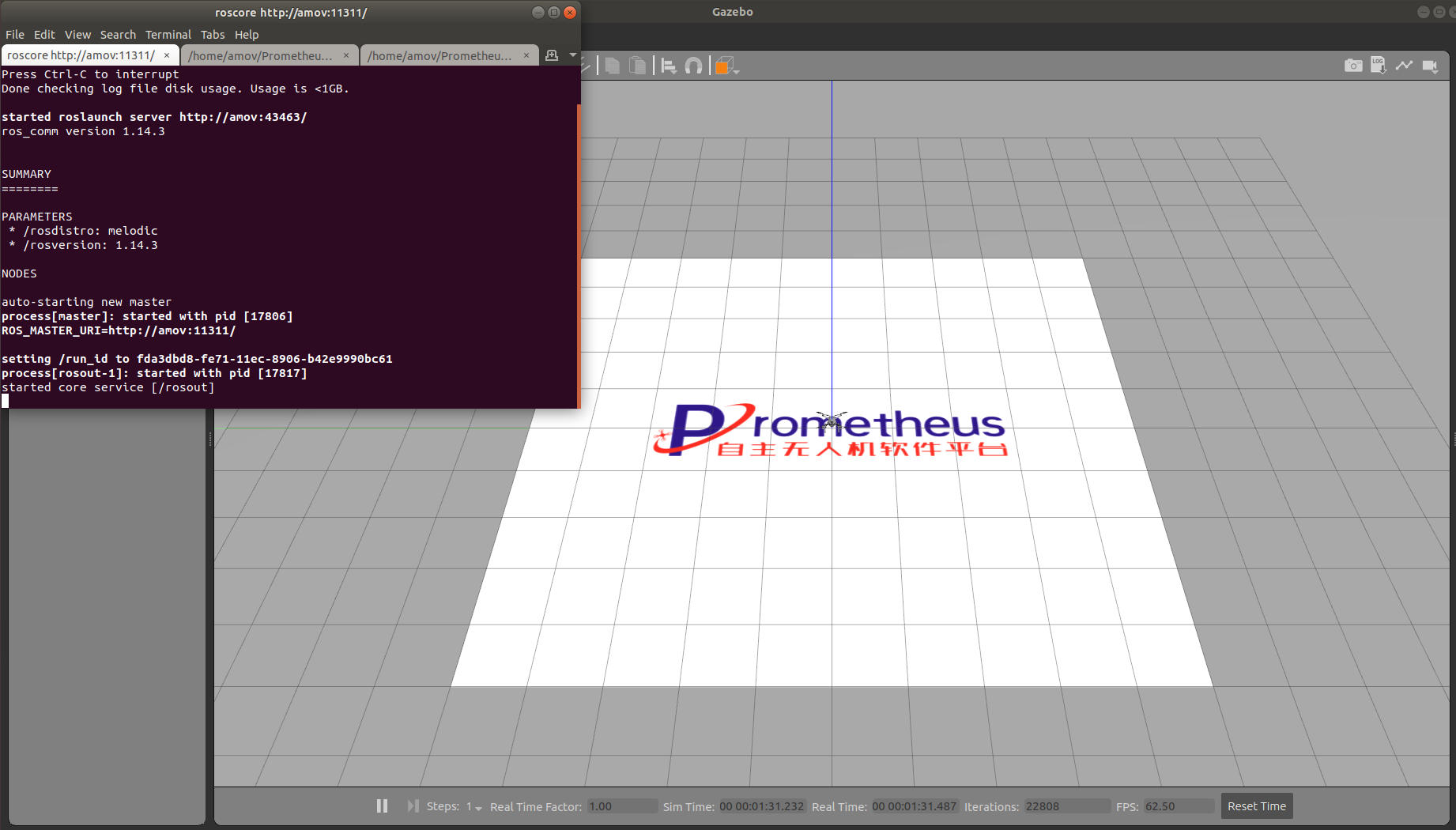

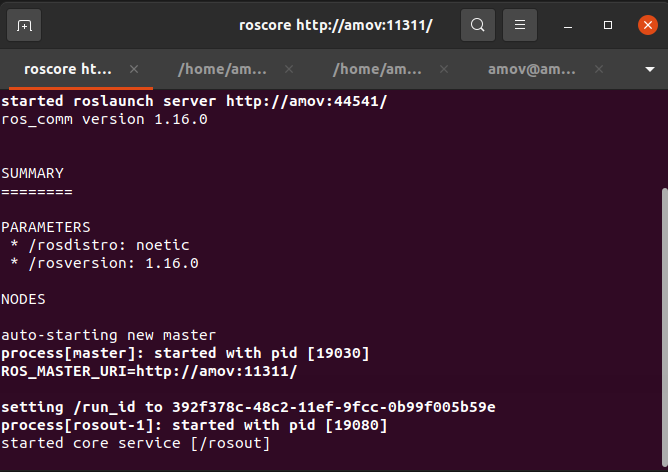

输入该命令后,会出现一个含有三个标签页的终端以及Gazebo,如下图所示。

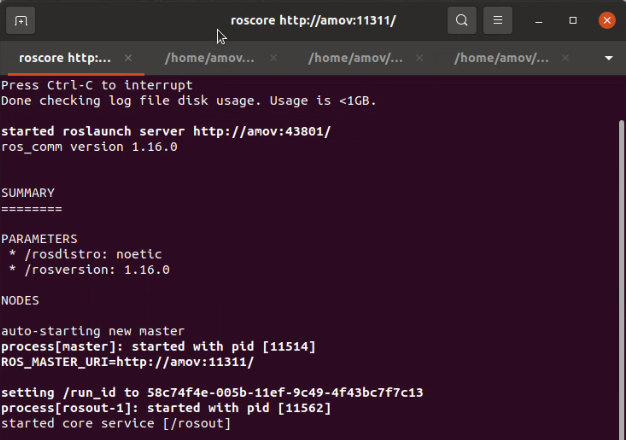

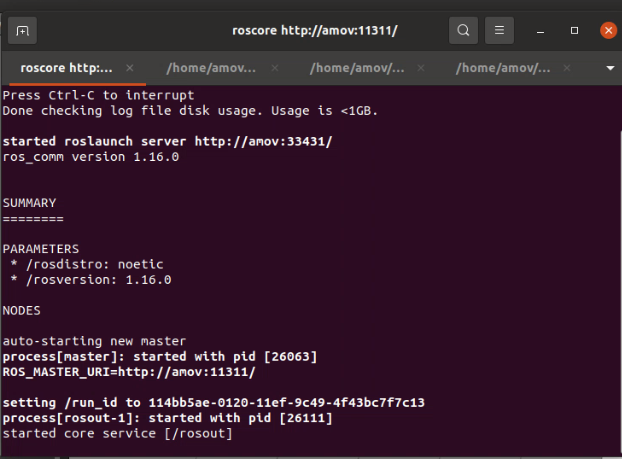

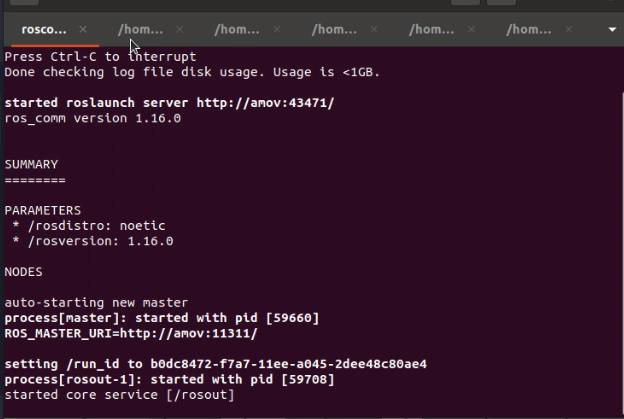

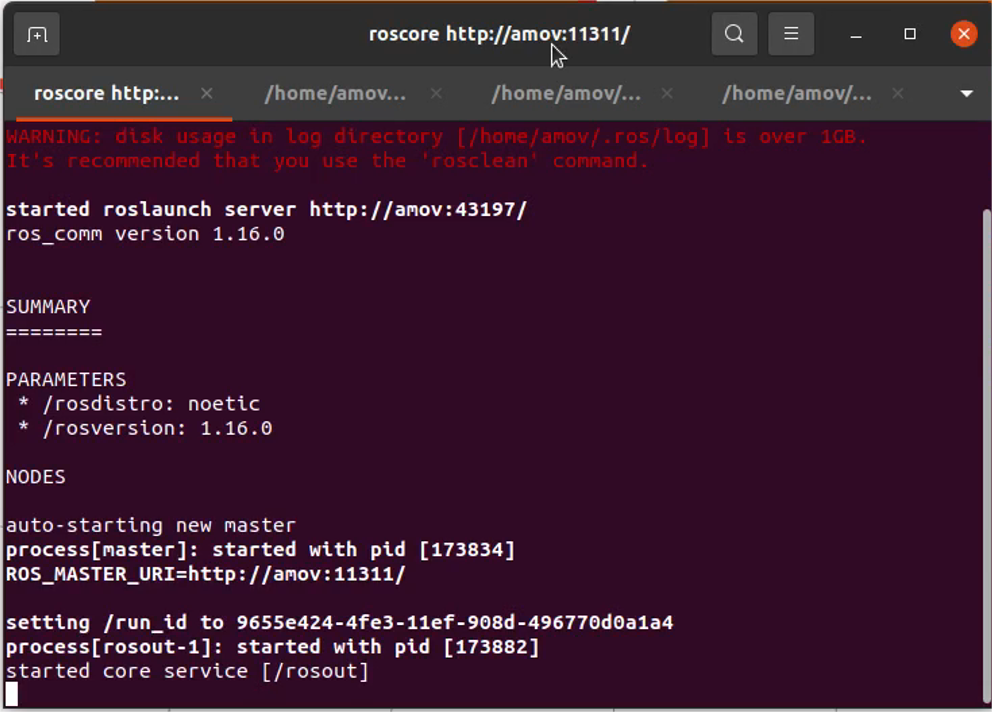

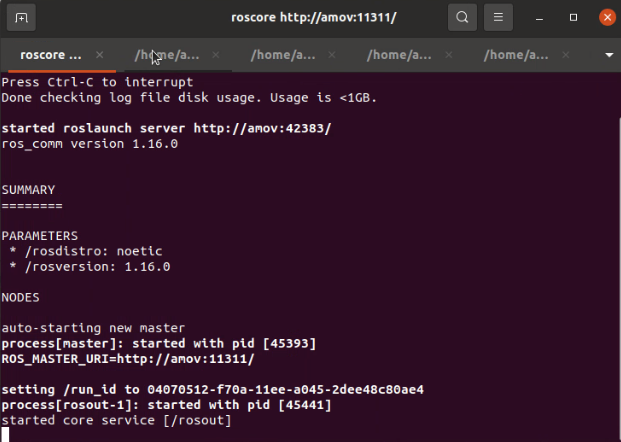

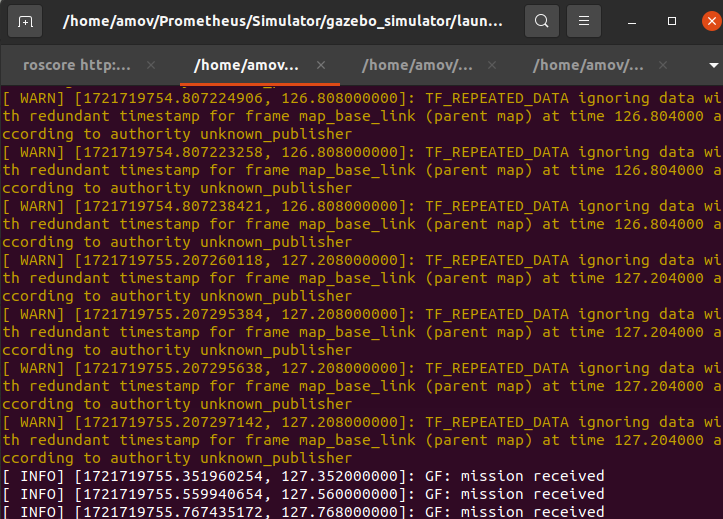

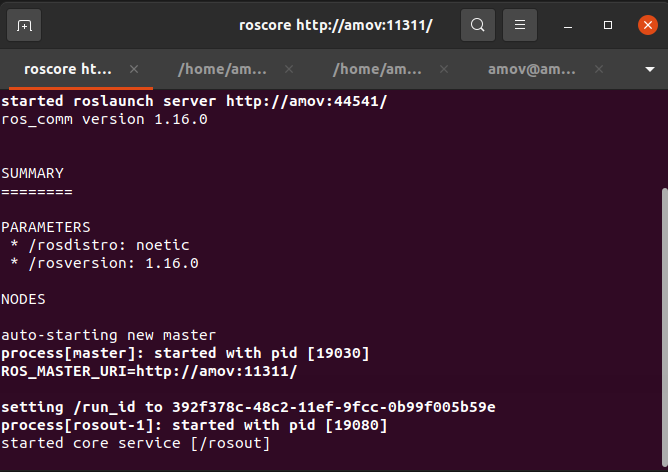

第一个标签页内启动ROS主节点,出现图中内容则说明启动正常。

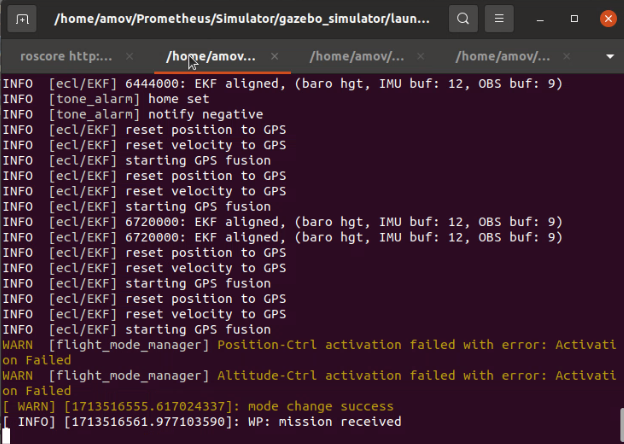

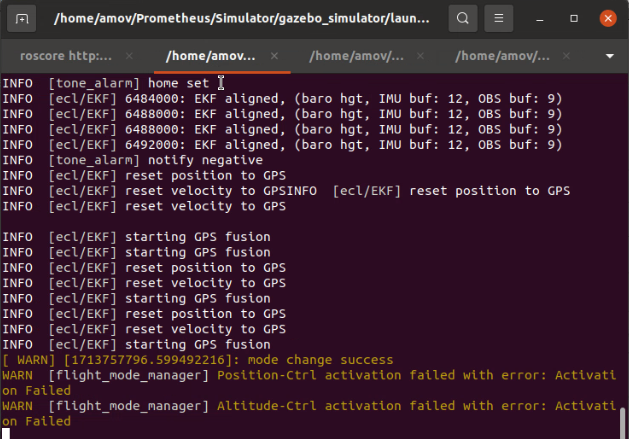

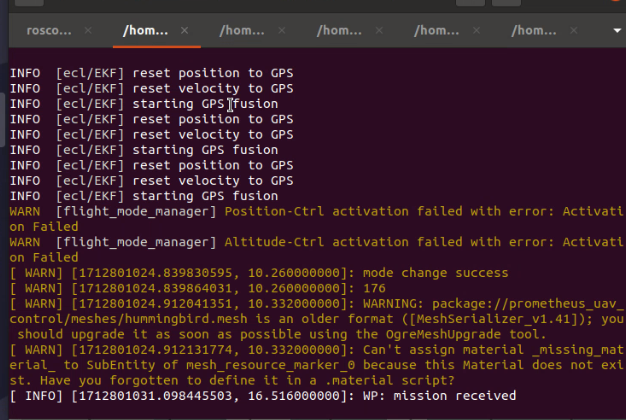

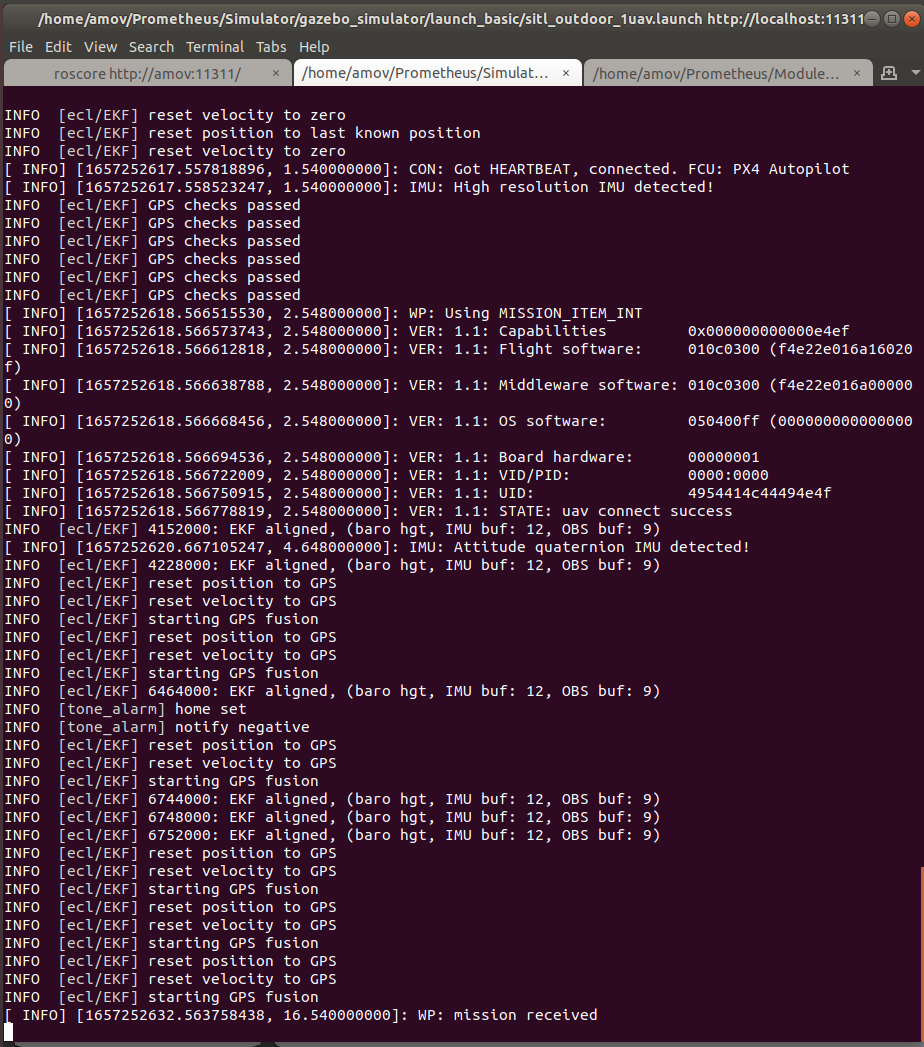

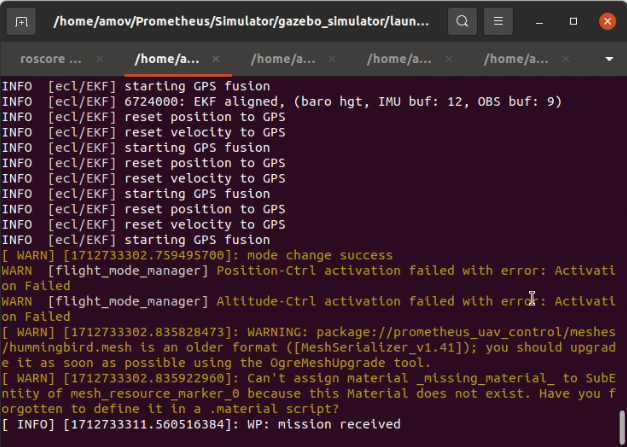

点击终端内的第二个标签页,该标签页为启动PX4以及仿真组件。查看打印信息,出现关键字CON: Got HEARTBEAT, connected. FCU:PX4 Autopilot则证明PX4正常启动,出现Gazebo和无人机则说明仿真组件启动正常。

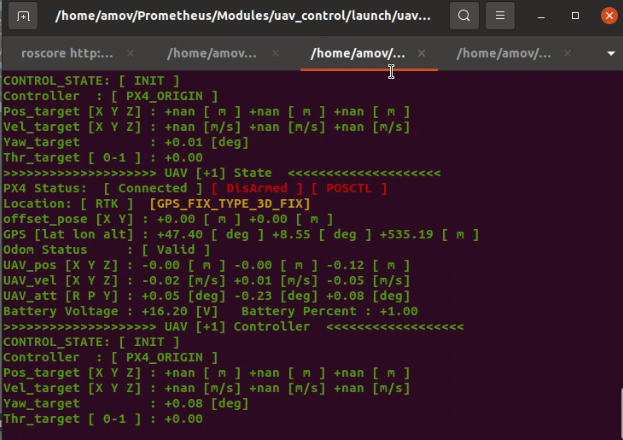

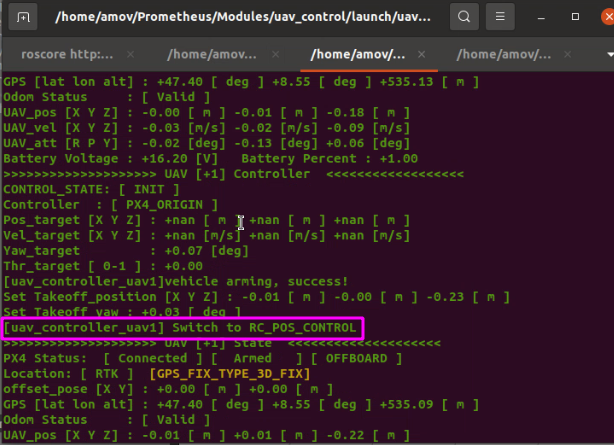

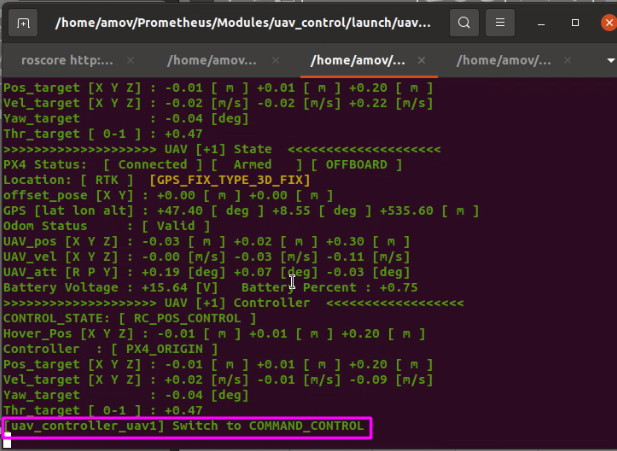

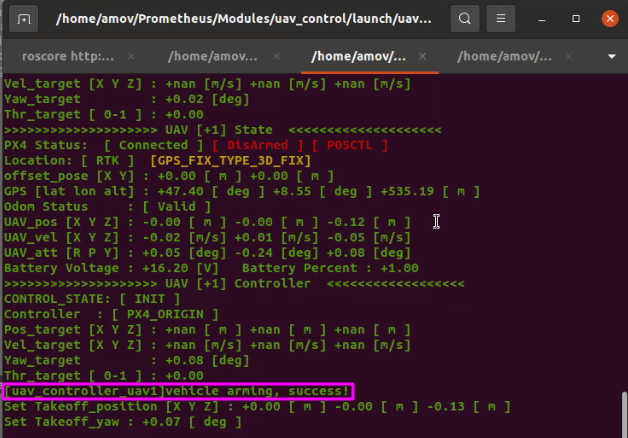

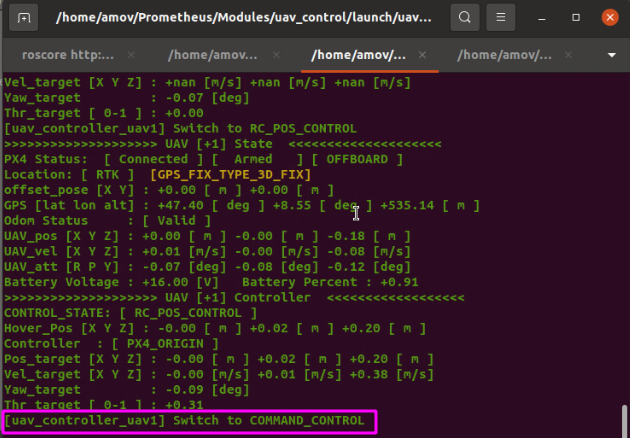

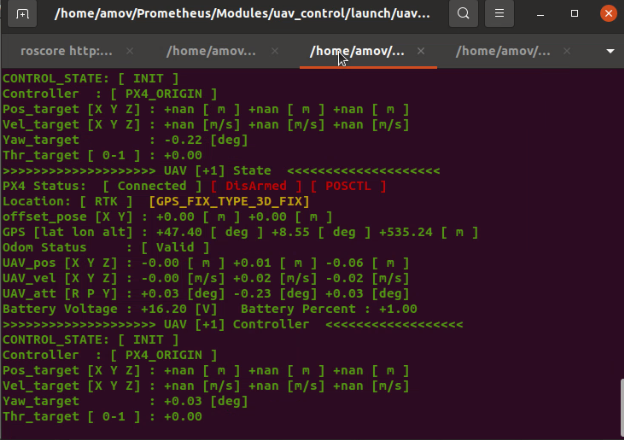

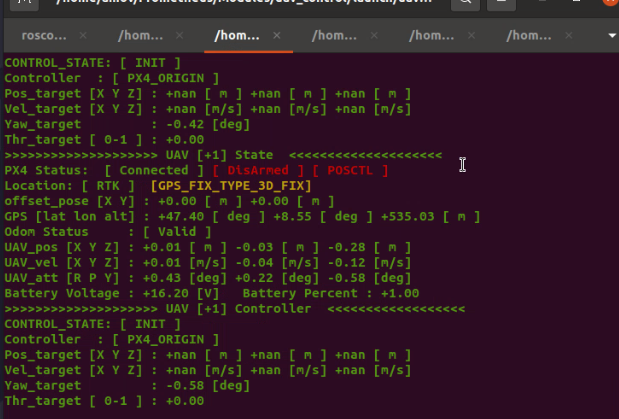

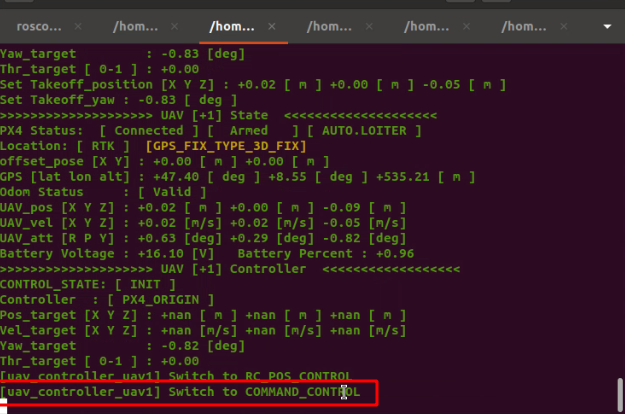

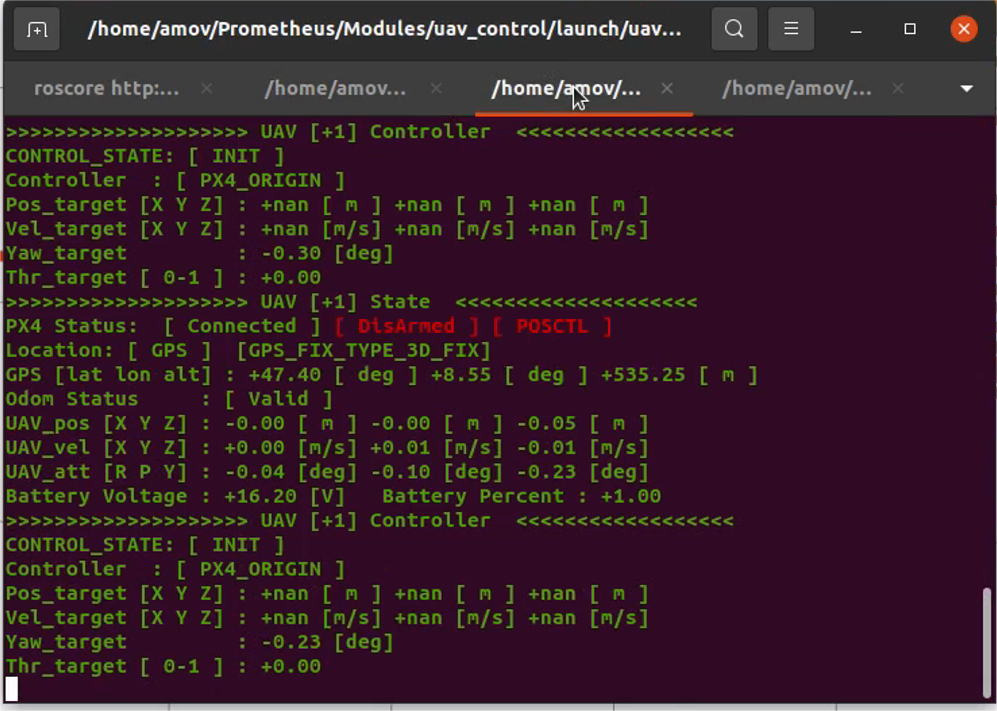

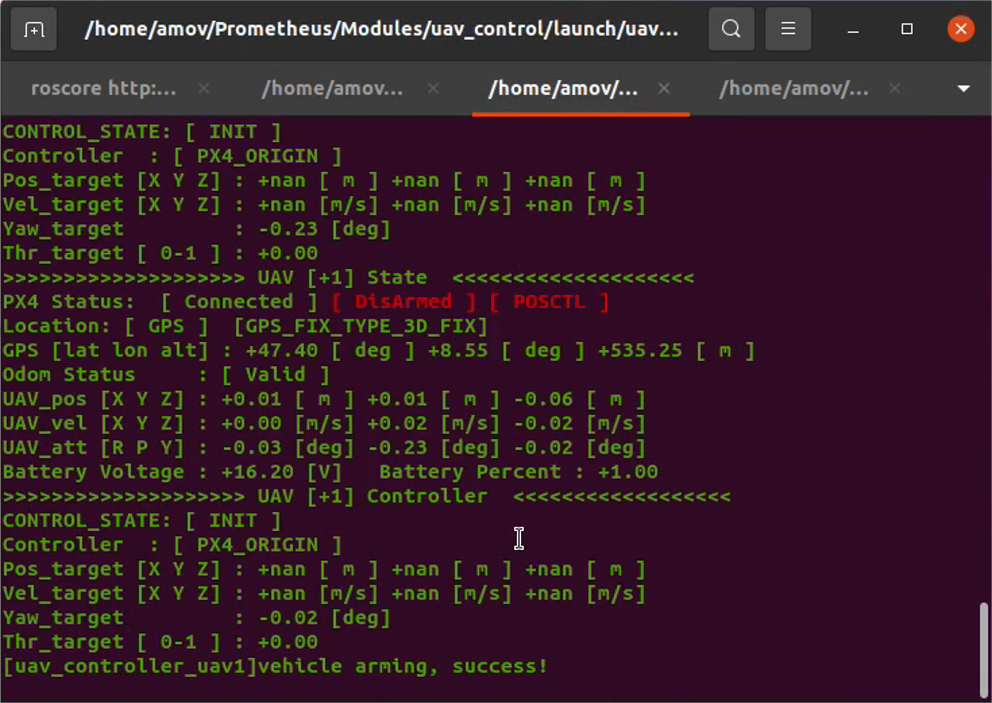

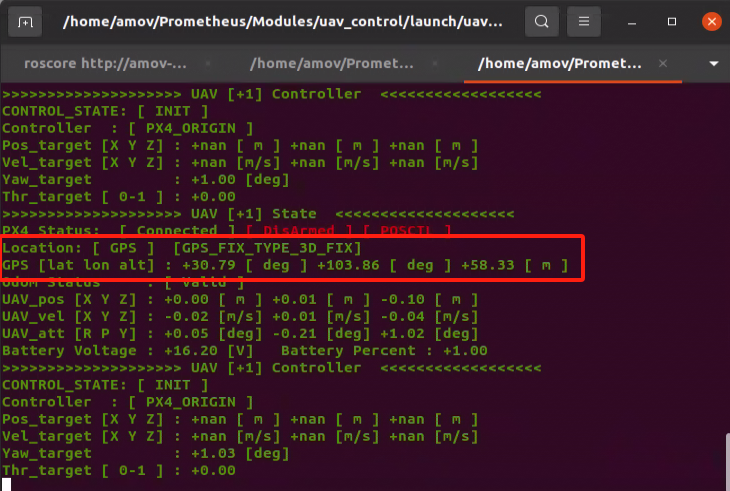

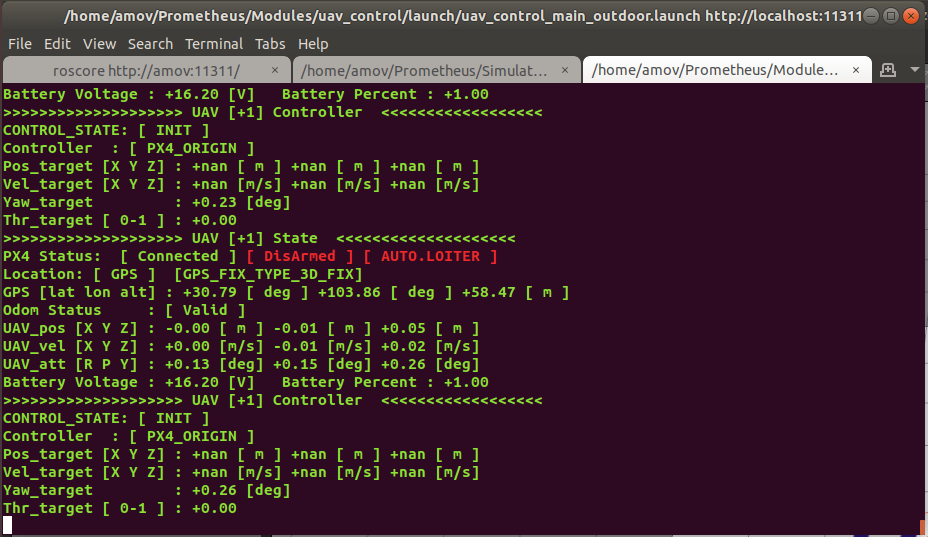

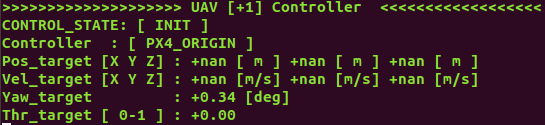

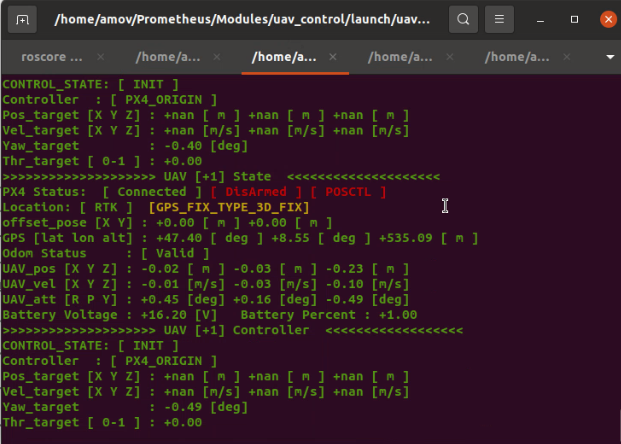

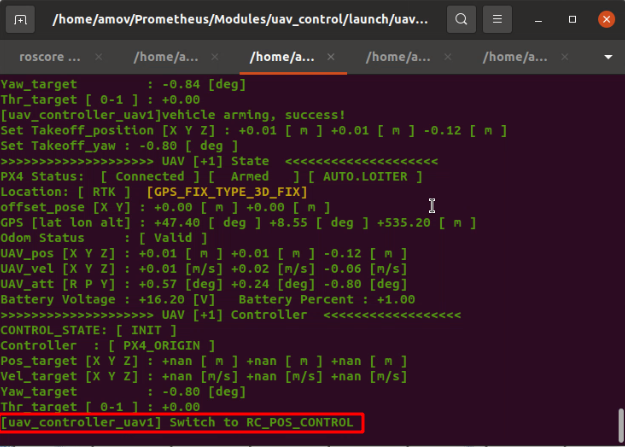

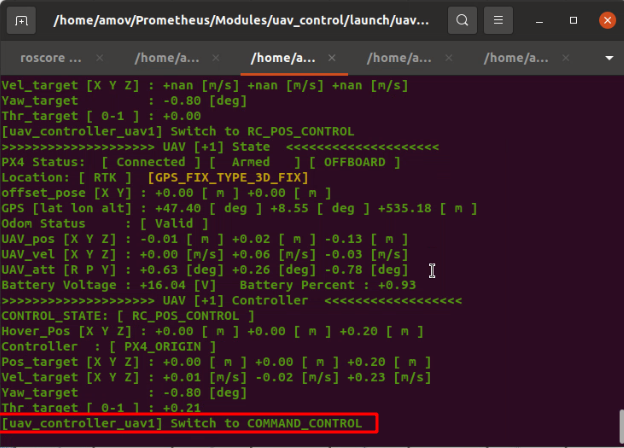

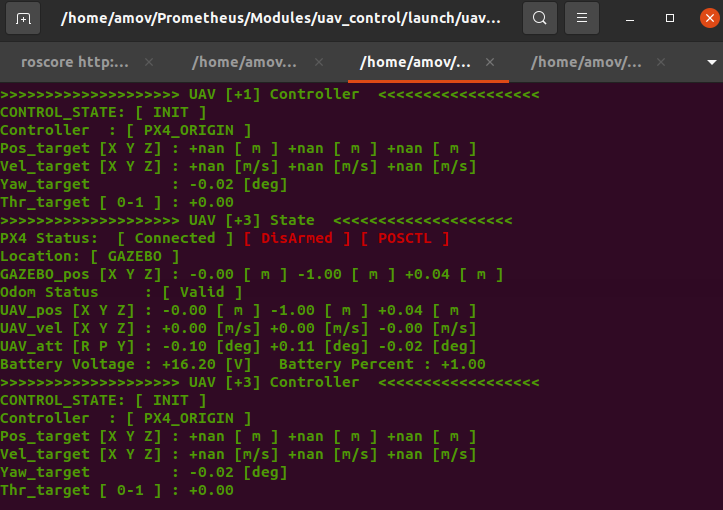

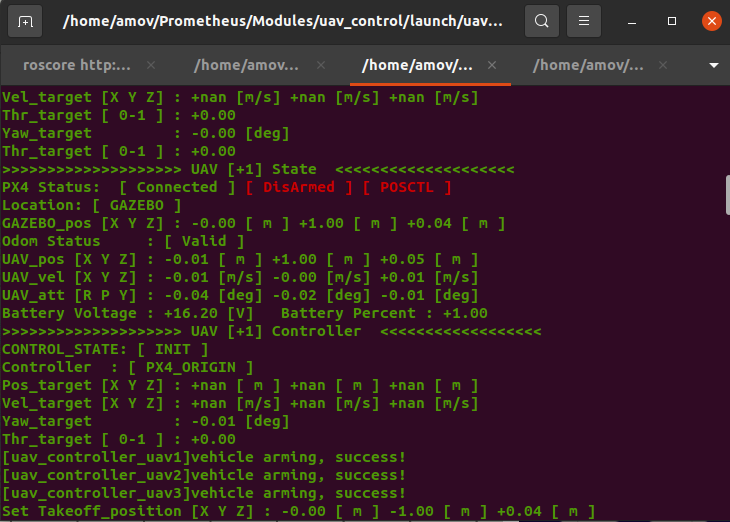

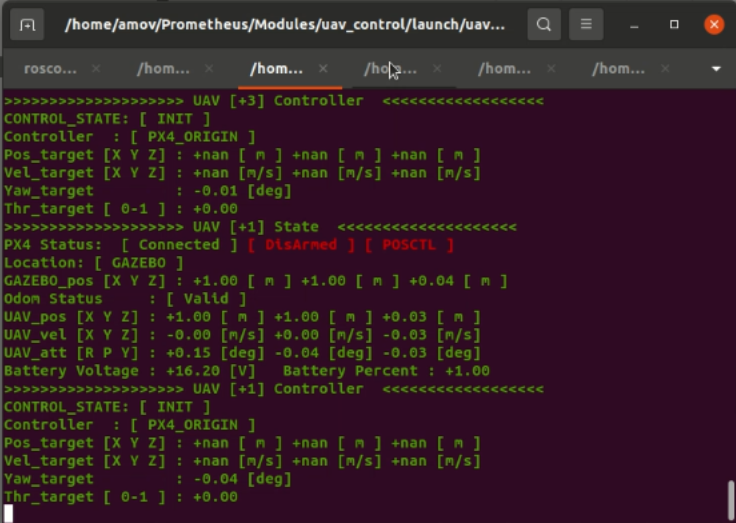

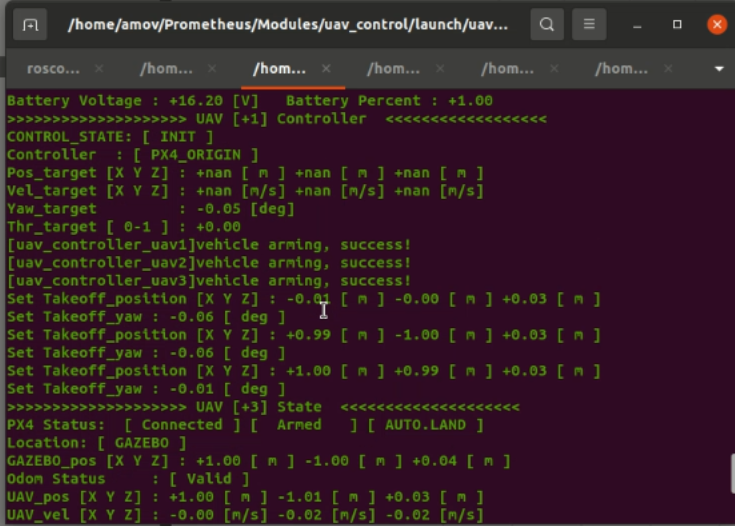

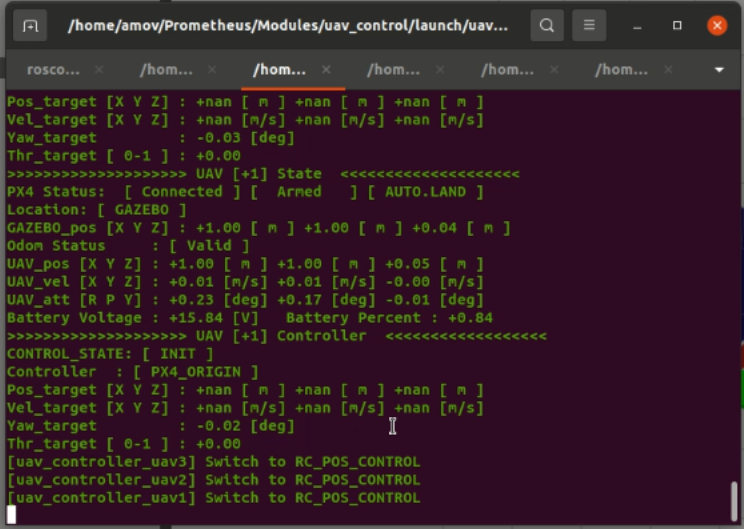

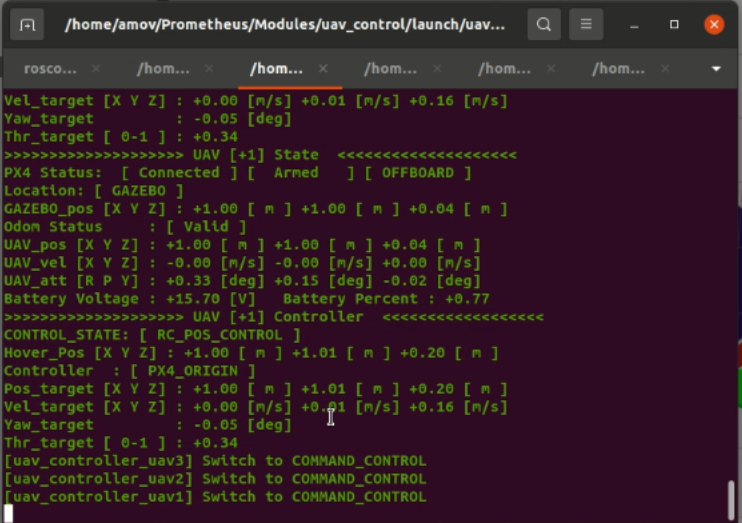

点击终端内第三个标签页,该标签页为启动Prometheus uav_control_main节点。该界面会打印无人机相关信息,包含无人机状态信息和控制数据。

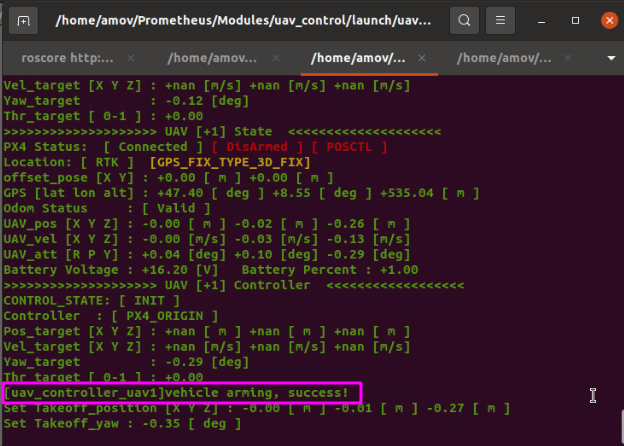

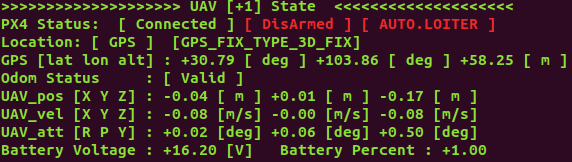

其中无人机状态信息如下图所示。

控制数据如下图所示。

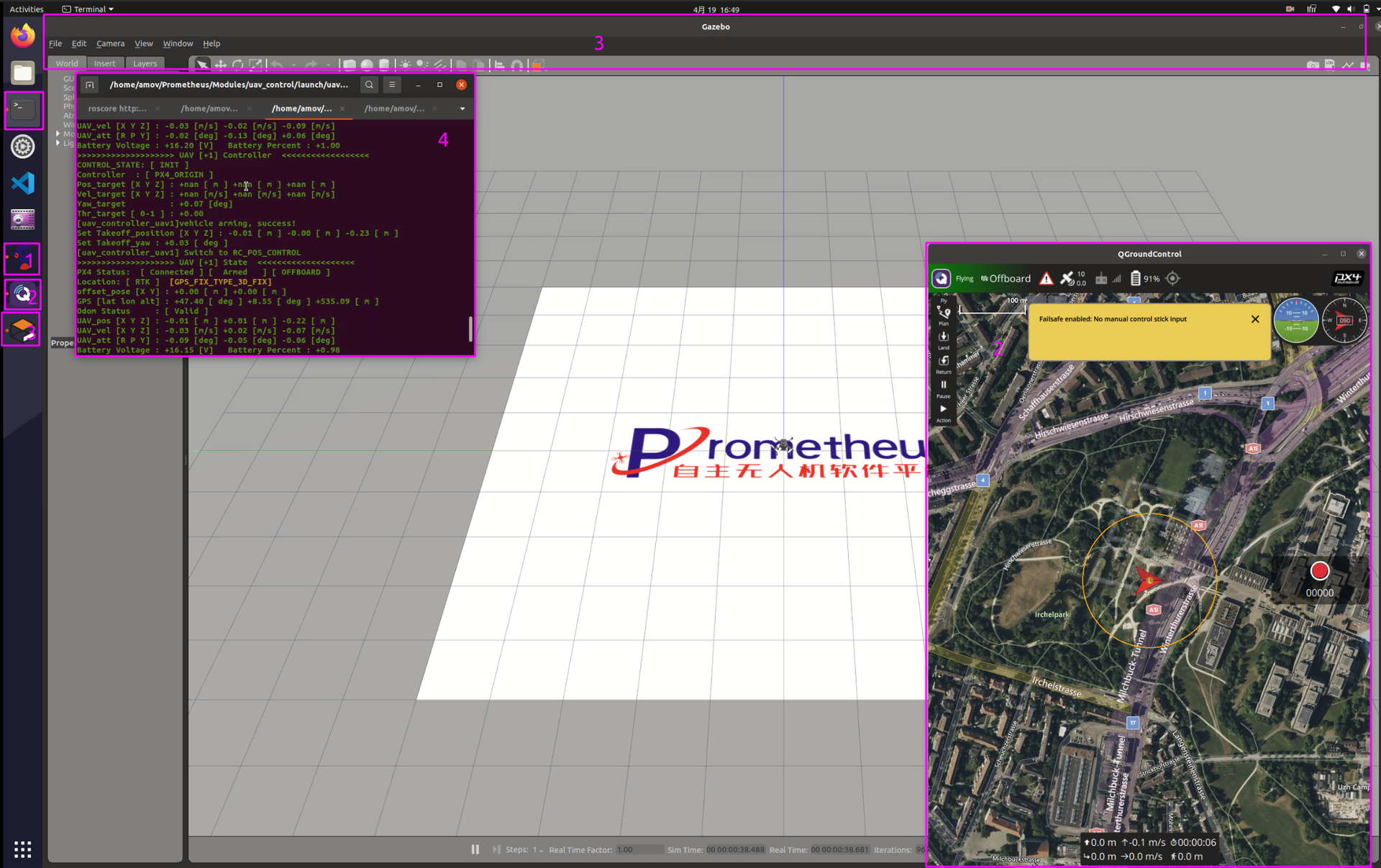

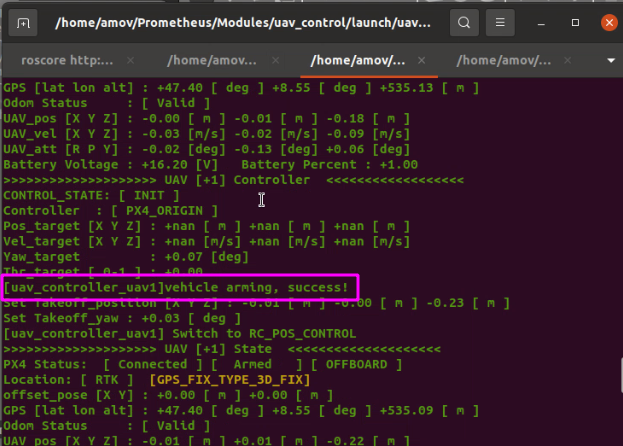

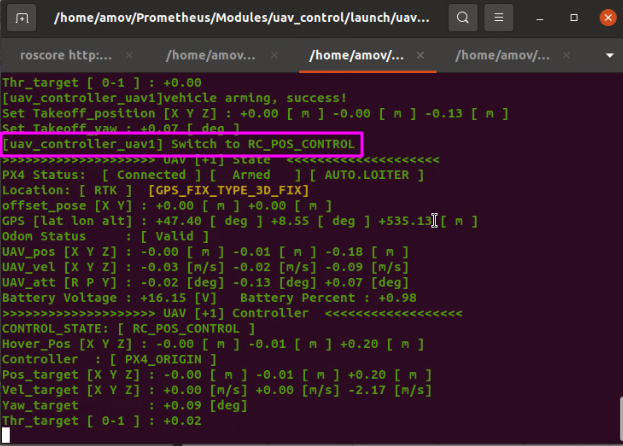

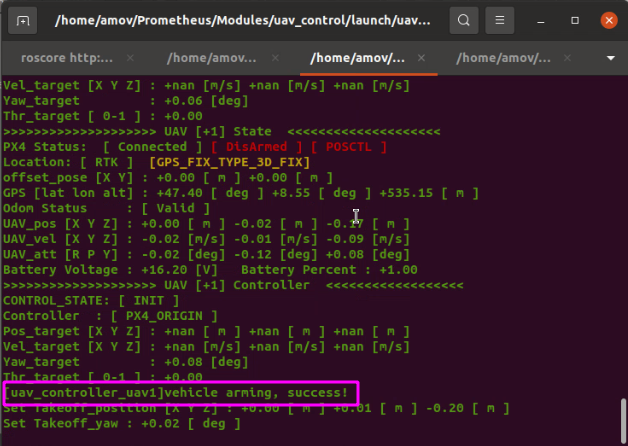

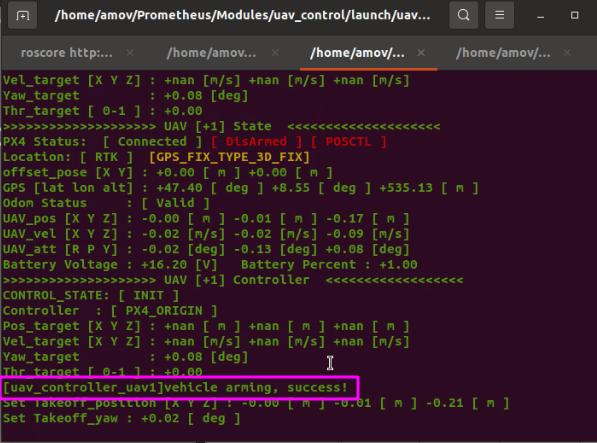

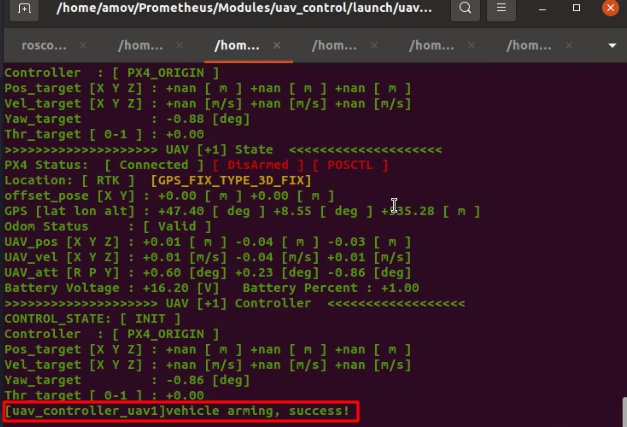

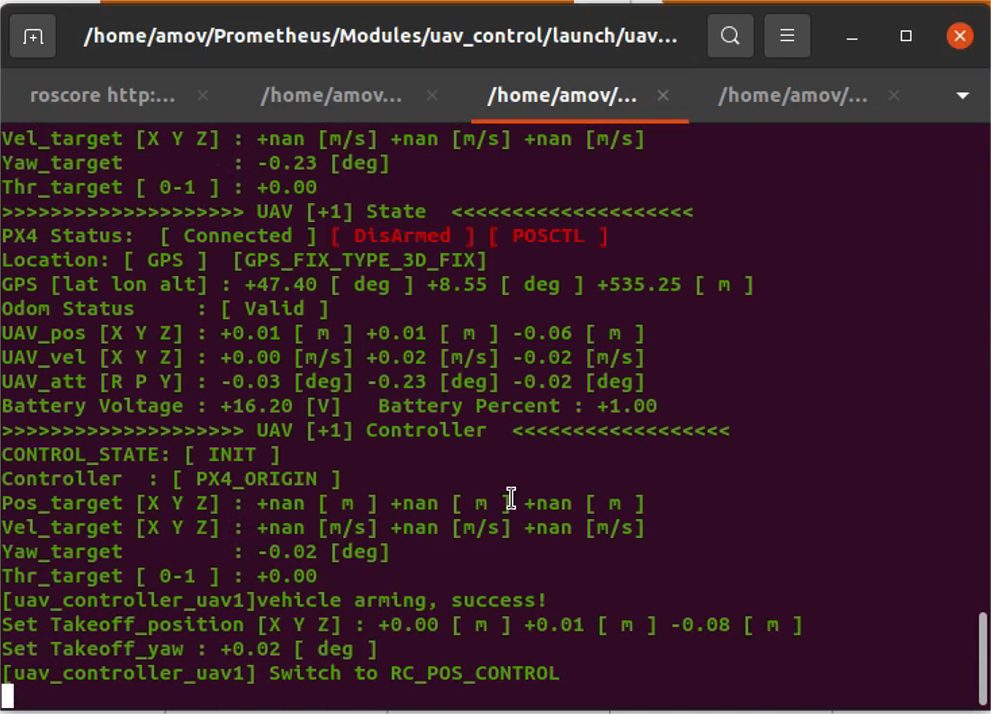

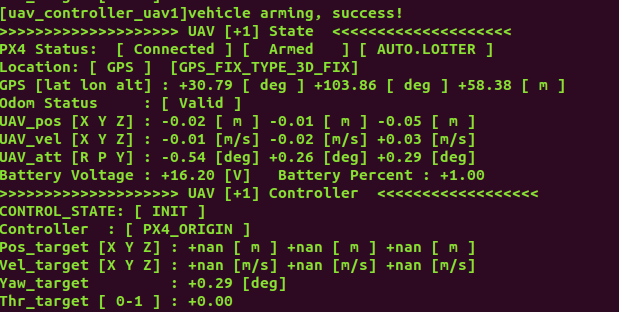

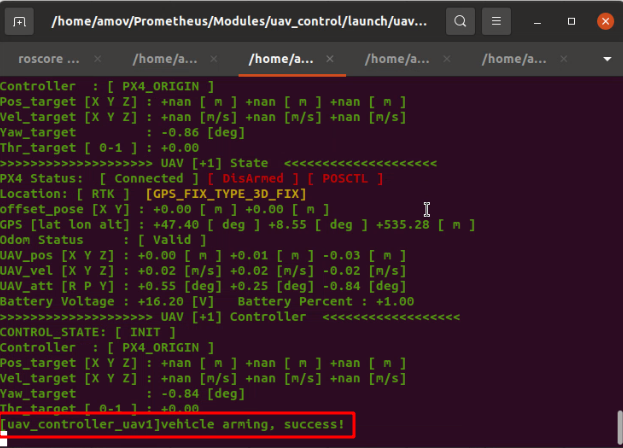

然后将遥控器SWA档杆打至最底端,此时无人机将解锁进入怠速状态,无人机状态信息如下图所示。

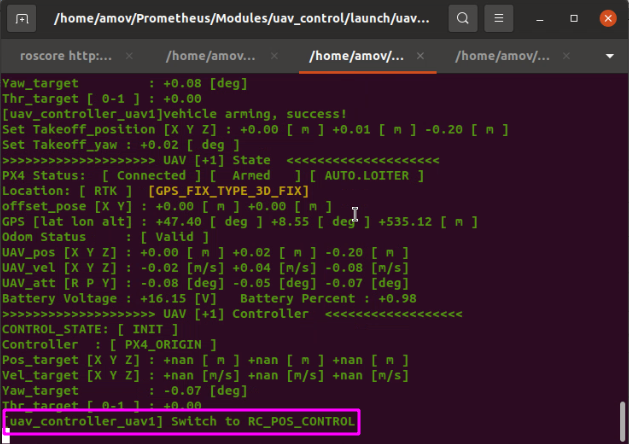

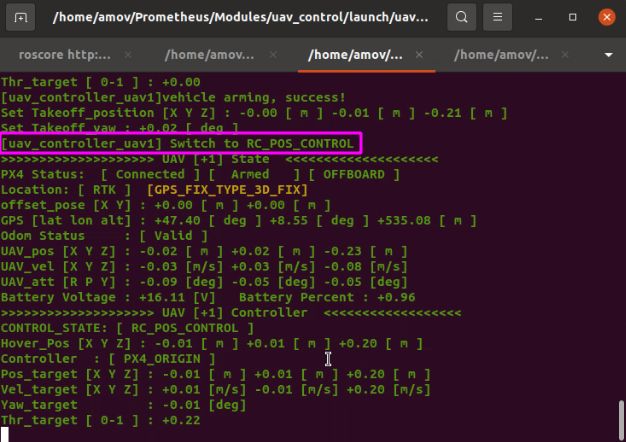

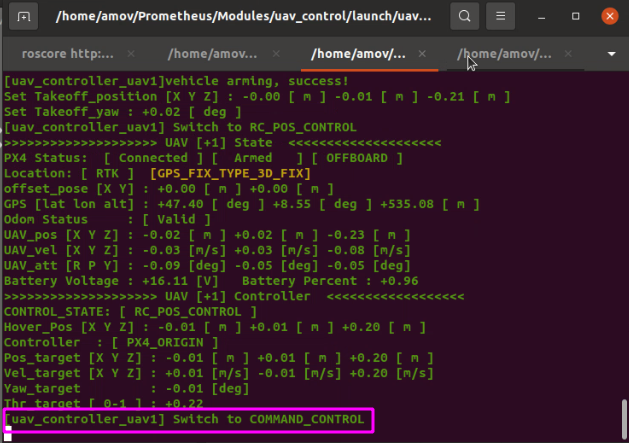

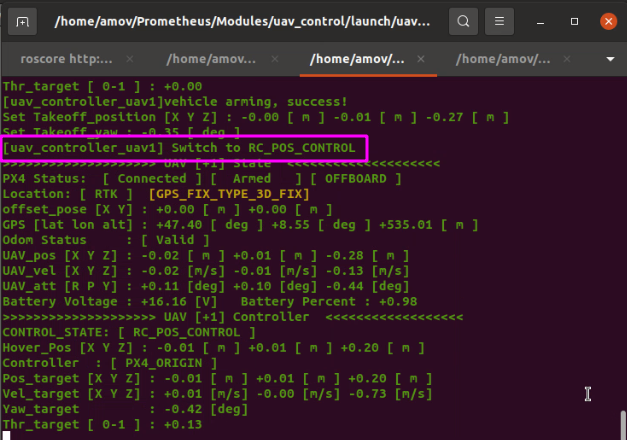

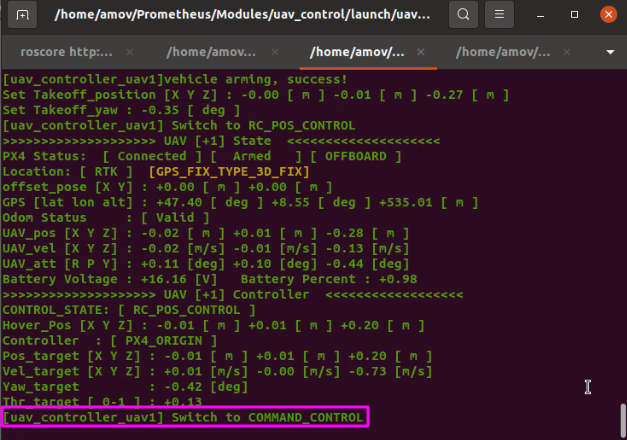

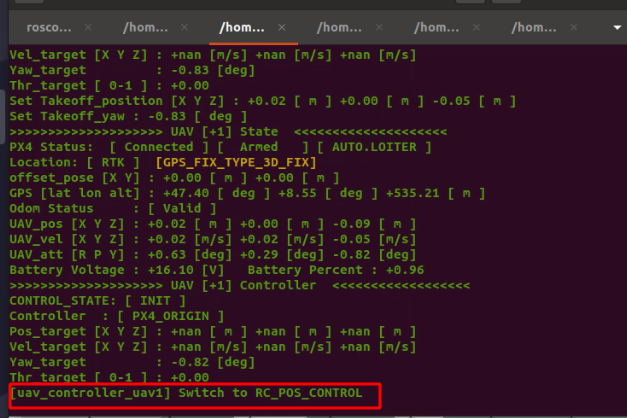

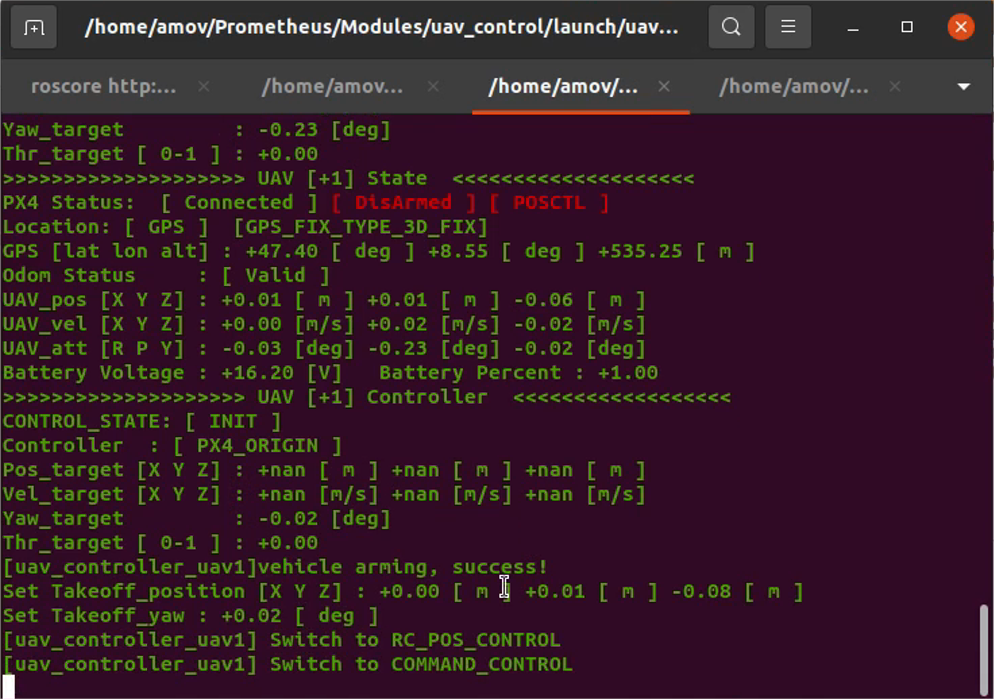

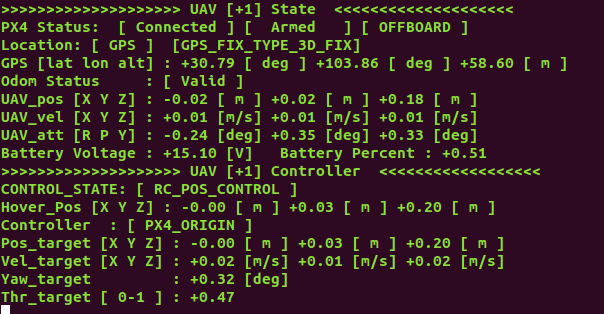

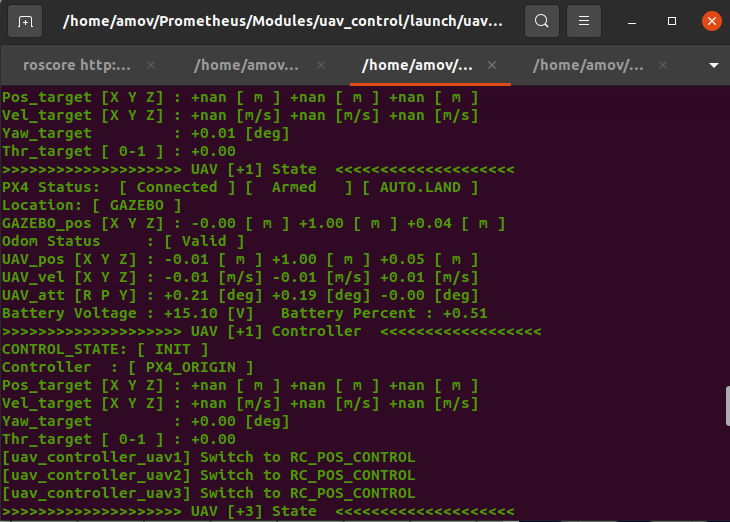

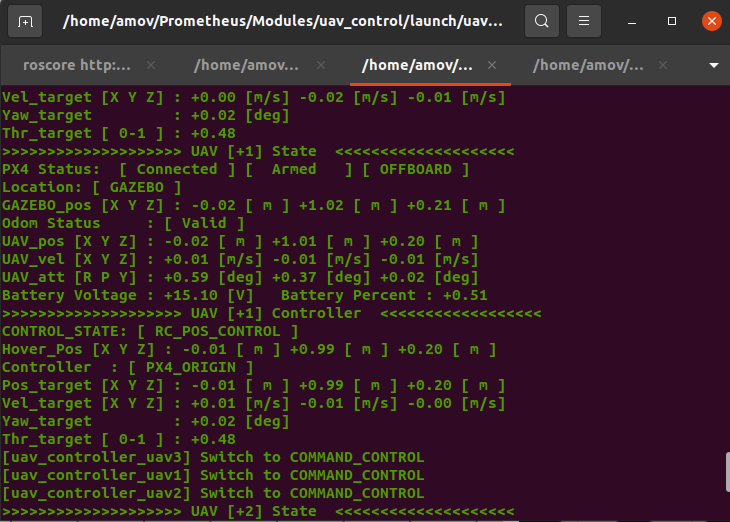

再将遥控器SWB档杆打至中间位置,此时无人机及进入RC_POS_CONTROL控制模式,此时可以通过遥控器控制无人机飞行,无人机状态信息如下图所示。

Prometheus仿真环境配置: Ubuntu

警告

提示

本章Prometheus仿真环境配置教程为Prometheus-v2版本的教程, 需要注意,由于Prometheus-v2版本更新,Prometheus-v1和Prometheus-v2相关项目分支存在差异

Prometheus-v2:Prometheus为

main分支,prometheus_px4为1.12.3分支也就是说如果你要配置Prometheus V1,那么在最开始不能直接git clone,那样会直接下载最新Prometheus 你需要指定分支v1.1下载 如下

git clone -b v1.1 https://gitee.com/amovlab/Prometheus.git #进入目录检查一下分支 cd Prometheus git branch #显示* v1.1代表分支下载正确Prometheus-v1:Prometheus为

v1.1分支,prometheus_px4为1.11.1分支这个和上面同理,下载时需要指定分支,如下

git clone -b Prometheus_PX4_1.11.1 https://gitee.com/amovlab/prometheus_px4.git #进入目录检查一下分支 cd prometheus_px4/ git branch #显示* Prometheus_PX4_1.11.1代表分支下载正确如果需要搭建Prometheus-v1版本,需要前往Prometheus旧版WIKI

前面已经提到Prometheus项目基于PX4和ROS,目前Prometheus支持在Ubuntu操作系统上运行,因此进行Prometheus仿真环境配置需要在电脑上安装Ubuntu操作系统,在Ubuntu操作系统上需要安装PX4、ROS、Prometheus以及相关依赖的环境。

安装步骤

Ubuntu系统

提示

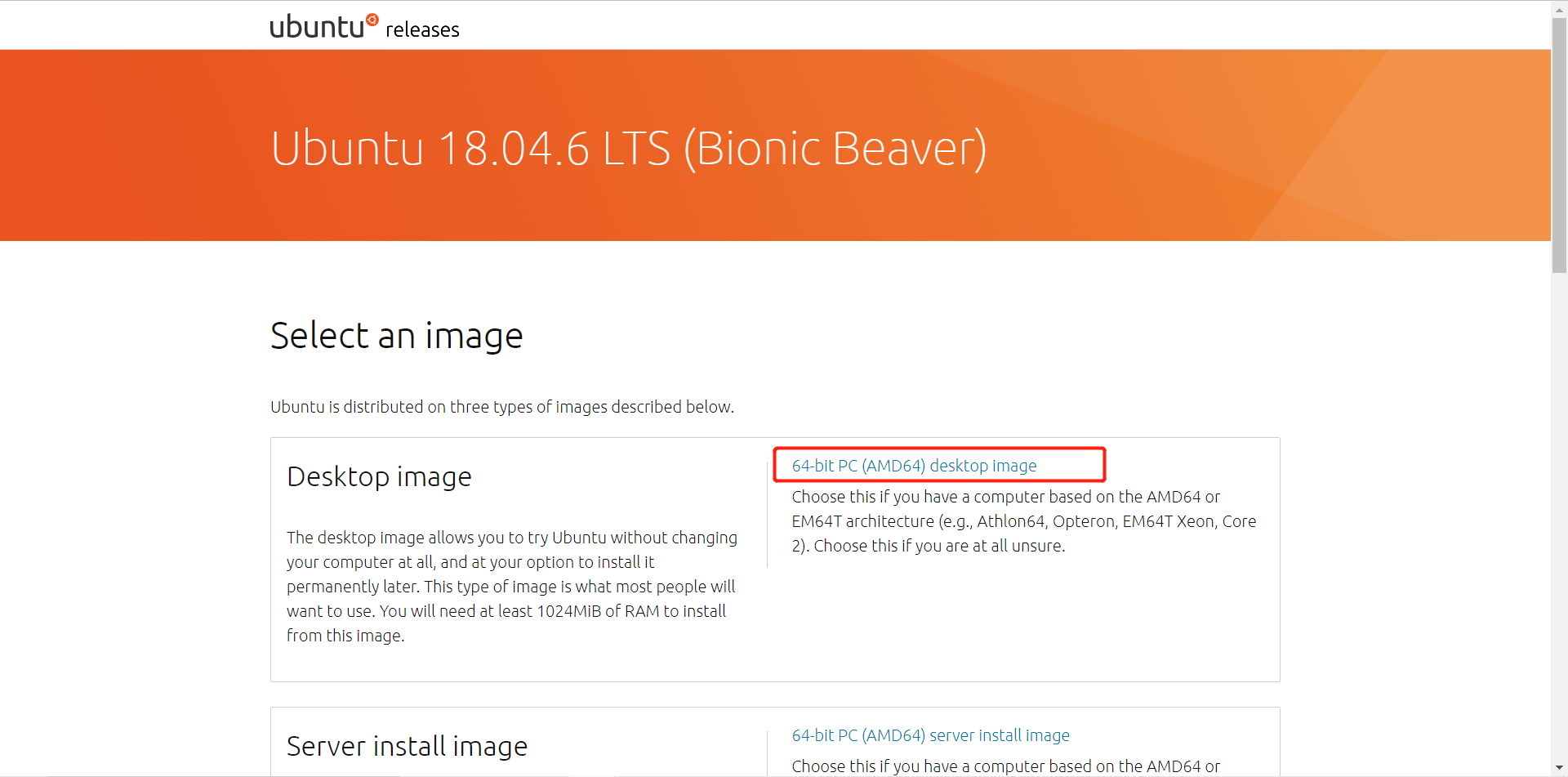

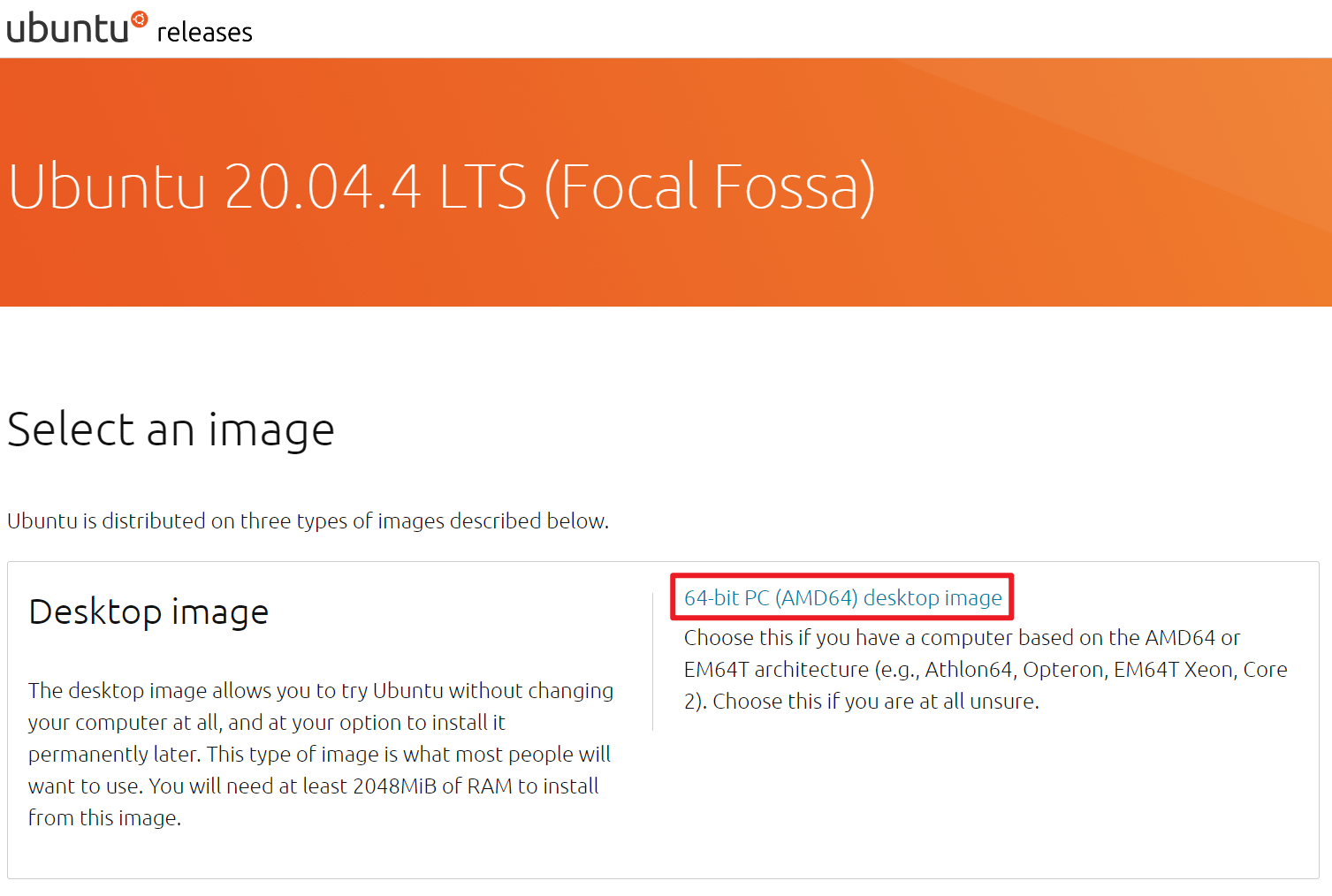

Prometheus支持Ubuntu18.04以及Ubuntu20.04操作系统

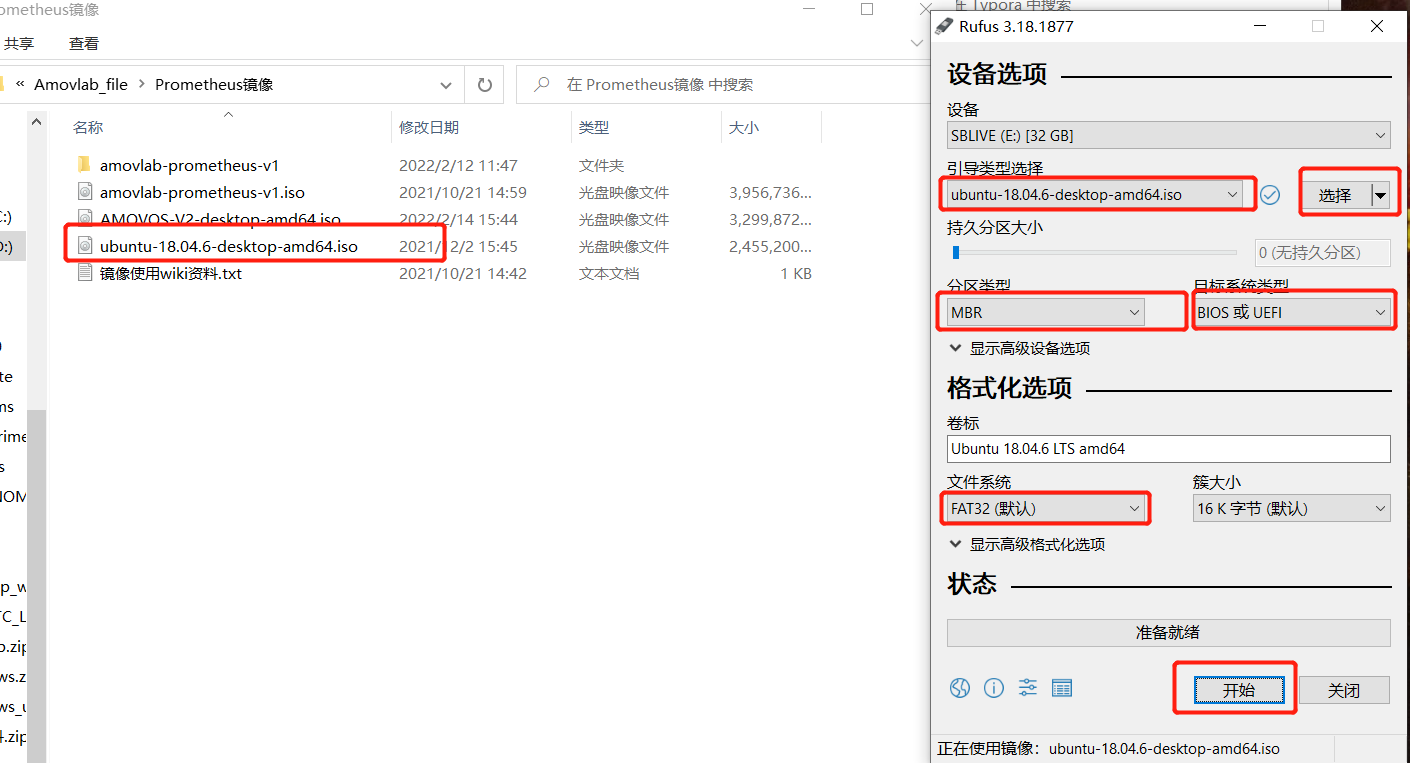

工具准备

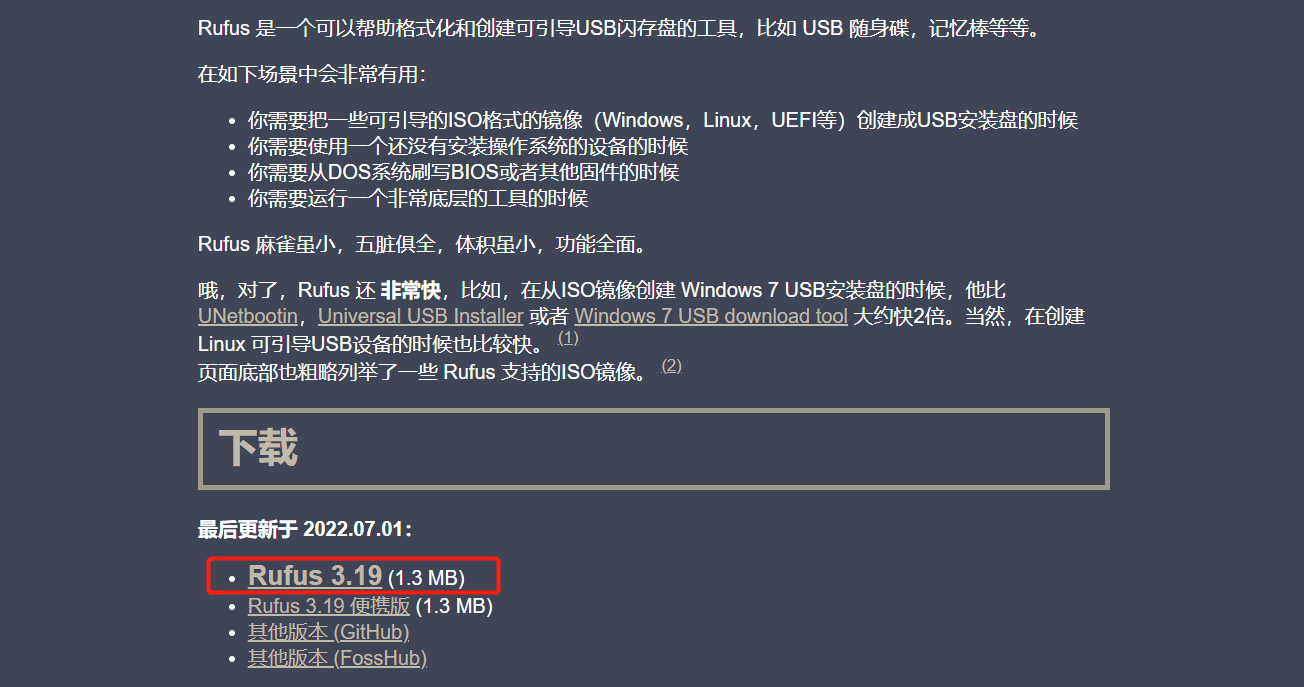

- Rufus软件

- Usb3.0接口U盘一个,推荐容量大于16G

- Ubuntu18.04桌面版镜像文件

Rufus下载

点击链接下载安装Rufus软件,选择图示版本。

Ubuntu系统镜像下载

Ubuntu18.04

点击链接下载安装Ubuntu18.04系统镜像,选择桌面版镜像,并设置好下载路径确保能找到镜像。

Ubuntu20.04

系统启动盘制作

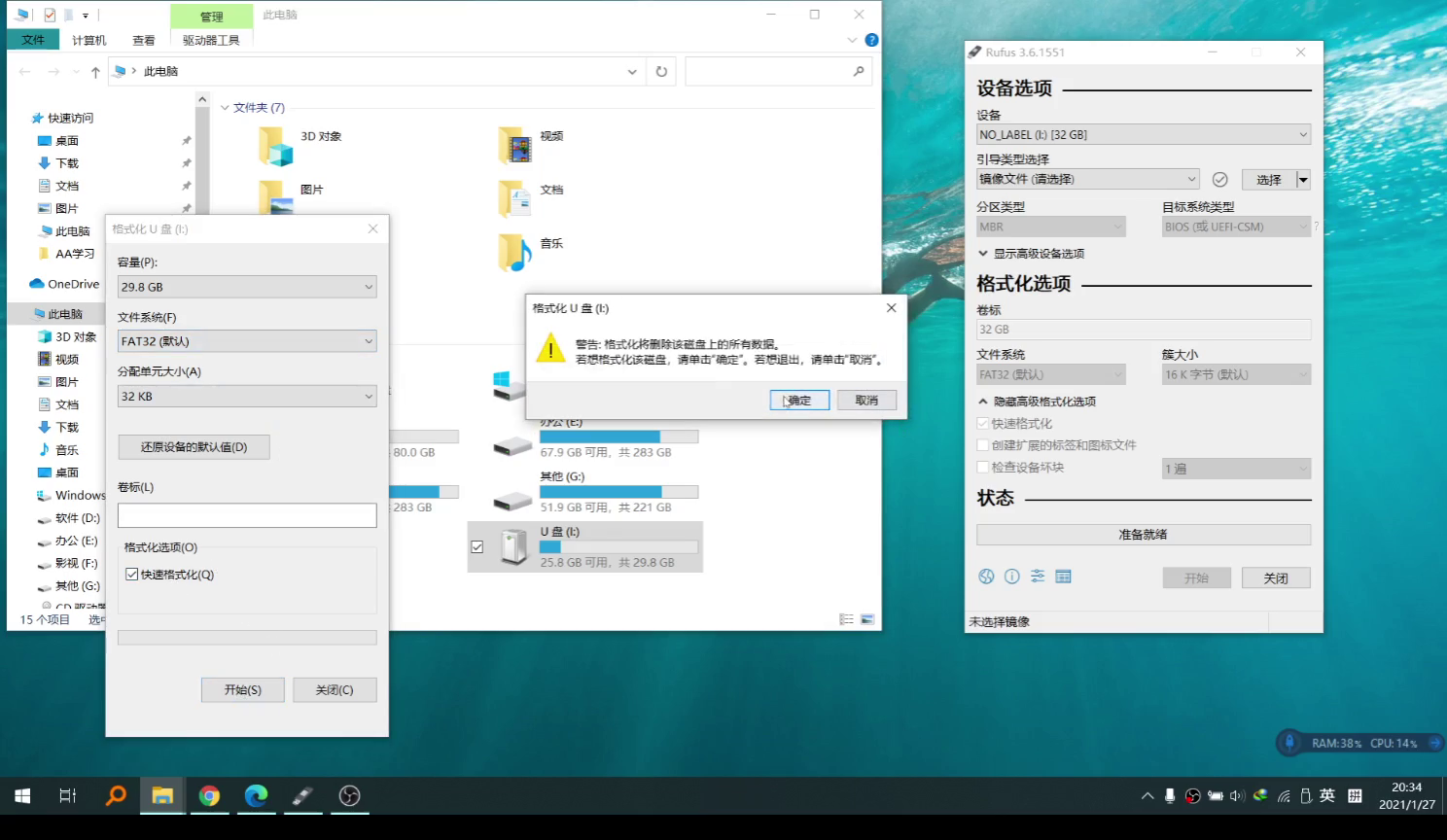

格式化U盘

警告

在格式U盘之前一定要备份好U盘中的数据!!!!

Rufus软件使用

使用Rufus软件制作启动盘。选择对应的U盘,选择下载好的Ubuntu镜像文件,其余设置与图示相同。等待制作完成关闭即可。

系统安装

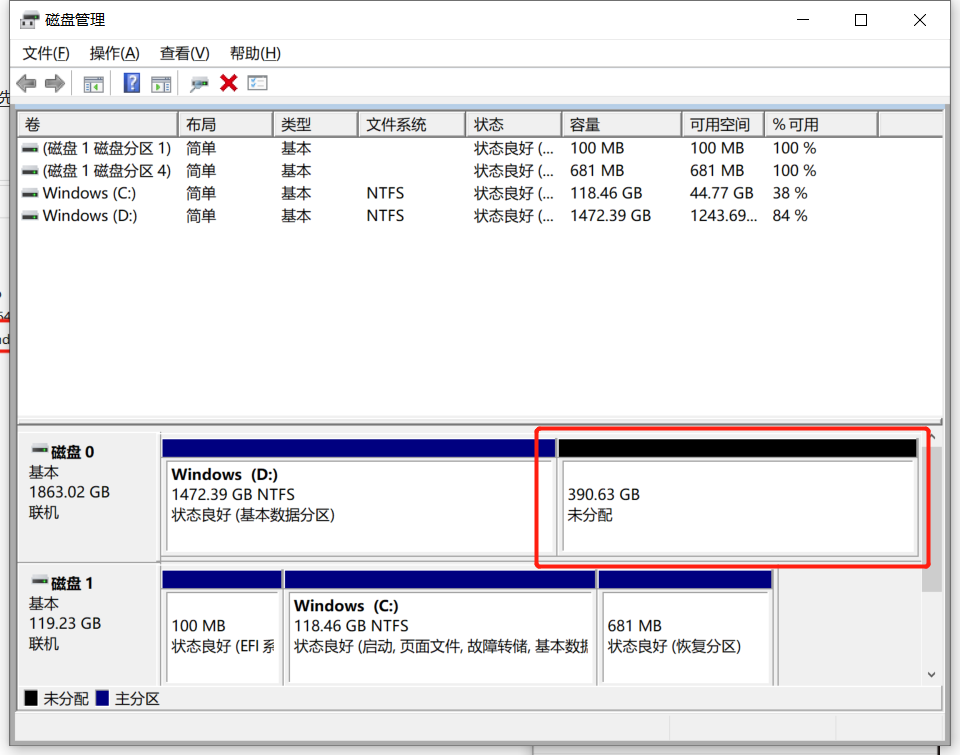

若为双系统安装,需压缩硬盘留出系统安装空间,单系统安装可跳过。

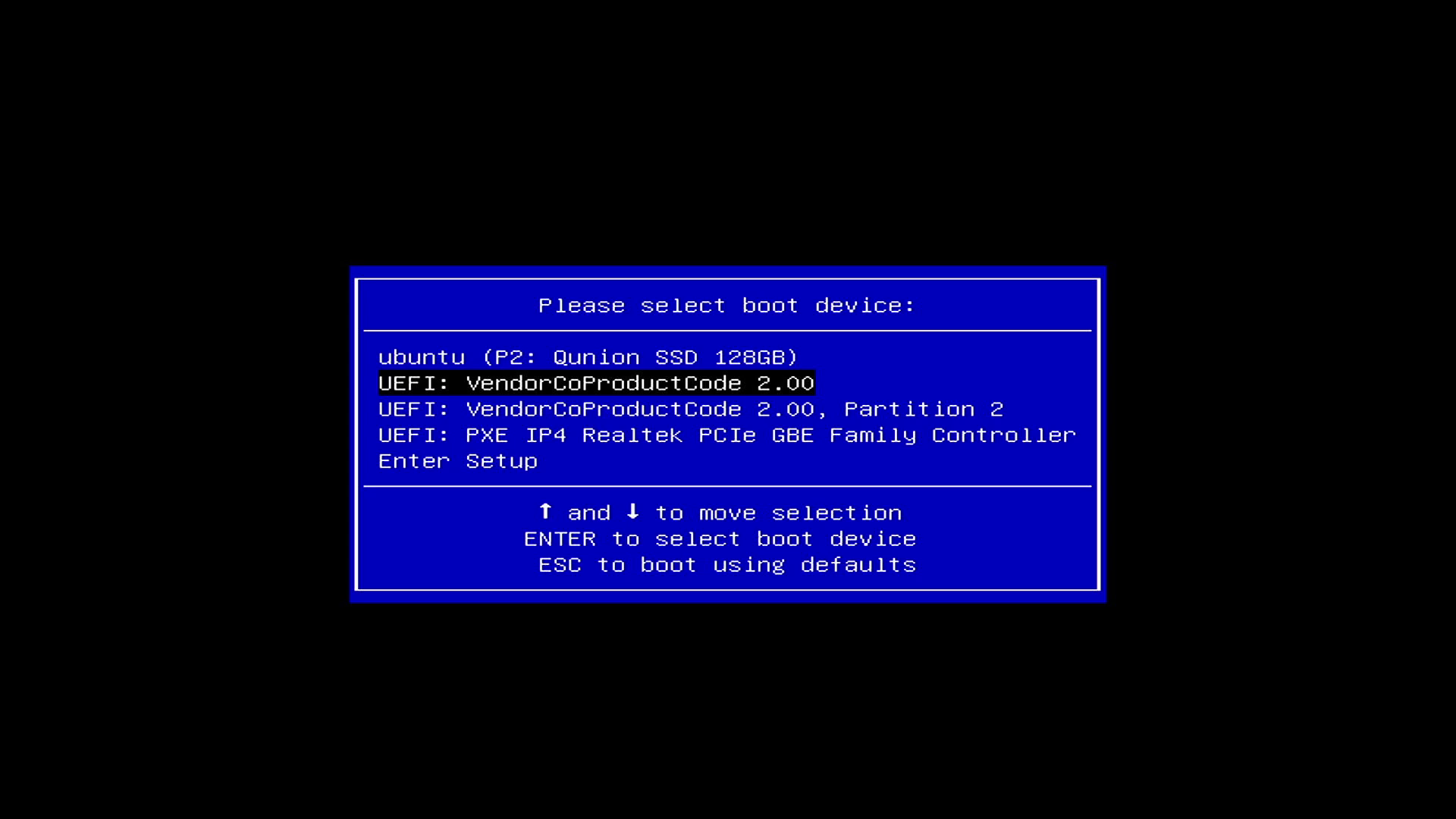

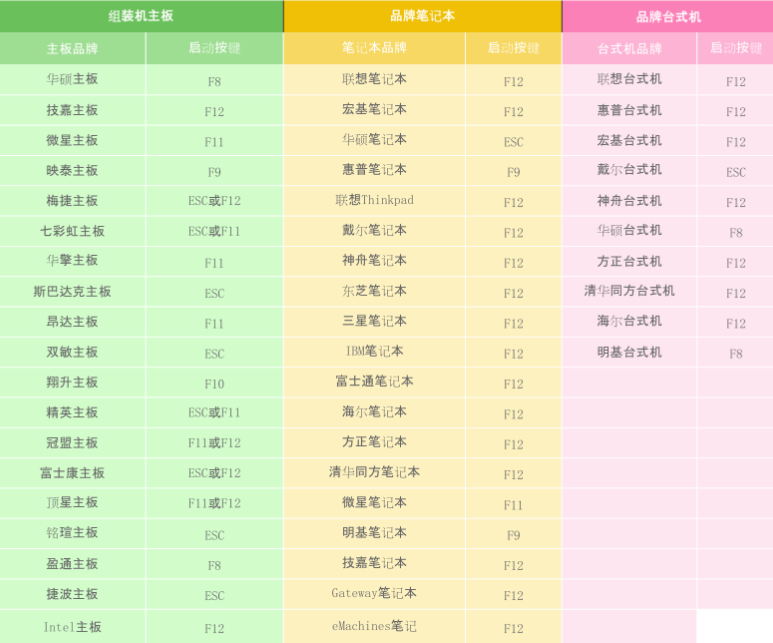

将U盘插上电脑、重启,在出现品牌logo时按F7进入boot模式,选择启动介质。

提示

不同品牌电脑,进入boot模式按键不同,可对照下图操作。

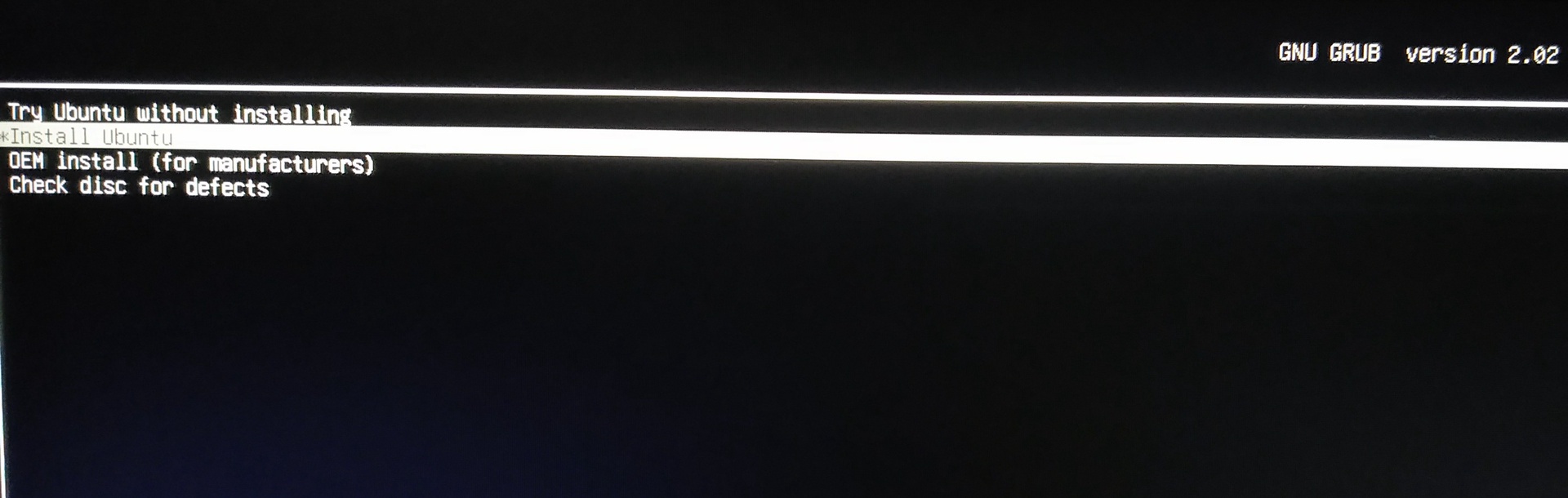

选择启动盘后,选择安装Ubuntu。

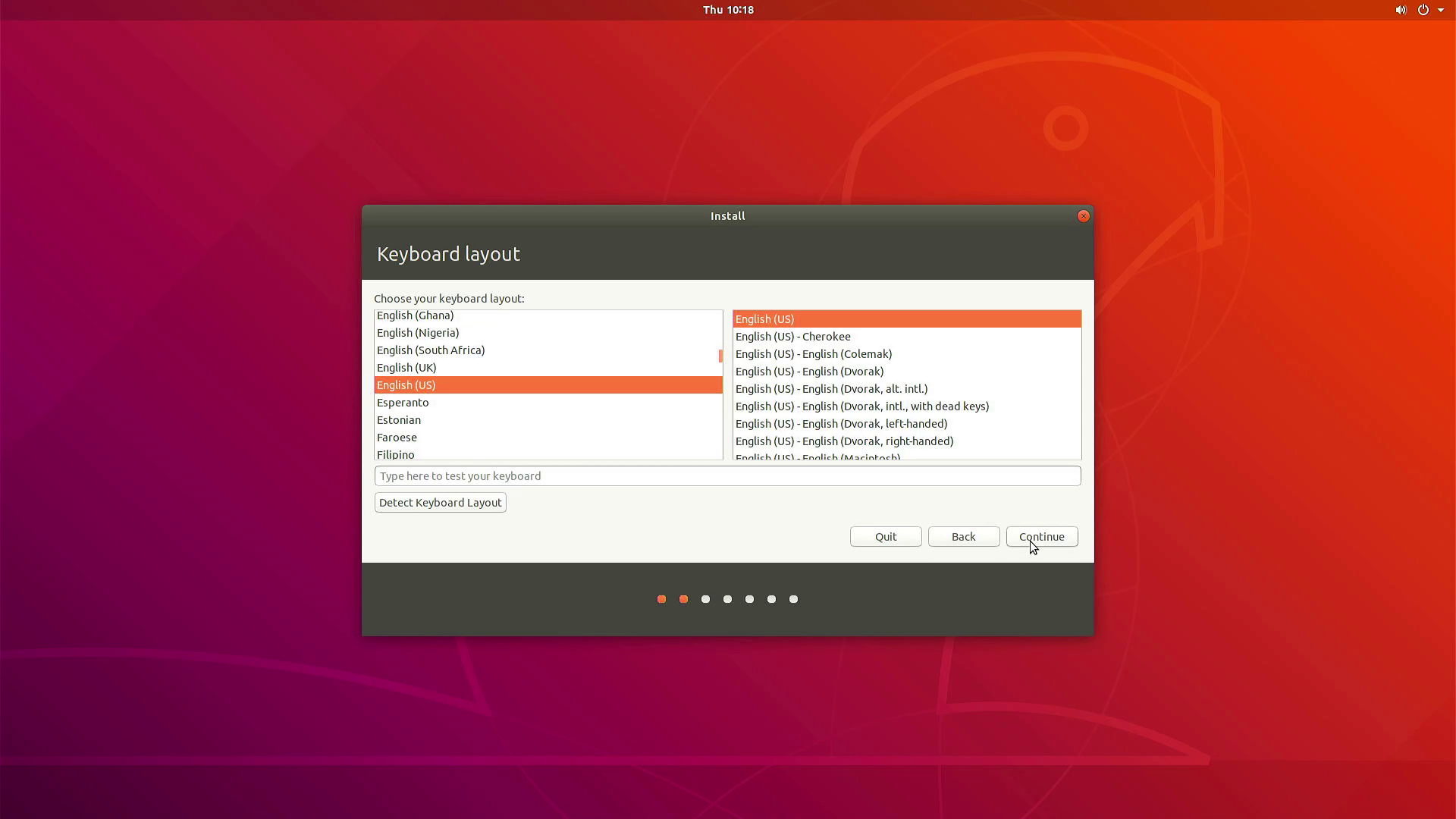

点击继续下一步。

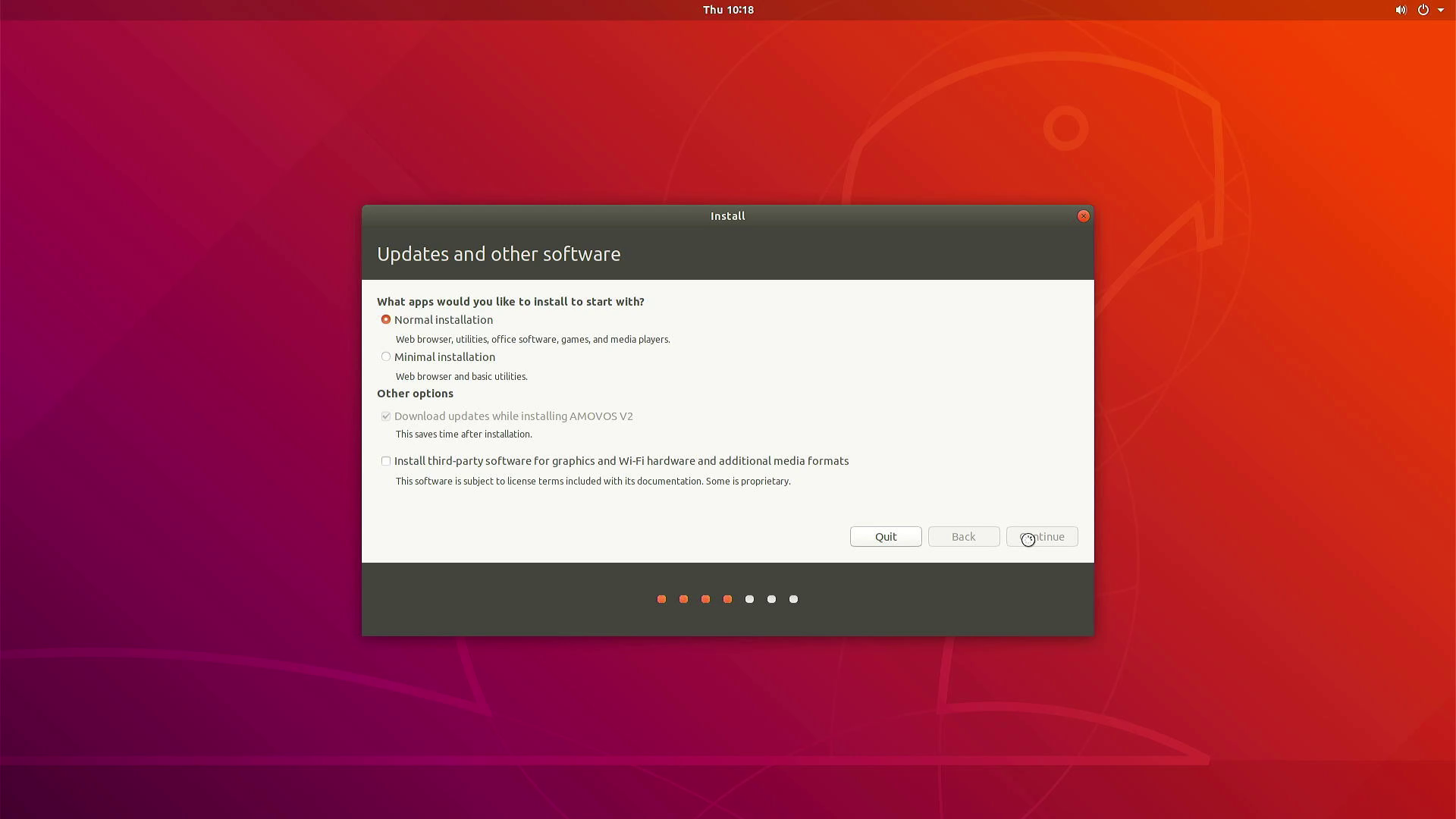

选择Normal installation 选项,如下图所示。

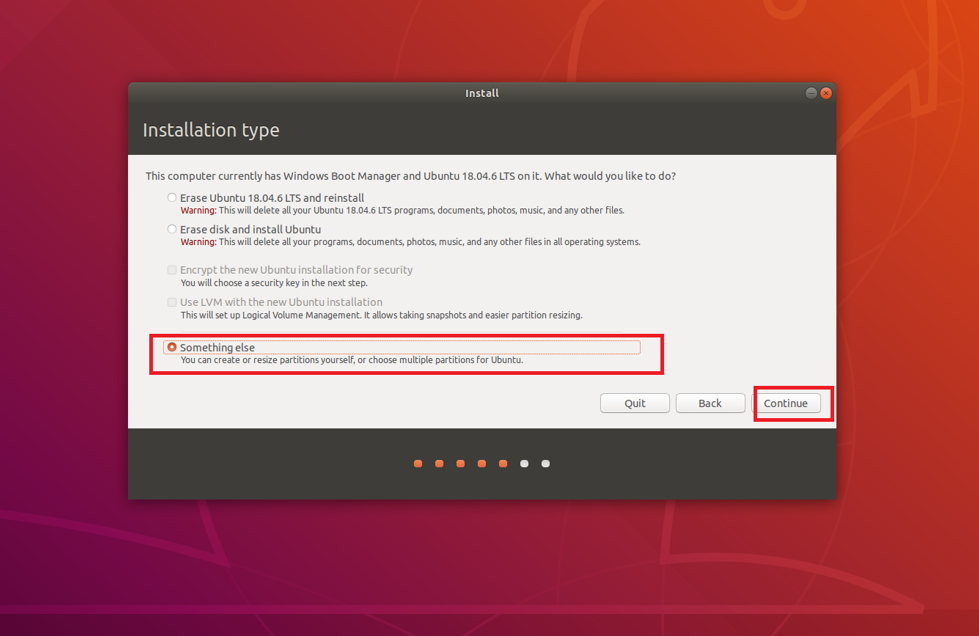

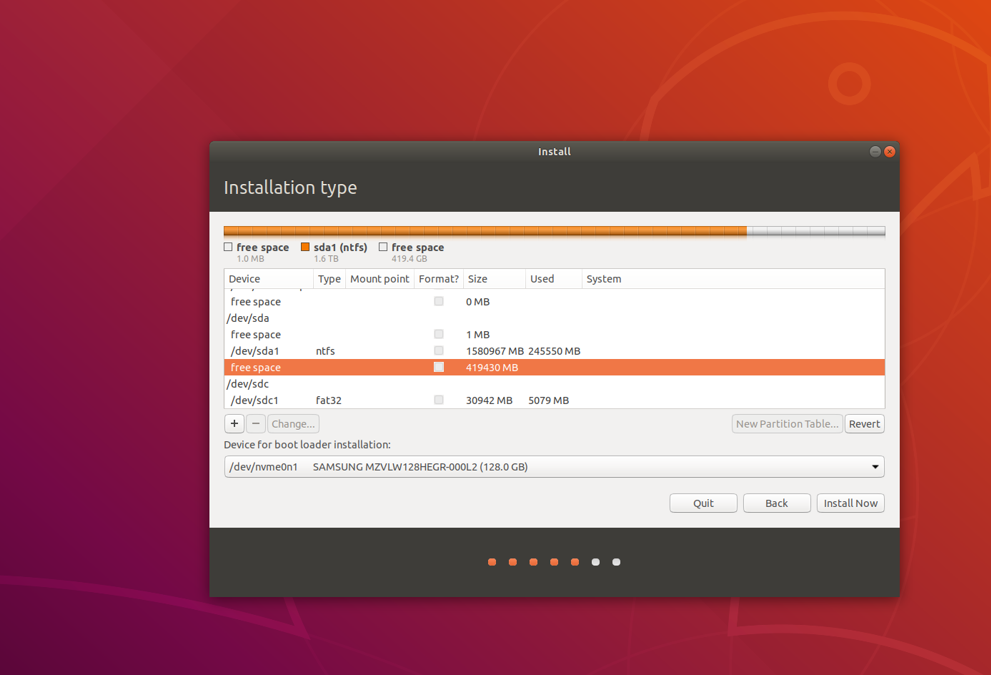

选择Something else 选项,如下图所示。

选择之前预留的存储空间。

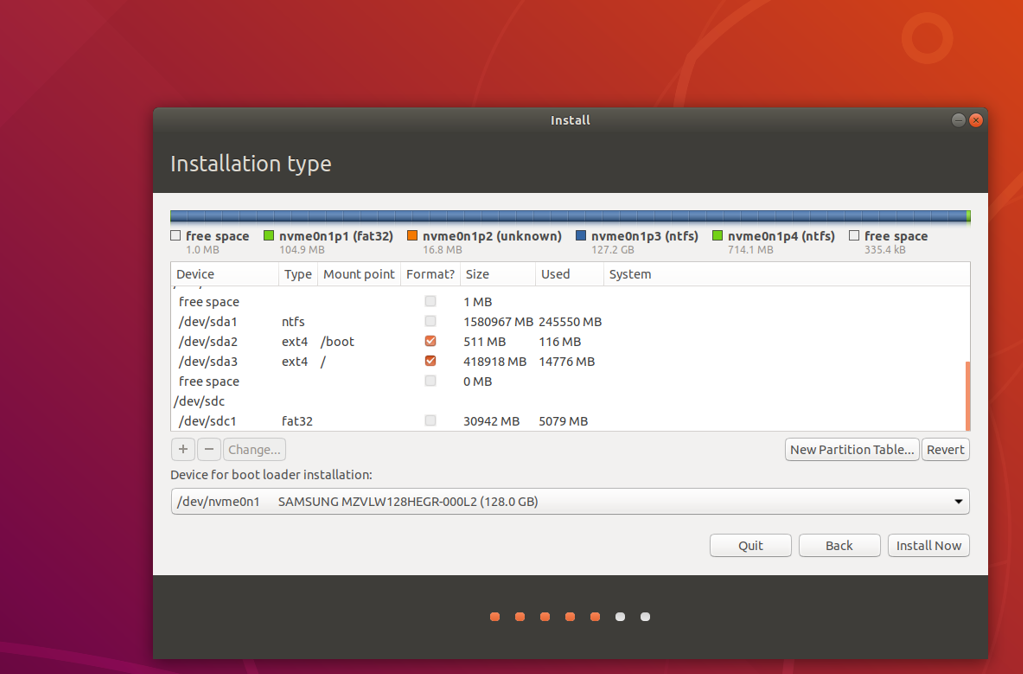

设置分区根据电脑内存和存储不同而不同,具体参见Ubuntu分区,勾选后点击install now。

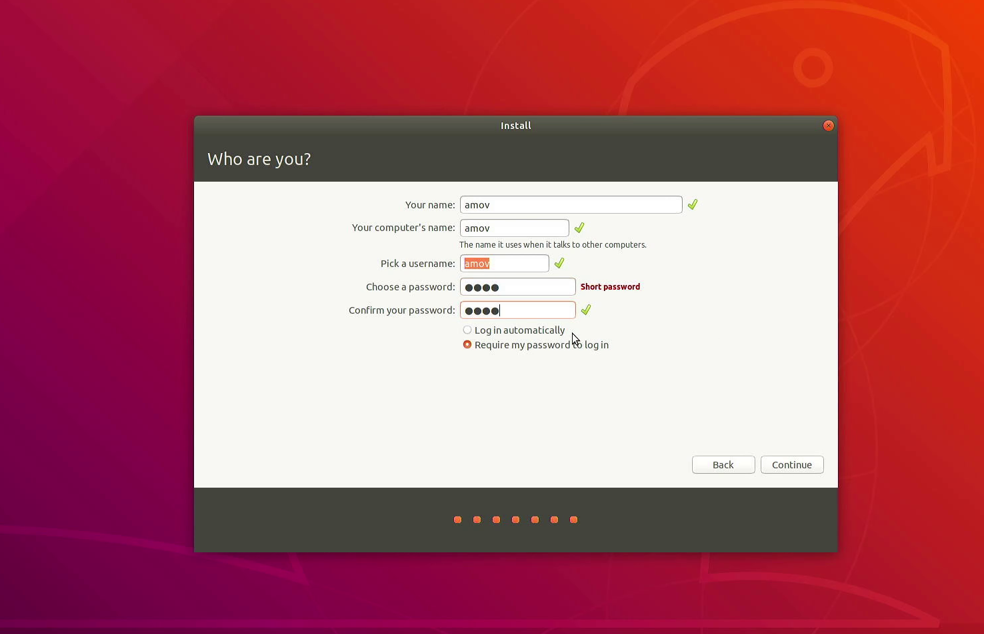

设置用户名及密码,点击继续。

等待安装完成后,重启。

对于Ubuntu使用由于国内网络环境影响,强烈建议更改Ubuntu的源,这里的源是指你使用Ubuntu下载东西时所经过的网络途径,默认是国外源,国内使用很慢,且经常出现下载失败,所以强烈建议改源,建议改为阿里源或者清华源 修改方法参见: 改源的两种方法

提示

ROS官方安装教程已经比较完善,Prometheus使用手册不再详细介绍,可参考官方的进行安装。

需要注意的是官方的安装由于国内网络环境影响可能会出现下载缓慢或者失败,这里也提供国内安装方法

fish一键安装:fish一键安装

国内源安装:国内源安装

Ubuntu18.04: ROS-melodic安装教程

Ubuntu20.04: ROS-noetic安装教程

ROS是否安装好可以通过终端依次输入下面指令,运行小乌龟程序来检验,如果可以正常键盘的↑↓←→键控制小乌龟代表正常ROS安装成功

roscorerosrun turtlesim turtlesim_noderosrun turtlesim turtle_teleop_key需注意无论哪种安装方式,其中一定包含构建包的依赖,也就是下面这个安装命令,否则后面安装PX4环境会出现问题

Ubuntu18.04依赖包

sudo apt install python-rosdep python-rosinstall python-rosinstall-generator python-wstool build-essentialUbuntu20.04依赖包

sudo apt install python3-rosdep python3-rosinstall python3-rosinstall-generator python3-wstool build-essentialprometheus_px4配置

prometheus_px4是Prometheus项目配套使用的PX4固件,Prometheus项目的仿真模块依赖PX4固件以及sitl_gazebo ros功能包。(如果是配置Prometheus到真实无人机上那不需要配置prometheus_px4,因为这个是用于虚拟仿真的,真实无人机不需要)

电脑建议Ubuntu18.04/20.04,内存建议大于等于16G,如果内存不足可以通过增加Swap空间来避免编译爆内存。Ubuntu20.04电脑默认分配swap 2G,如果编译卡住,也可以通过增加swap空间解决,教程链接

更新系统

sudo apt-get update sudo apt-get upgrade确保系统在当下版本保持最新

安装prometheus_px4

打开终端输入下面的命令安装prometheus_px4

git clone https://gitee.com/amovlab/prometheus_px4.git首次安装PX4固件时,需要安装PX4环境

cd prometheus_px4/Tools/setup source ./ubuntu.sh安装子模块以及相关依赖

注意

请将示例中的{your_prometheus_px4_path}替换为prometheus_px4的安装路径。

cd prometheus_px4 git submodule update --init --recursive #下载子模块可能会有些慢稍等,下载完可以再运行,如果下载好是不会显示什么的 pip3 install --user toml empy jinja2 packaging编译prometheus_px4

cd prometheus_px4make amovlab_sitl_default gazebo_p450编译对于CPU性能和内存有一定要求,内存建议16G及以上,CPU性能建议i7 10代及以上,安装Ubuntu18.04相比20.04对于性能要求相对低一些

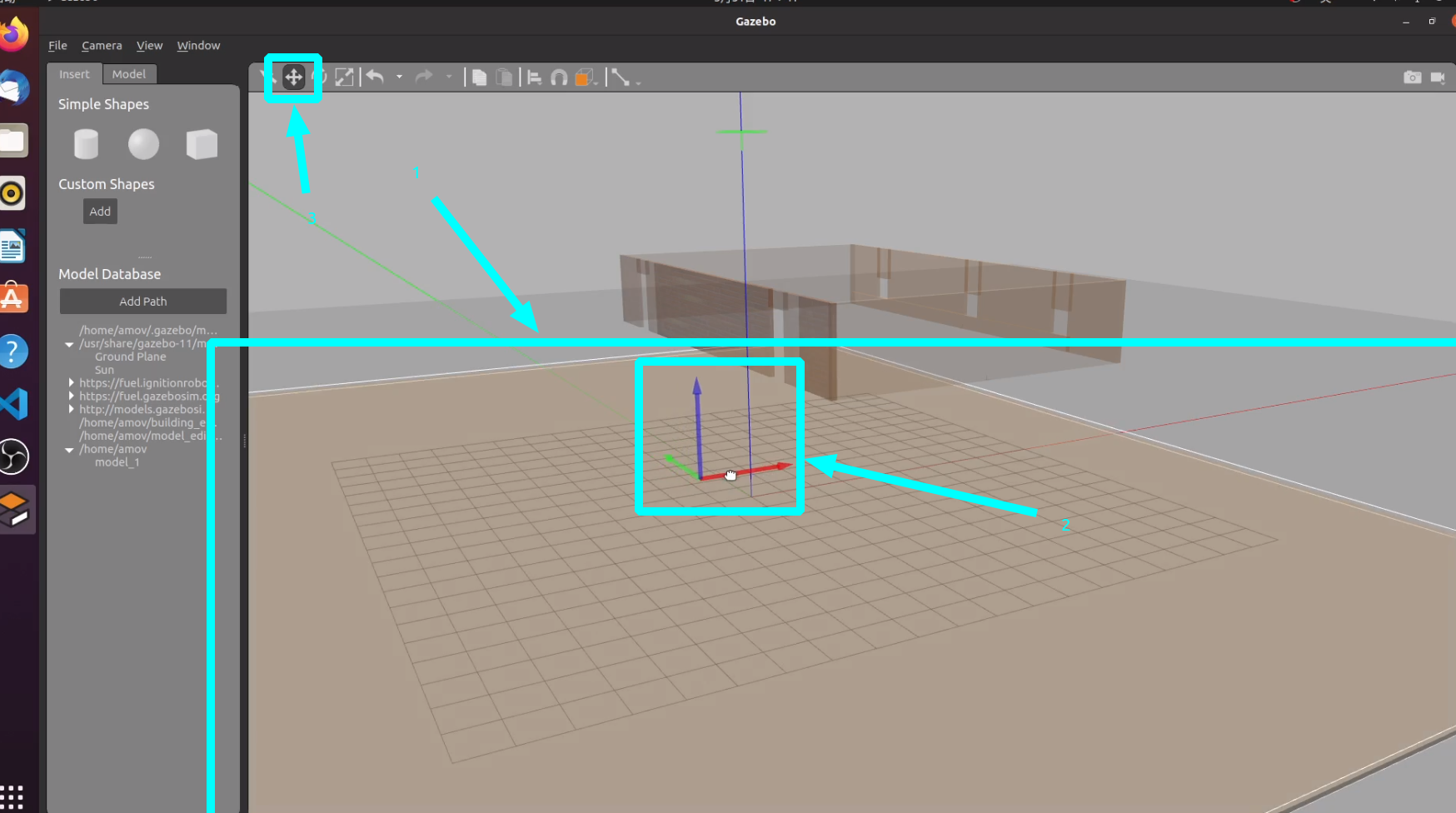

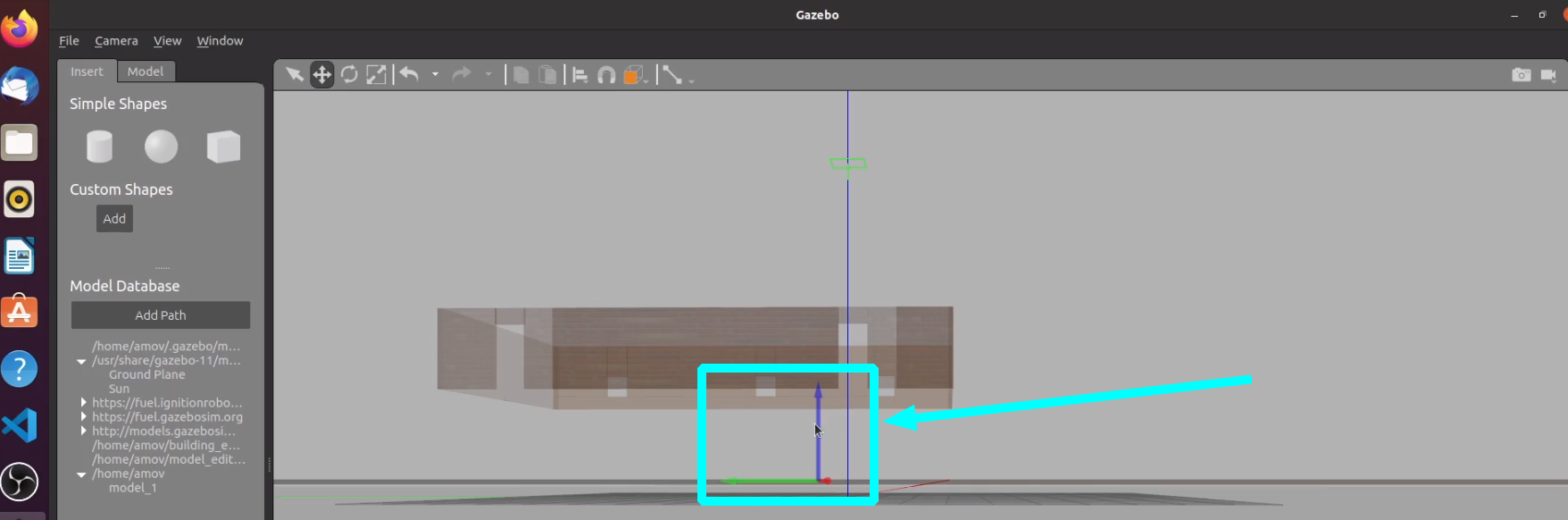

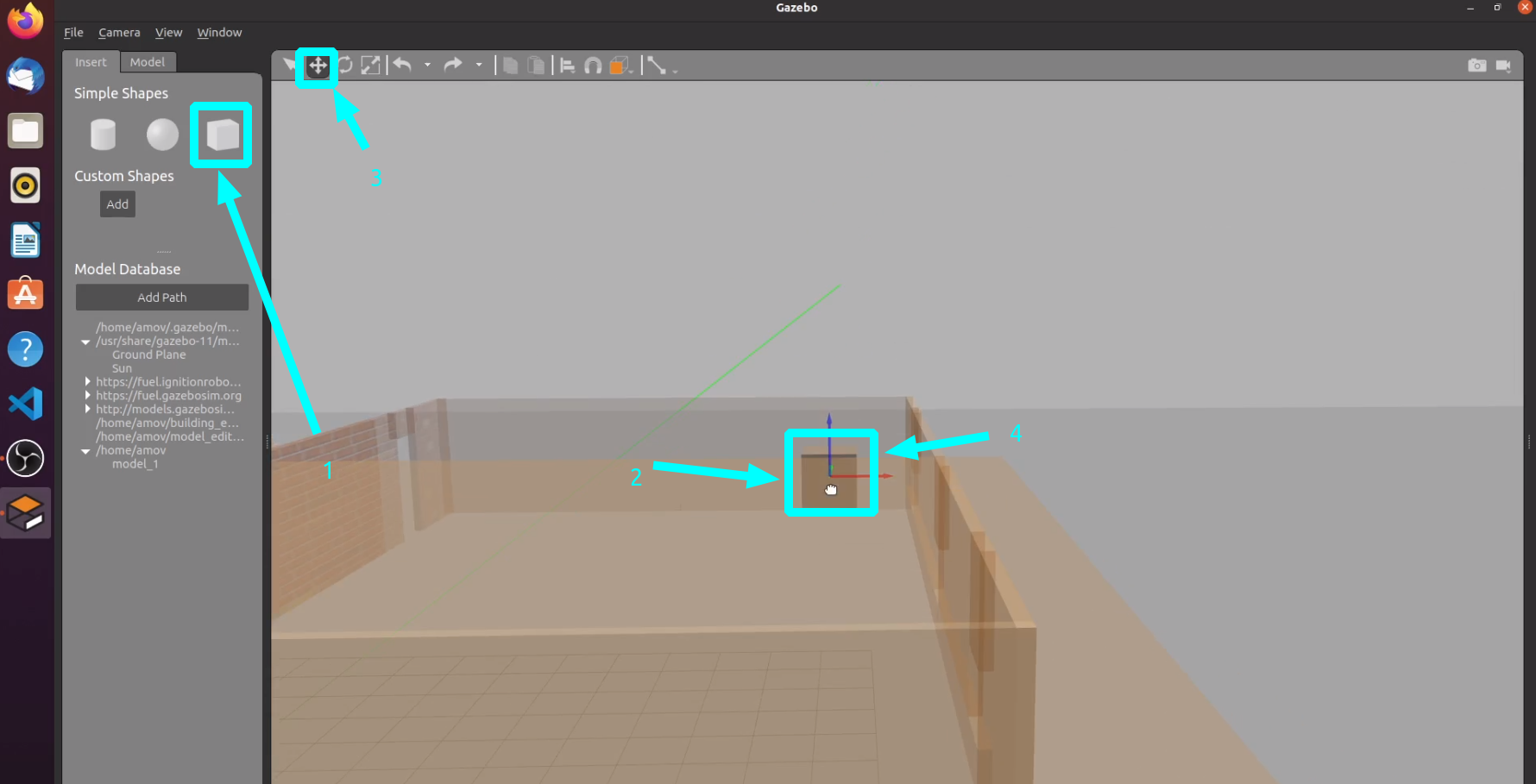

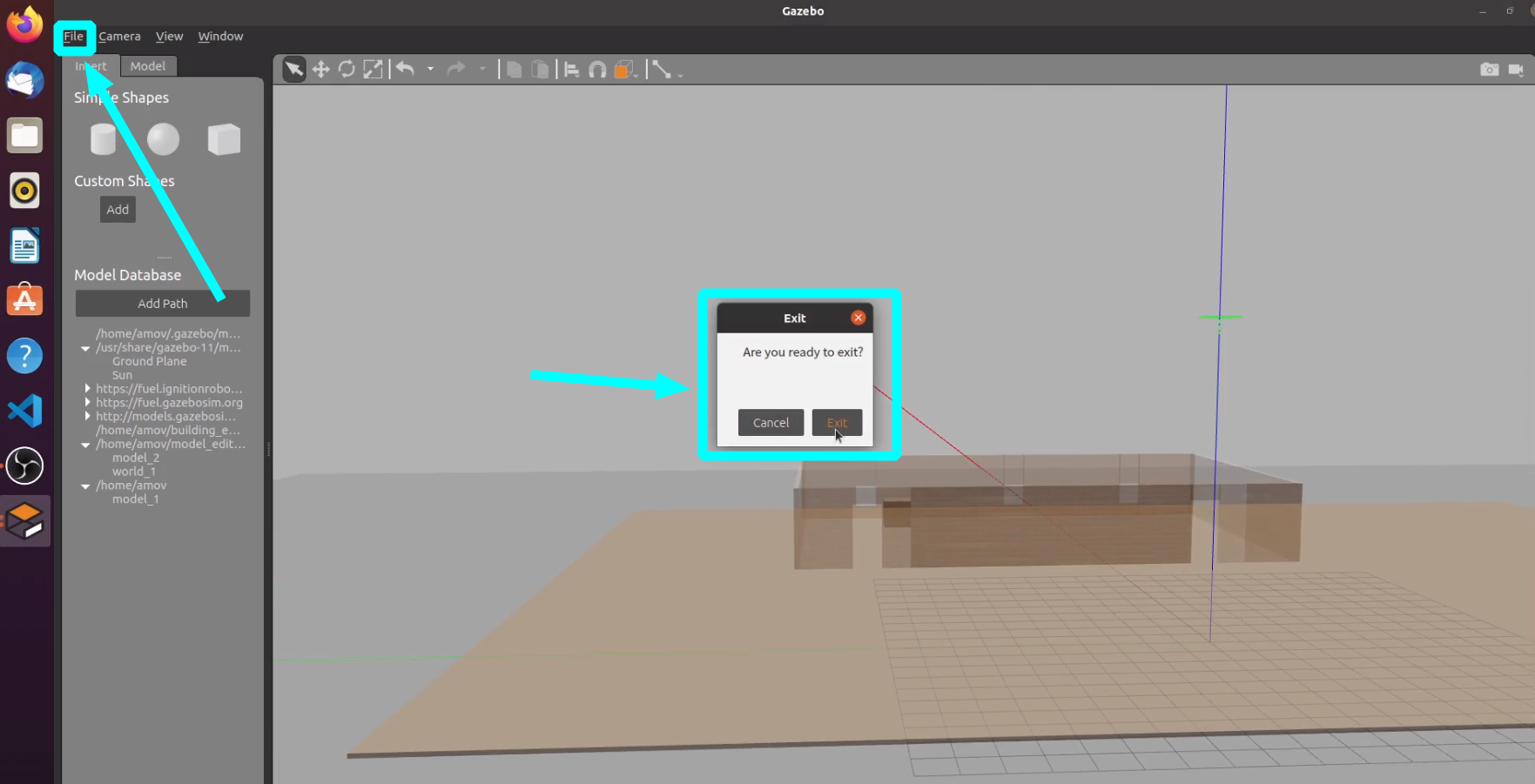

编译结束后,会自动运行gazebo仿真环境并加载P450无人机

如果遇到错误无法如下图显示,见下面常见错误解决

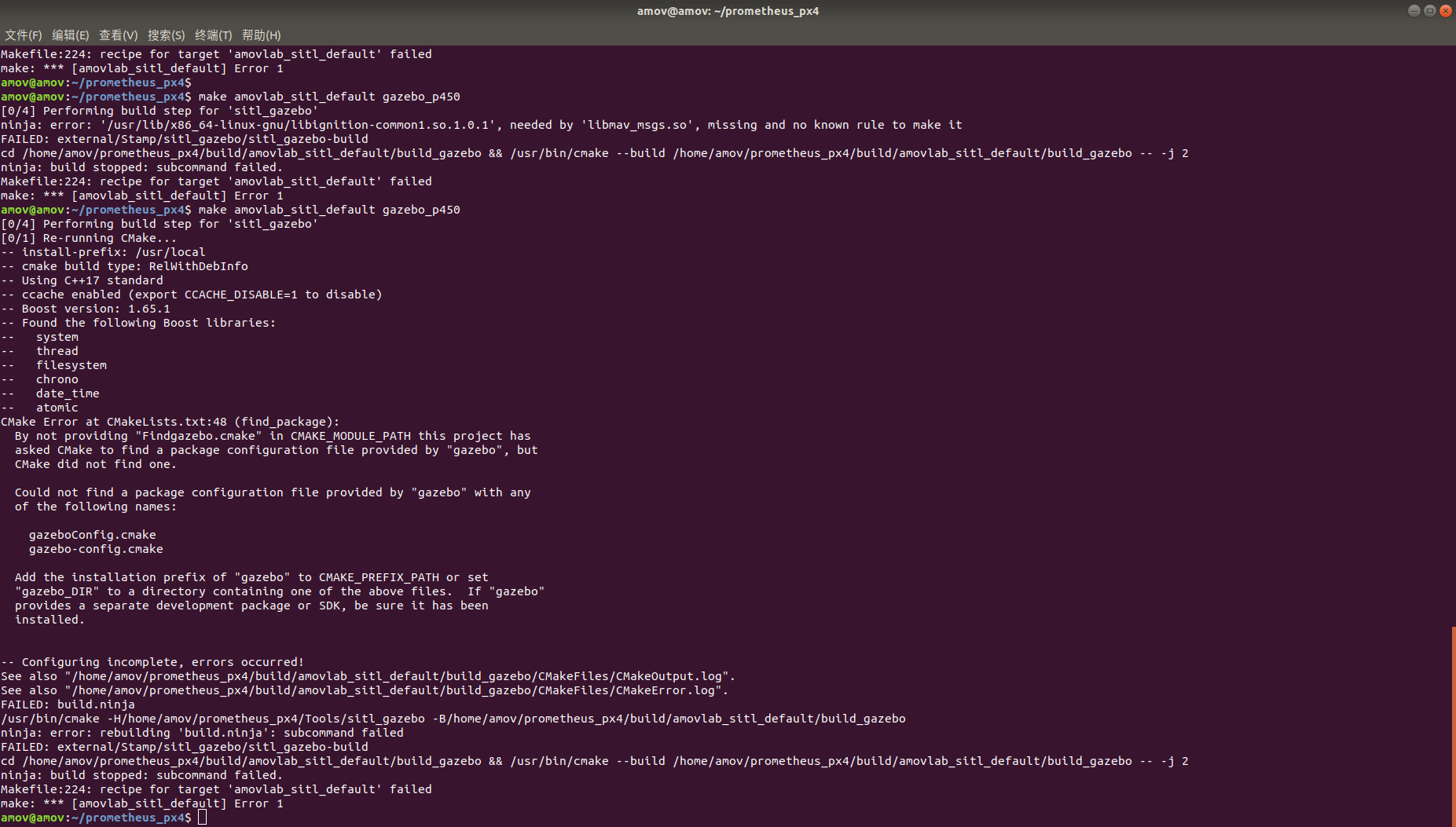

常见报错如下图所示

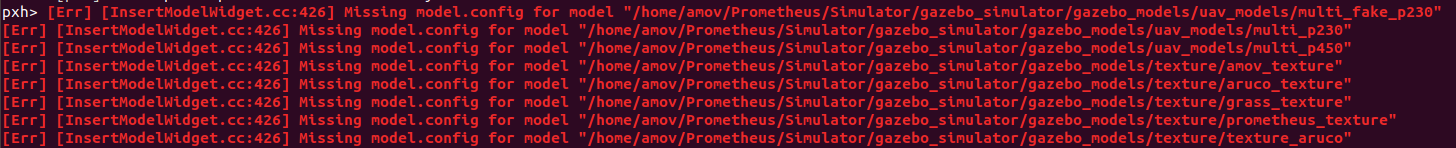

1.启动仿真环境时部分电脑可能出现下面这种报错信息,但只要仿真环境和P450无人机可以正常加载就可以忽略相关报错。

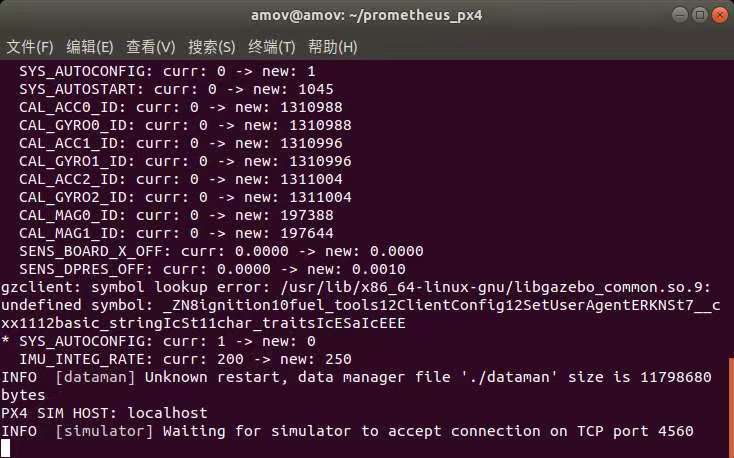

2.如果出现“Waiting for simulator to accept connection on TCP port 4560”并且一直保持,并且往上看显示lookup error:........./libgazebo_common.so.9,如下图 ,那么关闭终端,单独打开gazebo软件,不出意外是没有反应,这个错误原因:ignition-math库太老了,需要更新。 运行下面代码

sudo apt upgrade libignition-math2

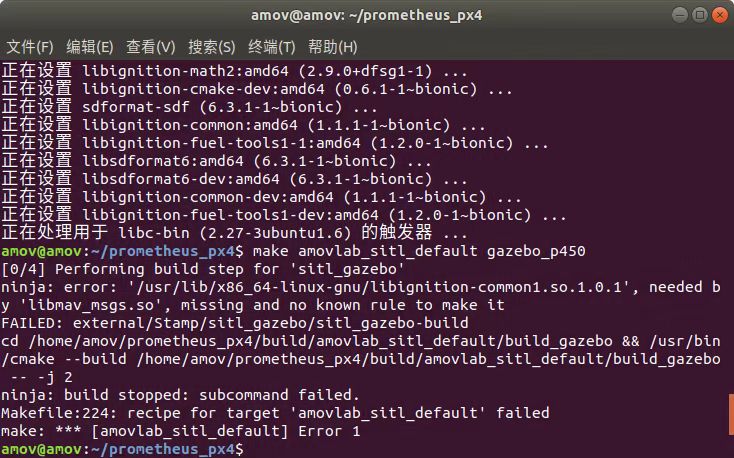

3.如果错误显示'amovlab_sitl_default'failed ,中间错误显示error:'........../libignition-common.so.1.0.1',如下图所示,这个是系统缺少libignition-common_1.0.1-1 点击ignition-common,下载libignition-common_1.0.1-1_amd64.deb,右键->用软件安装打开

4.如果出现错误显示“could not find a package configuration file provided by "gazebo" with any”,这个是缺少gazebo中的配置文件 运行下面代码

sudo apt-get install ros-melodic-gazebo-dev

ubuntu的终端中遇到错误不要慌,根据终端错误提示,将提示复制,百度搜索,一般都可以解决

Prometheus配置

安装Prometheus

打开终端输入以下命令安装Prometheus项目。

git clone https://gitee.com/amovlab/Prometheus.git安装prometheus_mavros

prometheus_mavros是Prometheus项目配套使用的MAVROS功能包,Prometheus项目与PX4连接进行数据交互依赖于MAVROS功能包。

打开终端输入以下命令安装prometheus_mavros。

注意

请将示例中的{your_prometheus_path}替换为Prometheus的安装路径。

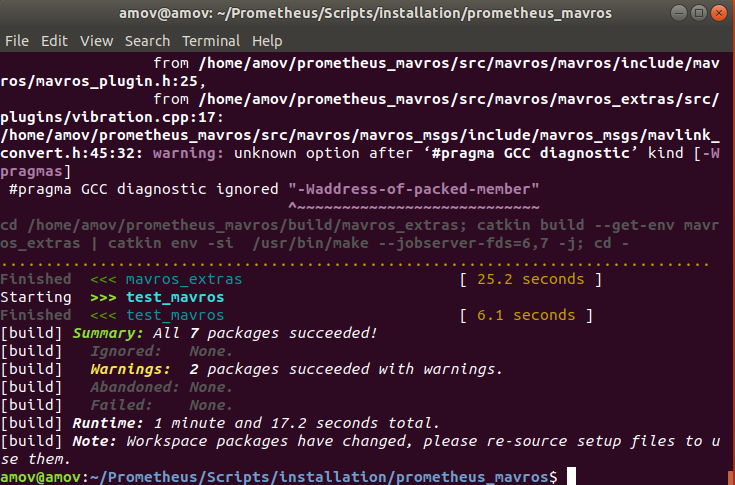

cd Prometheus/Scripts/installation/prometheus_mavros chmod +x install_prometheus_mavros.sh ./install_prometheus_mavros.sh

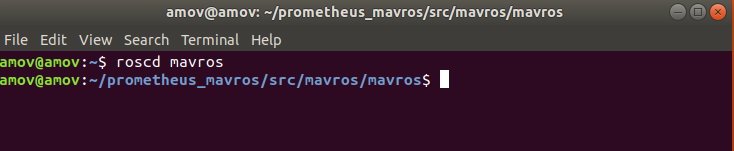

安装完毕后关闭当前终端窗口,打开新的终端输入以下命令测试prometheus_mavros是否正常安装完毕以及环境变量是否正常加载。

roscd mavros如果出现路径为

~/prometheus_mavros/src/mavros/mavros则证明安装成功。

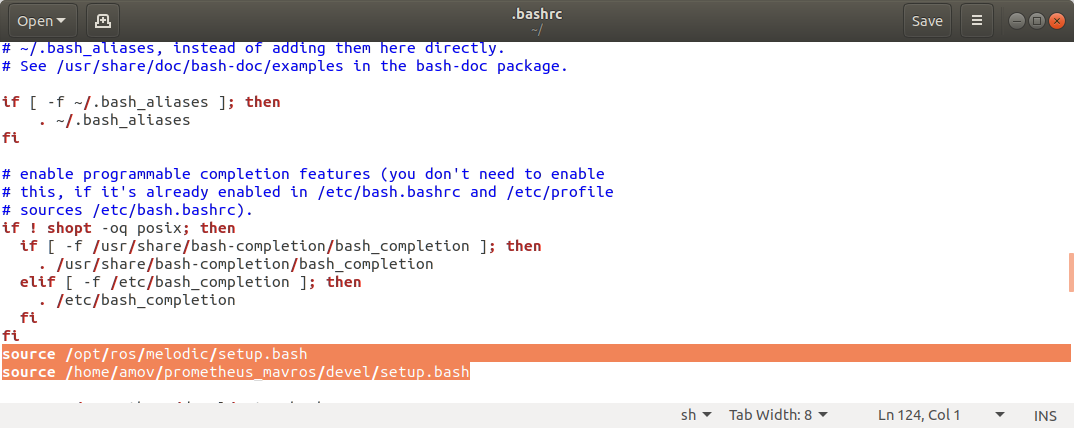

如果上面执行后没有报错,但是roscd mavros 并不能成功,那么打开.bashrc文件

sudo gedit ~/.bashrc正常情况下.bashrc里显示了ROS的环境"source /opt/ros/melodic/setup.bash",这时添加mavros如下所示

source ~/prometheus_mavros/devel/setup.bash

保存退出,再终端中更新环境变量

source .bashrc再

roscd mavros如果还没有成功那么就是前面有错误,仔细看看运行过程中是否异常,报错。

依赖项下载

遥控器仿真驱动安装

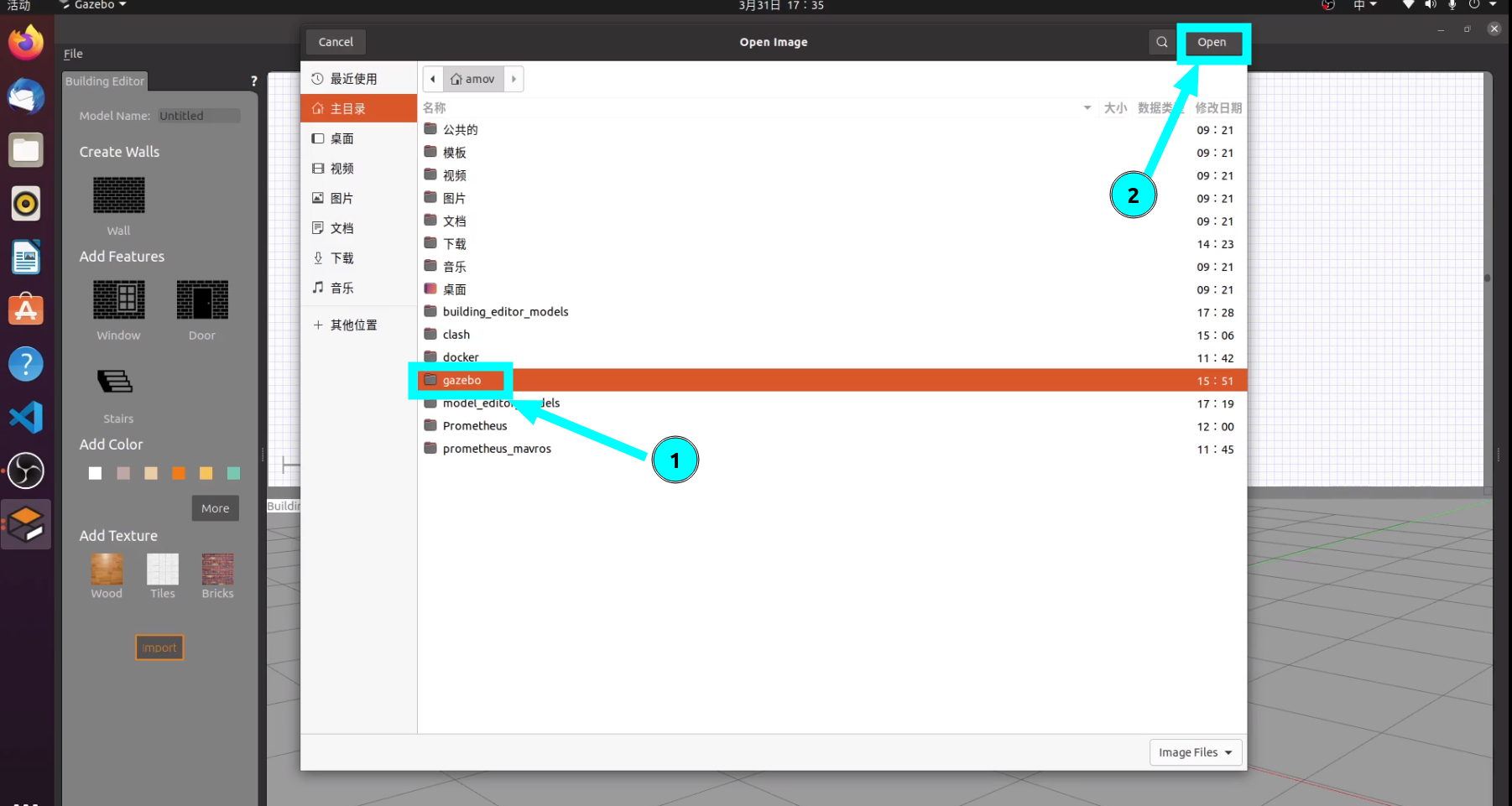

## 安装遥控器仿真驱动 sudo apt-get install jstest-gtk ## 安装完成之后,可以在终端中运行如下指令确认遥控器是否正常以及摇杆和按钮的响应情况 jstest-gtkGazebo模型库下载

cd ~/.gazebo/ # 如果之前没有models文件夹的话,创建models文件夹 mkdir -p models cd ~/.gazebo/models/ # 这个仓库是从官方仓库(https://github.com/osrf/gazebo_models)复制过来的,会定期更新 git clone https://gitee.com/amovlab/gazebo-models.gitnlink_parser安装

nlink_parser为UWB驱动功能包,目前仅支持nooploop相关UWB产品

# 通过git clone方式下载功能包,参考README配置该功能包 git clone https://github.com/nooploop-dev/nlink_parser.gitvrpn_client_ros安装(可选)

vrpn_client_ros功能包为动捕定位系统应用所依赖的ROS功能包,如果使用动捕定位则需要下载该功能包

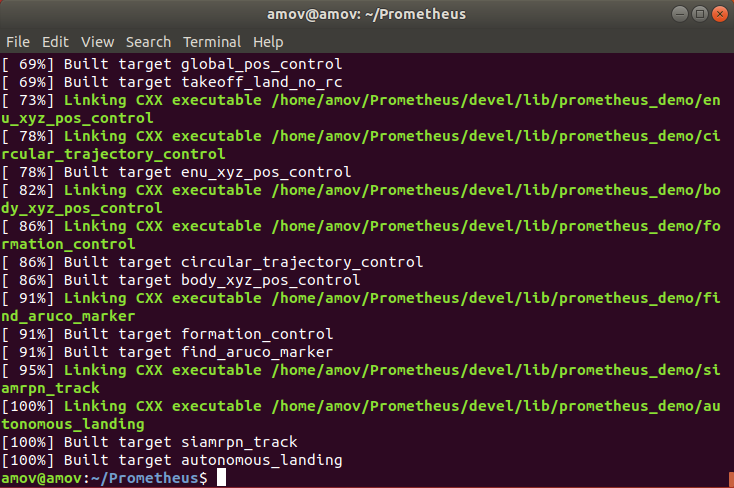

sudo apt-get install ros-melodic-vrpn-client-ros编译Prometheus

输入以下命令编译Prometheus项目。

cd Prometheus # 第一次使用时需要给编译脚本文件添加可执行权限 chmod +x compile_* # 编译控制功能模块 ./compile_control.sh

目前提供四个编译脚本:

编译脚本文件 编译模块 compile_all.sh 编译全部功能模块,包含基础模块、通信模块、Gazebo仿真模块、控制模块、demo模块、规划模块、目标检测模块 compile_control.sh 编译控制功能相关模块,包含基础模块、Gazebo仿真模块、控制模块、demo模块 compile_planning.sh 编译规划功能相关模块,包含基础模块、Gazebo仿真模块、控制模块、规划模块 compile_detection.sh 编译视觉功能相关模块,包含基础模块、Gazebo仿真模块、控制模块、demo模块、目标检测模块 警告

提示

用户可根据自身情况选择其中一个编译脚本文件运行,可避免不需要的功能模块带来的环境或编译问题。

其他配置

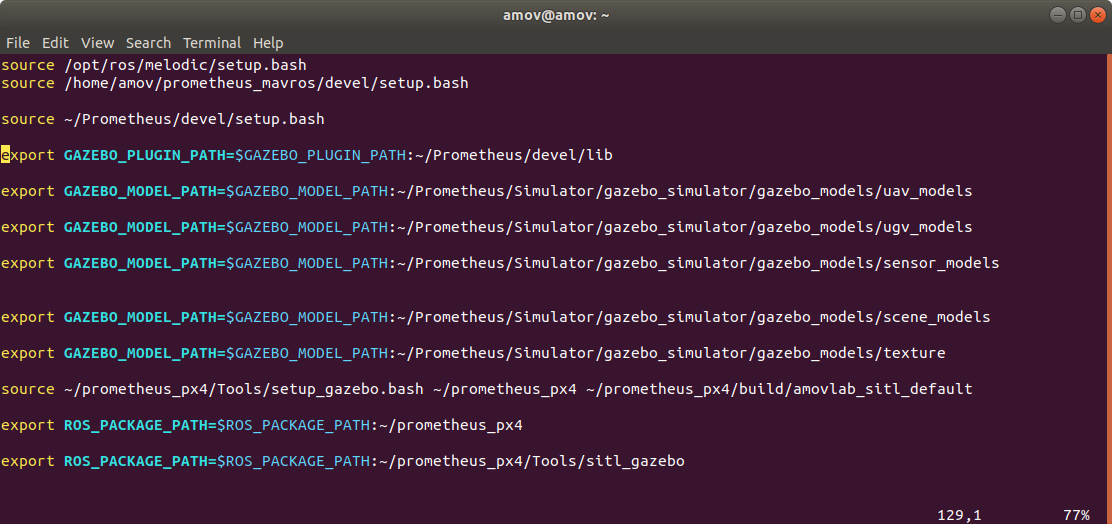

环境变量配置

打开终端输入以下命令打开

.bashrc文件。sudo gedit ~/.bashrc将以下内容复制到

.bashrc文件中后保存退出,如果.bashrc已有相关内容,则无需重复添加。提示

其中{your prometheus path}为Prometheus项目路径,{your px4 path}为安装prometheus_px4固件的路径。

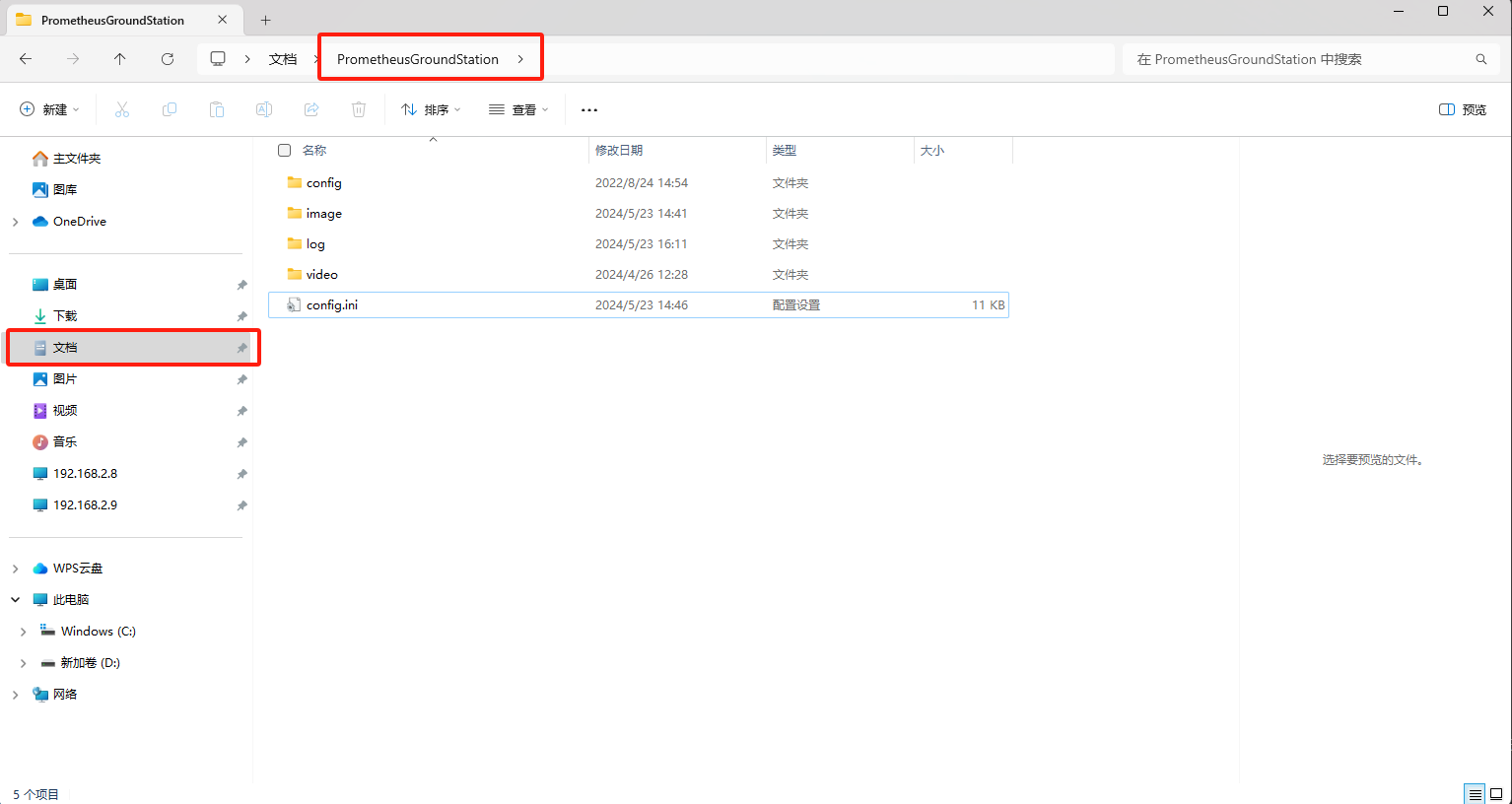

source {your prometheus path}/Prometheus/devel/setup.bash export GAZEBO_PLUGIN_PATH=$GAZEBO_PLUGIN_PATH:{your prometheus path}/Prometheus/devel/lib export GAZEBO_MODEL_PATH=$GAZEBO_MODEL_PATH:{your prometheus path}/Prometheus/Simulator/gazebo_simulator/gazebo_models/uav_models export GAZEBO_MODEL_PATH=$GAZEBO_MODEL_PATH:{your prometheus path}/Prometheus/Simulator/gazebo_simulator/gazebo_models/ugv_models export GAZEBO_MODEL_PATH=$GAZEBO_MODEL_PATH:{your prometheus path}/Prometheus/Simulator/gazebo_simulator/gazebo_models/sensor_models export GAZEBO_MODEL_PATH=$GAZEBO_MODEL_PATH:{your prometheus path}/Prometheus/Simulator/gazebo_simulator/gazebo_models/scene_models export GAZEBO_MODEL_PATH=$GAZEBO_MODEL_PATH:{your prometheus path}/Prometheus/Simulator/gazebo_simulator/gazebo_models/texture source {your px4 path}/prometheus_px4/Tools/setup_gazebo.bash {your px4 path}/prometheus_px4 {your px4 path}/prometheus_px4/build/amovlab_sitl_default export ROS_PACKAGE_PATH=$ROS_PACKAGE_PATH:{your px4 path}/prometheus_px4 export ROS_PACKAGE_PATH=$ROS_PACKAGE_PATH:{your px4 path}/prometheus_px4/Tools/sitl_gazebo以下图为例,

Prometheus安装在/home文件夹下,可用~代表。~/Prometheus与/home/amov/Prometheus等效。示例中的amov为用户名,如果使用/home/{user}/Prometheus这种形式的需要将用户名更改。

Prometheus仿真环境配置:Prometheus镜像

提示

Prometheus镜像支持在虚拟机上安装使用 ,但若是想在双系统上安装Prometheus镜像,需注意必须使用Rufus 3.19以上版本软件去制作系统启动盘。另外,在双系统下安装Prometheus镜像兼容性较差,不太容易成功。

Prometheus镜像系统基于Ubuntu18.04操作系统,大小约10个G,镜像系统已提前安装并配置好Prometheus、prometheus_mavros以及prometheus_px4以及相关依赖环境,可以直接上手使用Prometheus。

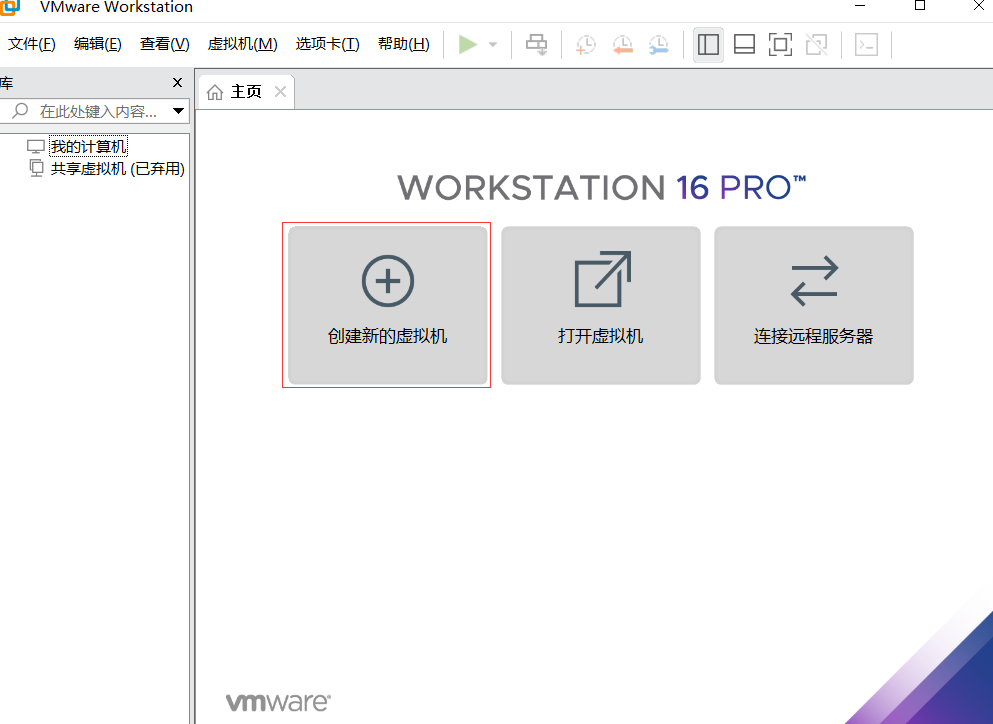

虚拟机安装Prometheus镜像

安装准备

注意

这里提供的Prometheus镜像只是为了方便用户安装,安装后并不是就可以直接上手使用Prometheus,用户需要按照wiki中操作配置Prometheus

如果用户不想要配置或者时间紧急需要快速上手Prometheus仿真,阿木实验室提供仿真套件供用户购买,到手即用,包含仿真遥控器

提供的下载链接为百度网盘方式,提取码为

amov注意

此处提到的Prometheus镜像系统为Prometheus-v2版本(指2022年7月15日发布的新版Prometheus),此前的Prometheus-v1版本镜像请点击下方链接进行下载

提供的下载链接为百度网盘方式,提取码为

amov安装步骤

首先,创建一个新的虚拟机。

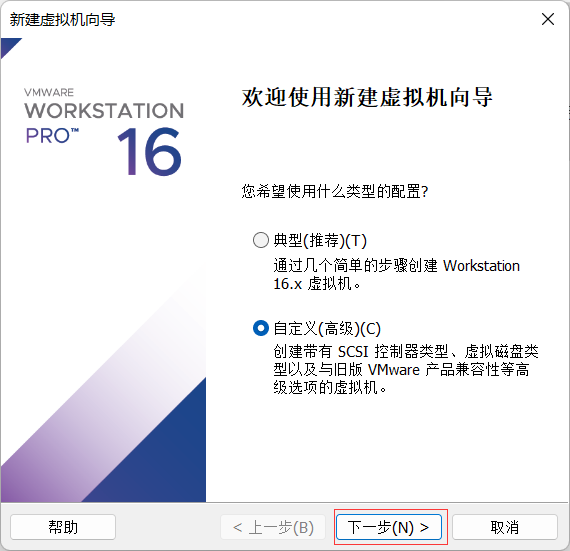

选择自定义安装,点击下一步。

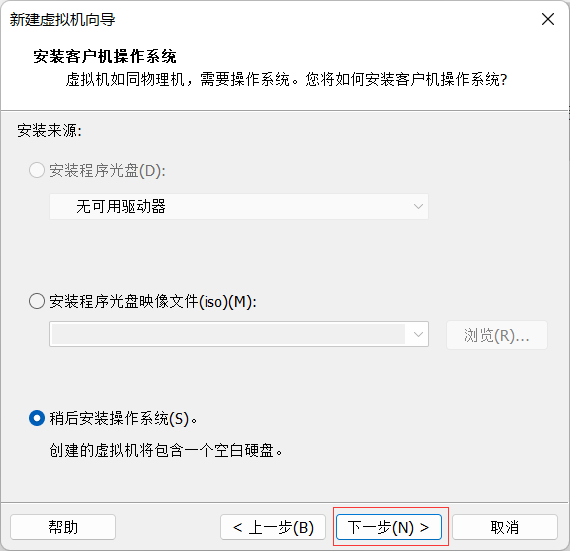

选择稍后安装操作系统,继续下一步。

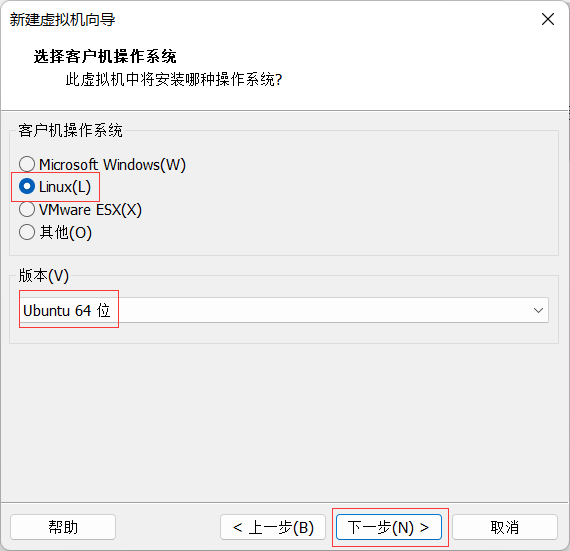

选择Linux操作系统,版本为Ubuntu64位。

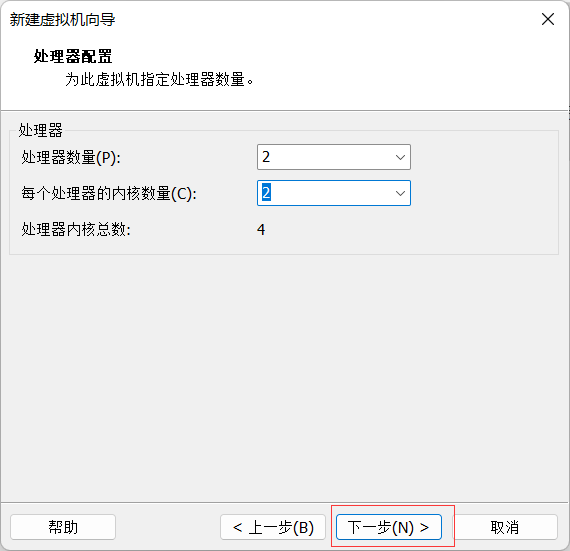

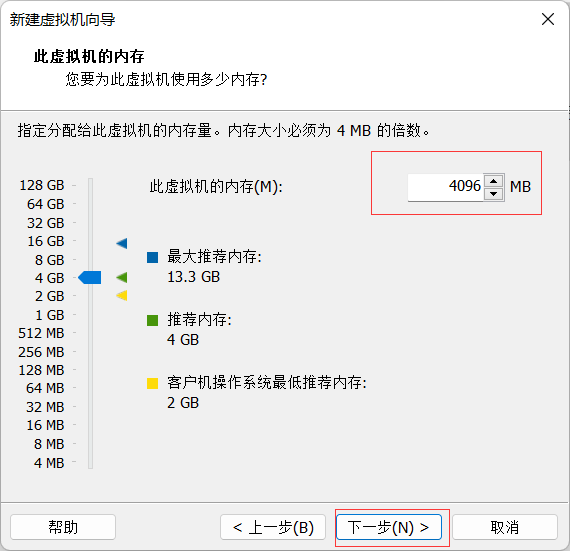

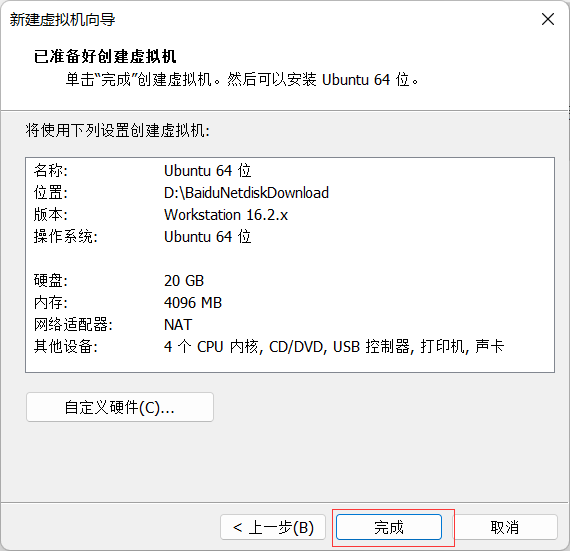

根据电脑配置和需求选择合适的虚拟机处理器配置和内存大小。

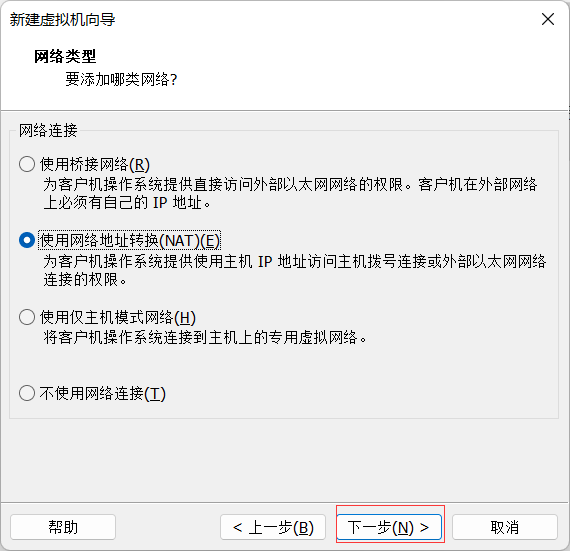

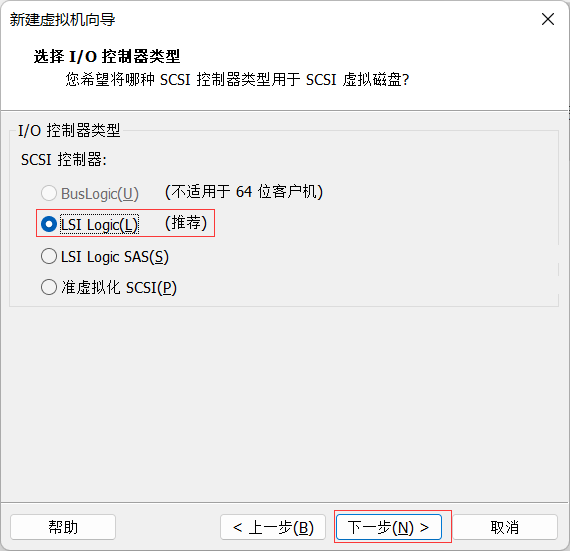

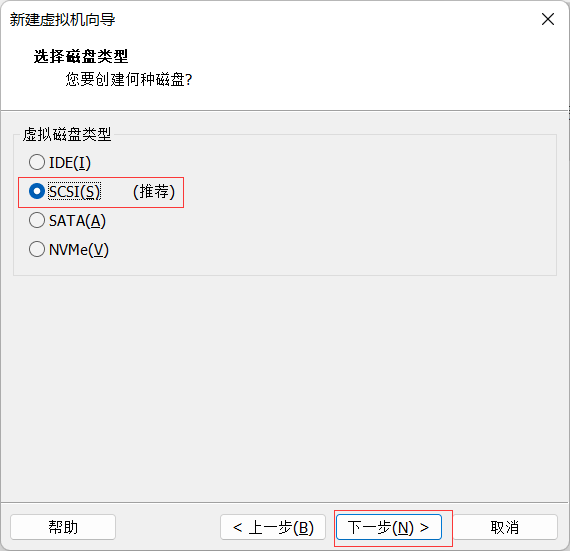

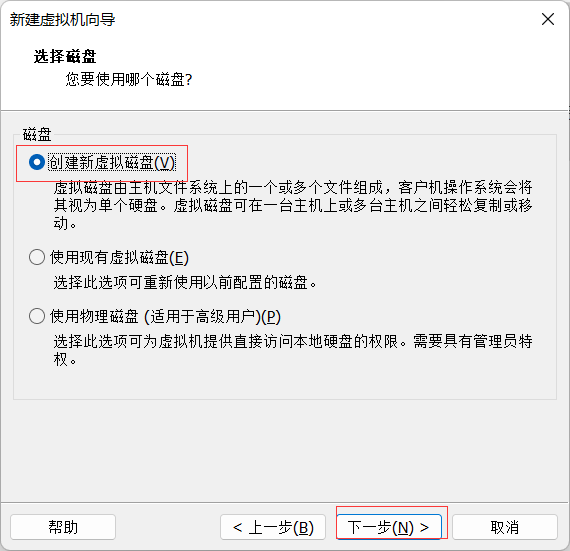

接下来按照引导推荐选择即可。

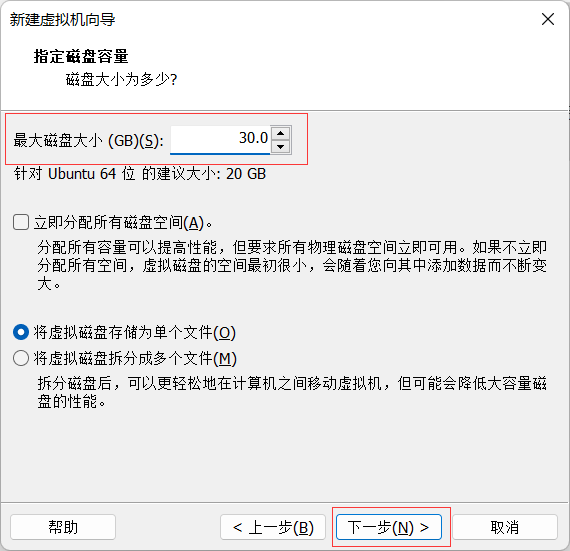

根据需求选择合适的磁盘大小,至少大于30G空间,推荐60G空间以上,其余根据引导推荐完成安装。

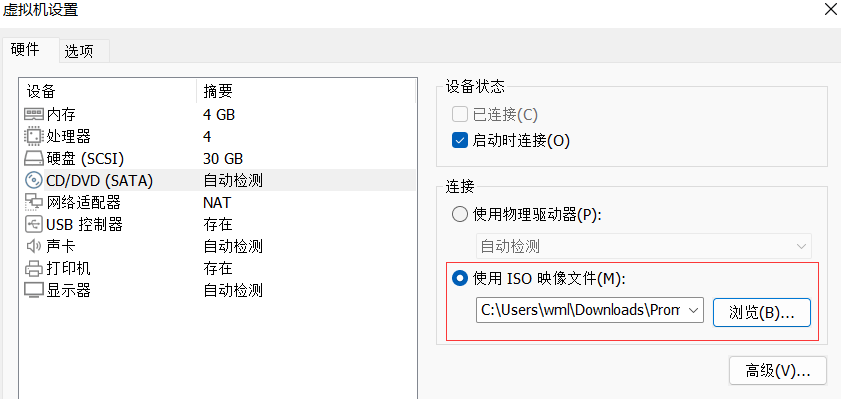

创建虚拟机之后,在虚拟机设置中选择使用Prometheus镜像,然后点击运行虚拟机。

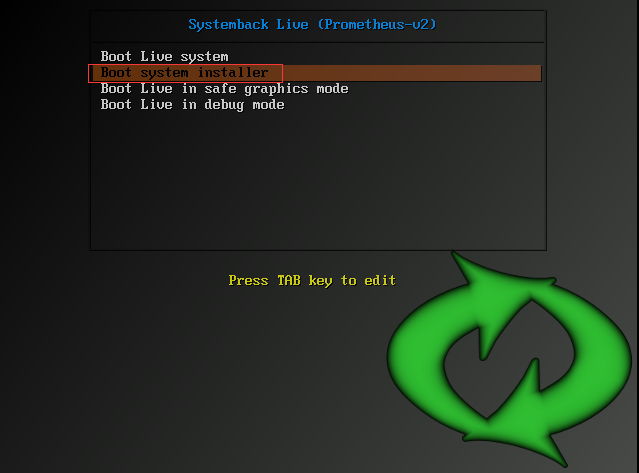

选择

Boot system installer,按下回车。

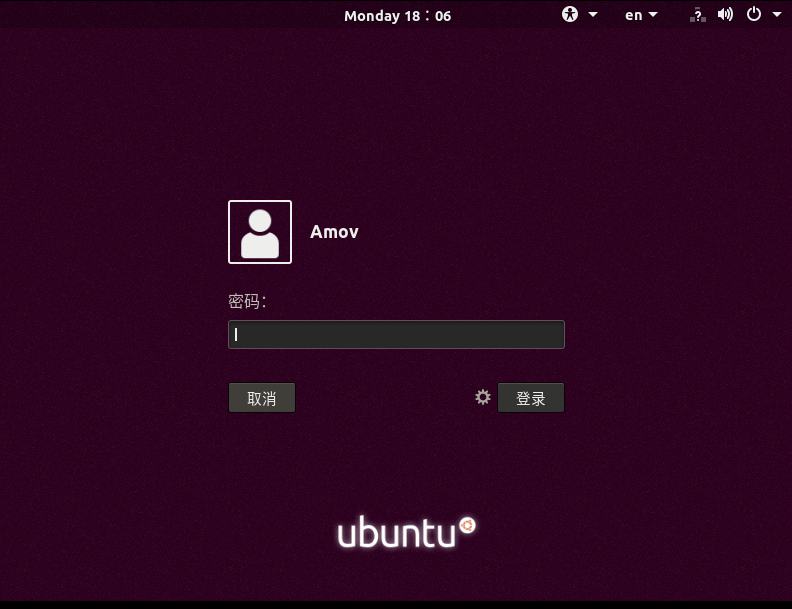

进入登录界面,输入密码 amov,即可进入Prometheus镜像系统开始安装。

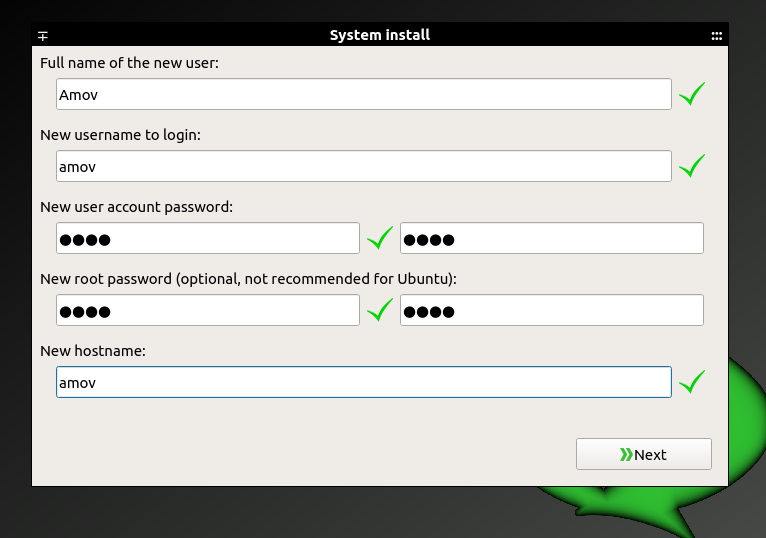

开始安装镜像系统,配置用户名和密码。

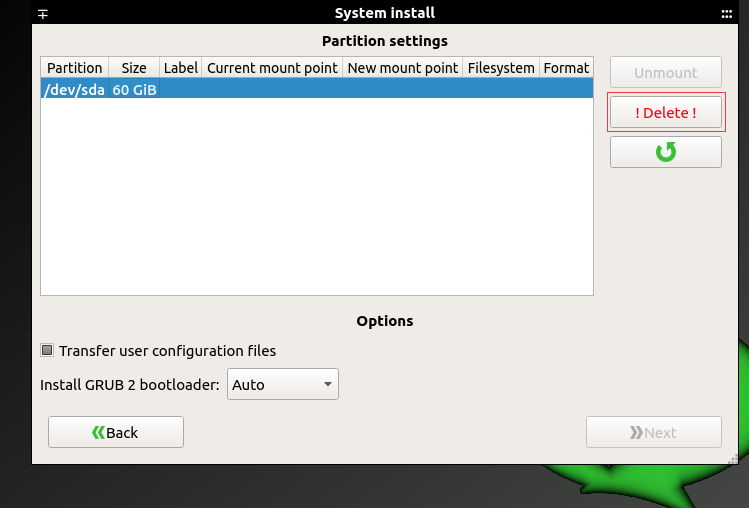

选择之前创建的虚拟磁盘分区,点击delete。

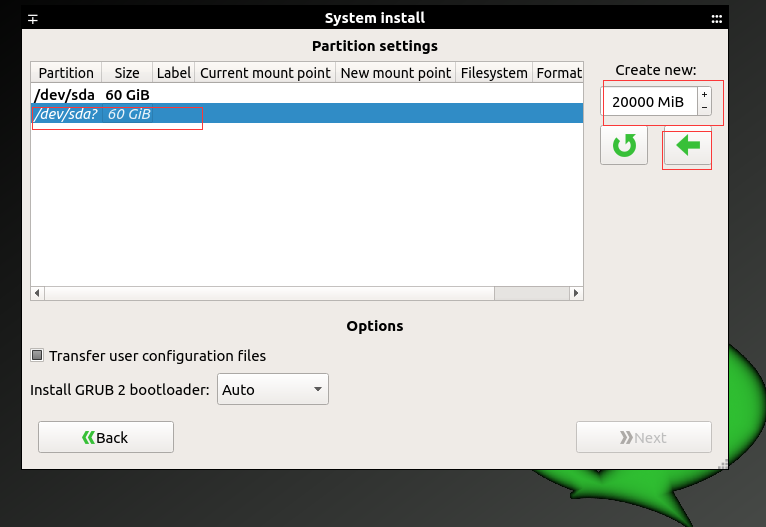

选中虚拟磁盘分区,再选择生成的新磁盘大小,再点击右边的绿色箭头分配。

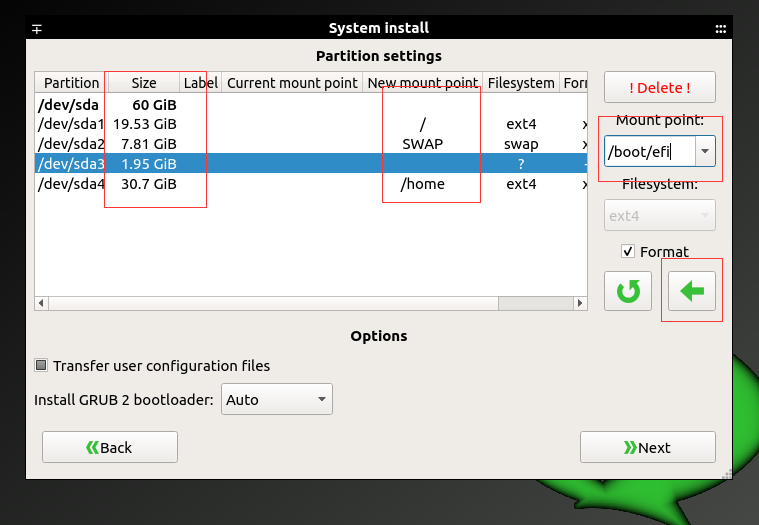

将生成的四个新虚拟磁盘分别设置为 “/” , “/home" , "/SWAp" , "/boot/efi"。

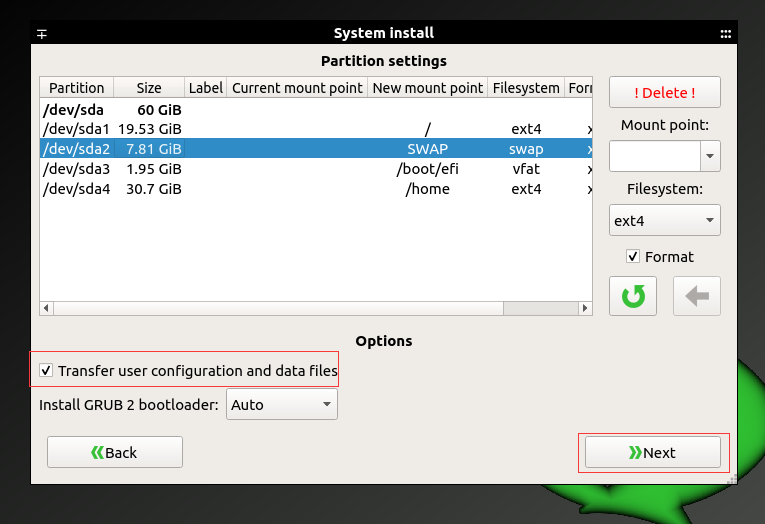

注意要勾选传递用户配置文件,如何点击next。

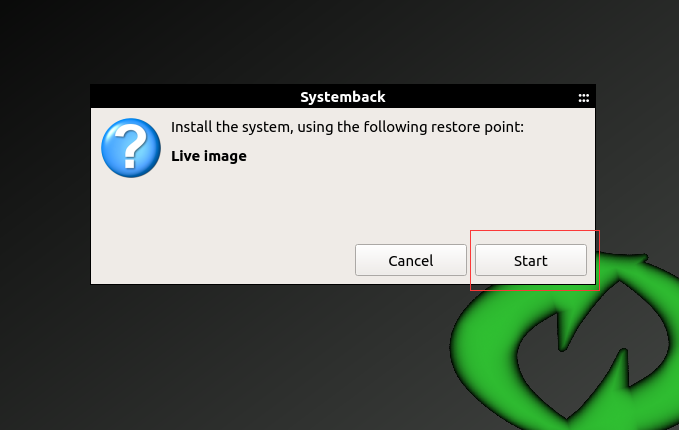

点击start后,耐心等待镜像安装完成。

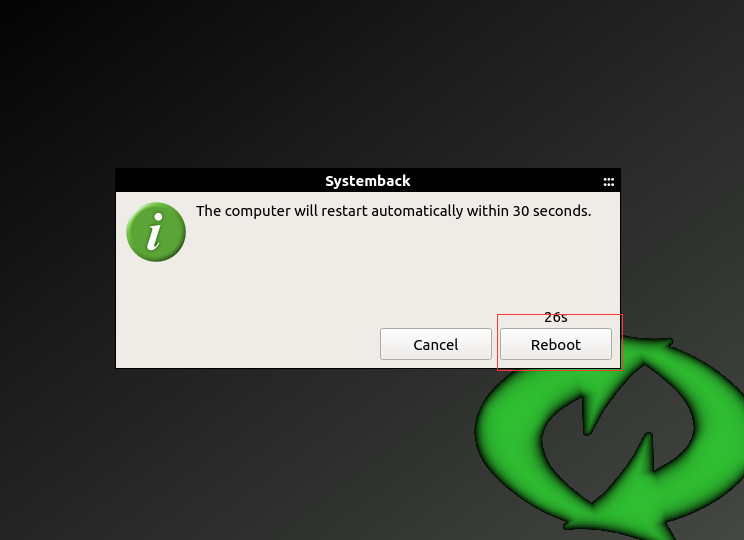

安装完成点击reboot重启后即可使用Prometheus镜像系统。

Prometheus配置常见问题处理

更新子模块遇到报错

尝试输入以下命令解决。

make distclean git submodule update --init --recursivearm-none-eabi-gcc安装失败或者版本不对

一定要使用prometheus_px4/Tools/setup目录下的ubuntu.sh进行安装,如果使用PX4官方master分支下的对应文件则会安装高级版本的arm-none-eabi-gcc,会使得编译prometheus_px4出错,可通过下面的命令查看查看arm-none-eabi-gcc版本。

arm-none-eabi-gcc --versionprometheus_px4对应的版本是gcc version 9-2020-q2-update(其他版本gcc可能也支持,只要能顺利编译固件即可),如果之前已经安装过最新的arm-none-eabi-gcc,请重新运行ubuntu.sh文件后,重启电脑。

安装失败一般是由于网络原因导致,在运行ubuntu.sh文件时,请耐心查看安装记录,下载arm-none-eabi-gcc有时会因为网络原因而自动放弃下载,此时,也只需要反复运行ubuntu.sh文件直至安装成功。

缺少gstreamer依赖

输入以下命令安装相关依赖。

sudo apt-get install libgstreamer1.0-0 gstreamer1.0-plugins-base gstreamer1.0-plugins-good gstreamer1.0-plugins-bad gstreamer1.0-plugins-ugly gstreamer1.0-libav gstreamer1.0-doc gstreamer1.0-tools gstreamer1.0-x gstreamer1.0-alsa gstreamer1.0-gl gstreamer1.0-gtk3 gstreamer1.0-qt5 gstreamer1.0-pulseaudio编译prometheus_px4时提示"Failed to import numpy: No module named 'numpy' "

输入以下命令安装numpy。

pip3 install --user numpyprometheus_mavros安装时出现rosdep update 错误

# 需要科学上网 rosdep updatePrometheus仿真入门

本章将为大家介绍Prometheus仿真涉及的基础内容。

在本章内容中,会首先介绍一些常用开发工具的安装,这些工具能帮助大家更好地进行开发,能够提升开发效率,大家可以从中找出比较适合自己的工具下载即可。

接下来会介绍PX4-Gazebo的仿真原理,能够让大家快速了解掌握仿真各模块的框架,也能了解到Prometheus、PX4、Gazebo中各个功能模块的关系,强烈建议大家熟悉这一块内容,当掌握了仿真框架,再去了解真机相关内容后,基本上就能够明白如何将仿真代码移植到真机中。

然后是Prometheus代码框架及功能汇总,介绍Prometheus项目的代码框架、消息文件以及功能汇总。

最后是仿真中的遥控器说明,这一块将详细介绍Prometheus仿真中遥控器操作相关内容,这一节内容较为重要,需要完全掌握全部内容。

常用开发工具的安装

VSCode

VSCode(全称:Visual Studio Code)是一款由微软开发且跨平台的免费源代码编辑器。该软件支持语法高亮、代码自动补全(又称 IntelliSense)、代码重构、查看定义功能,并且内置了命令行工具和 Git 版本控制系统。用户可以更改主题和键盘快捷方式实现个性化设置,也可以通过内置的扩展程序商店安装扩展以拓展软件功能。

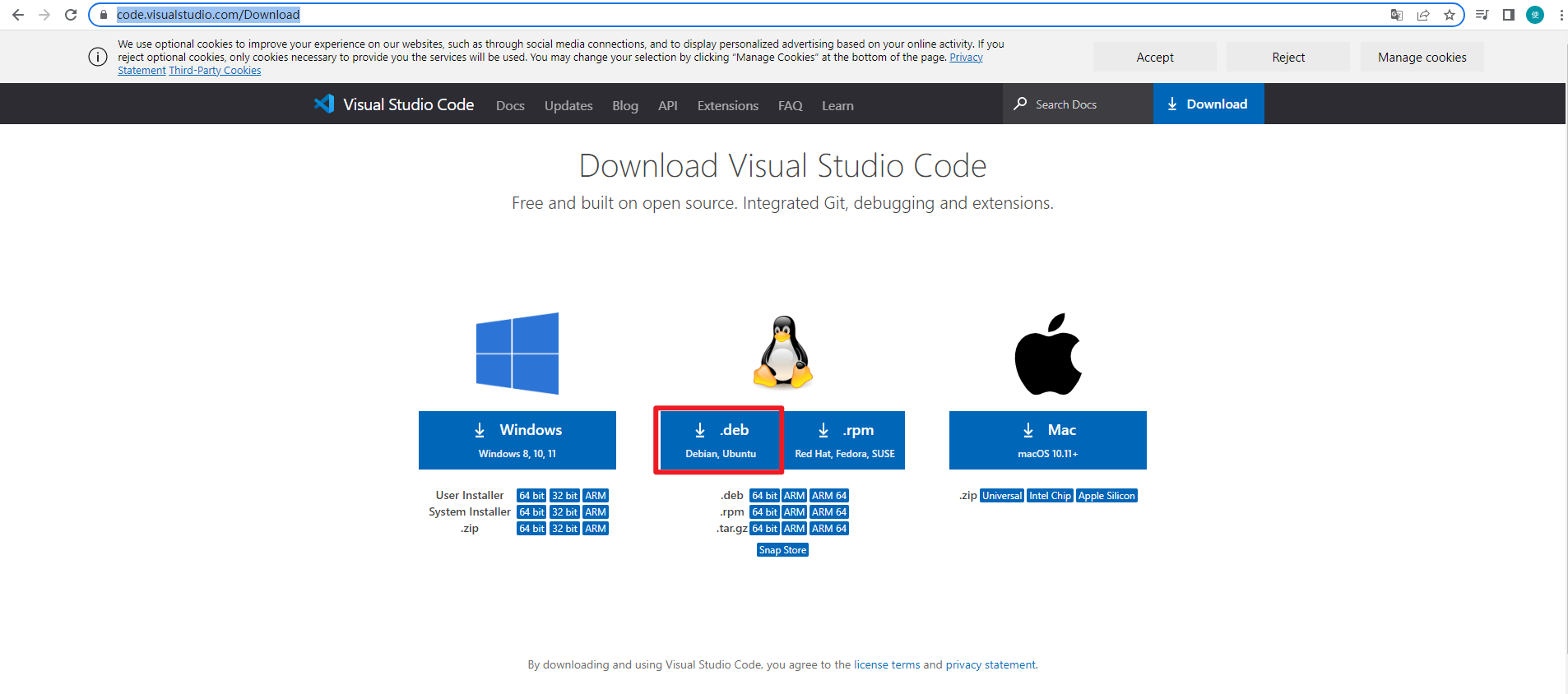

打开VSCode下载地址后将出现以下界面,点击

.deb下载方式。

一般情况下默认下载在Downloads文件夹下,输入以下命令进行安装。

cd ~/Downloads sudo dpkg -i ***.debNoMachine

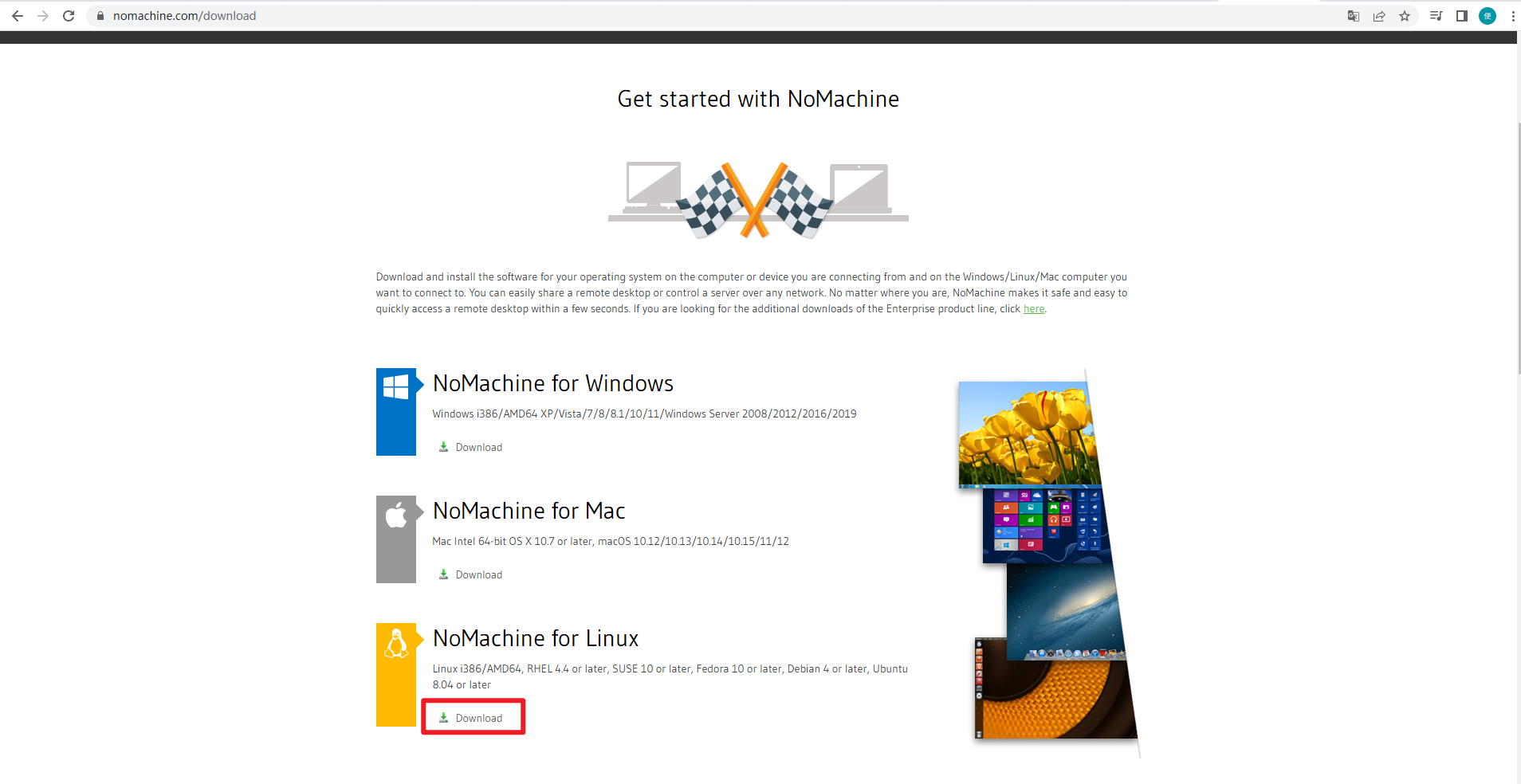

NoMachine是一款远程桌面工具,在高延迟低带宽的通信链路上也有较好地表现。

建议大家使用

.deb下载方式,下载完后安装命令与VSCode安装方式一致。QGroudControl

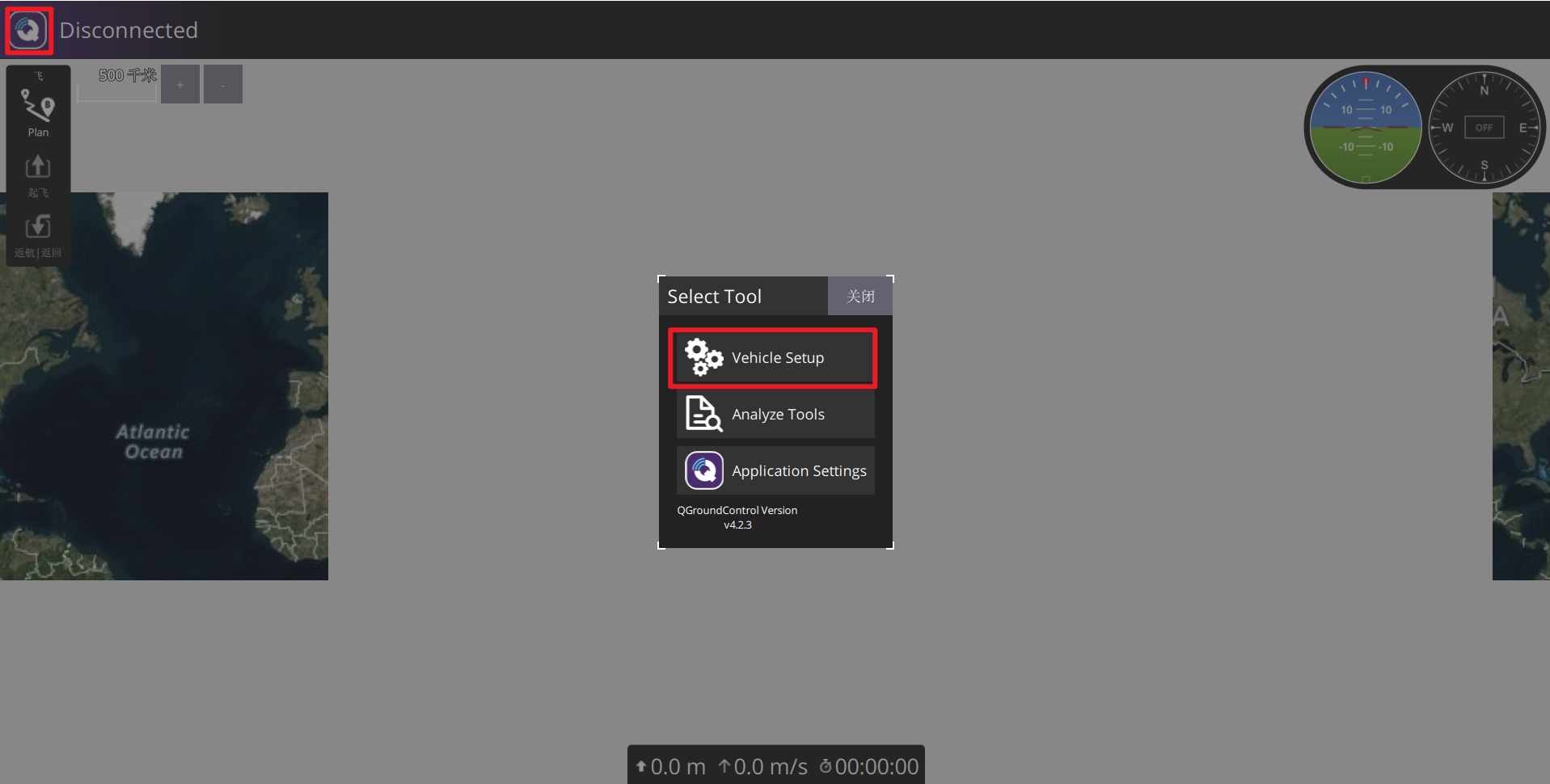

QGroundControl简称QGC,是一款与PX4飞控通信连接进行交互的地面站软件,官方网站对于下载安装的说明已经非常完善了,此处不再过多讲解,大家参考官网即可完成下载安装。

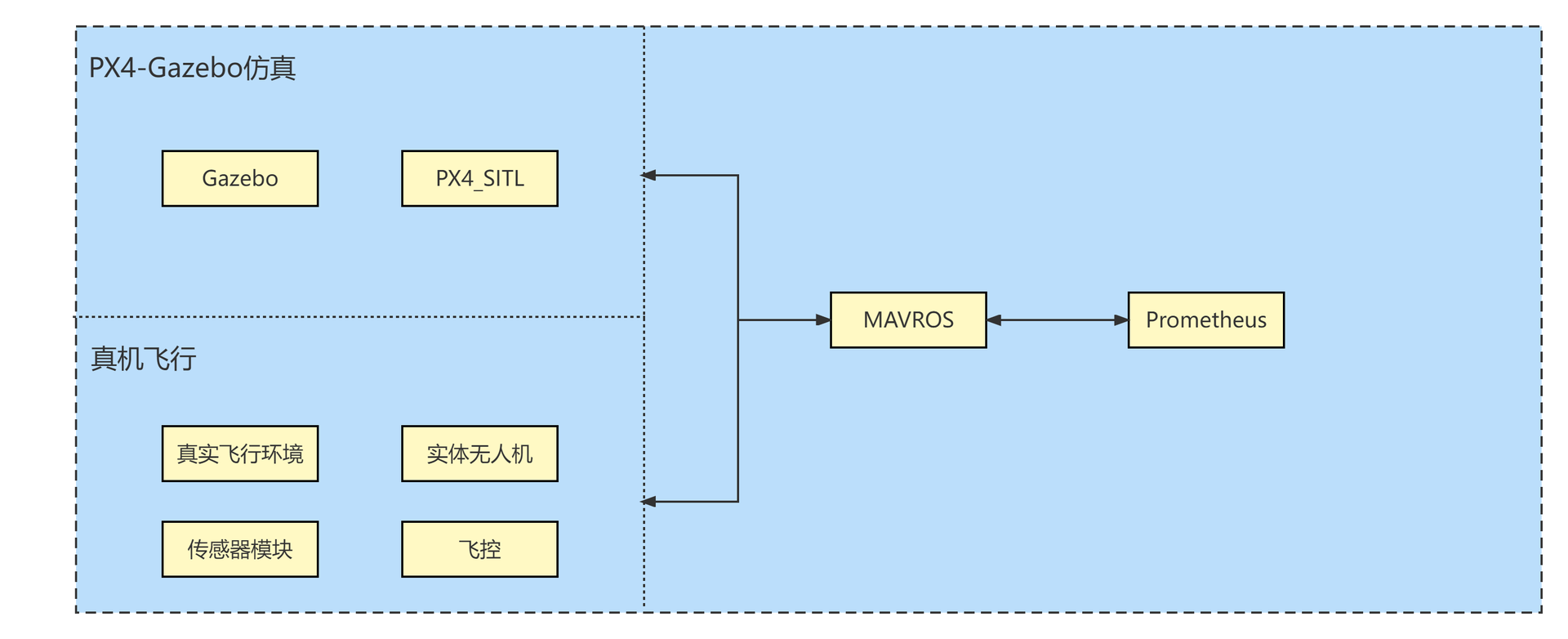

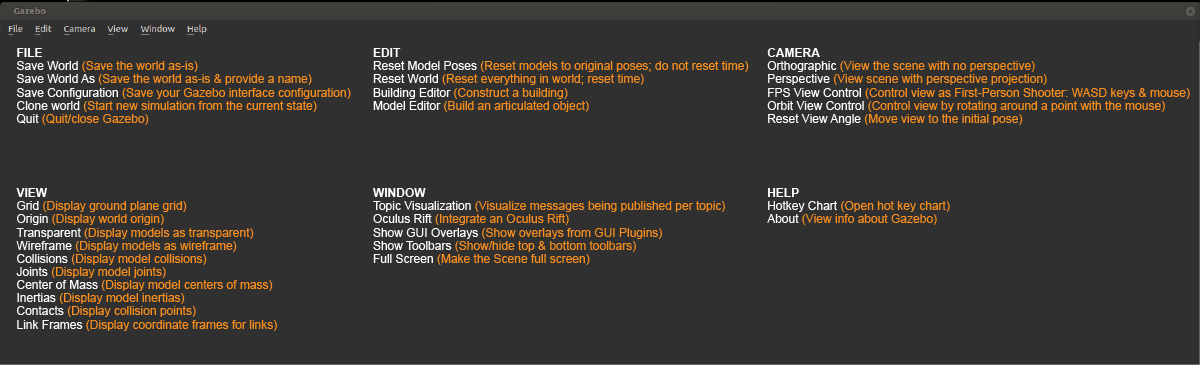

PX4-Gazebo仿真说明

在介绍PX4-Gazebo仿真之前,我们先介绍一下基于PX4的旋翼无人机系统

首先,先了解一下上面这幅PX4无人机框架图,可以看到PX4旋翼无人机包含机架、电机、旋翼、飞控(飞行控制板)、脚架等必需模块,这是无人机实现飞行移动的基础。

其次还包含图传、数传、GPS、激光雷达、视觉传感器等模块,这一块非必需模块和无人机应用场景相关,根据不同的场景会搭载其余模块。

其中,我们需要清楚地认识到真实无人机能够实现飞行功能就必须要有上面所说的必需模块以及配套的软件系统。

而在仿真当中,我们并不需要这些硬件模块,但是我们需要通过软件来模拟这些硬件模块的数据交互。

其中Gazebo为我们提供了一个物理环境的模拟系统,例如无人机以及飞行环境的可视化、物理属性、碰撞属性等。

而PX4完成了对无人机物理模型以及运动控制模型的搭建、运动控制插件、飞行控制系统等内容。

基于PX4-Gazebo的仿真系统能够完全实现无人机飞行控制的全部功能,除了性能,其余方面与真机表现并无差异.可以简单理解为Gazebo提供无人机硬件仿真,而PX4提供飞控仿真,当然无人机硬件仿真也是由PX4项目组完成,Gazebo仅仅是提供一个物理仿真平台。

关于PX4-Gazebo仿真更多的内容可参考PX4-Gazebo官网介绍

Prometheus代码框架及功能汇总

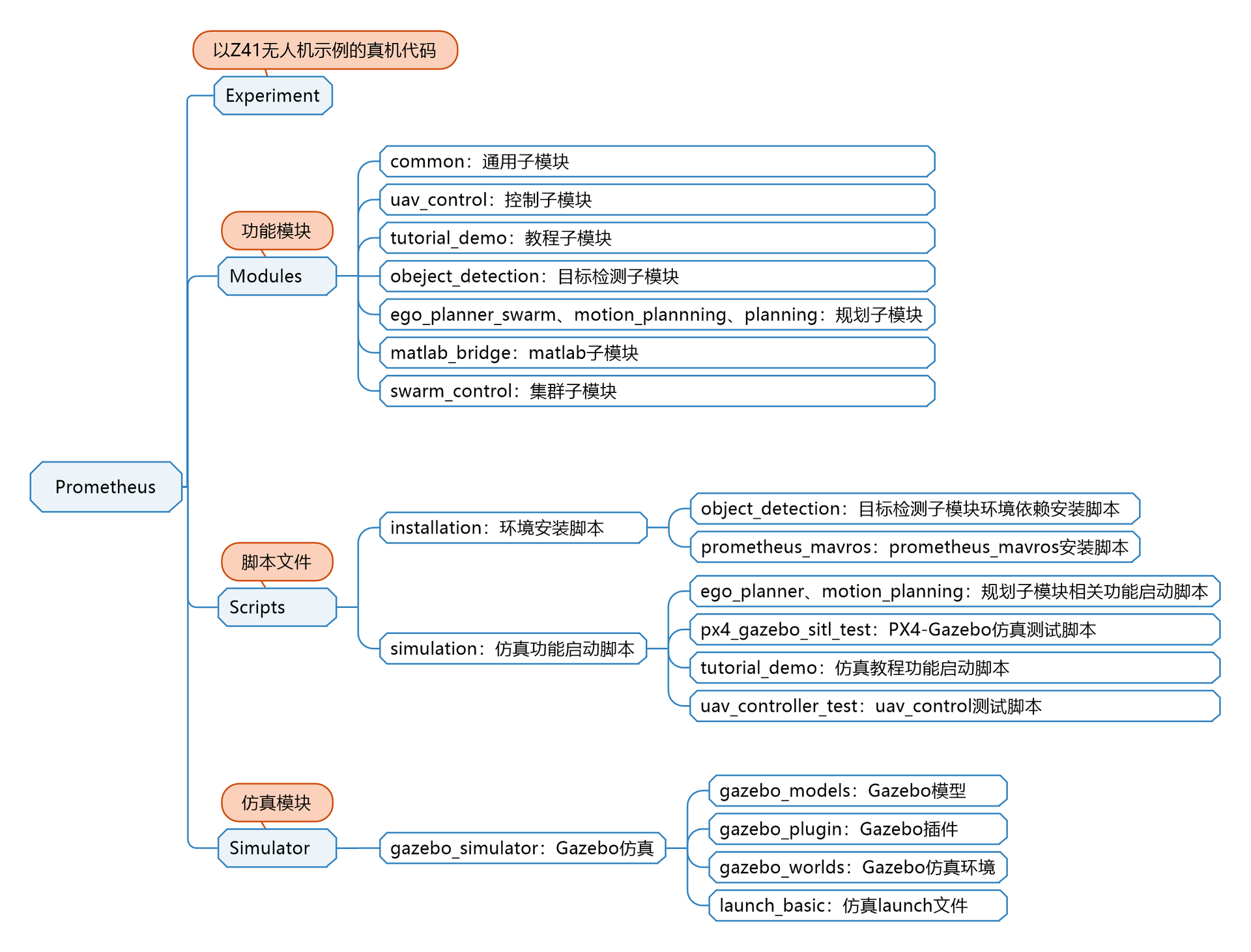

Prometheus代码框架图

提示

Prometheus代码框架图仅展示主要内容,并未包含所有文件。

Prometheus代码框架主要包含Experiment、Scripts、Simulator、Modules四个模块:

Experiment

与阿木实验室Z410无人机配套的真机代码,其余安装有Prometheus项目的无人机也可以通过该模块内容适配Prometheus项目,但可能需要修改部分参数,详情请查看Prometheus真机教程。

Modules

Modules作为Prometheus项目最重要的组成部分,包含各个功能子模块的全部源代码,主要包括通用子模块、控制子模块、教程子模块、目标检测子模块、规划子模块等功能源代码。

Scripts

Scripts下有

installation和simulation两大部分,其中installation包含目标检测子模块环境安装脚本以及prometheus_mavros安装脚本,simulation包含各仿真功能启动脚本以及测试脚本。Simulator

提供基于PX4-Gazebo的Prometheus仿真代码,包含无人机、传感器、二维码以及环境等相关模型,控制插件以及仿真launch文件等。

Prometheus_msgs说明

ArucoInfo: Aruco二维码的信息, 标定相机后可估计二维码的位姿

MultiArucoInfo: ArucoInfo的数组形式

BoundingBox: 表示目标检测的分类,边框坐标,置信度

BoundingBoxes: BoundingBox的数组形式

DetectionInfo: 目标检测反馈信息,包含对目标、类别、位姿估计

MultiDetectionInfo: DetectionInfo的数组形式

FormationAssign: 集群队形位置分配

GPSData: GPS经纬度以及海拔高度

MultiUAVState: 多架无人机状态

OffsetPose: 无人机ENU坐标系下的定位数据位置偏移量

SwarmCommand: 集群控制指令,包含位置控制、控制模式设置、队形变换设置、队形间距设置等.

TextInfo: 无人机向地面站反馈文本消息

UAVCommand: 无人机控制指令,包含控制命令设置、惯性系、机体系、轨迹、姿态、经纬度、位置、速度、加速度等多种控制模式

UAVControlState: 无人机控制状态

UAVSetup: 无人机设置,包含解上锁、设置px4飞行模式、设置控制模式、重启飞控

UAVState: 无人机状态,包含飞行模式、连接状态、定位来源、gps状态、位置、速度、姿态等信息

Prometheus项目功能模块组成

uav_control:Prometheus项目中的基础模块,负责其余上层功能模块与底层MAVROS进行数据交互的接口

gazebo_simulator:仿真模块,包含室内外无人机仿真模型、仿真环境、Gazebo插件以及仿真启动的launch文件等内容

turtorial_demo: 示例模块,包含Prometheus项目绝大部分功能模块的基础教程源代码以及相应的启动lauch文件

planning: 路径规划模块

object_detection:视觉检测模块

swarm_control:集群控制模块

matlab_bridge:matlab子模块

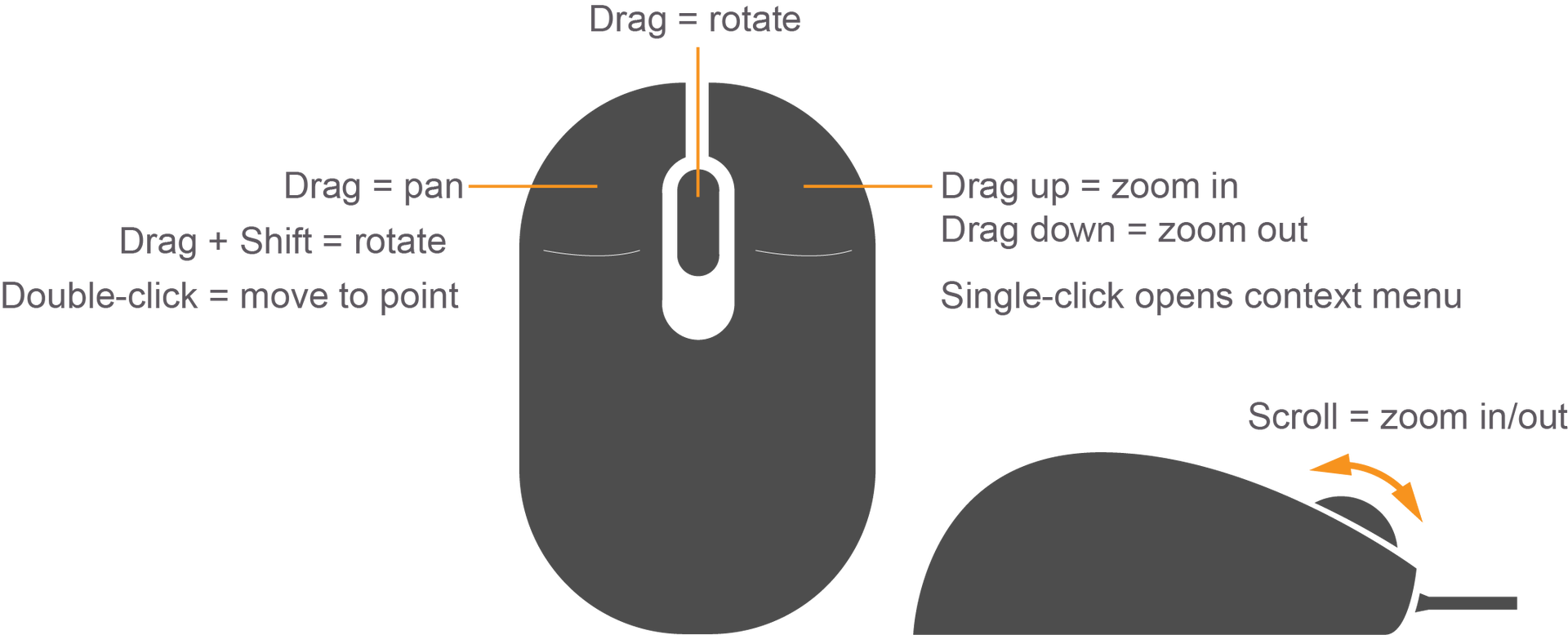

仿真中的遥控器使用说明

在真实飞行过程中,我们使用真实的遥控器作为控制无人机的主要操作来源,遥控器始终拥有最高的权限,精湛的遥控器操作手法可以保证无人机安稳着陆,但对于很多非专业来说,遥控的操作技巧是需要不断的练习的。我们始终强调一个观念,仿真与实机结合,这样更加符合开发流程,在以往的仿真中,我们通过键盘控制无人机飞行,并不能真实的反应出实机飞行时该怎么操作,也是基于现在存在的种种问题,为了让仿真与实机结合的更加完美,在Prometheus中增加遥控器控制方式,与真机使用更加对应起来,更加容易上手进行二次开发。

遥控器通道和方向

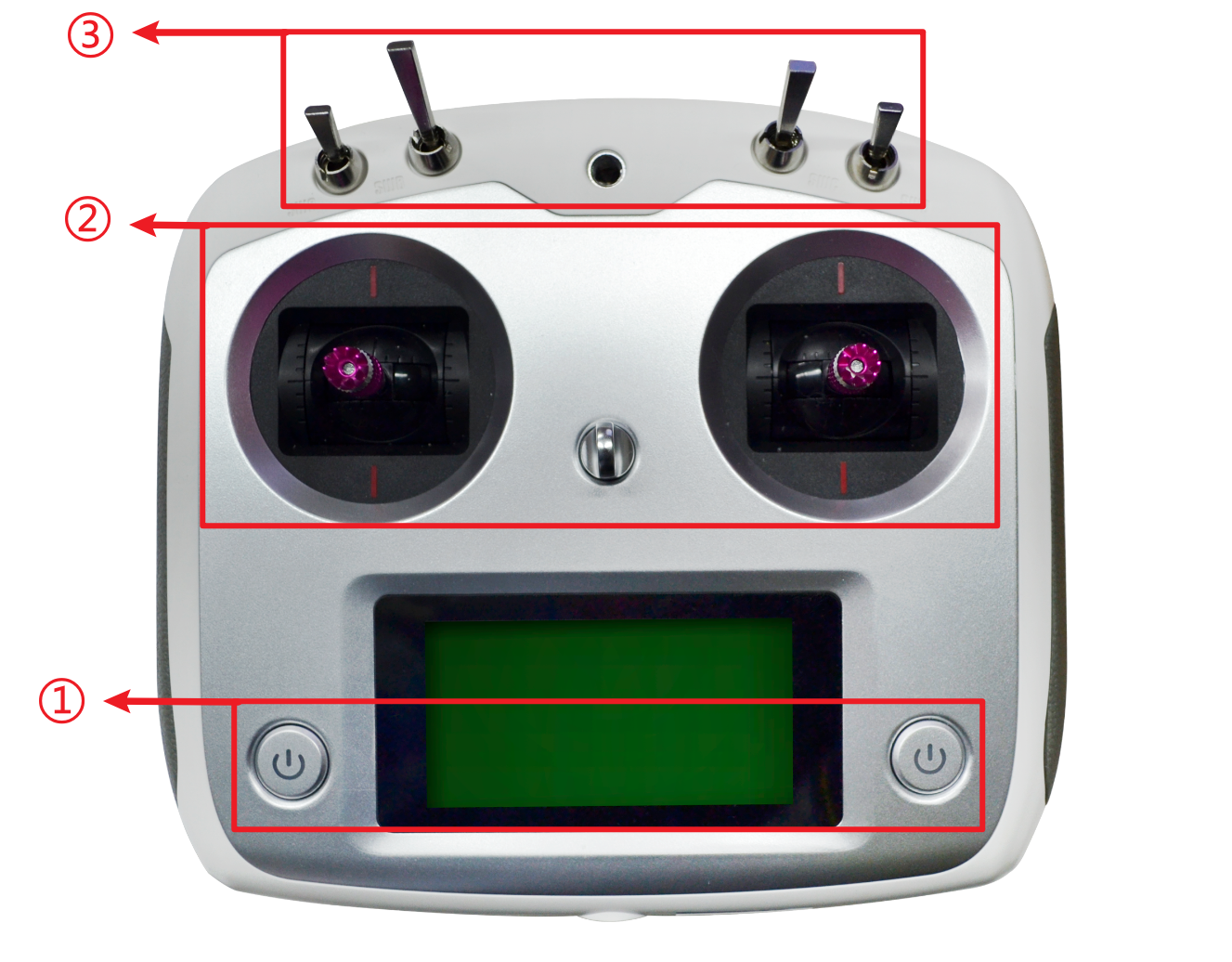

- 开关机按钮,开关机需要同时按下两个按钮,开机时需要所有档杆开关打至最上端

- 摇杆

- 档杆开关,从左到右依次为SWA、SWB、SWC、SWD

遥控器 通道 含义 右摇杆(左右) 通道1 滚转(向左推,无人机向左移动) 右摇杆(上下) 通道2 俯仰(向上推,无人机向前飞) 左摇杆(上下) 通道3 油门(向上推,无人机向上飞) 左摇杆(左右) 通道4 偏航(向左推,无人机向左转弯) SWA(两段开关) 通道5 解锁/上锁开关 SWB(三段开关) 通道6 Prometheus控制模式切换,分别对应INIT-RC_POS_CONTROL-COMMAND_CONTROL SWC(三段开关) 通道7 KILL开关,也可以留作用户自定义 SWD(两段开关) 通道8 Prometheus中的LAND模式 仿真电脑和遥控器连接

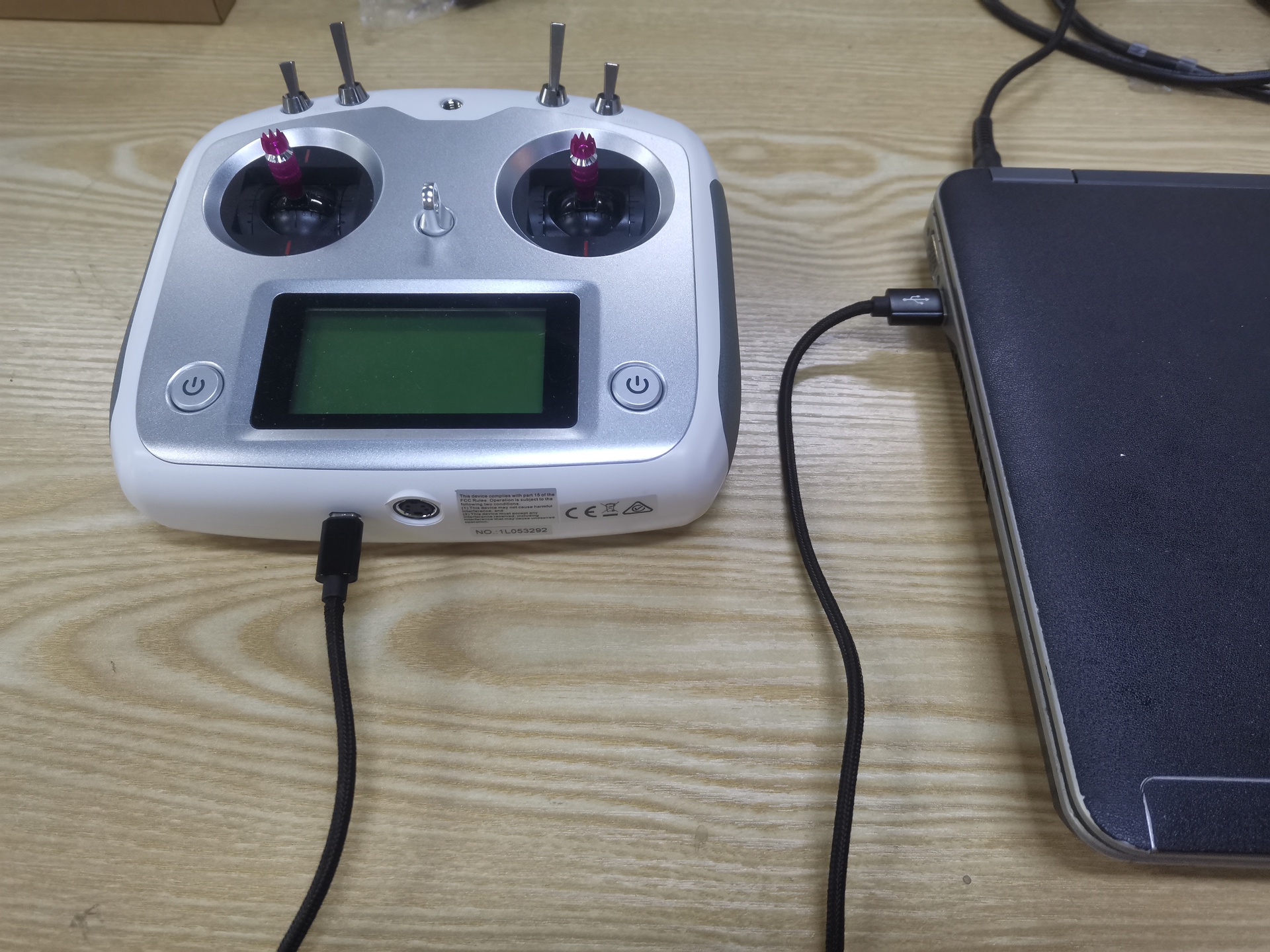

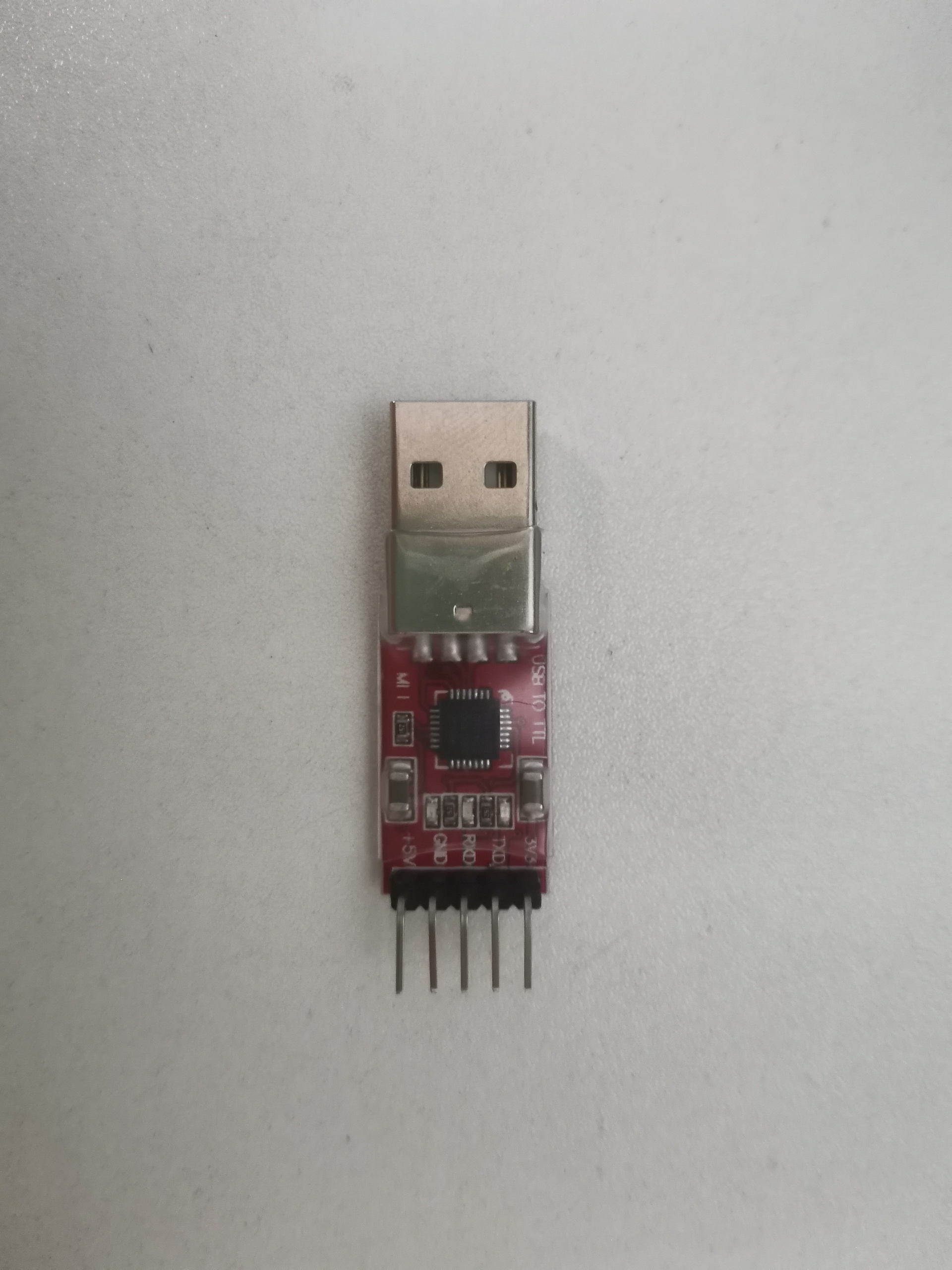

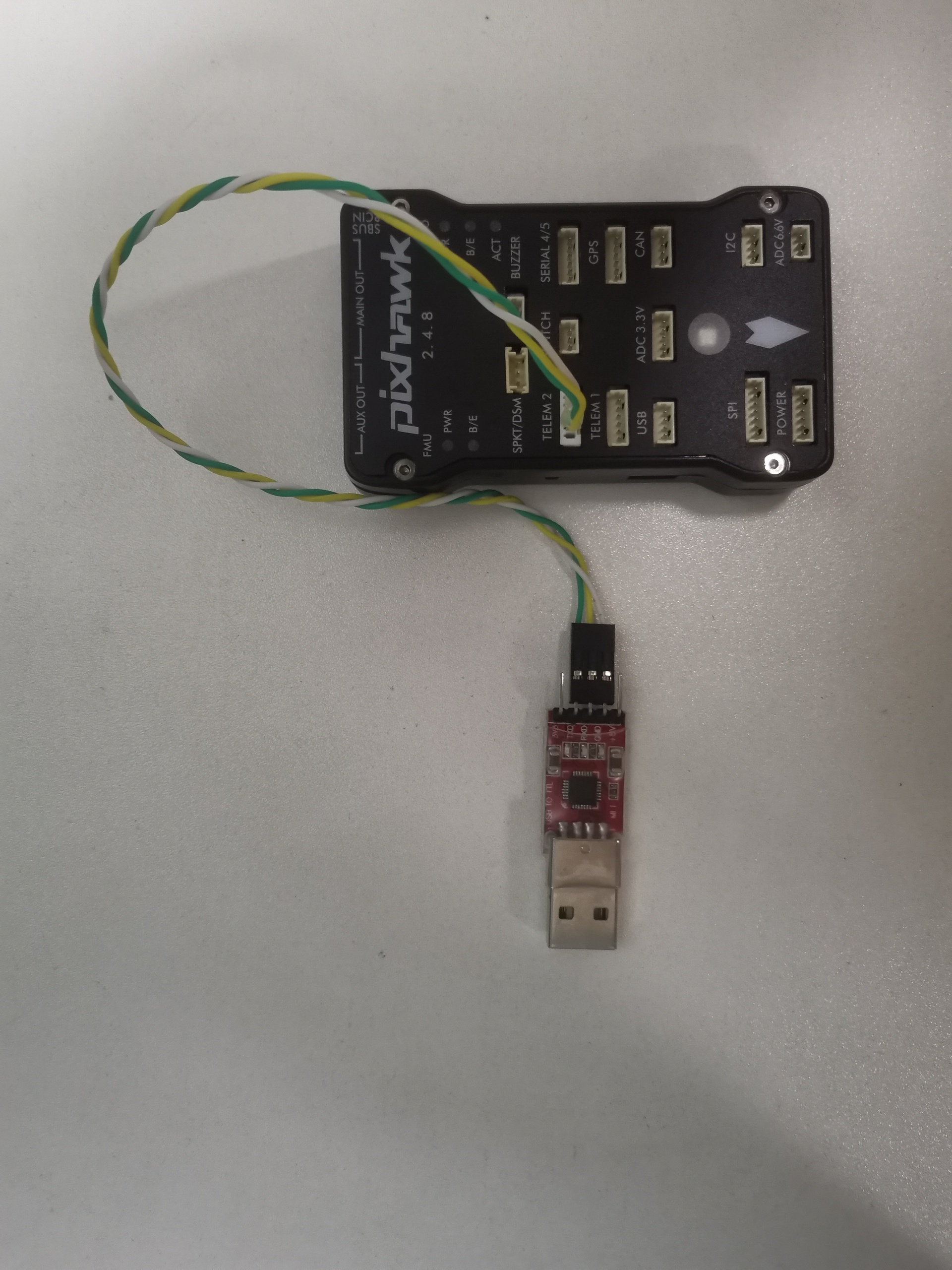

仿真电脑和遥控器通过Micro USB数据线连接

Micro USB数据线

仿真电脑与遥控器连接图

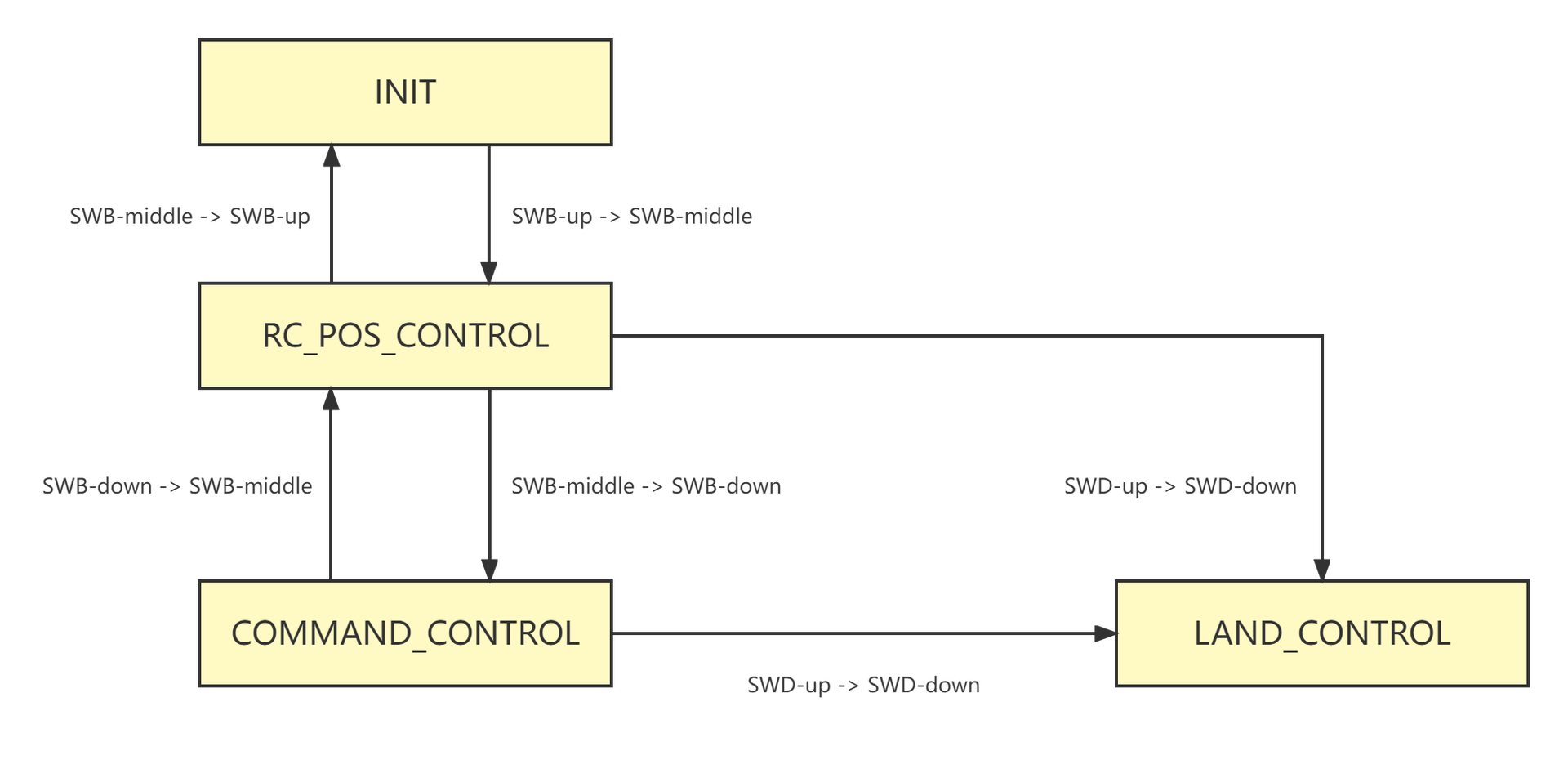

Prometheus控制模式包含四种,分别是

INIT、RC_POS_CONTROL、COMMAND_CONTROL、LAND_CONTROL下图为无人机运行时的控制状态机图

无人机各种情况下的操作说明

无人机档杆情况说明

SWA/SWC/SWD档杆都属于触发型,而SWB档杆属于维持型,SWA档杆执行解上锁操作,触发解锁操作需要从上往下拨这个动作,而不是SWA档杆处于底部,而SWB切换到某一模式,是因为档杆处于那个位置,而不是拨的动作。

无人机未解锁时

1.仅能通过SWA档杆进行解锁上锁操作,SWB档杆无法切换控制模式,SWD无法切换到降落模式。

2.将SWB档杆拨到中间位置时,无人机解锁后会直接进入RC_POS_CONTROL,而直接拨到底部位置时,无人机解锁后无法进入COMMAND_CONTROL,因为需要先进入RC_POS_CONTROL才能切入到COMMAND_CONTROL模式。

无人机解锁并处于INIT(PX4处于Position模式)模式时

1.处于地面时可执行上锁操作。

2.可使用摇杆控制无人机移动。

3.可切入RC_POS_CONTROL模式。

4.无法切入LAND_CONTROL模式(需要在RC_POS_CONTROL或LAND_CONTROL模式下)。

5.无法直接切入COMMAND_CONTROL模式(档杆以及软件都需要先进入RC_POS_CONTROL模式)。

6.将SWB档杆快速切入到COMMAND_CONTROL模式时,会导致系统异常,此时,档杆处于COMMAND_CONTROL模式,但无人机上一状态为INIT模式,导致无人机无法正常进入COMMAND_CONTROL模式。

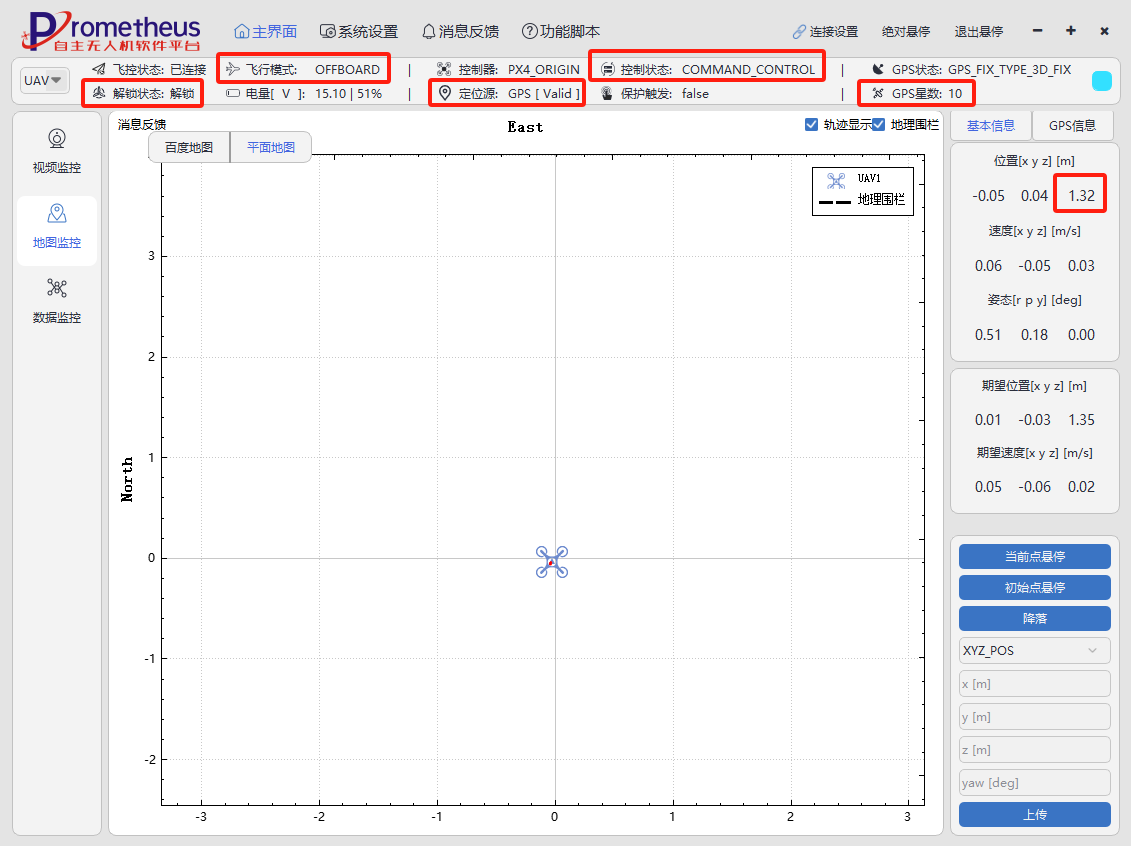

无人机解锁并处于RC_POS_CONTROL(PX4处于OFFBOARD模式)模式时

1.无人机此时会离地一定高度,不能上锁。

2.可切入LAND_CONTROL。

3.可切入COMMAND_CONTROL。

无人机解锁并处于COMMAND_CONTROL(PX4处于OFFBOARD模式)模式时

1.可切入LAND_CONTROL。

2.可切入RC_POS_CONTROL。

3.将SWB档杆快速移动至顶端可直接切入到INIT模式。

无人机遥控器操作正常流程

1.将SWA/SWB/SWC/SWD档杆全部打到最顶端。

2.启动相关功能代码脚本。

3.将SWA档杆切入到底端进行解锁。

4.无人机解锁后将SWB档杆切入到RC_POS_CONTROL模式,缓慢升高到一定高度。

5.将SWB档杆切入到COMMAND_CONTROL模式,无人机进行自主飞行。

6.自主飞行任务结束后将SWD档杆拨到底端,无人机自主降落。

无人机定位异常无法正常飞行

1.此时无人机将触发保护机制,进行快速降落。

2.如果快速降落依然存在安全风险或无人机已经失控,则将SWC档杆向下拨,无人机电机将停转。

无人机在COMMAND_CONTROL模式下需要人为接管

1.将SWB档杆拨到中间位置或最顶端位置切换至RC_POS_CONTROL或INIT人为进行操作。

无人机控制模块 - uav_control

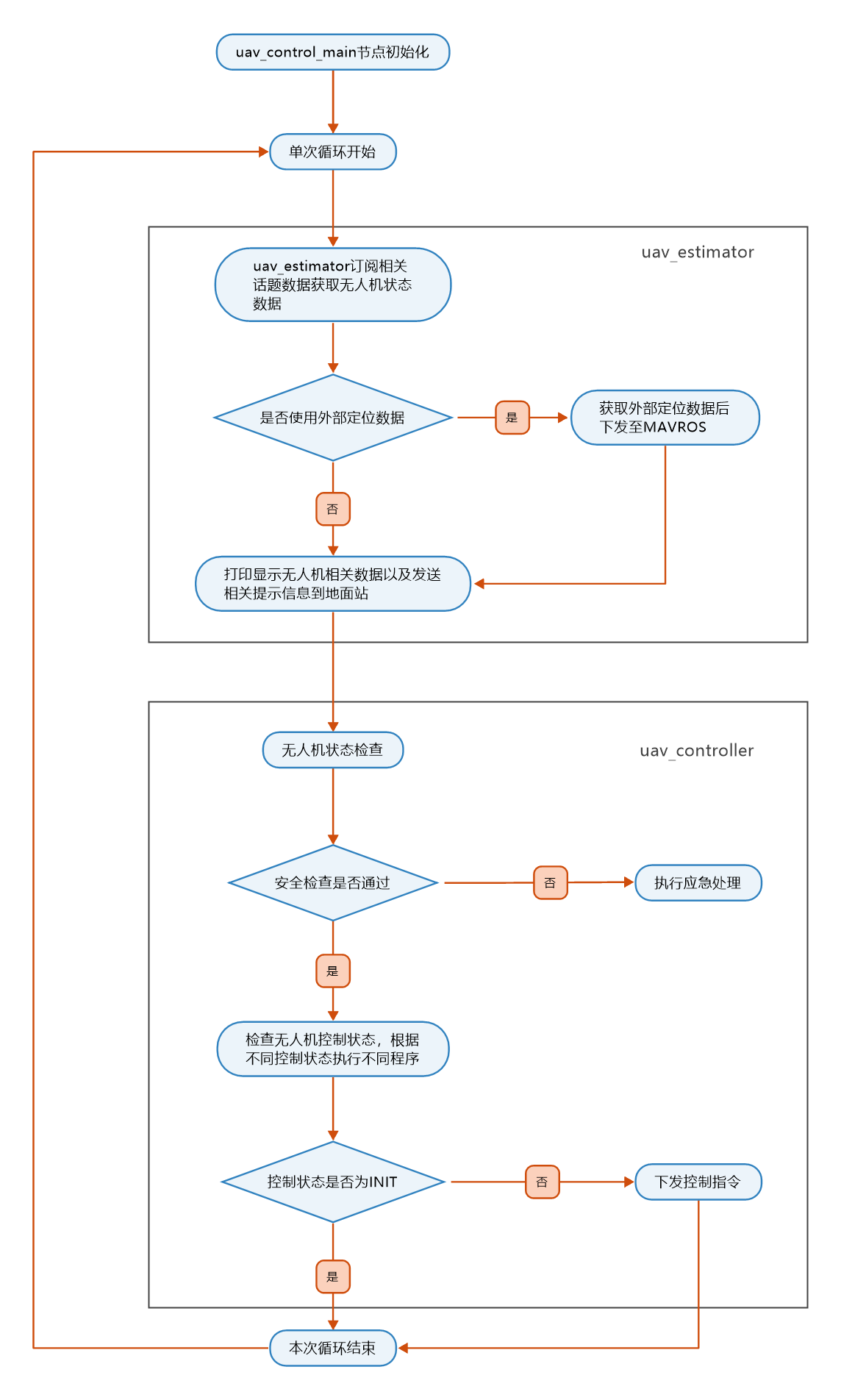

uav_control代码框架

uav_control包含两个功能模块uav_controller(无人机控制)和uav_estimator(无人机状态);

uav_controller模块一次循环的的核心逻辑为:

- 无人机状态检查,包含飞控连接状态、定位状态、地理围栏等

- 检查无人机控制状态,包含INIT、RC_POS_CONTROL、COMMAND_CONTROL、LAND_CONTROL四种控制状态并对控制变量进行赋值

- 如果无人机状态为INIT则本次循环结束

- 下发控制指令

uav_estimator模块一次循环的的核心逻辑为:

- 订阅无人机状态、电池状态、无人机定位数据、外部定位数据等

- 如果使用外部定位数据,则将定位数据下发到MAVROS

- 打印显示无人机相关数据

- 发送相关提示信息到地面站

下图为uav_control模块代码运行流程

uav_control代码框架图

uav_control_node介绍

uav_control模块相关源代码放置在Prometheus/Modules/uav_control文件夹下,对应的ROS功能包名为prometheus_uav_control。该模块为Prometheus项目的基础模块,完成Prometheus其他功能模块与mavros节点进行数据交互。

发布话题和订阅话题中均带有命名空间/uav*,无人机编号不同则对应的命名空间不同,一般情况下默认为/uav1

发布话题

/uav*/mavros/setpoint_raw/attitude(mavros_msgs/AttitudeTarget)

期望的无人机姿态控制量

/uav*/mavros/setpoint_raw/global(mavros_msgs/GlobalPositionTarget)

期望的无人机经纬高控制量

/uav*/mavros/setpoint_raw/local(mavros_msgs/PositionTarget)

期望的无人机ENU坐标系的控制量(包含位置、速度、加速度等)

/uav*/mavros/vision_pose/pose(geometry_msgs/PoseStamped)

MAVROS提供的外部定位数据接口

/uav*/prometheus/control_state(prometheus_msgs/UAVControlState)

Prometheus控制状态

/uav*/prometheus/odom(nav_msgs/Odometry)

无人机里程计数据

/uav*/prometheus/offset_pose(prometheus_msgs/OffsetPose)

ENU坐标系下的位置偏移量

/uav*/prometheus/state(prometheus_msgs/UAVState)

无人机状态合集,包括位置\速度\姿态\模式等

/uav*/prometheus/text_info(prometheus_msgs/TextInfo)

反馈到地面站的打印信息

/uav*/prometheus/trajectory(nav_msgs/Path)

无人机运动轨迹

/uav*/prometheus/uav_mesh(visualization_msgs/Marker)

无人机位置(带图标),用于RVIZ显示

订阅话题

/uav*/mavros/battery(sensor_msgs/BatteryState)

无人机电池状态

/uav*/mavros/global_position/global(sensor_msgs/NavSatFix)

无人机当前经纬度数据,经飞控融合过后的数据.

/uav*/mavros/gpsstatus/gps*/raw(mavros_msgs/GPSRAW)

GPS模块数据状态

/uav*/mavros/imu/data(sensor_msgs/Imu)

IMU模块数据

/uav*/mavros/local_position/pose(geometry_msgs/PoseStamped)

无人机ENU坐标系下的位置数据

/uav*/mavros/local_position/velocity_local(geometry_msgs/TwistStamped)

无人机ENU坐标系的当前速度数据

/uav*/mavros/setpoint_raw/target_attitude(mavros_msgs/AttitudeTarget)

PX4中无人机的姿态设定值 (坐标系:ENU系)

/uav*/mavros/setpoint_raw/target_local(mavros_msgs/PositionTarget)

PX4中无人机的位置/速度/加速度设定值(坐标系:ENU系)

/uav*/mavros/state(mavros_msgs/State)

无人机当前状态(PX4)

/uav*/prometheus/command(prometheus_msgs::UAVCommand)

无人机控制指令(用于COMMAND_CONTROL模式)

/uav*/prometheus/fake_rc_in(mavros_msgs/RCIn)

PX4遥控器数据

/uav*/prometheus/offset_pose(prometheus_msgs::OffsetPose)

ENU坐标系下的位置偏移量

/uav*/prometheus/set_local_offset_pose(prometheus_msgs::OffsetPose)

设置ENU坐标系下无人机的位置偏移量

/uav*/prometheus/setup(prometheus_msgs/UAVSetup)

无人机设置指令

/uav*/prometheus/state(prometheus_msgs/UAVState)

无人机状态合集,包括位置、速度、姿态、模式等

参数

uav_id:

参数说明: 无人机编号

单位: -

数据类型: int

默认值: 1

备注: 无

sim_mode:

参数说明: 是否为仿真

单位: -

数据类型: bool

默认值: true

备注: true代表为仿真模式,false代表为非仿真模式

control/pos_controller:

参数说明: 控制器标志位

单位: -

数据类型: int

默认值: 0

备注: 0: PX4_ORIGIN, 1: PID, 2: UDE, 3: NE

control/enable_external_control:

参数说明: 是否使用外部控制器

单位: -

数据类型: bool

默认值: false

备注: true代表使用外部控制器,false代表不使用外部控制器

control/Takeoff_height:

参数说明: 起飞高度(command_control模式下的起飞高度)

单位: 米

数据类型: float

默认值: 1.0

备注: 无

control/Disarm_height:

参数说明: land_control模式下自动上锁的高度

单位: 米

数据类型: float

默认值: 0.2

备注: 无

control/Land_speed:

参数说明: land_control模式下下降的速度

单位: 米

数据类型: float

默认值: 0.2

备注: 位置坐标系为ENU坐标系

control/location_source:

参数说明: 定位数据来源

单位: 无

数据类型: int

默认值: 4

备注: 0: MOCAP, 1: T265, 2: GAZEBO, 3: FAKE_ODOM, 4: GPS, 5: RTK, 6: UWB

control/maximum_safe_vel_xy:

参数说明: XY轴最大安全速度

单位: 米/秒

数据类型: float

默认值: 4.0

备注: 无

control/maximum_safe_vel_z:

参数说明: Z轴最大安全速度

单位: 米/秒

数据类型: float

默认值: 3.0

备注: 无

control/maximum_vel_error_for_vision:

参数说明: 最大vision/px4速度误差

单位: 米/秒

数据类型: float

默认值: 1.0

备注: 无

geo_fence/x_min:

参数说明: 地理围栏X轴最小值

单位: 米

数据类型: float

默认值: -100.0

备注: 位置坐标系为ENU坐标系

geo_fence/x_max:

参数说明: 地理围栏X轴最大值

单位: 米

数据类型: float

默认值: 100.0

备注: 位置坐标系为ENU坐标系

geo_fence/y_min:

参数说明: 地理围栏Y轴最小值

单位: 米

数据类型: float

默认值: -100.0

备注: 位置坐标系为ENU坐标系

geo_fence/y_max:

参数说明: 地理围栏Y轴最大值

单位: 米

数据类型: float

默认值: 100.0

备注: 位置坐标系为ENU坐标系

geo_fence/z_min:

参数说明: 地理围栏Z轴最小值

单位: 米

数据类型: float

默认值: -100.0

备注: 位置坐标系为ENU坐标系

geo_fence/z_max:

参数说明: 地理围栏Z轴最大值

单位: 米

数据类型: float

默认值: 100.0

备注: 位置坐标系为ENU坐标系

无人机控制模块教学例程

提示

尝试运行无人机控制模块教学例程前需要掌握仿真入门中仿真中的遥控器使用说明

学习无人机控制模块教学例程需要掌握一定的Ubuntu、ROS、C++/Python基础

无人机控制模块作为Prometheus项目的基础子模块,Prometheus项目中其余子模块均会通过控制模块与无人机进行数据交互。所以学习Prometheus项目以及通过Prometheus项目进行无人机二次开发都是需要先从控制模块开始学习。

在控制模块我们提供了对应的教学例程,包含起飞降落、惯性系控制、机体系控制、经纬高控制、轨迹控制以及集群控制六个教学例程。通过教学例程大家能够快速了解控制模块的相关数据接口,也能够通过学习例程demo的源码学习Prometheus控制模块的二次开发。

教学例程提供有C++以及Python两种语言的源码,用户可自行选择相应的源码文件进行学习。

- 控制模块源码文件位置:/Prometheus/Modules/uav_control

- 教学例程demo源码文件:/Prometheus/Modules/tutorial_demo/basic

无人机控制模块教学例程 - 起飞降落

<span style="display: flex; flex-direction: column; width: 100%"><img src = https://qiniu.md.amovlab.com/img/m/202206/20220630/1050113953508024345067520.gif>运行结果展示

起飞降落demo对应脚本文件位于

~/Prometheus/Scripts/simulation/tutorial_demo/takeoff_land/takeoff_land_P450.sh操作步骤

将遥控器开机并通过USB接口接入电脑

输入以下命令启动起飞降落仿真demo

cd ~/Prometheus/Scripts/simulation/tutorial_demo/takeoff_land # 第一次启动该脚本时,需要添加可执行权限 chmod +x takeoff_land_P450.sh ./takeoff_land_P450.sh遥控器SWA档杆向下拨解锁无人机

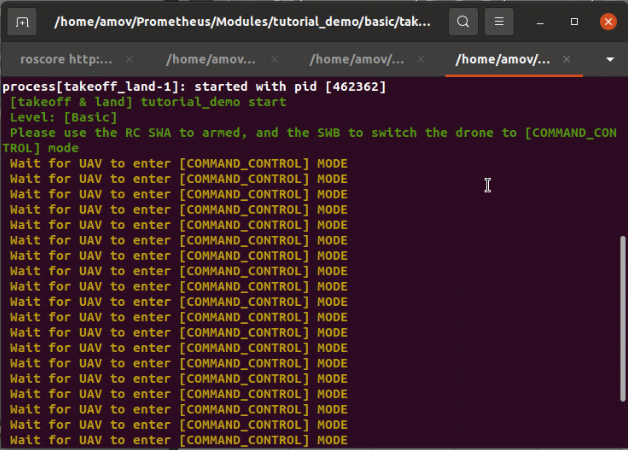

遥控器SWB档杆拨到中间位置将无人机控制状态切换到RC_POS_CONTROL

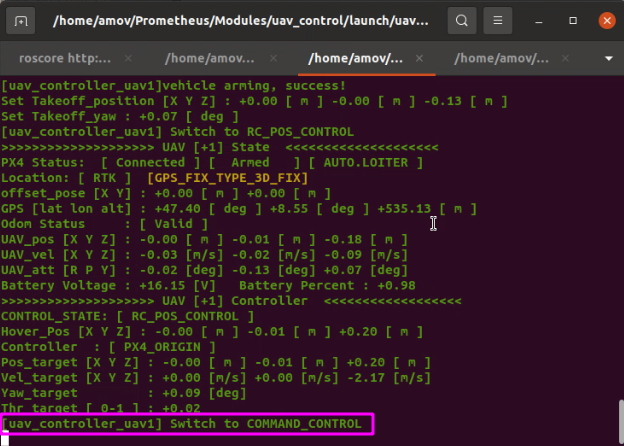

遥控器SWB档杆拨到最底部将无人机控制状态切换到COMMAND_CONTROL

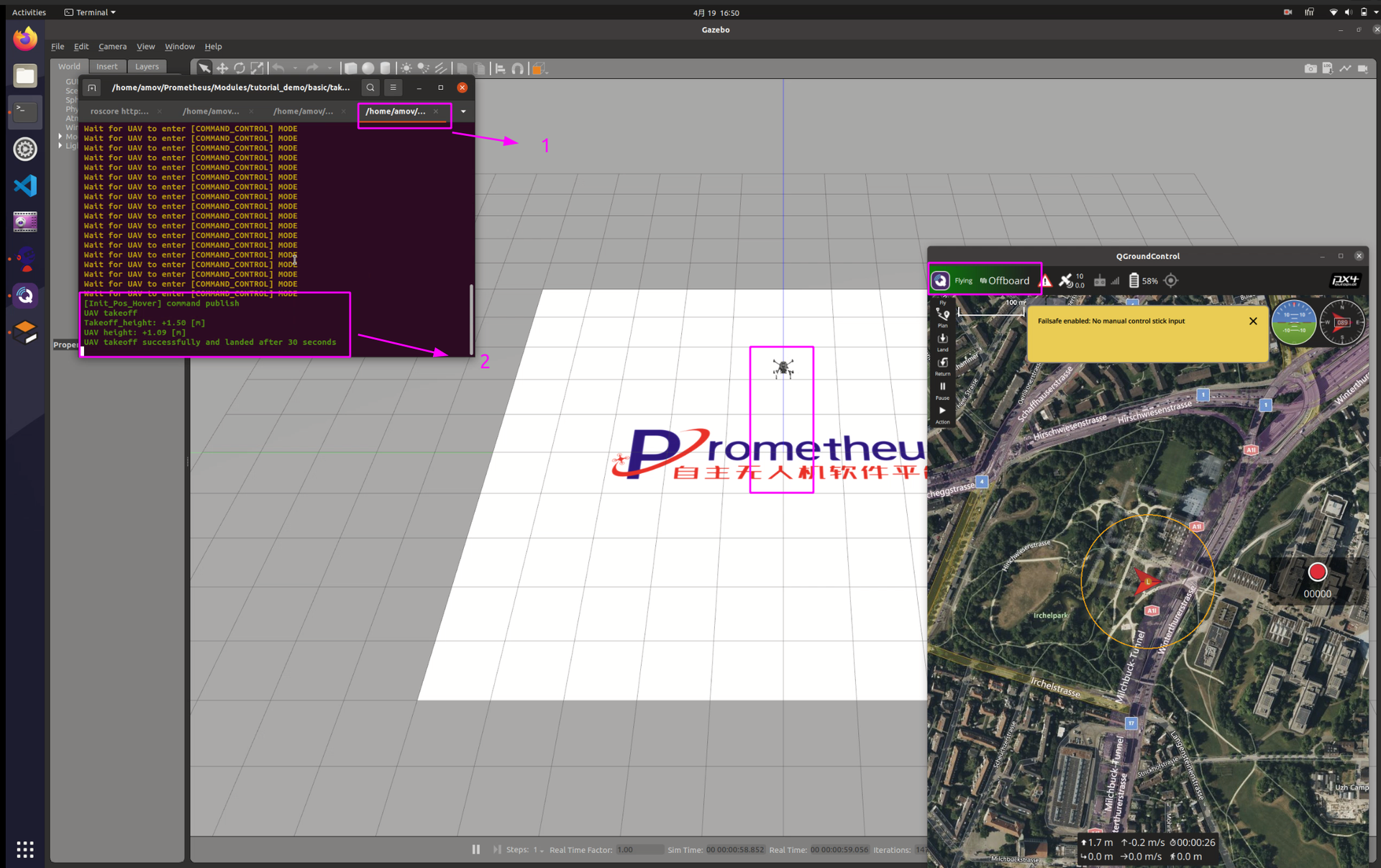

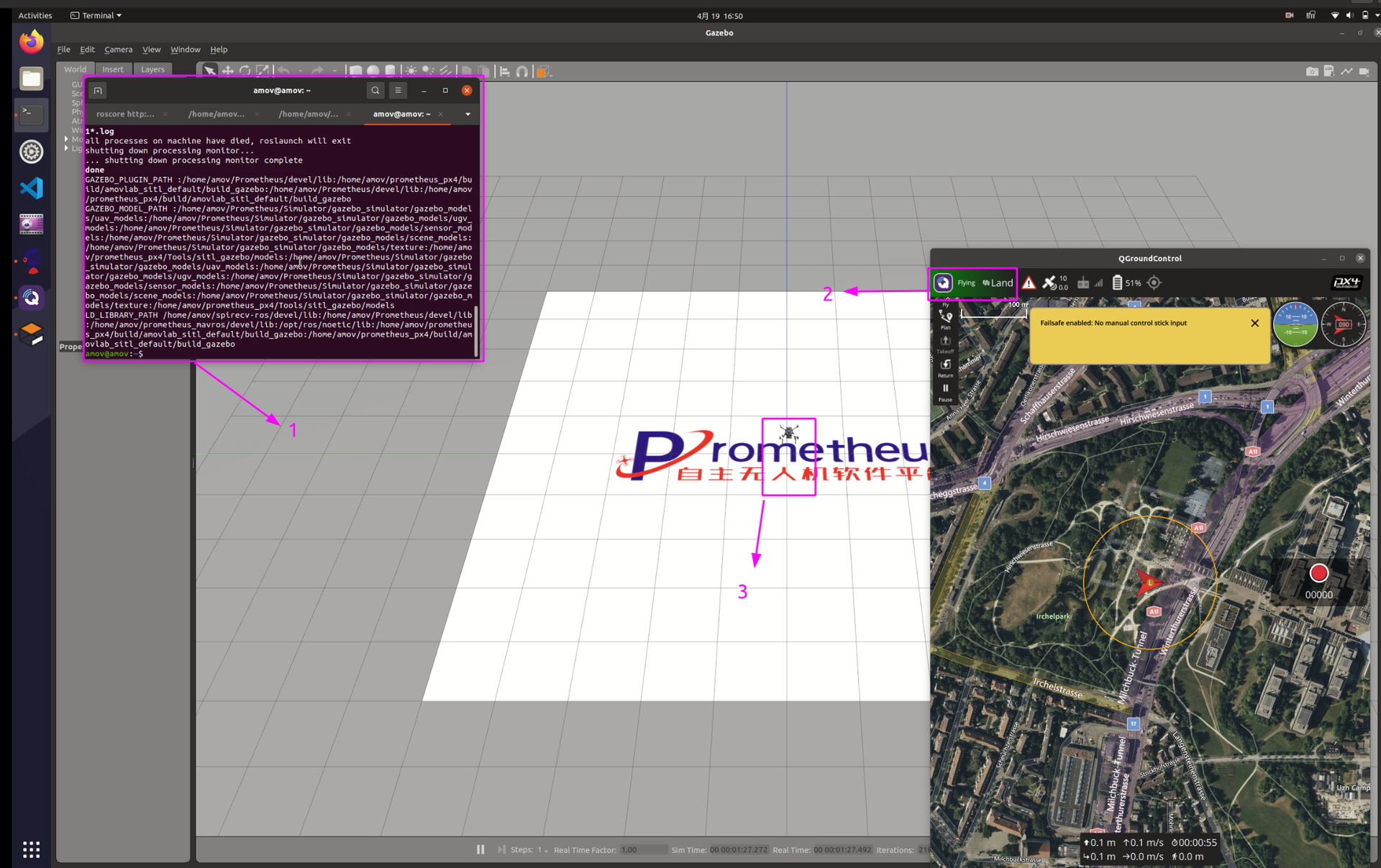

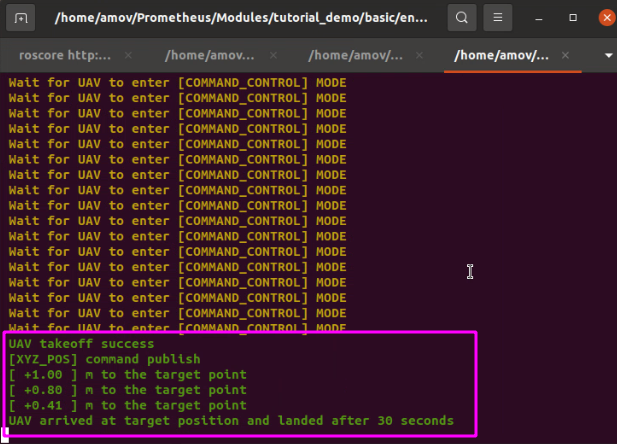

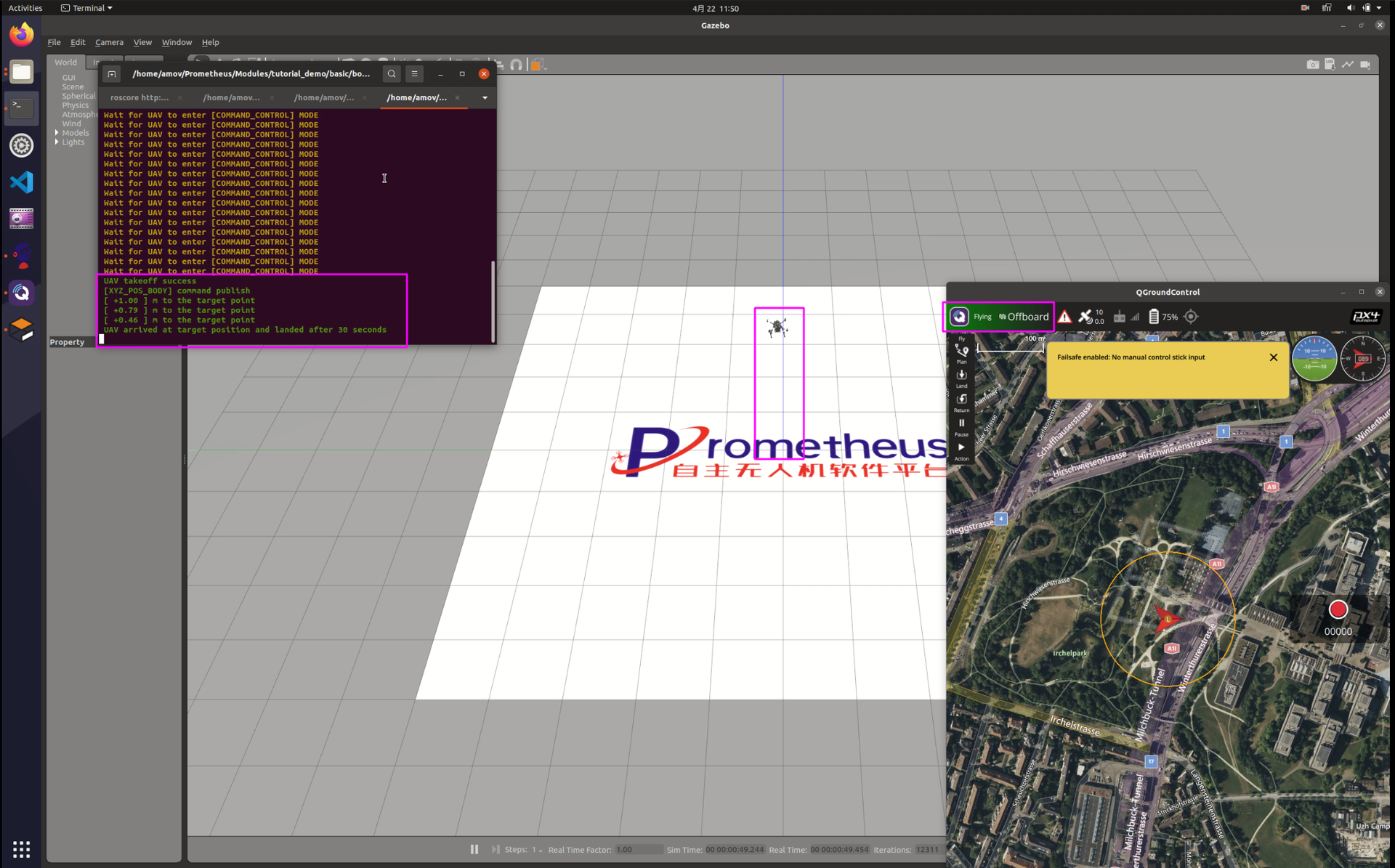

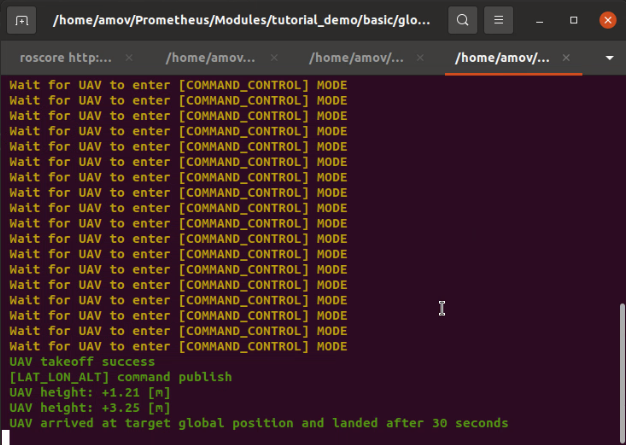

无人机将自动起飞,到达预设高度后悬停30秒,随后自动降落

检查终端运行是否正常

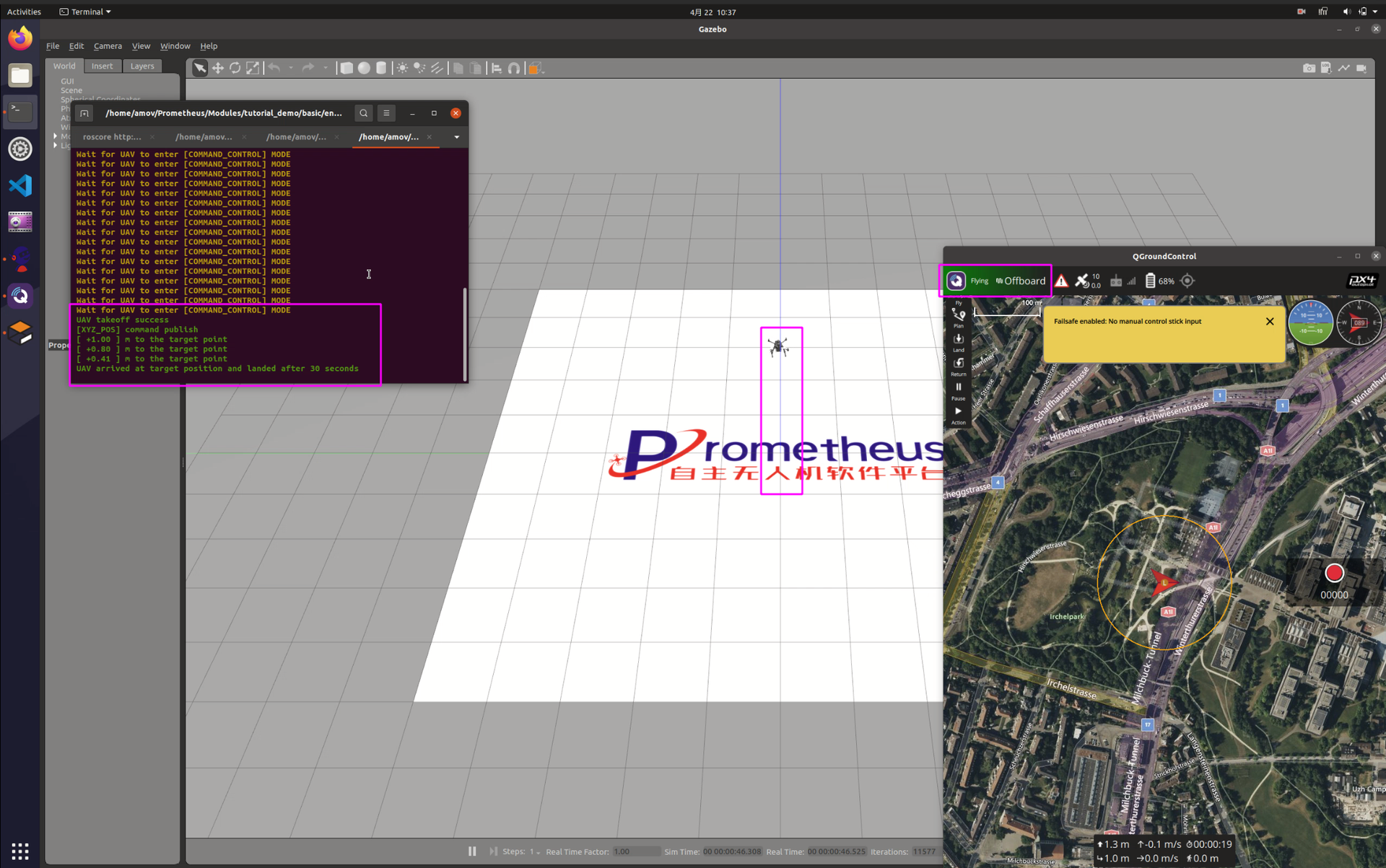

- ros主节点

- 下图所示为正常运行

- PX4飞控仿真

- 下图所示为正常运行

- Prometheus控制

- 下图所示为正常运行

- Prometheus控制demo,起飞降落

- 下图所示为正常运行

- 正常启动仿真界面

- 下图所示为正常运行

运行仿真功能

- 拨动遥控器的SW-A拨杆,到最下面,解锁无人机

- 拨动遥控器的SW-B拨杆,到中间位置,切换到RC_POS_CONTROL模式

- 拨动遥控器的SW-B拨杆,到最下面,切换到COMMAND_CONTROL模式

- 此时无人机会在初始点悬停

- 在COMMAND_CONTROL模式下可以使用代码控制无人机飞行了,此处运行代码控制无人机,到达预设高度后悬停30秒,随后自动降落

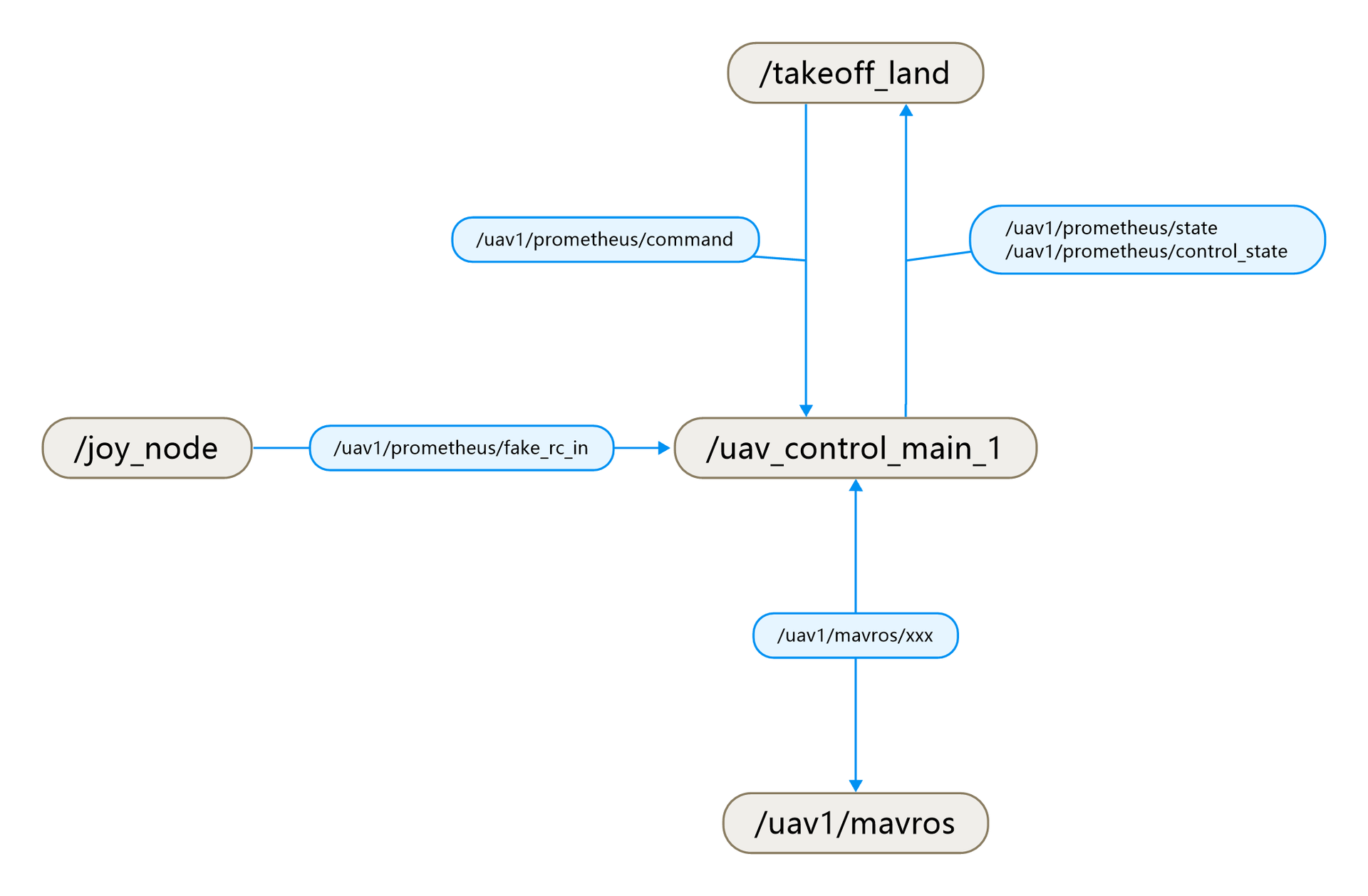

节点运行图

起飞降落例程主要包含

/joy_node、/uav1/mavros、/uav_control_main_1、/takeoff_land等ROS节点。

/joy_node节点为遥控器ROS驱动节点,用以获取遥控器数据。/uav1/mavros节点为飞控ROS驱动节点,与飞控进行数据交互。在仿真中,该驱动节点与模拟飞控进行数据交互。/uav_control_main_1节点为Prometheus项目中最基础的ROS节点,所有Prometheus项目的功能模块都通过该节点与无人机进行数据交互。/takeoff_land节点为起飞降落节点,通过/uav_control_main_1节点提供的数据接口获取无人机数据以及控制无人机。从节点运行图中,我们可以看到

/takeoff_land节点与/uav_control_main_1节点进行数据交互主要有三个ROS话题

- /uav1/prometheus/command:无人机控制接口,对应的消息为

prometheus_msgs/UAVCommand- /uav1/prometheus/state:无人机状态,对应的消息为

prometheus_msgs/UAVState- /uav1/prometheus/control_state:无人机控制状态,对应的消息为

prometheus_msgs/UAVControalState建议阅读

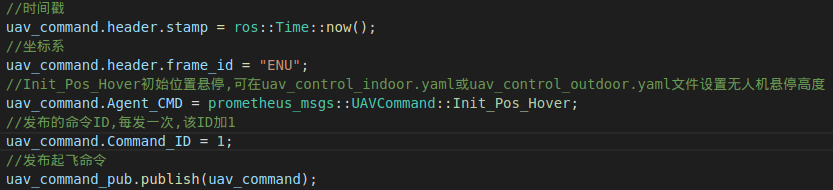

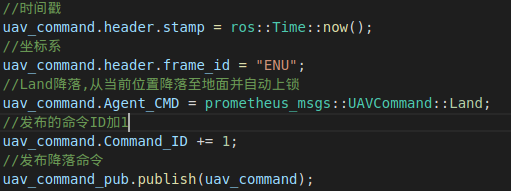

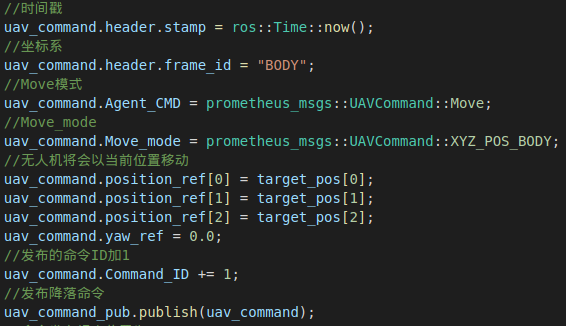

/Prometheus/Modules/common/prometheus_msgs/msg内对应的消息文件,了解上面提到的三个消息的详细定义。代码讲解

源码文件名为

takeoff_land.cpp位于

/Prometheus/Modules/tutorial_demo/basic/takeoff_land/src文件夹下

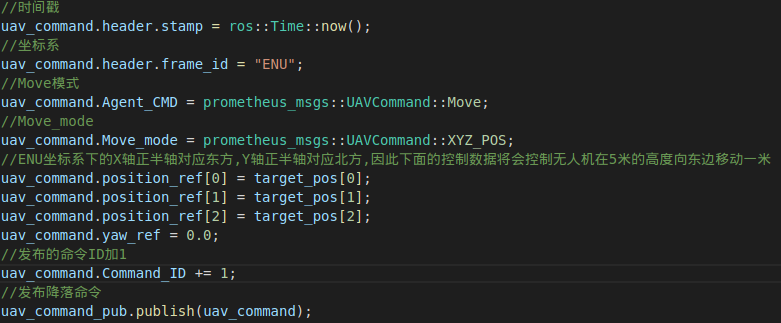

该demo为Prometheus 起飞&降落控制接口开发示例,核心代码如上图所示;主要是填充以下数据:

- Agent_CMD设置为Init_Pos_Hover模式,该模式为起飞;Agent_CMD设置为Land,该模式为降落

- 每发送一次数据,Command_ID加1

- 时间戳通过调用

ros::Time::now()函数获取当前ROS系统时间并赋值即可,frame_id并不影响功能,但建议与控制命令所采用的坐标系一致。无人机控制模块教学例程 - 惯性系控制

运行结果展示

惯性系控制demo对应脚本文件位于

~/Prometheus/Scripts/simulation/tutorial_demo/enu_xyz_pos_control/enu_xyz_pos_control_P450.sh操作步骤

将遥控器开机并通过USB接口接入电脑

输入以下命令启动惯性系移动仿真demo

cd ~/Prometheus/Scripts/simulation/tutorial_demo/enu_xyz_pos_control # 第一次启动该脚本时,需要添加可执行权限 chmod +x enu_xyz_pos_control_P450.sh ./enu_xyz_pos_control_P450.sh遥控器SWA档杆向下拨解锁无人机

遥控器SWB档杆拨到中间位置将无人机控制状态切换到RC_POS_CONTROL

遥控器SWB档杆拨到最底部将无人机控制状态切换到COMMAND_CONTROL

无人机将自动起飞,飞行到预设位置(ENU坐标系下(1,0,1)坐标点)后将悬停30秒,随后降落

检查终端运行是否正常

- ros主节点

- 下图所示为正常运行

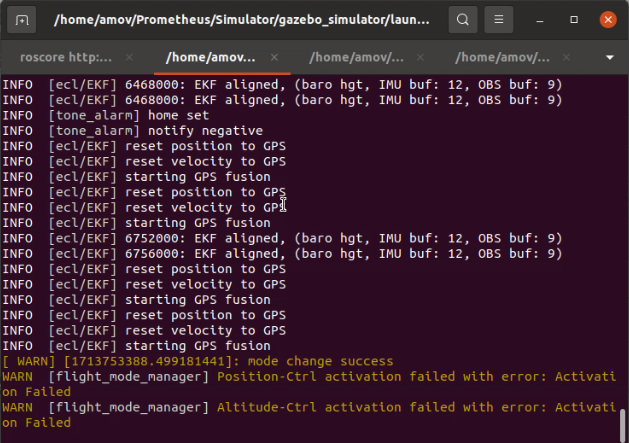

- PX4飞控仿真

- 下图所示为正常运行

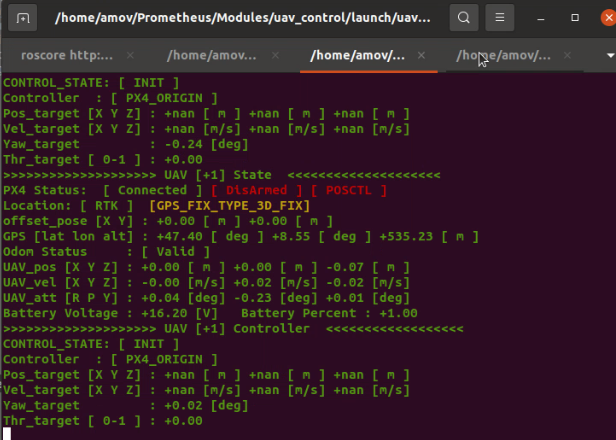

- Prometheus控制

- 下图所示为正常运行

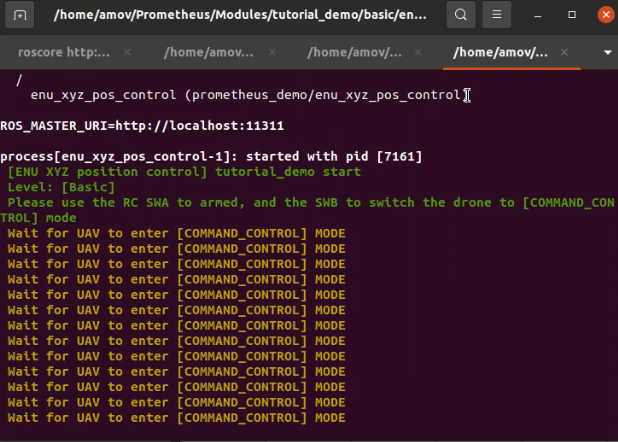

- Prometheus惯性系控制demo

- 下图所示为正常运行

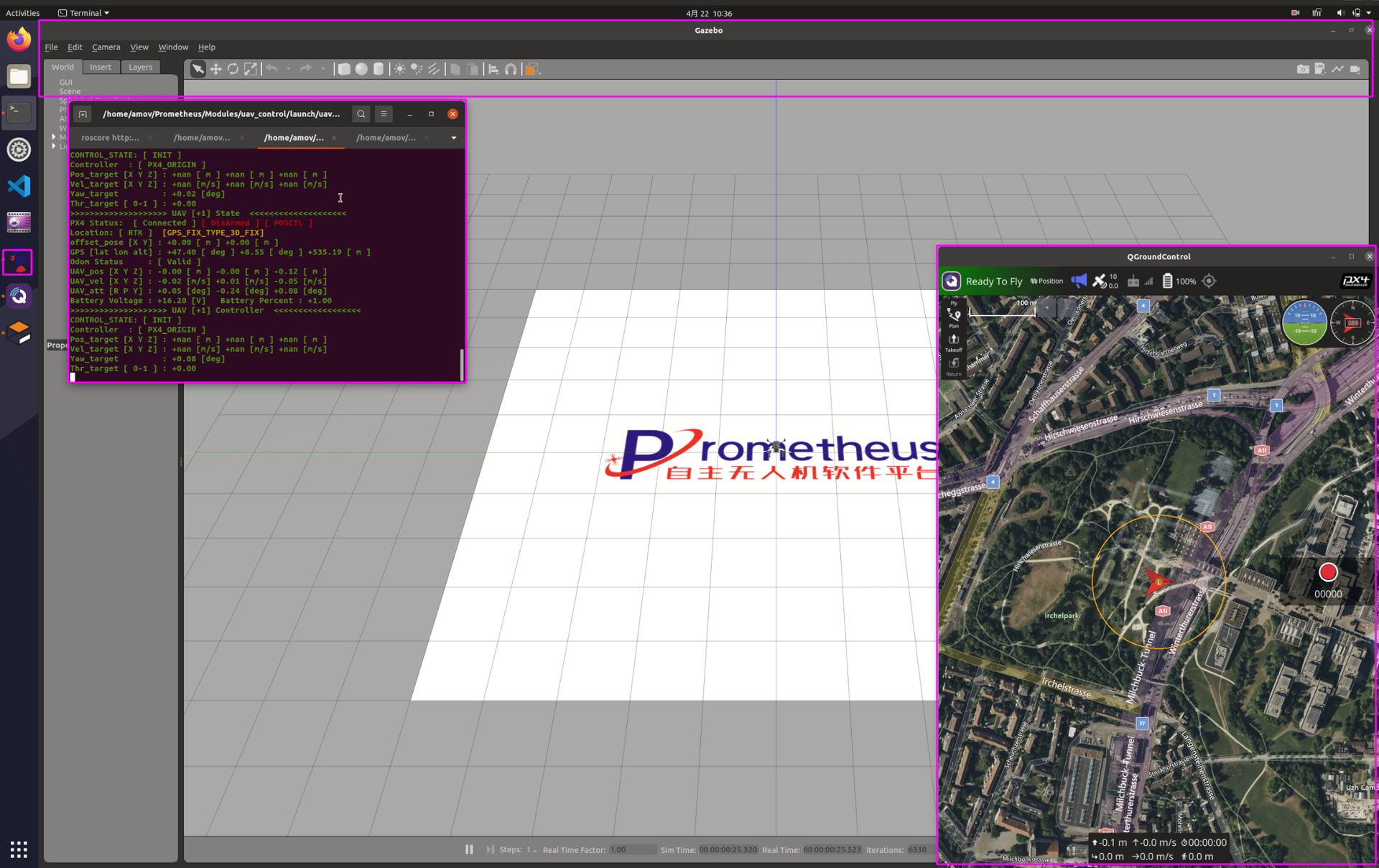

- 正常启动仿真界面

- 下图所示为正常运行

运行仿真功能

- 拨动遥控器的SW-A拨杆,到最下面,解锁无人机

- 拨动遥控器的SW-B拨杆,到中间位置,切换到RC_POS_CONTROL模式

- 拨动遥控器的SW-B拨杆,到最下面,切换到COMMAND_CONTROL模式

- 此时无人机会在初始点悬停

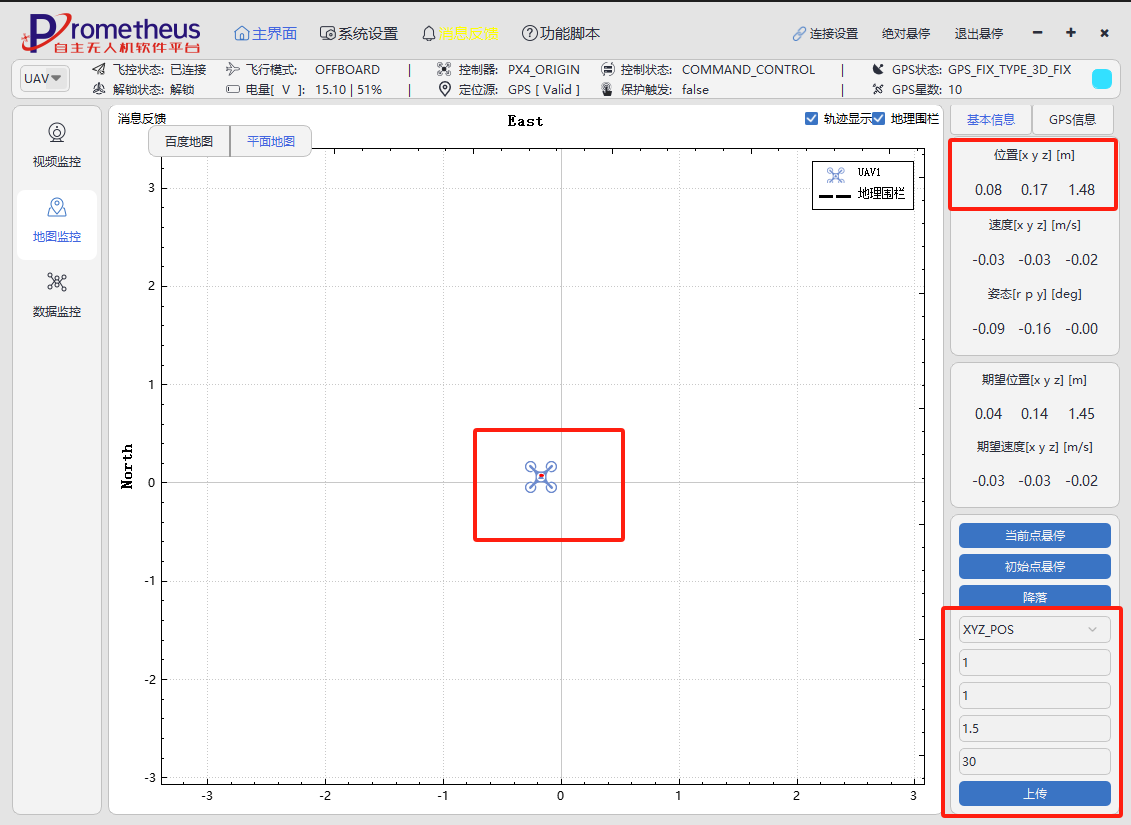

- 在COMMAND_CONTROL模式下可以使用代码控制无人机飞行了,此处运行代码控制无人机,到达惯性系控制预设点后(ENU坐标系下(1,0,1)坐标点)悬停30秒,随后自动降落

代码讲解

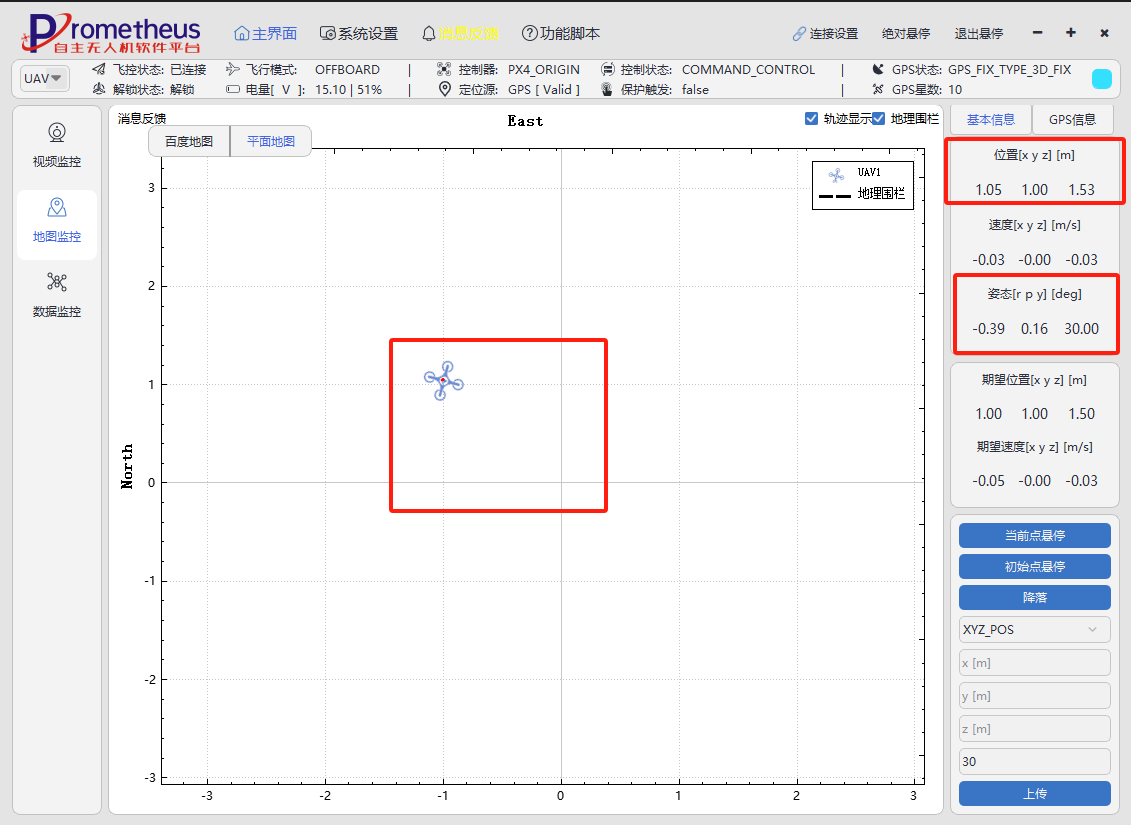

该demo为Prometheus XYZ_POS控制接口开发示例,XYZ_POS为无人机XYZ轴位置(ENU坐标系)的控制模式,核心代码如上图所示;主要是填充以下数据:

- Agent_CMD设置为Move模式

- Move_mode设置为XYZ_POS

- 填充XYZ轴的位置数据

- 每发送一次数据,Command_ID加1

无人机控制模块教学例程 - 机体系控制

运行结果展示

机体系控制demo对应脚本文件位于

~/Prometheus/Scripts/simulation/tutorial_demo/body_xyz_pos_control/body_xyz_pos_control_P450.sh操作步骤

将遥控器开机并通过USB接口接入电脑

输入以下命令启动机体系移动仿真demo

cd ~/Prometheus/Scripts/simulation/tutorial_demo/body_xyz_pos_control # 第一次启动该脚本时,需要添加可执行权限 chmod +x body_xyz_pos_control_P450.sh ./body_xyz_pos_control_P450.sh遥控器SWA档杆向下拨解锁无人机

遥控器SWB档杆拨到中间位置将无人机控制状态切换到RC_POS_CONTROL

遥控器SWB档杆拨到最底部将无人机控制状态切换到COMMAND_CONTROL

无人机将自动起飞,飞行到预设位置(body坐标系下(1,0,0)坐标点)后将悬停30秒,随后降落

检查终端运行是否正常

- ros主节点

- 下图所示为正常运行

- PX4飞控仿真

- 下图所示为正常运行

- Prometheus控制

- 下图所示为正常运行

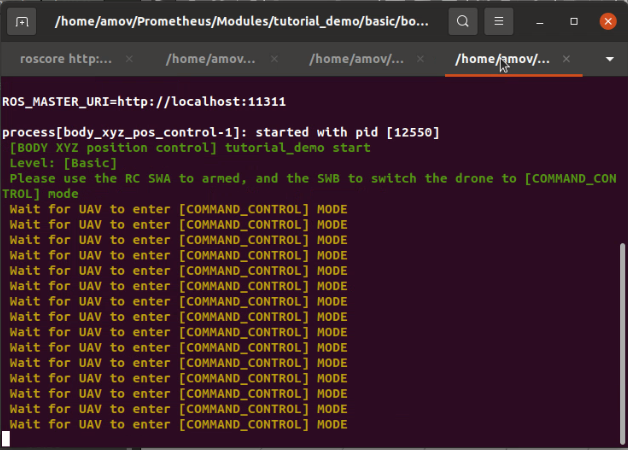

- Prometheus机体系控制demo

- 下图所示为正常运行

- 正常启动仿真界面

- 下图所示为正常运行

运行仿真功能

- 拨动遥控器的SW-A拨杆,到最下面,解锁无人机

- 拨动遥控器的SW-B拨杆,到中间位置,切换到RC_POS_CONTROL模式

- 拨动遥控器的SW-B拨杆,到最下面,切换到COMMAND_CONTROL模式

- 在COMMAND_CONTROL模式下可以使用代码控制无人机飞行了,此处运行代码控制无人机,到达惯性系控制预设点后(body坐标系下(1,0,0))悬停30秒,随后自动降落

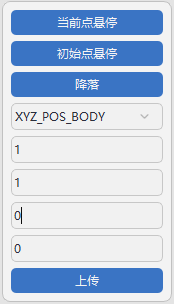

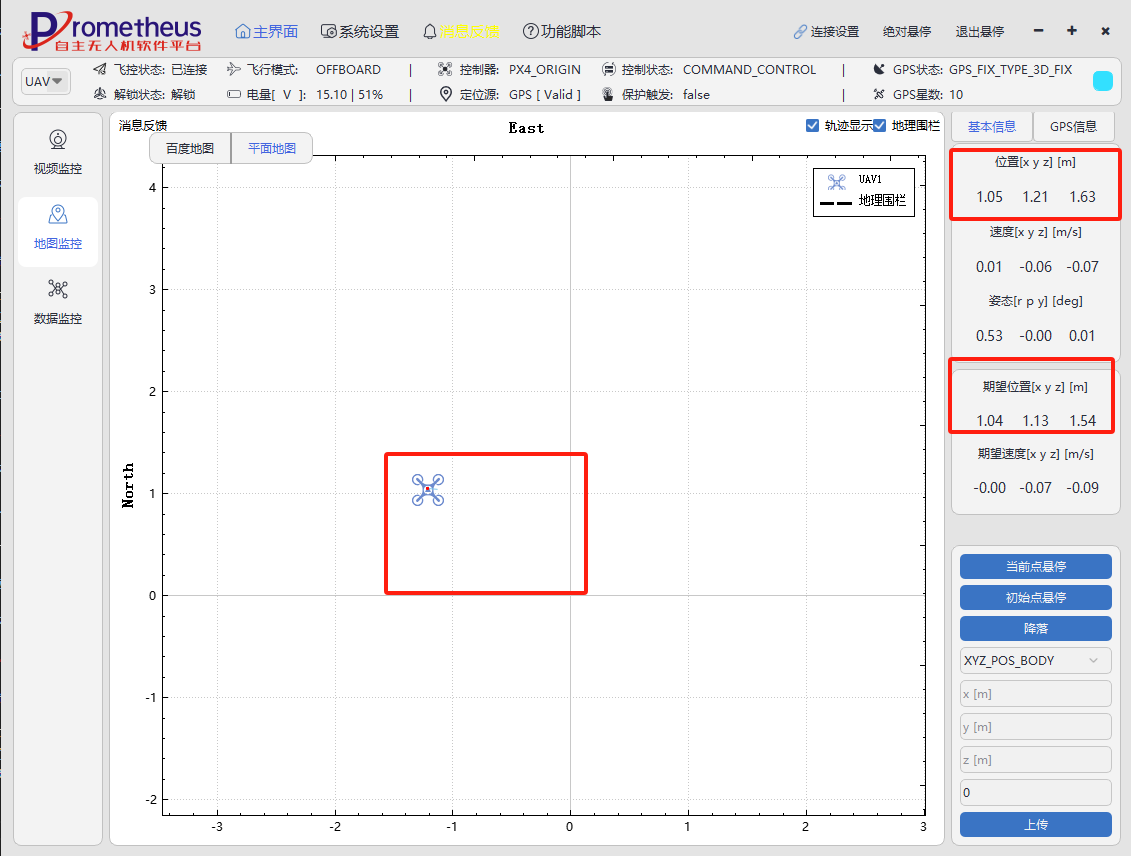

代码讲解

该demo为Prometheus XYZ_POS_BODY控制接口开发示例,XYZ_POS_BODY为无人机XYZ轴位置(BODY坐标系)的控制模式,核心代码如上图所示;主要是填充以下数据:

- Agent_CMD设置为Move模式

- Move_mode设置为XYZ_POS_BODY

- 填充XYZ轴的位置数据

- 每发送一次数据,Command_ID加1

注意

机体坐标系控制对Command_ID变量有严格限制,当前发送控制命令的Command_ID必须高于上一个控制命令的Command_ID才会执行

无人机控制模块教学例程 - 经纬高控制

<span style="display: flex; flex-direction: column; width: 100%"><img src = https://qiniu.md.amovlab.com/img/m/202206/20220630/1051424338210948570316800.gif>运行结果展示

经纬高控制demo对应脚本文件位于

~/Prometheus/Scripts/simulation/tutorial_demo/global_pos_control/global_pos_control_P450.sh操作步骤

将遥控器开机并通过USB接口接入电脑

输入以下命令启动经纬高控制仿真demo

cd ~/Prometheus/Scripts/simulation/tutorial_demo/global_pos_control # 第一次启动该脚本时,需要添加可执行权限 chmod +x global_pos_control_P450.sh ./global_pos_control_P450.sh遥控器SWA档杆向下拨解锁无人机

遥控器SWB档杆拨到中间位置将无人机控制状态切换到RC_POS_CONTROL

遥控器SWB档杆拨到最底部将无人机控制状态切换到COMMAND_CONTROL

无人机将自动起飞,飞行到预设位置(无人机当前经纬度,高度5米的位置点)后将悬停30秒,随后降落

注意

高度数据为相对高度,并不是海拔高度

检查终端运行是否正常

- ros主节点

- 下图所示为正常运行

- PX4飞控仿真

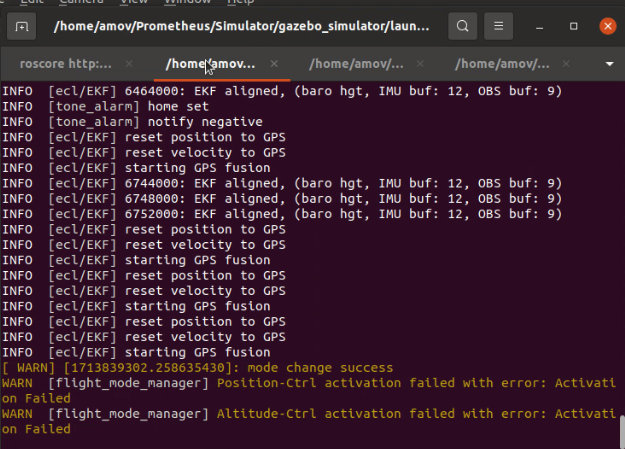

- 下图所示为正常运行

- Prometheus控制

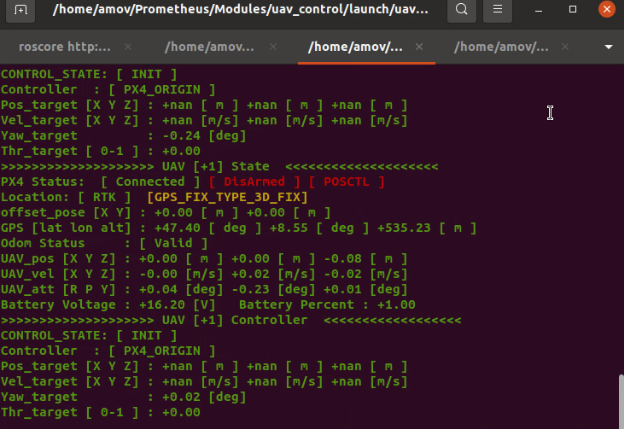

- 下图所示为正常运行

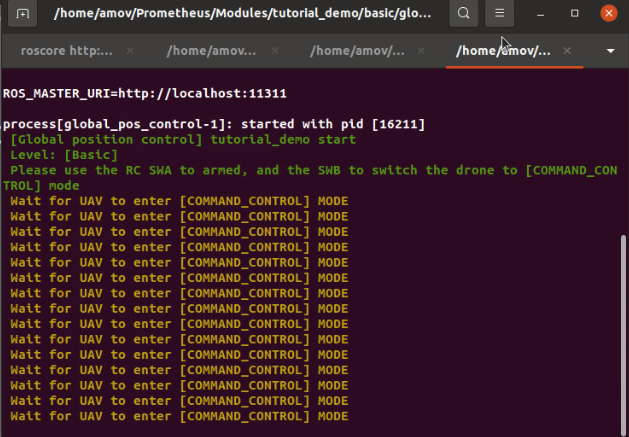

- Prometheus经纬高控制demo

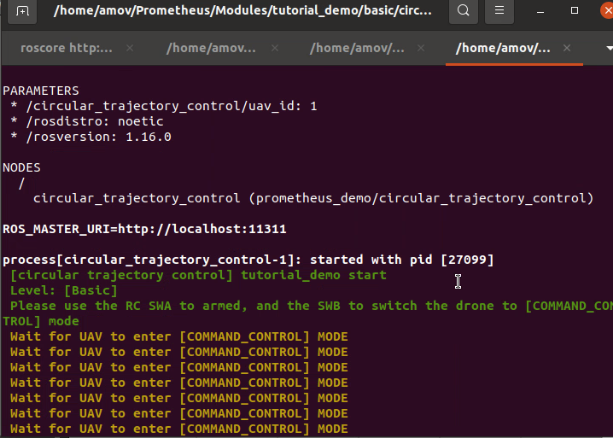

- 下图所示为正常运行

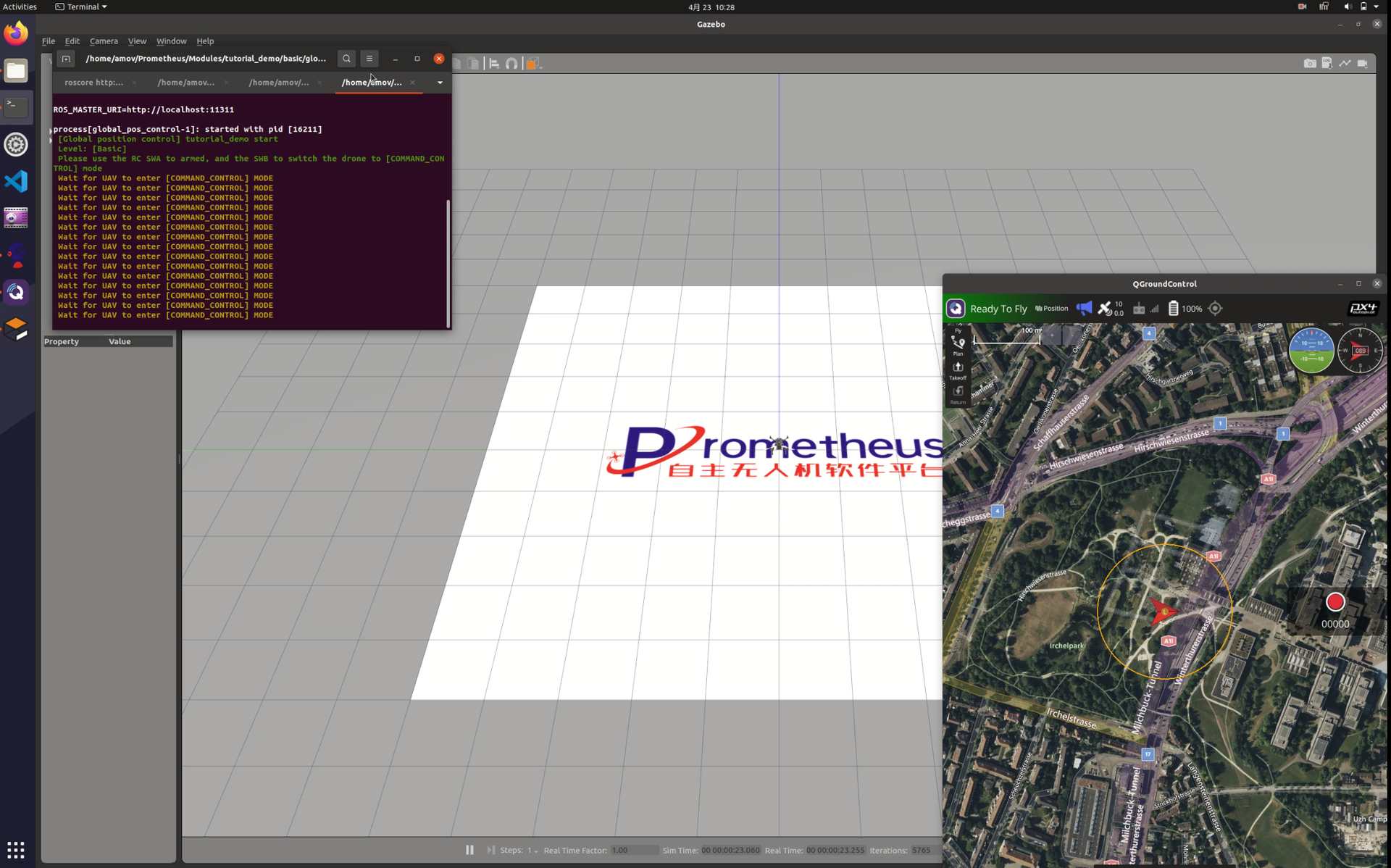

- 正常启动仿真界面

- 下图所示为正常运行

运行仿真功能

- 拨动遥控器的SW-A拨杆,到最下面,解锁无人机

- 拨动遥控器的SW-B拨杆,到中间位置,切换到RC_POS_CONTROL模式

- 拨动遥控器的SW-B拨杆,到最下面,切换到COMMAND_CONTROL模式

- 在COMMAND_CONTROL模式下可以使用代码控制无人机飞行了,此处运行代码控制无人机,到达惯性系控制预设点后(无人机当前经纬度,高度5米的位置点)悬停30秒,随后自动降落

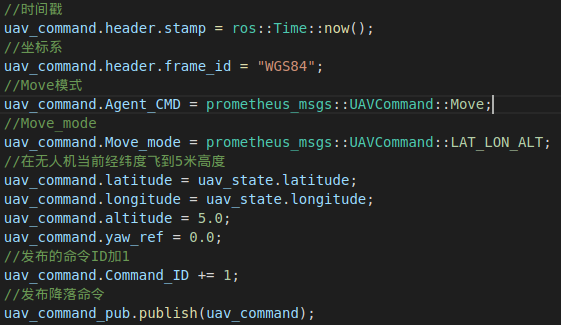

代码讲解

该demo为Prometheus LAT_LON_ALT控制接口开发示例,LAT_LON_ALT为无人机经纬度以及高度位置(WGS84坐标系)的控制模式,核心代码如上图所示;主要是填充以下数据:

- Agent_CMD设置为Move模式

- Move_mode设置为LAT_LON_ALT

- 填充经纬度以及高度数据

- 每发送一次数据,Command_ID加1

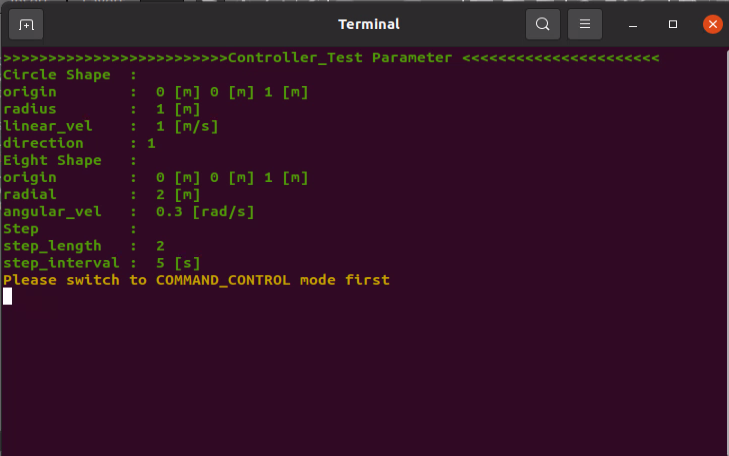

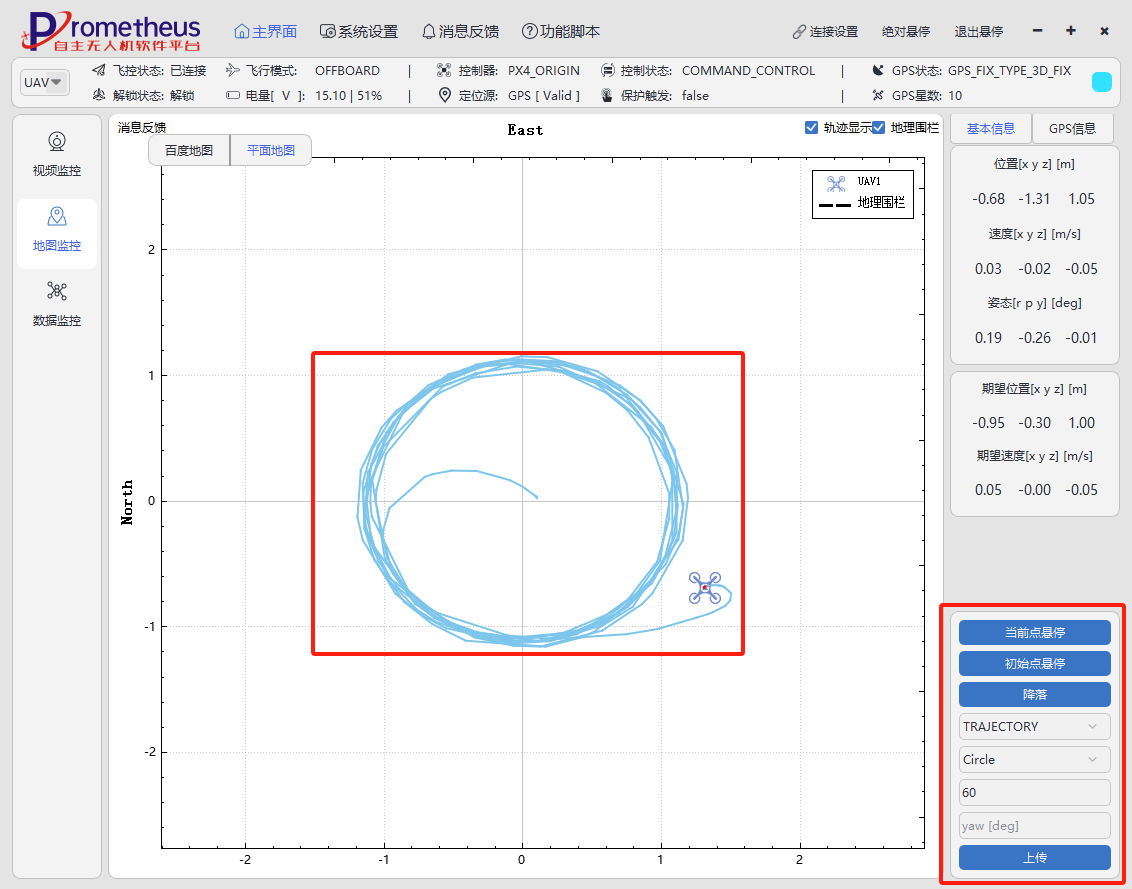

无人机控制模块教学例程 - 轨迹控制

运行结果展示

轨迹控制demo对应脚本文件位于

~/Prometheus/Scripts/simulation/tutorial_demo/circular_trajectory_control/circular_trajectory_control_P450.sh操作步骤

将遥控器开机并通过USB接口接入电脑

输入以下命令启动圆形轨迹追踪仿真demo

cd ~/Prometheus/Scripts/simulation/tutorial_demo/circular_trajectory_control # 第一次启动该脚本时,需要添加可执行权限 chmod +x circular_trajectory_control_P450.sh ./circular_trajectory_control_P450.sh遥控器SWA档杆向下拨解锁无人机

遥控器SWB档杆拨到中间位置将无人机控制状态切换到RC_POS_CONTROL

遥控器SWB档杆拨到最底部将无人机控制状态切换到COMMAND_CONTROL

无人机将自动起飞,然后飞行一个圆形轨迹后将悬停30秒,随后降落

检查终端运行是否正常

- ros主节点

- 下图所示为正常运行

- PX4飞控仿真

- 下图所示为正常运行

- Prometheus控制

- 下图所示为正常运行

- Prometheus机体系控制demo

- 下图所示为正常运行

- 正常启动仿真界面

- 下图所示为正常运行

运行仿真功能

- 拨动遥控器的SW-A拨杆,到最下面,解锁无人机

- 拨动遥控器的SW-B拨杆,到中间位置,切换到RC_POS_CONTROL模式

- 拨动遥控器的SW-B拨杆,到最下面,切换到COMMAND_CONTROL模式

- 在COMMAND_CONTROL模式下可以使用代码控制无人机飞行了,此处运行代码控制无人机,到达惯性系控制预设点后,飞行一个圆形轨迹,并悬停30秒,随后自动降落

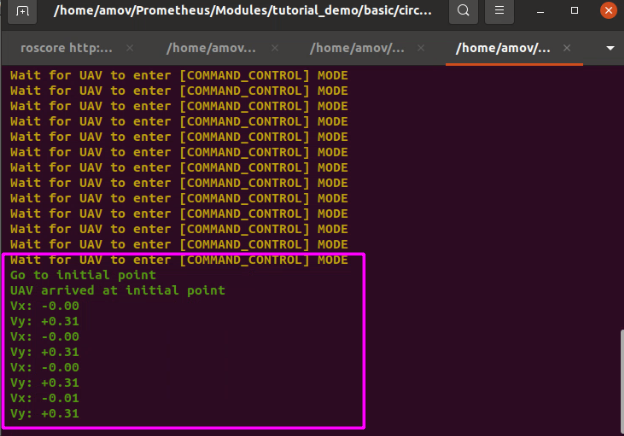

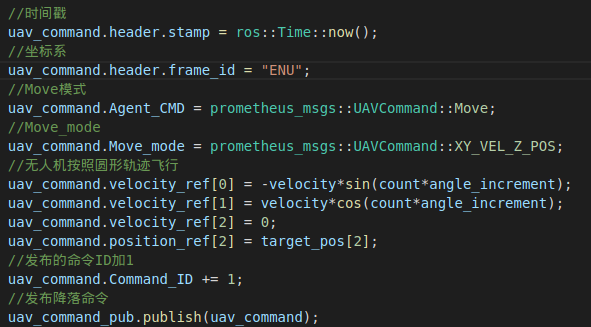

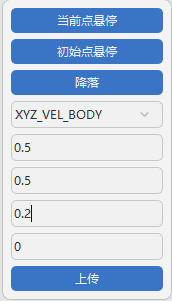

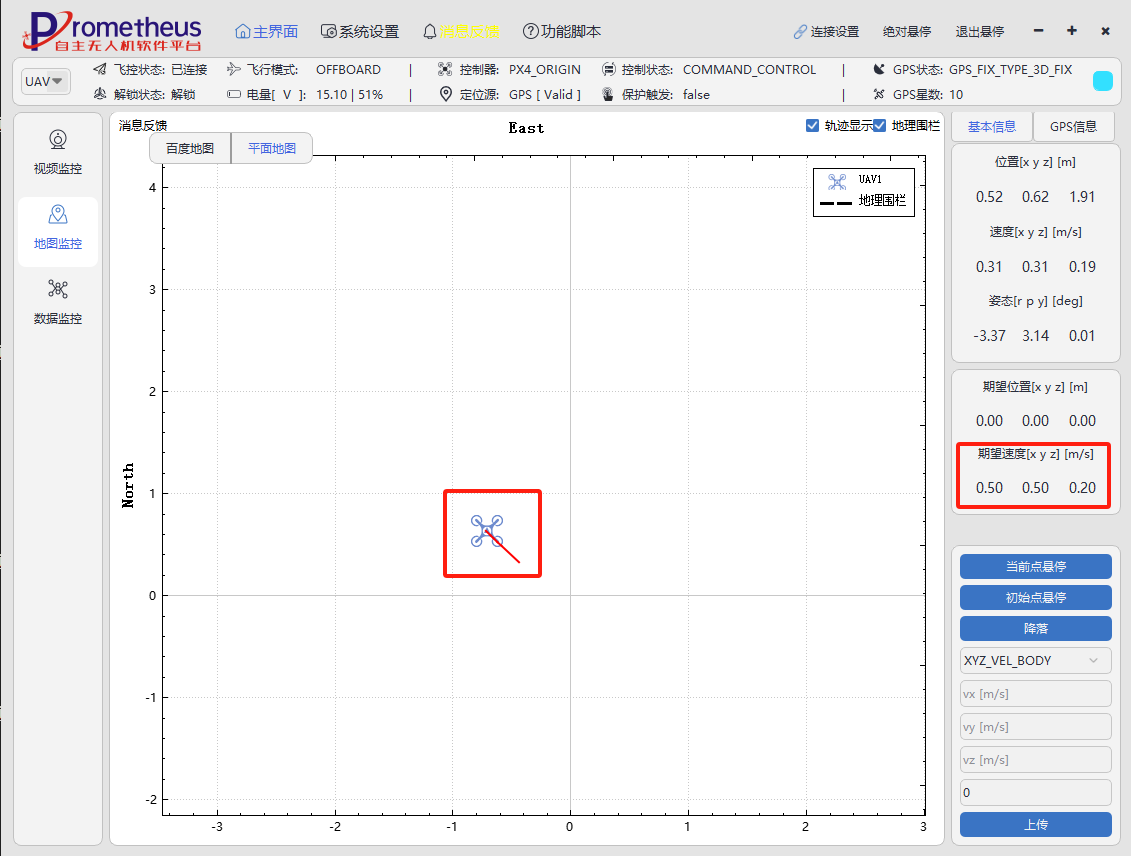

代码讲解

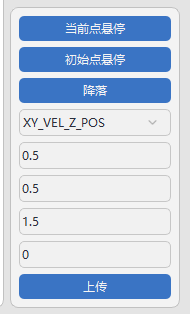

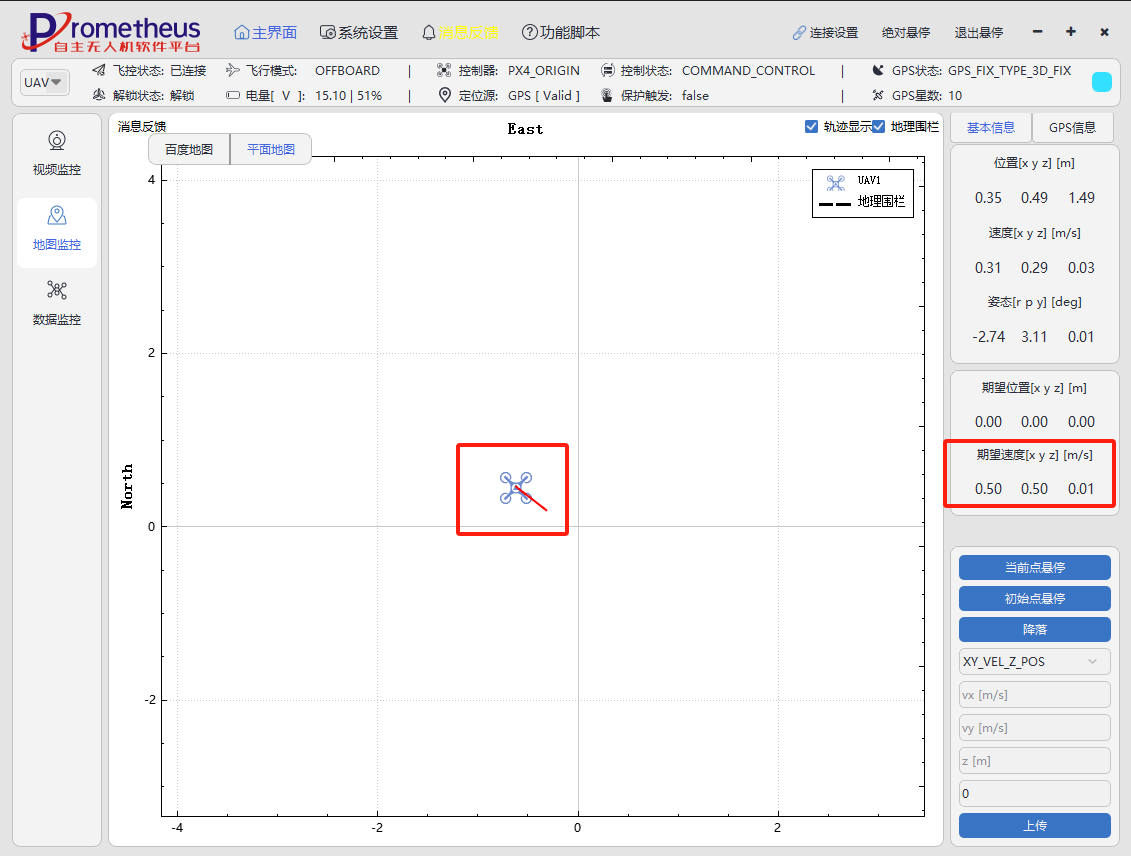

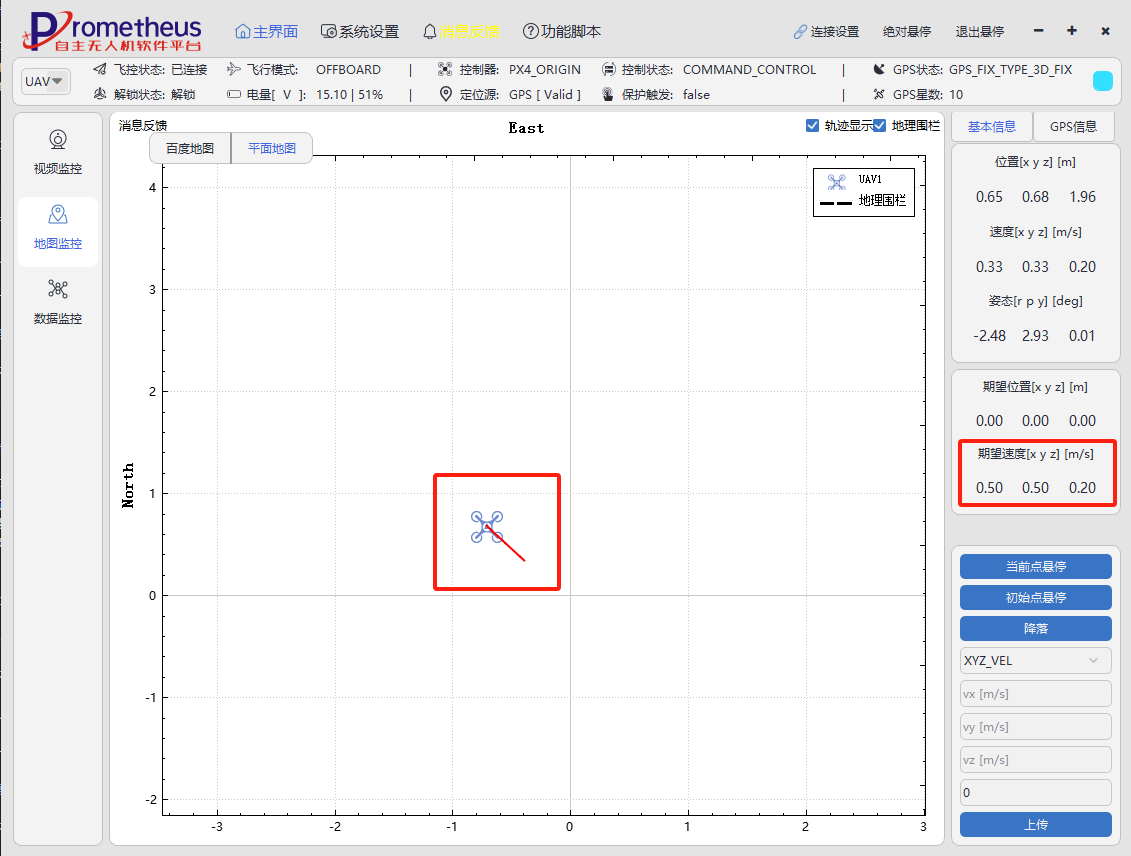

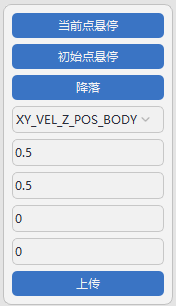

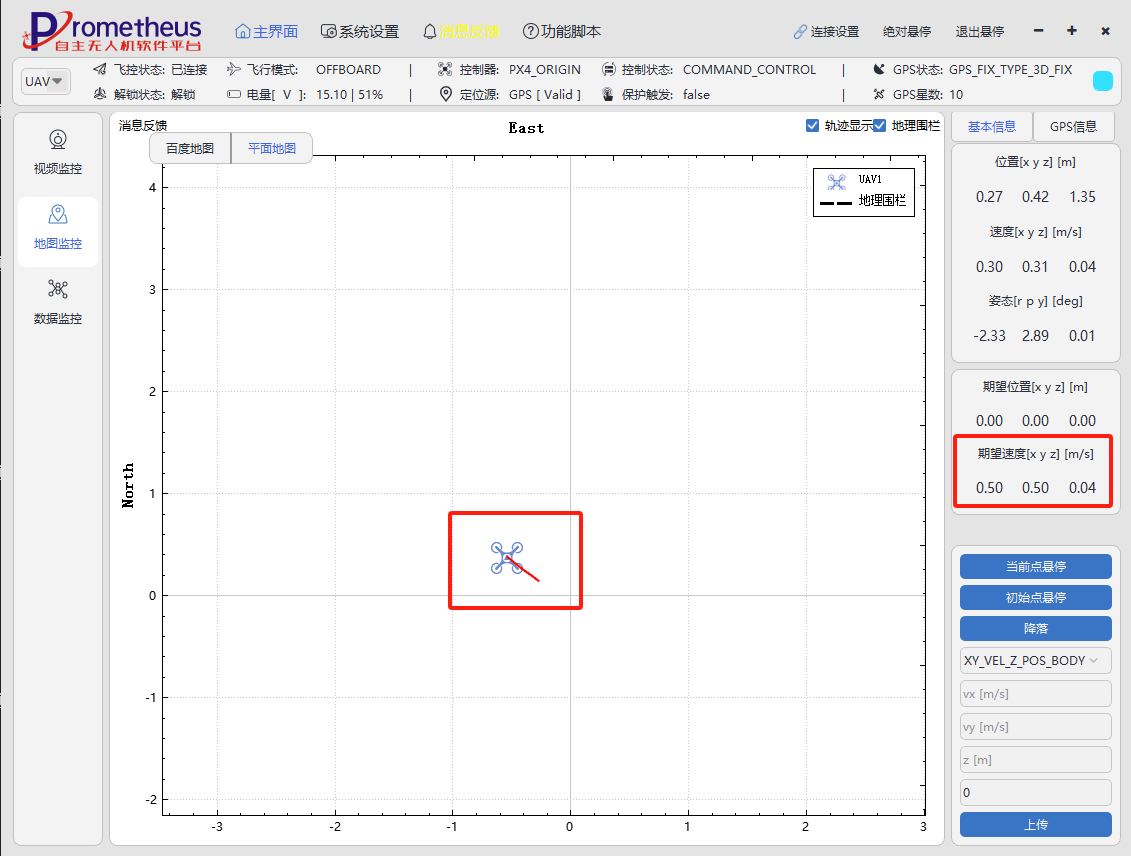

该demo为Prometheus XY_VEL_Z_POS控制接口开发示例,XY_VEL_Z_POS为无人机XY轴速度、Z轴位置(ENU坐标系)的控制模式,核心代码如上图所示;主要是填充以下数据:

- Agent_CMD设置为Move模式

- Move_mode设置为XY_VEL_Z_POS

- 填充XY轴的速度数据以及Z轴的位置数据

- 每发送一次数据,Command_ID加1

无人机控制模块教学例程 - 集群控制

<span style="display: flex; flex-direction: column; width: 100%"><img src = https://qiniu.md.amovlab.com/img/m/202206/20220630/1052294532238464493453312.gif>运行结果展示

集群控制demo对应脚本文件位于

~/Prometheus/Scripts/simulation/tutorial_demo/formation_control/formation_control_P450.sh操作步骤

将遥控器开机并通过USB接口接入电脑

输入以下命令启动集群控制仿真demo

cd ~/Prometheus/Scripts/simulation/tutorial_demo/formation_control # 第一次启动该脚本时,需要添加可执行权限 chmod +x formation_control_P450.sh ./formation_control_P450.sh遥控器SWA档杆向下拨解锁无人机

遥控器SWB档杆拨到中间位置将无人机控制状态切换到RC_POS_CONTROL

遥控器SWB档杆拨到最底部将无人机控制状态切换到COMMAND_CONTROL

此时可通过在终端界面输入相关指令控制无人机集群,如下图所示

- 其中输入0后将输入位置控制数据,控制无人机集群移动

- 输入1后切换无人机集群队形为一字队形(无人机默认以一字队形飞行)

- 输入2后切换无人机集群队形为三角队形

代码讲解

- 接收终端输入的控制指令(集群位置控制、队形切换)

- 将集群控制指令转化为单台无人机控制指令

- 下发单台无人机控制指令

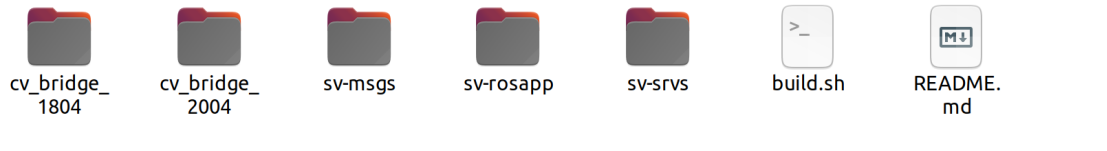

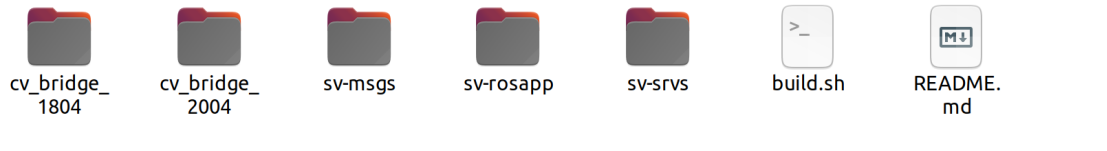

spirecv-ros的大致框架

- 顶层目录

cv_bridge_1804/:包含适用于 Ubuntu 18.04 的 cv_bridge 代码。

cv_bridge_2004/:包含适用于 Ubuntu 20.04 的 cv_bridge 代码。

sv-msgs/:包含消息定义相关的代码。

sv-rosapp/:包含主要的 ROS 应用程序代码。

sv-srvs/:包含服务定义相关的代码。

build.sh:构建项目的脚本,根据操作系统版本选择合适的 cv_bridge 版本,并构建消息、服务和 ROS 应用程序。

README.md:项目介绍和安装教程

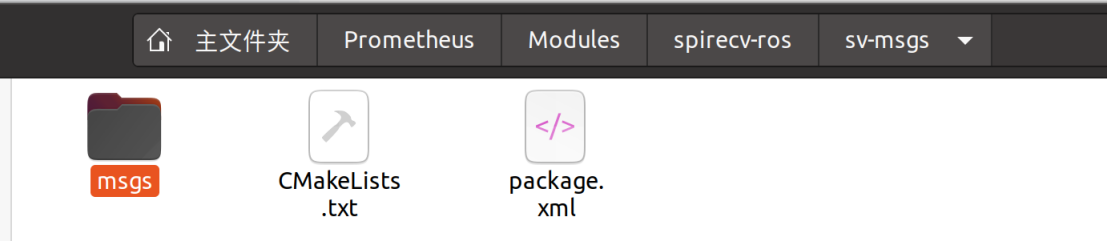

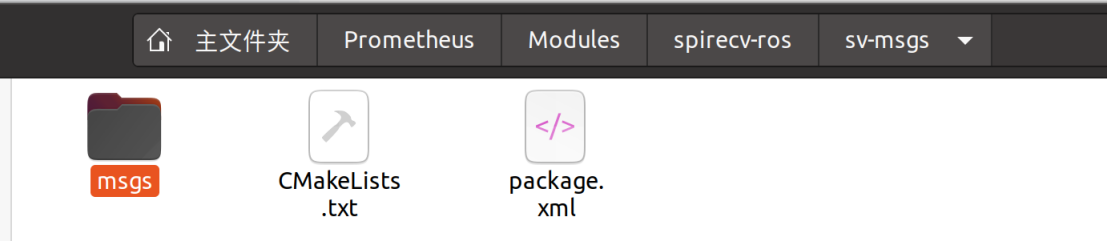

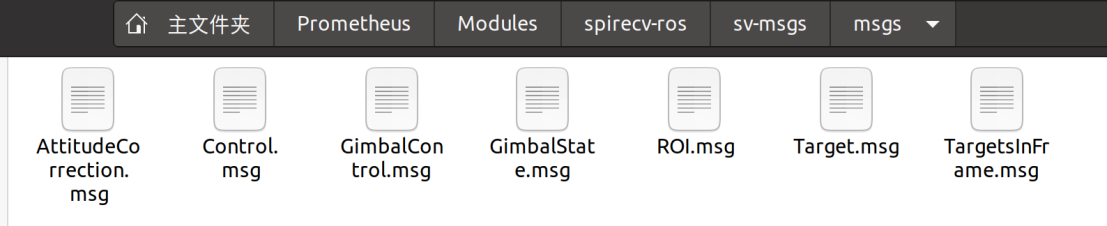

sv-msgs目录

2.1主要目录和文件:

msg/:消息文件目录,包含具体的消息定义文件。

CMakeLists.txt:CMake 构建配置文件。

package.xml:ROS 包描述文件。

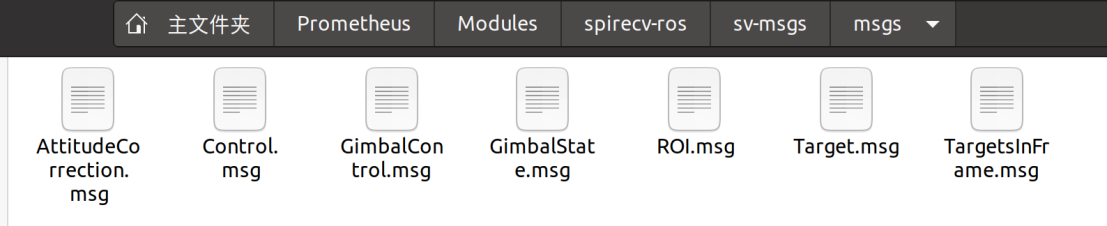

2.2消息文件 (msg/目录)

AttitudeCorrection.msg:姿态校正消息。

Control.msg:控制消息。

GimbalControl.msg:云台控制消息。

GimbalState.msg:云台状态消息。

ROI.msg:感兴趣区域消息。

Target.msg:单个目标消息。

TargetsInFrame.msg:帧内多个目标消息。

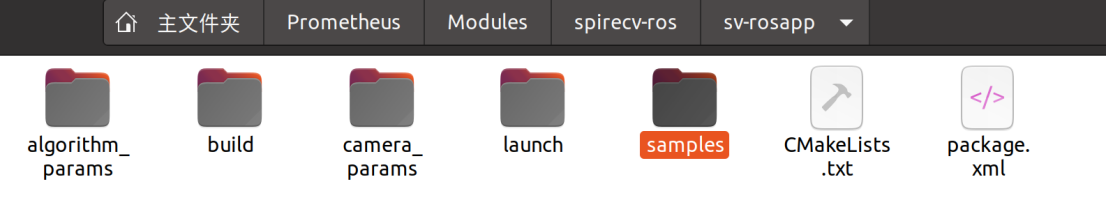

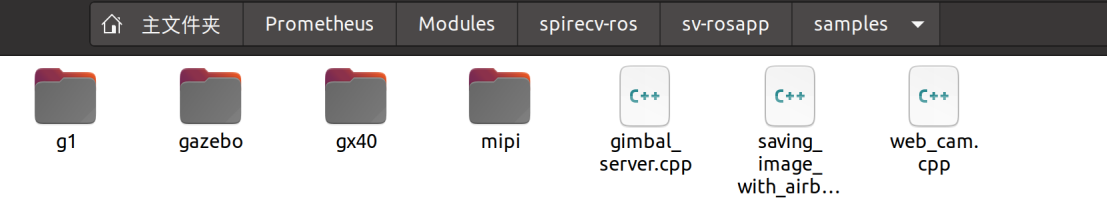

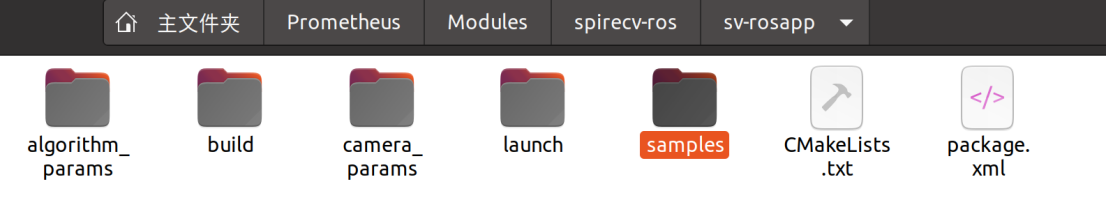

- sv-rosapp 目录内容介绍

algorithm_params/:该目录下的文件用于定义和配置各种算法的参数。build/:这是 CMake 的默认构建目录,存储了编译过程中的中间文件和最终生成的二进制文件。

camera_params/:该目录包含相机校准文件,用于校正相机的内参和外参,以保证图像处理算法的准确性。

launch/:包含用于启动 ROS 节点的 launch 文件。launch 文件可以配置多个节点、参数和启动顺序,方便一次性启动整个系统。

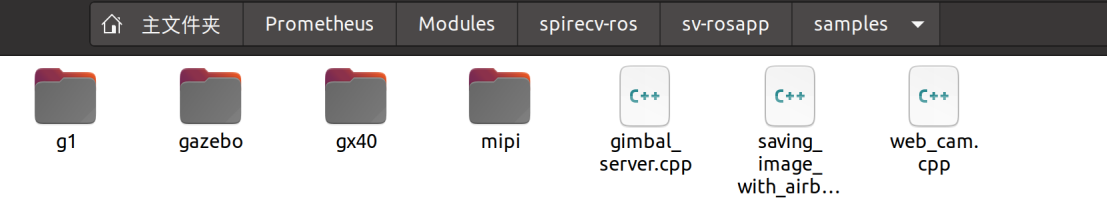

samples/:提供了多个示例代码和样本项目,展示了如何使用该包的功能。

g1/目录:包含与g1设备相关的示例代码

gazebo/目录:包含与gazebo仿真环境相关的示例代码

gx40/目录:包含与gx40设备相关的示例代码

mipi/目录:包含与mipi设备相关的示例代码

gimbal_server.cpp:该文件用于控制云台的服务端

saving_image_with_airball.cpp:该文件用于保存图像

web_cam.cpp:该文件使用网络摄像头进行图像捕获和处理

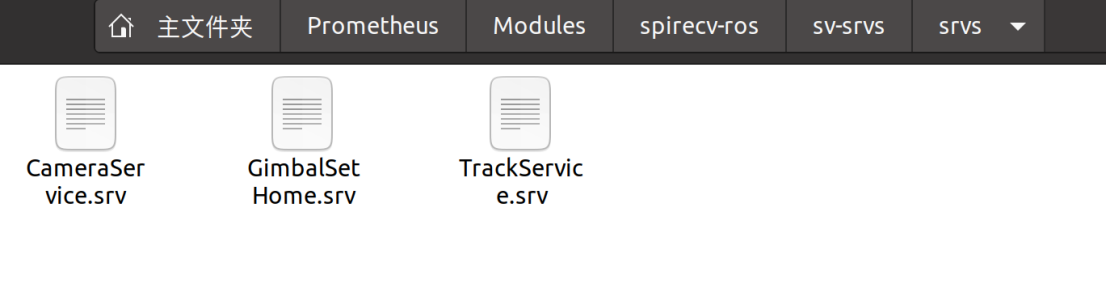

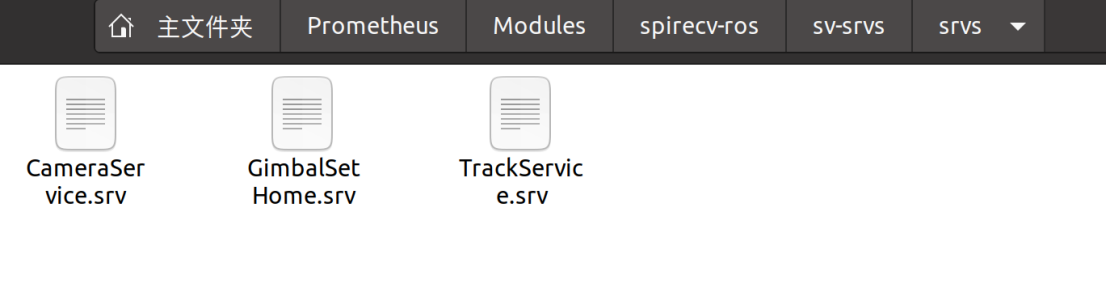

- sv-srvs目录内容介绍

CameraService.srv:定义了一个相机服务

GimbalSetHome.srv:定义了一个设置云台回到初始位置的服务

TrackService.srv:定义了一个目标跟踪服务

spirecv-ros的大致框架

- 顶层目录

cv_bridge_1804/:包含适用于 Ubuntu 18.04 的 cv_bridge 代码。

cv_bridge_2004/:包含适用于 Ubuntu 20.04 的 cv_bridge 代码。

sv-msgs/:包含消息定义相关的代码。

sv-rosapp/:包含主要的 ROS 应用程序代码。

sv-srvs/:包含服务定义相关的代码。

build.sh:构建项目的脚本,根据操作系统版本选择合适的 cv_bridge 版本,并构建消息、服务和 ROS 应用程序。

README.md:项目介绍和安装教程

sv-msgs目录

2.1主要目录和文件:

msg/:消息文件目录,包含具体的消息定义文件。

CMakeLists.txt:CMake 构建配置文件。

package.xml:ROS 包描述文件。

2.2消息文件 (msg/目录)

AttitudeCorrection.msg:姿态校正消息。

Control.msg:控制消息。

GimbalControl.msg:云台控制消息。

GimbalState.msg:云台状态消息。

ROI.msg:感兴趣区域消息。

Target.msg:单个目标消息。

TargetsInFrame.msg:帧内多个目标消息。

- sv-rosapp 目录内容介绍

algorithm_params/:该目录下的文件用于定义和配置各种算法的参数。build/:这是 CMake 的默认构建目录,存储了编译过程中的中间文件和最终生成的二进制文件。

camera_params/:该目录包含相机校准文件,用于校正相机的内参和外参,以保证图像处理算法的准确性。

launch/:包含用于启动 ROS 节点的 launch 文件。launch 文件可以配置多个节点、参数和启动顺序,方便一次性启动整个系统。

samples/:提供了多个示例代码和样本项目,展示了如何使用该包的功能。

g1/目录:包含与g1设备相关的示例代码

gazebo/目录:包含与gazebo仿真环境相关的示例代码

gx40/目录:包含与gx40设备相关的示例代码

mipi/目录:包含与mipi设备相关的示例代码

gimbal_server.cpp:该文件用于控制云台的服务端

saving_image_with_airball.cpp:该文件用于保存图像

web_cam.cpp:该文件使用网络摄像头进行图像捕获和处理

- sv-srvs目录内容介绍

CameraService.srv:定义了一个相机服务

GimbalSetHome.srv:定义了一个设置云台回到初始位置的服务

TrackService.srv:定义了一个目标跟踪服务

教学历程

敬请期待!正在进一步完善中!!!!!

源码解析

二维码点击跟踪代码讲解

- 当 ROS 系统正常运行时,检查是否接收到新的 ROS 图像,重置 get_ros_img 标志,并将 ROS 图像克隆到本地图像变量 img

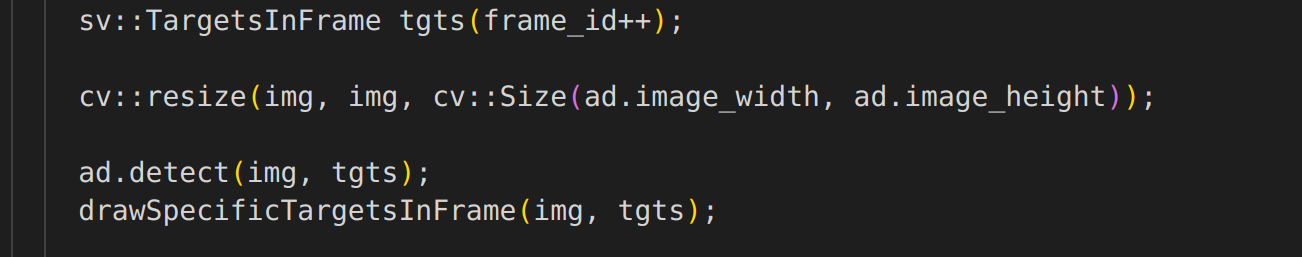

- 创建一个 SpireCV 库的 TargetsInFrame 类的实例,用于保存单帧的检测结果,并递增帧 ID,将图像调整为 ad 指定的宽度和高度,在图像上运行检测,并在帧中绘制特定目标,即在检测的时候显示所有的二维码检测框,在追踪的时候,只显示追踪的二维码检测框

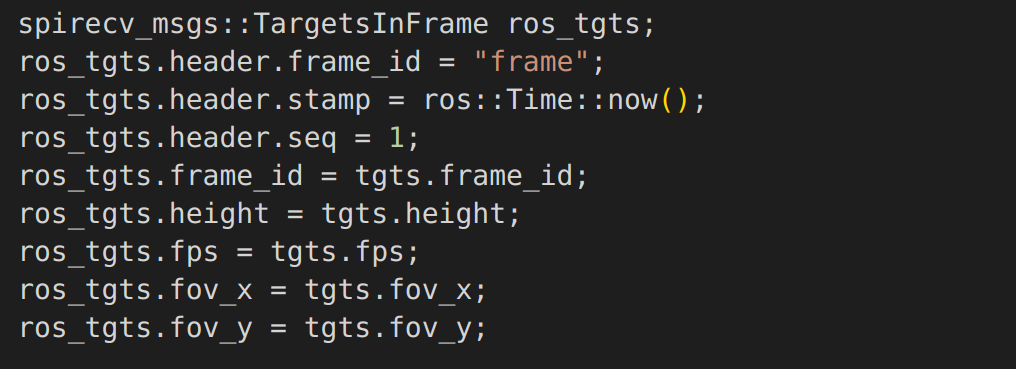

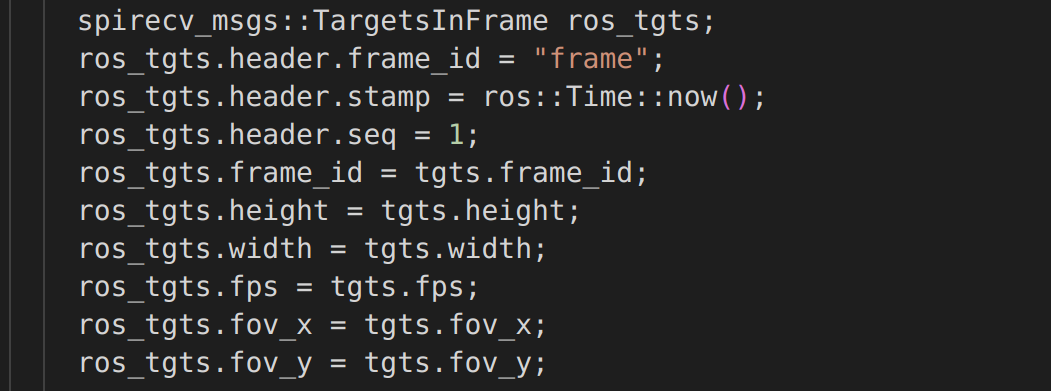

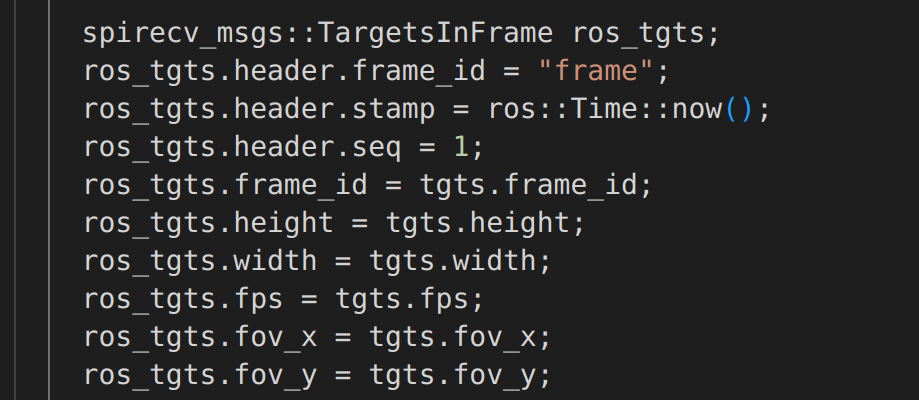

- 初始化一个 ROS 消息 ros_tgts,用于保存帧中的目标,并设置其元数据。

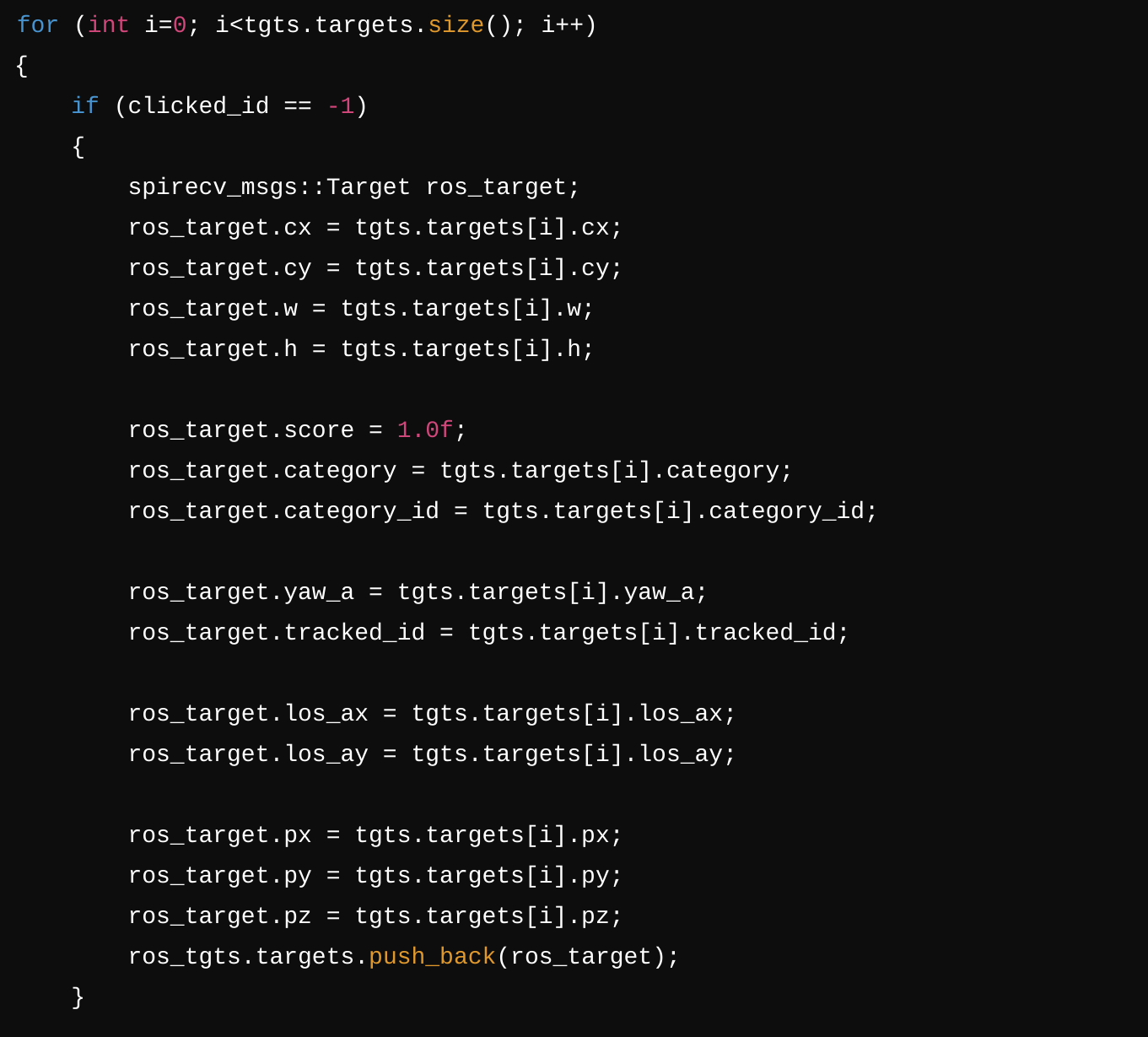

- 遍历所有检测到的目标,如果 clicked_id 未设置,将目标添加到 ROS 消息中。

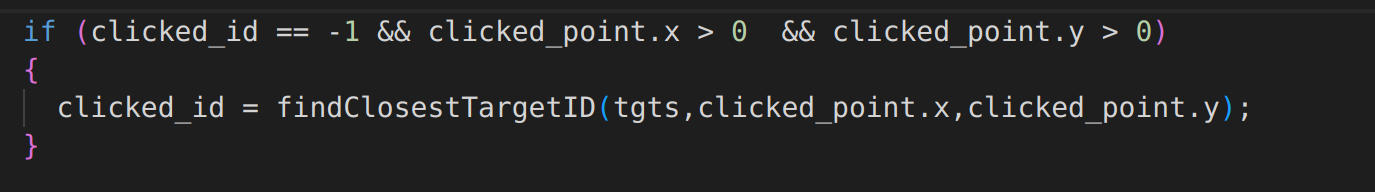

- 如果此前没有二维码被点击,并且当前被点击了,找到被点击的二维码的id

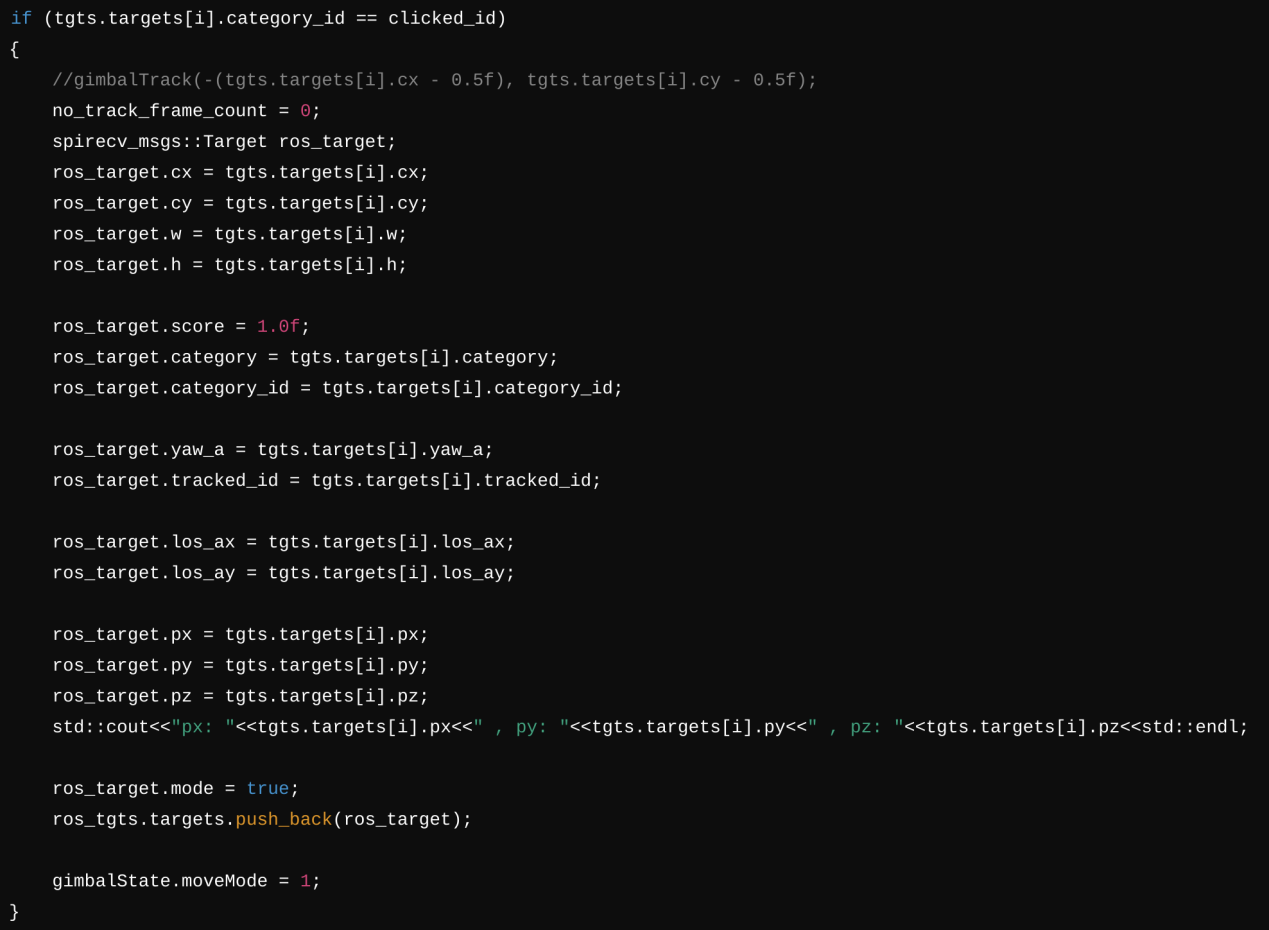

- 如果二维码ID 匹配 clicked_id,则重置 no_track_frame_count,将目标添加到 ROS 消息,并设置云台状态为跟踪模式。

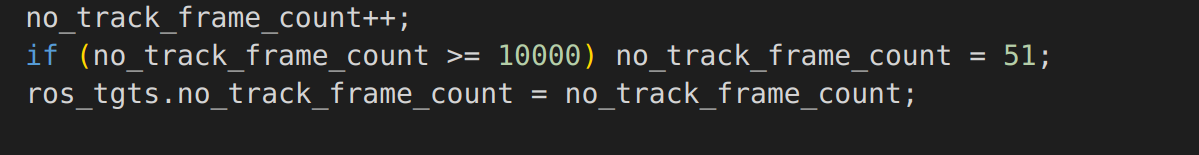

- no_track_frame_count标志位可以控制吊舱的移动和停止

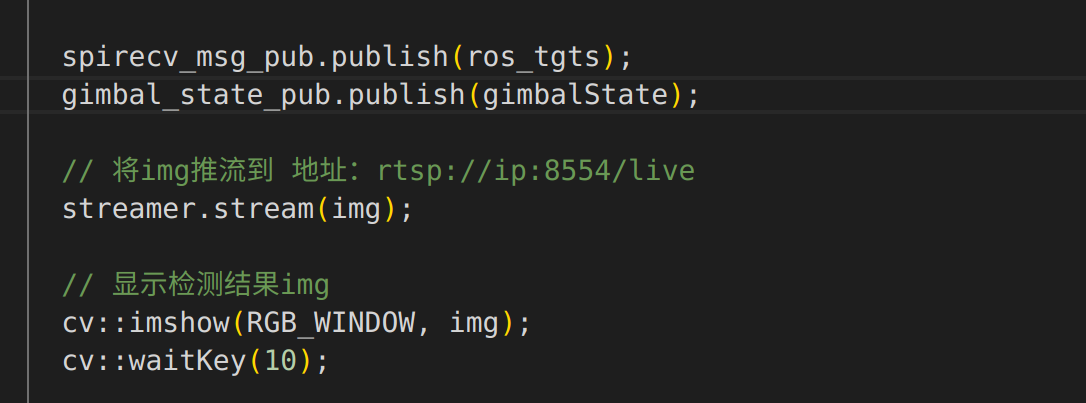

- 将目标和云台状态发布到各自的 ROS 话题,将图像推流到指定的 RTSP 地址,并在窗口中显示图像

通用目标点击跟踪

- 当 ROS 系统正常运行时,检查是否接收到新的 ROS 图像,重置 get_ros_img 标志,并将 ROS 图像克隆到本地图像变量 img

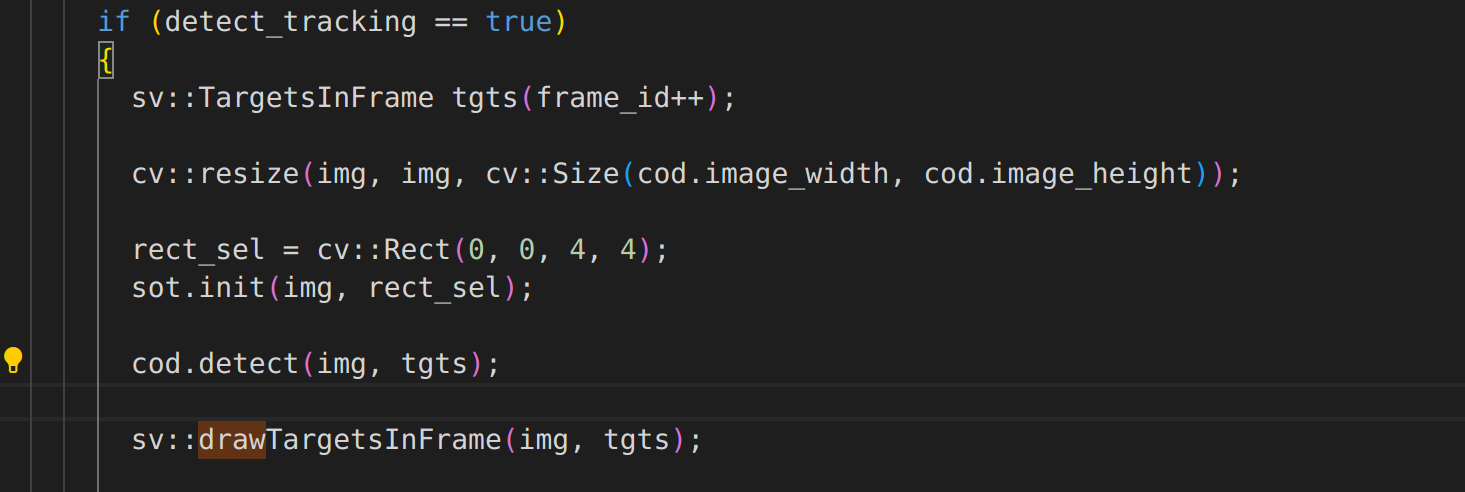

- 如果处于检测状态,创建一个 TargetsInFrame 实例,用于存储检测结果,并递增帧 ID,将图像调整到指定的宽度和高度,使用调整后的图像和选定区域,初始化跟踪矩形和跟踪器,在图像上执行通用目标检测,将检测目标显示在图像上面

- 创建一个检测的ROS 消息 ros_tgts,用于保存帧中的目标,并设置其元数据。

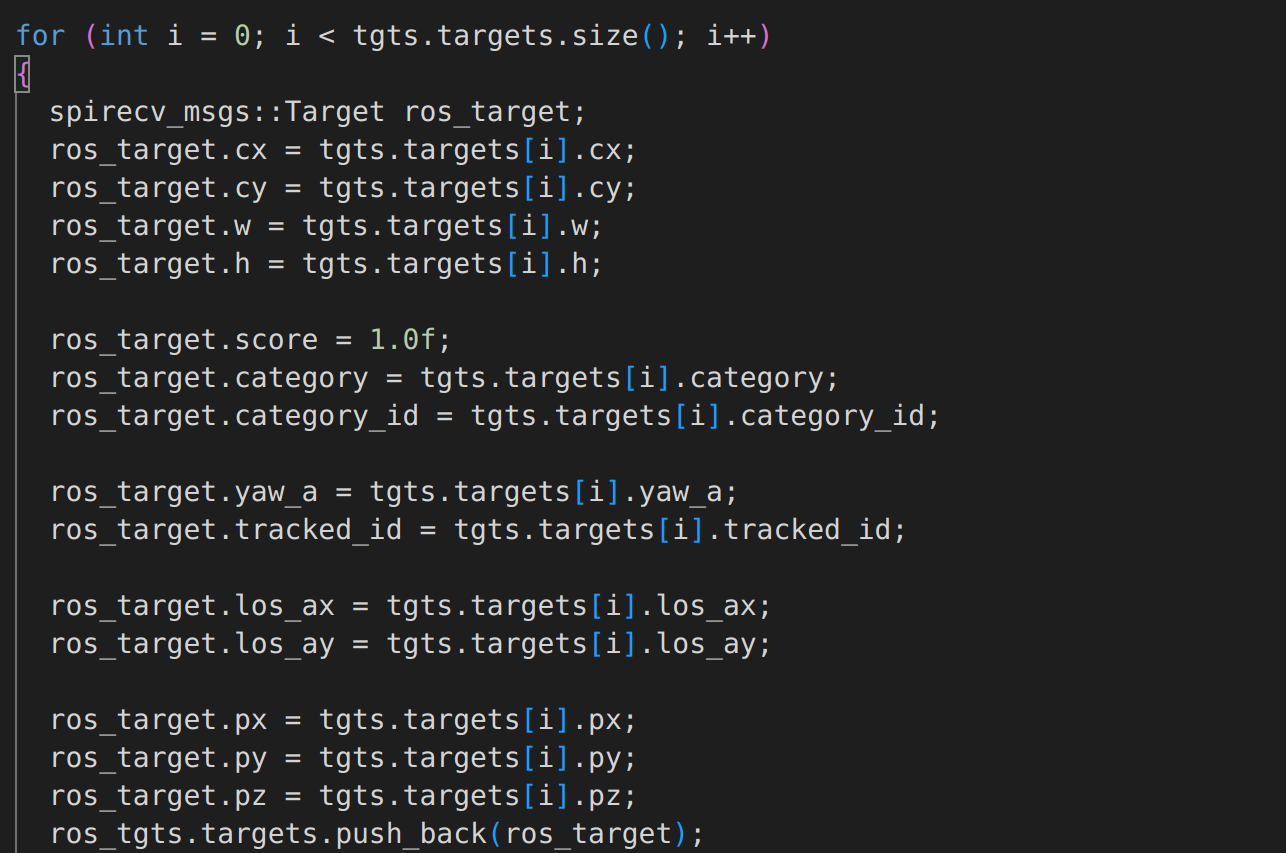

- 遍历检测到的目标,将每个目标的详细信息填充到 ROS 消息中,包括中心坐标、尺寸、置信度、类别、视线角度、跟踪 ID 和 3D 位置。

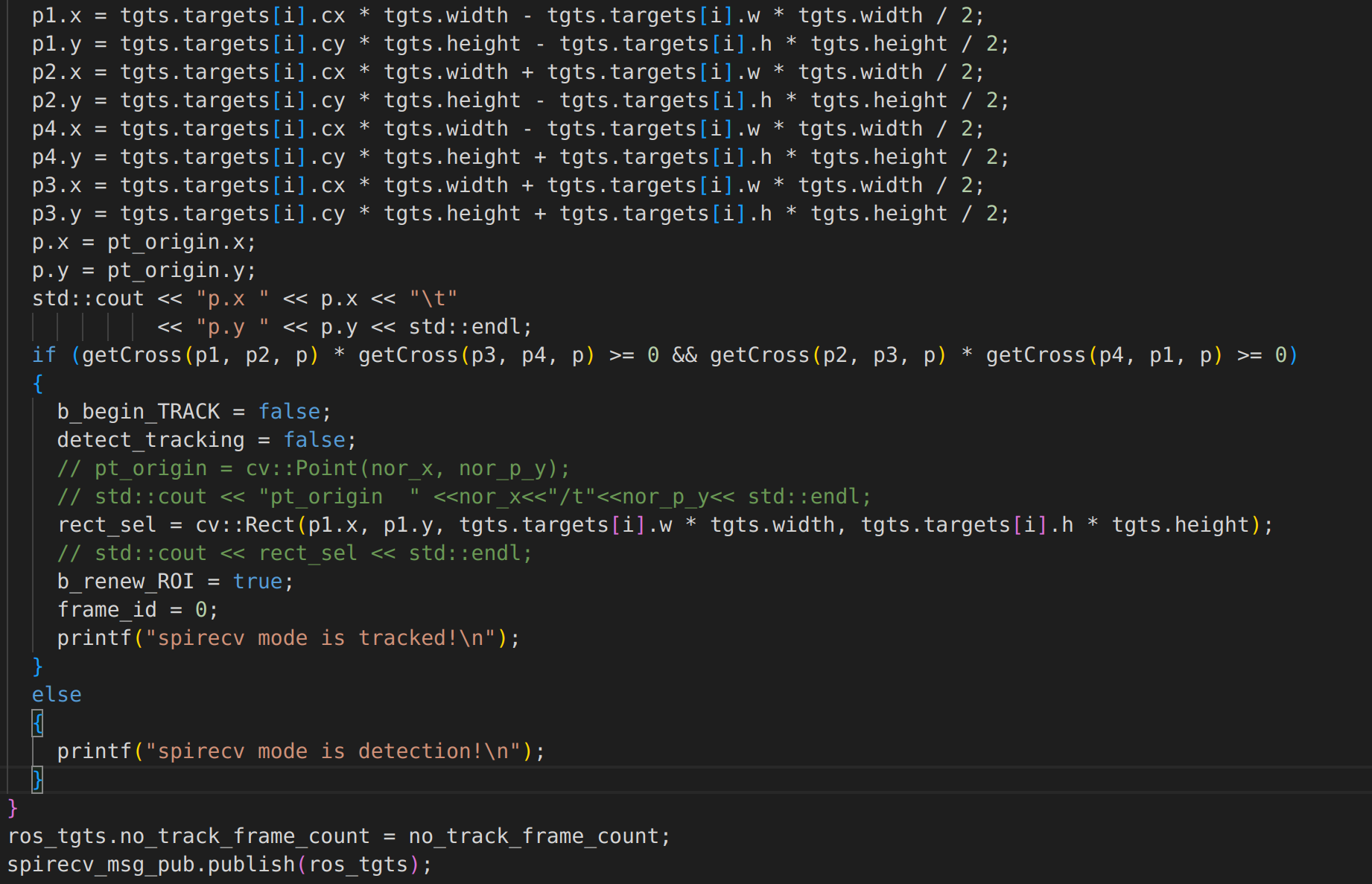

- 计算目标外接矩形框的四个顶点坐标 ,使用叉乘方法确定被点击的点是否在目标的外接矩形框内。如果是,则更新跟踪状态,初始化新的 ROI,并打印模式状态,发布检测结果到 ROS 主题

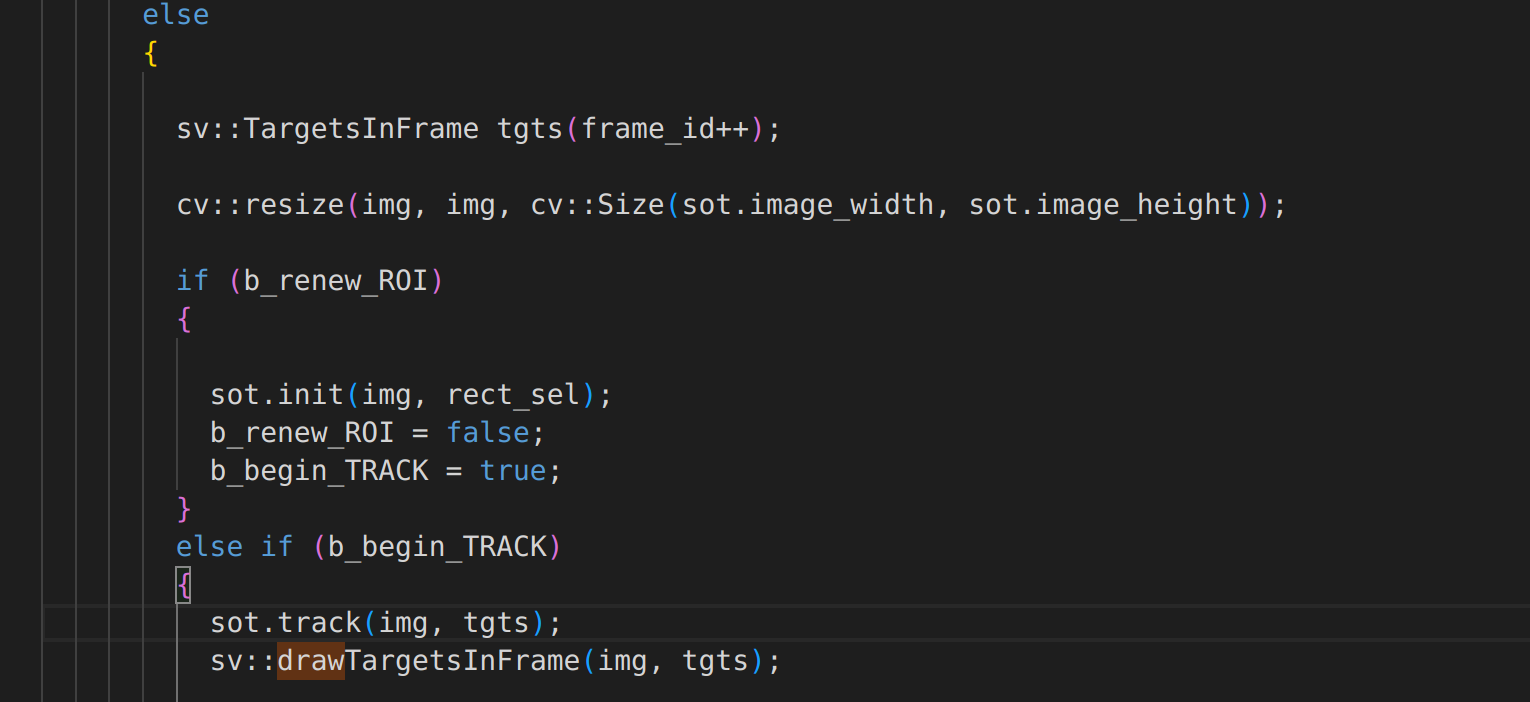

- 如果处于追踪状态,创建一个 TargetsInFrame 实例,用于存储检测结果,并递增帧 ID,将图像调整到指定的宽度和高度,如果有新的框选区域,则重新初始化跟踪器,开始追踪,显示追踪框

- 创建一个追踪的ROS 消息 TargetsInFrame 并填充相关元数据

- 如果有追踪目标,则创建 spirecv_msgs::Target 消息并填充和发布目标数据,包括中心坐标、宽度、高度、视线角、3D 位置等。

原理讲解

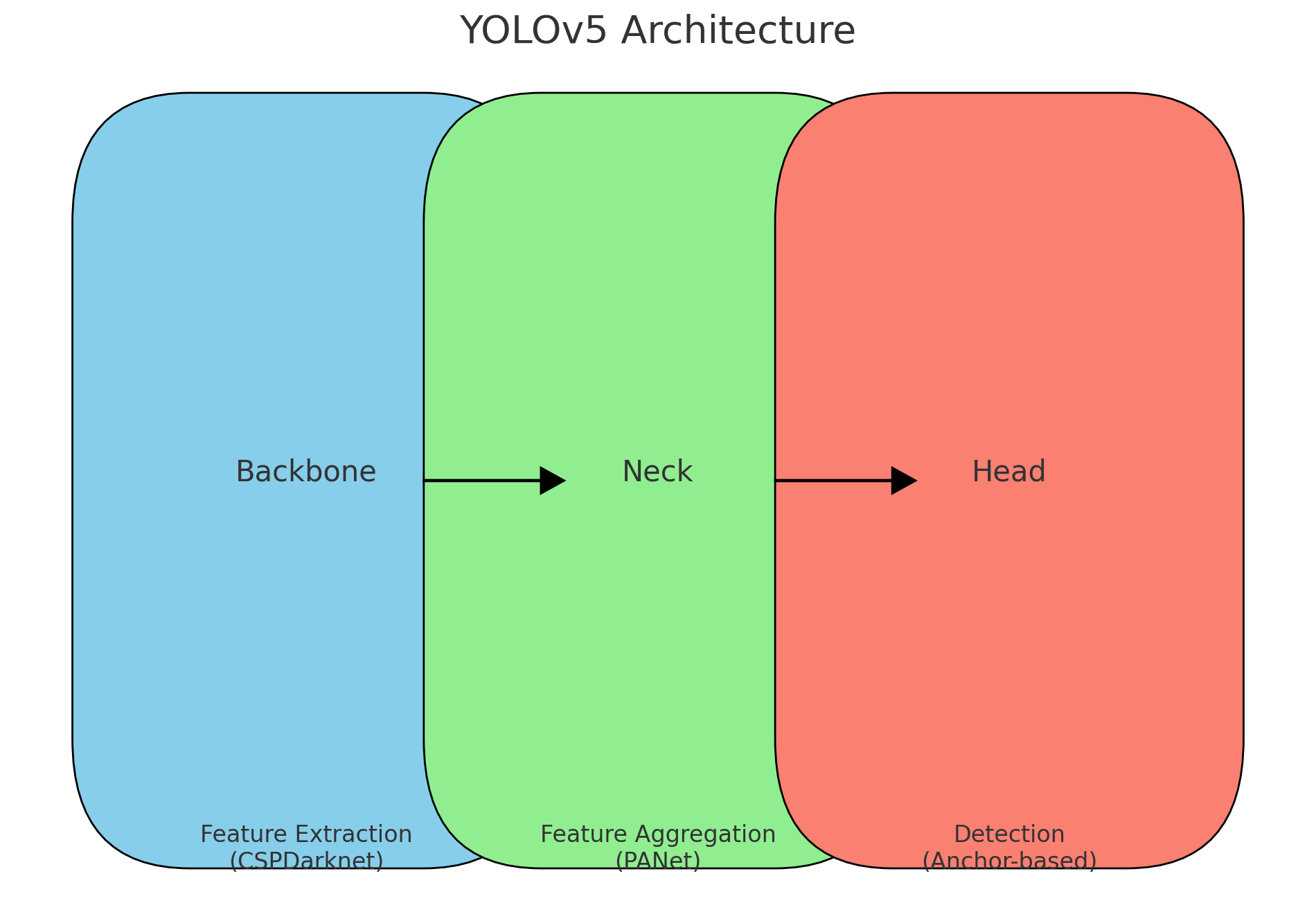

Backbone:特征提取网络,用于从输入图像中提取特征。YOLOv5使用的是CSPDarknet。

Neck:特征融合层,用于融合不同尺度的特征。YOLOv5采用的是PANet(Path Aggregation Network)。

Head:检测头,用于生成最终的检测结果,包括目标的类别和边界框。

详细流程

输入图像

输入图像被调整到统一的尺寸(如640x640像素),并进行归一化处理。

Backbone(特征提取)

Backbone部分采用CSPDarknet,该网络通过多个卷积层和残差块,从图像中提取出多层次的特征。

Neck(特征融合)

Neck部分使用了PANet,结合了不同层次的特征,通过上采样和下采样操作,使得高层特征和低层特征有效融合,从而提高了检测效果。

Head(检测头)

Head部分采用了YOLOv5的检测头,分为三个尺度(大、中、小),每个尺度负责检测不同大小的目标。每个尺度上的每个位置会预测一个锚框,并给出该框的类别概率和边界框偏移量。

损失函数

YOLOv5的损失函数由三部分组成:

边界框回归损失:用于衡量预测边界框与真实边界框的差异,通常使用GIoU或DIoU损失。

置信度损失:用于衡量是否存在目标的置信度差异。

类别损失:用于衡量预测类别与真实类别的差异,通常使用交叉熵损失。

训练和推理

训练

训练过程中,模型通过前向传播计算输出,通过损失函数计算误差,再通过反向传播更新模型参数。YOLOv5采用了数据增强技术,如随机裁剪、颜色抖动等,提升模型的鲁棒性。

推理

推理过程中,输入图像经过模型后,输出检测结果。通过NMS(非极大值抑制)处理,去除冗余的检测框,只保留置信度最高的框。

优势与改进

YOLOv5相比于之前版本和其他目标检测模型,具有以下优势:

高效:能在保持高精度的同时,实现实时检测。

简洁:模型架构简洁,易于理解和实现。

灵活:支持多种输入尺寸,能够检测多尺度目标。

增强训练:采用了更好的数据增强和损失函数,提高了模型性能。

扩展阅读

如何训练自己的模型

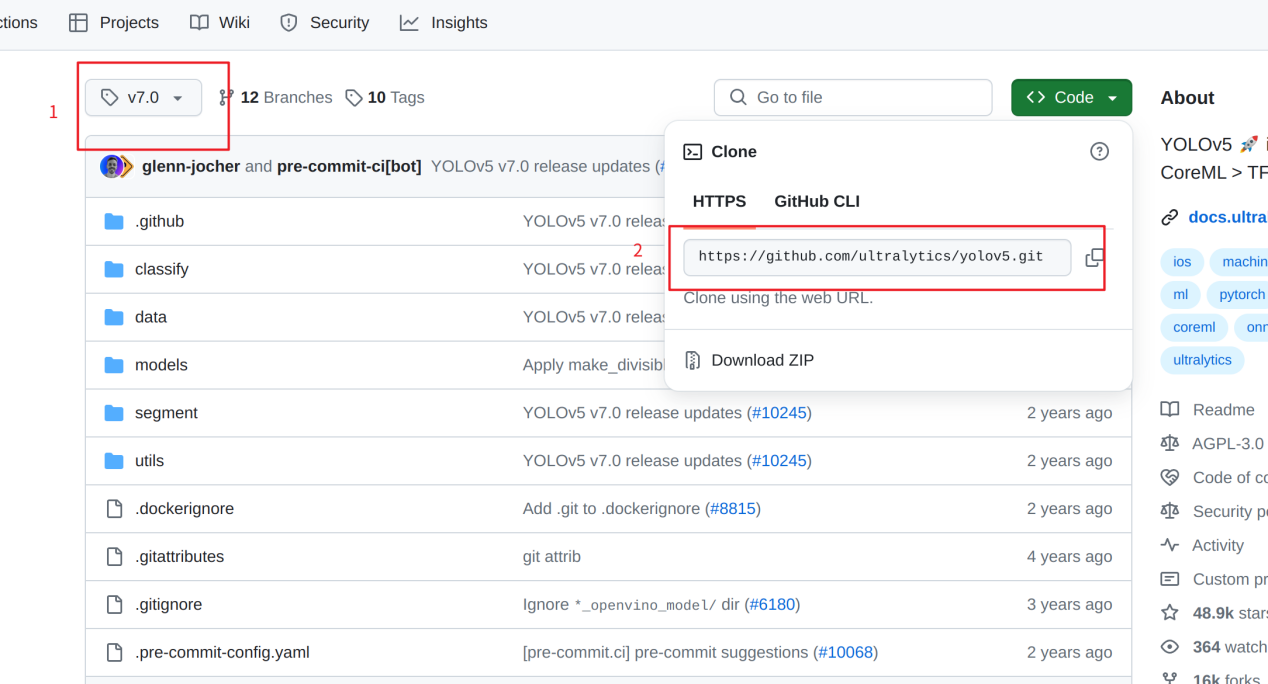

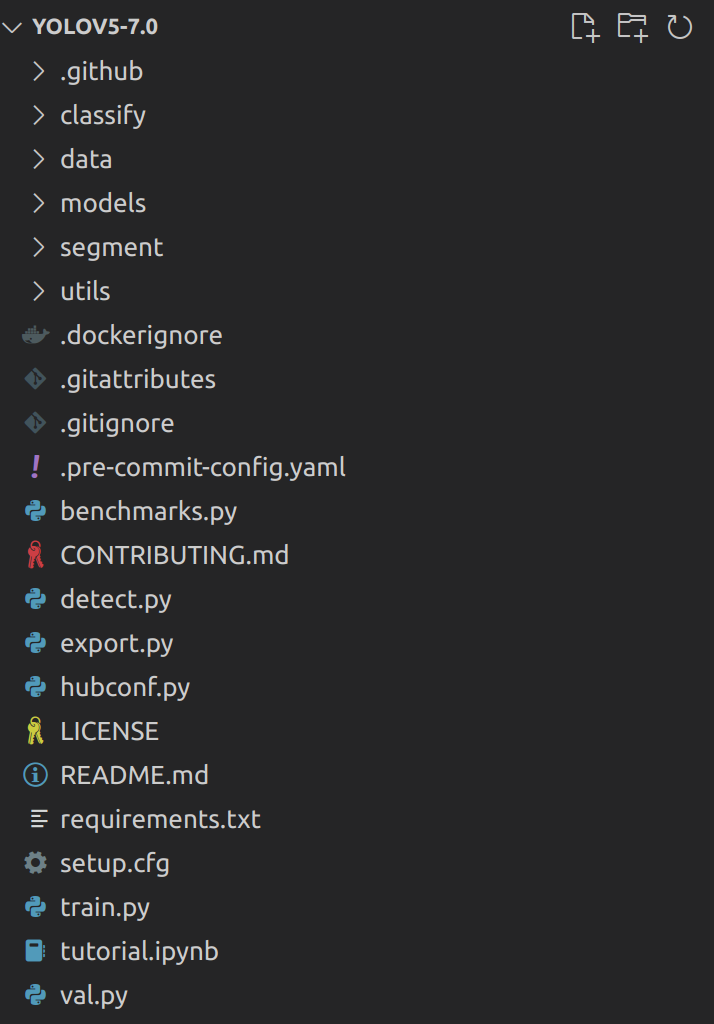

- 打开github,克隆yolov5 7.0

- 了解一下整个目录结构

- data:主要是存放一些超参数的配置文件,用来配置训练集和测试集还有验证集的路径的

- models:里面主要是一些网络构建的配置文件和函数

- utils:存放的是工具类的函数

- weights:放置训练好的权重参数。

- detect.py:利用训练好的权重参数进行目标检测

- train.py:训练自己的数据集的函数。

- test.py:测试训练的结果的函数。

- requirements.txt:yolov5项目的环境依赖包(pip install -r requirements.txt)

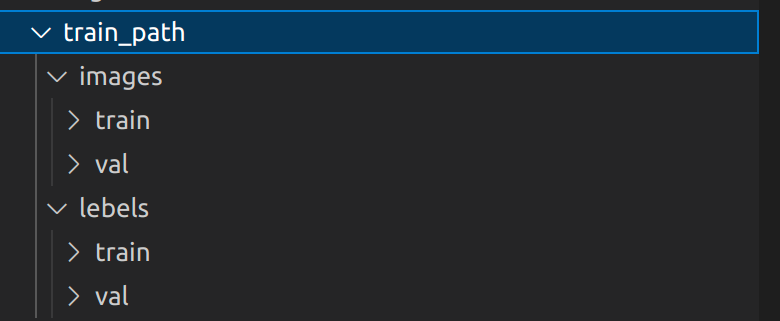

- 数据标注好,划分训练集和验证集,创建目录,将其放到对应图像和标签目录里面 数据如何标注请看5.2怎么打标签 标签转化请看5.3标注文件的相互转化 划分训练集和验证集请看5.4 划分数据集和验证集

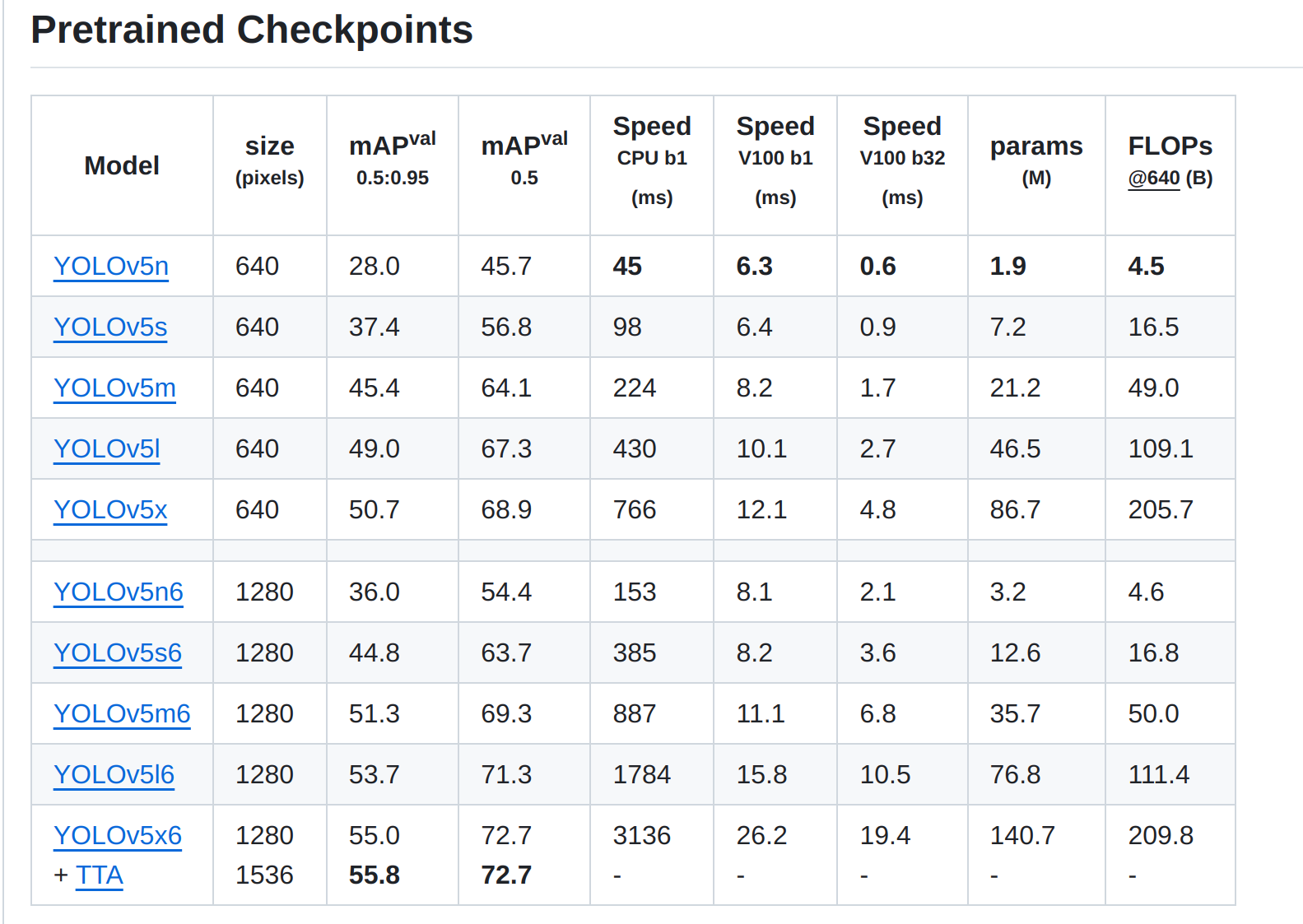

- 获取预训练权重 进入此网站https://github.com/ultralytics/yolov5/releases,放到yolov5

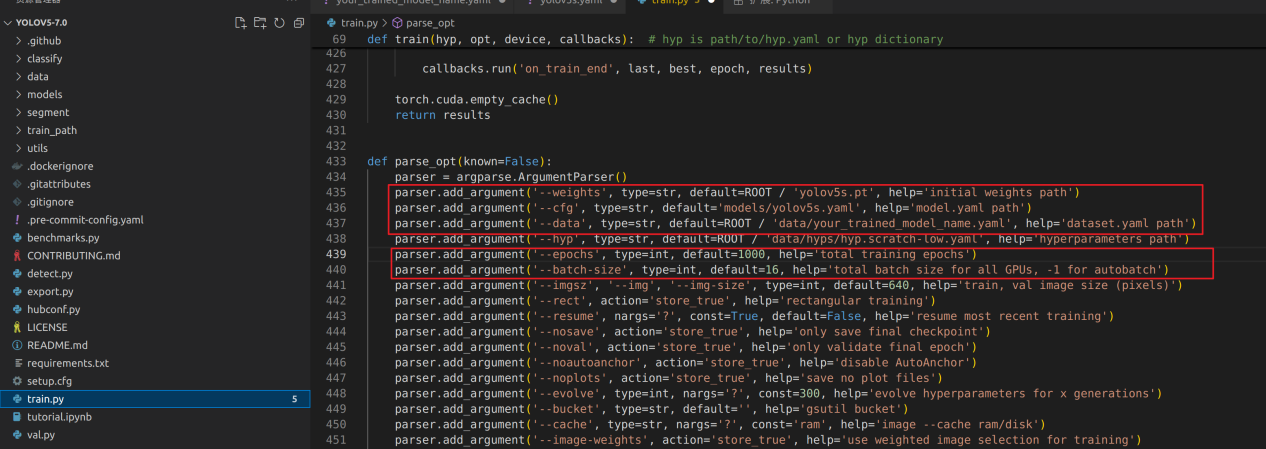

- 修改配置文件,准备训练

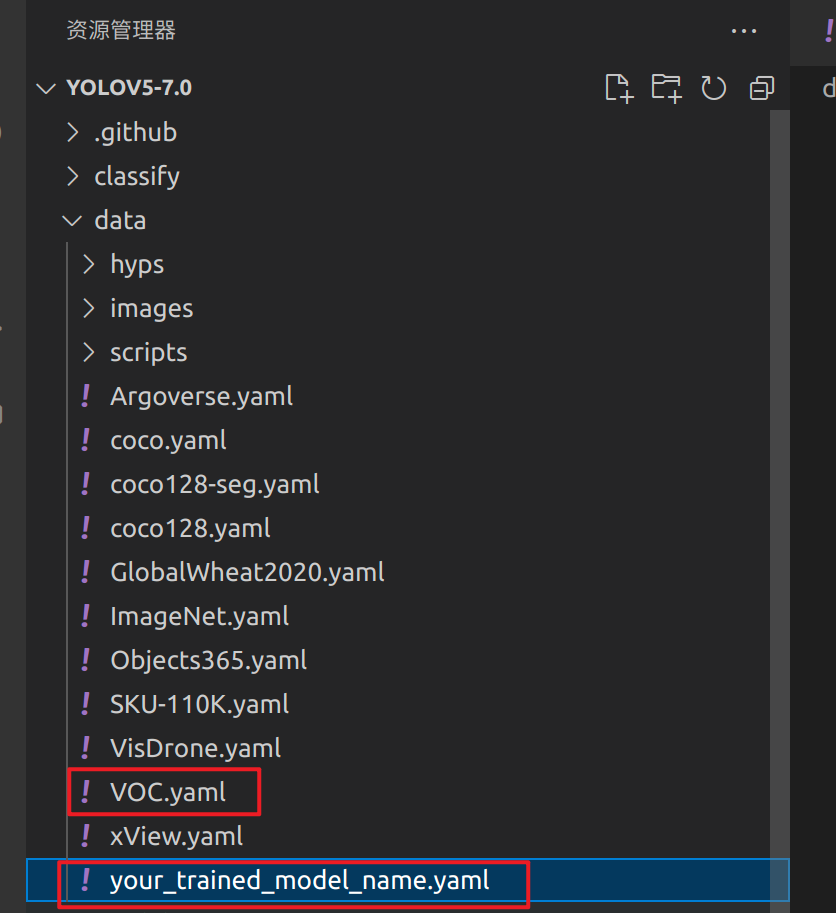

复制一份VOC.yaml,命名一个跟自己模型相关的名字

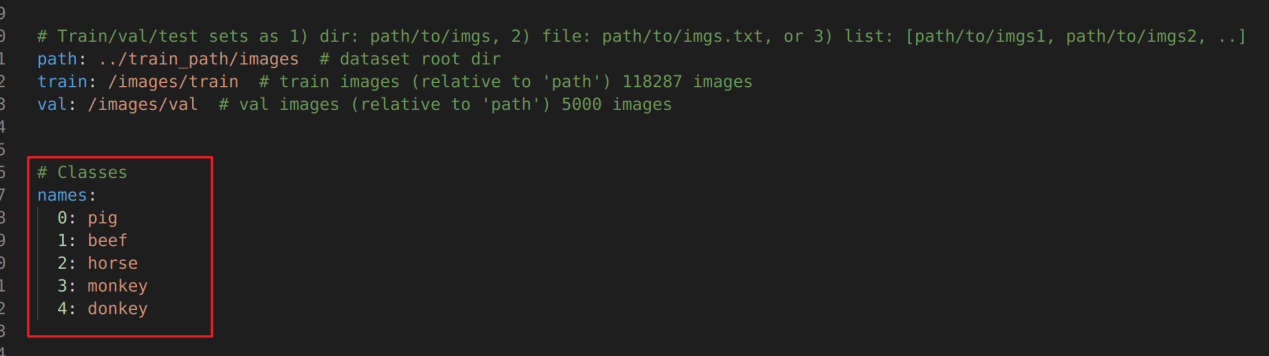

写好之前创建好的目录,然后写上要训练的类别

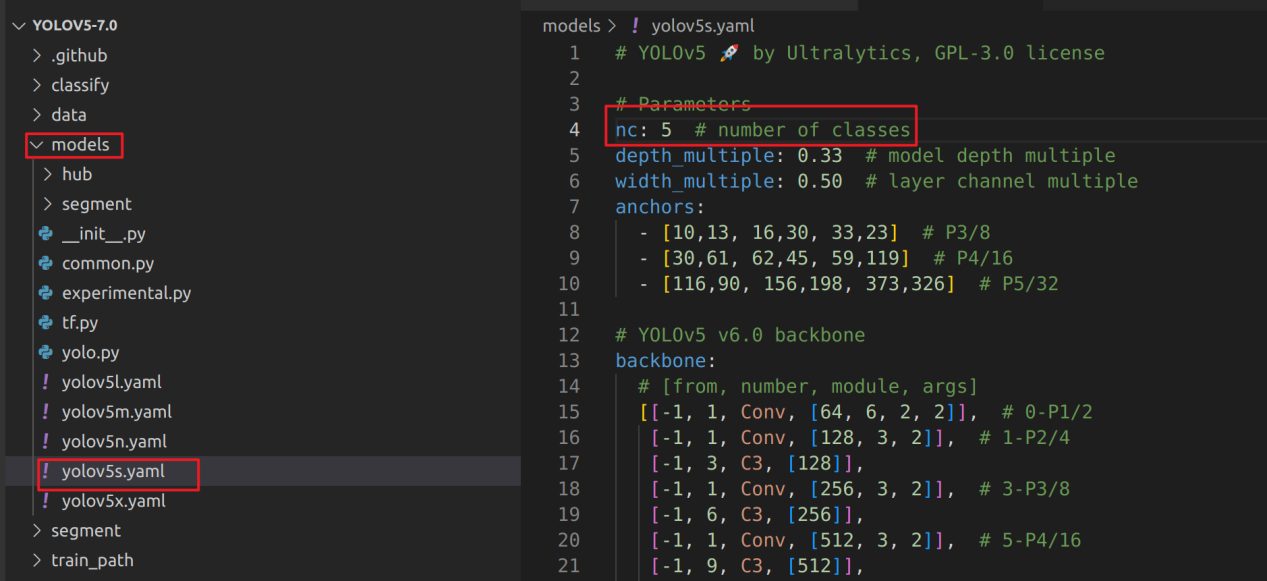

假设你要训练的是yolov5s的模型,在models文件夹的yolov5s.yaml文件里面修改类别的数量,改为5

在train.py文件里面,修改模型的pt文件(默认在yolov5-7.0主目录下),yolov5s的yaml文件,数据集的yaml文件,训练轮数可以设置为1000,训练到不能提升会自动停下来,batch_size可以根据自己的GPU显存进行调整

怎么打标签

- 打标签工具:labelimg 安装命令 :

pip install labelimg -i https://pypi.tuna.tsinghua.edu.cn/simple

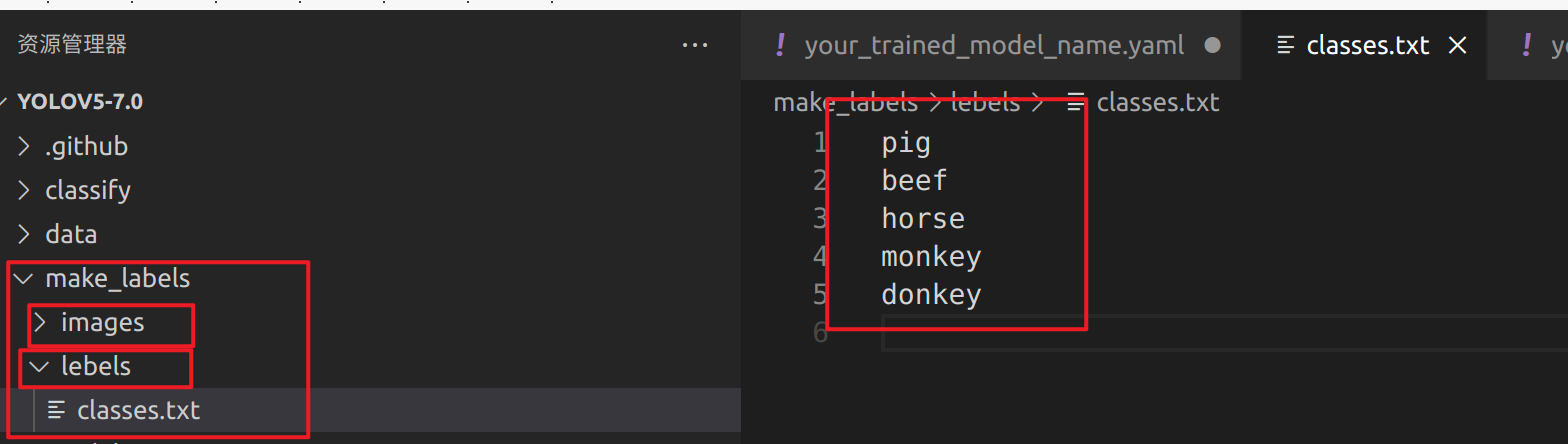

- 创建打标签的目录

├── make_labels │├── images 存放需要打标签的图片文件 │├── lebels 存放标注的标签文件 ││├── classes.txt 定义自己要标注的所有类别(可以没有这个文件)

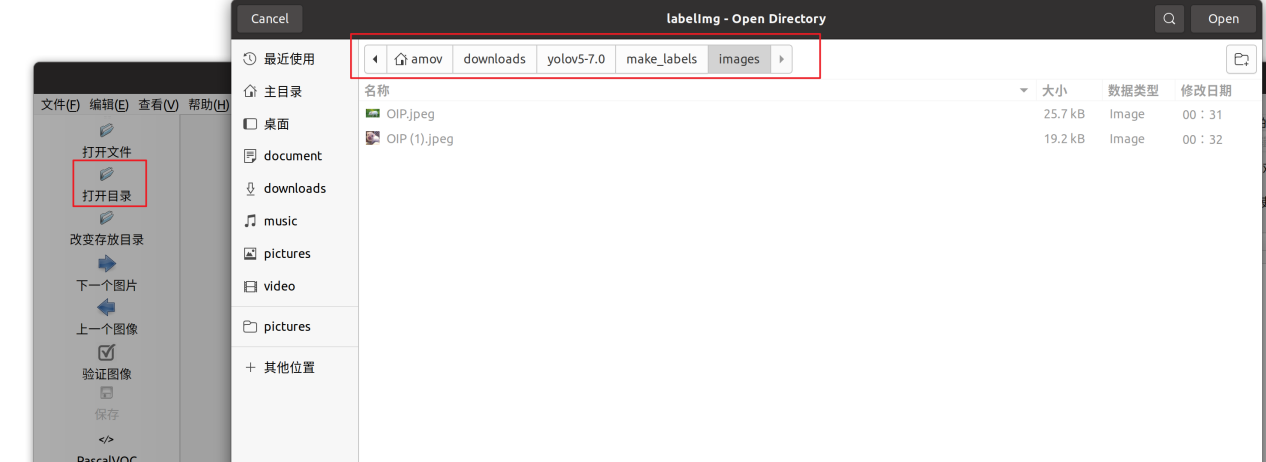

- 打开labelImg软件,打开图片和标签目录,并设置labelimg配置 打开软件的命令如下图 :

labelImg

打开图片目录

打开标签目录

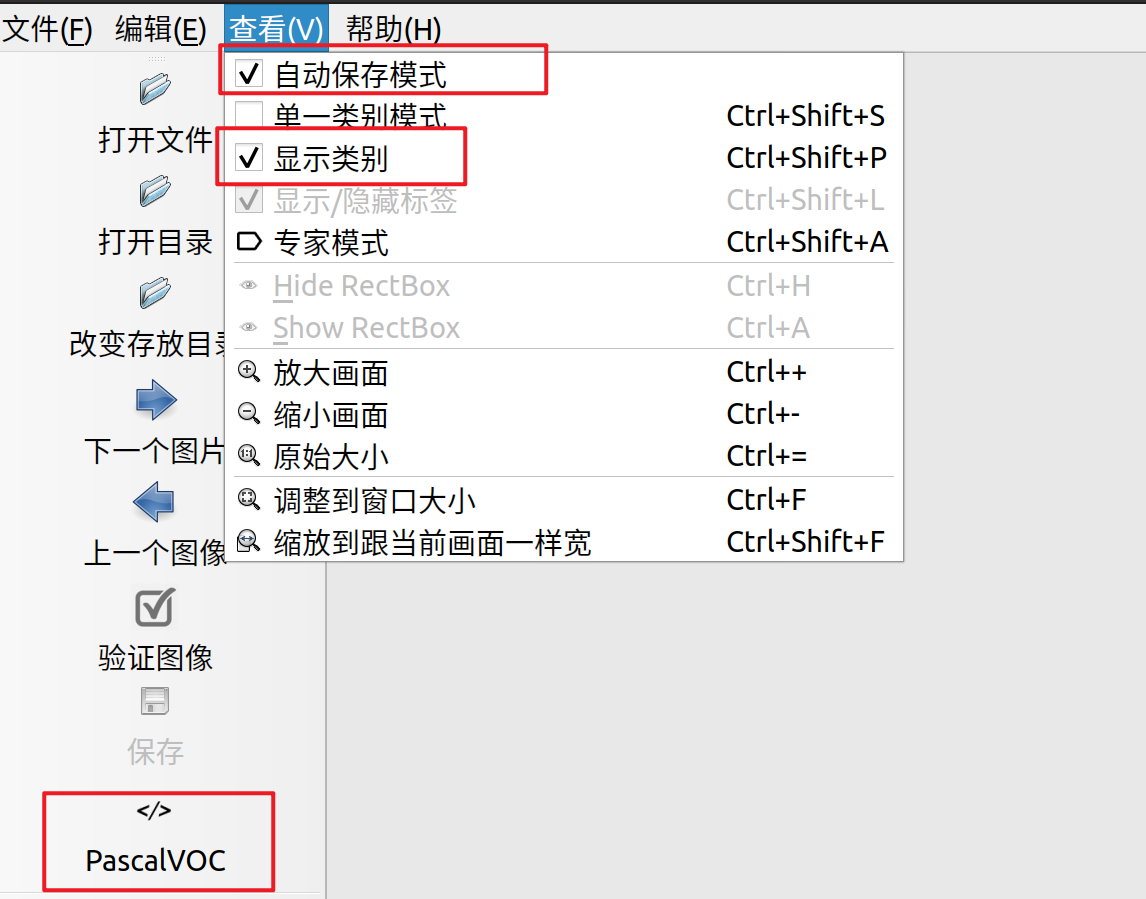

使用PascalVOC模式的标签 设置自动保存和显示类别

常用快捷键如下 :

- A:切换到上一张图片

- D:切换到下一张图片

- W:调出标注十字架

- del :删除标注框框

- Ctrl+u:选择标注的图片文件夹

- Ctrl+r:选择标注好的label标签存在的文件夹

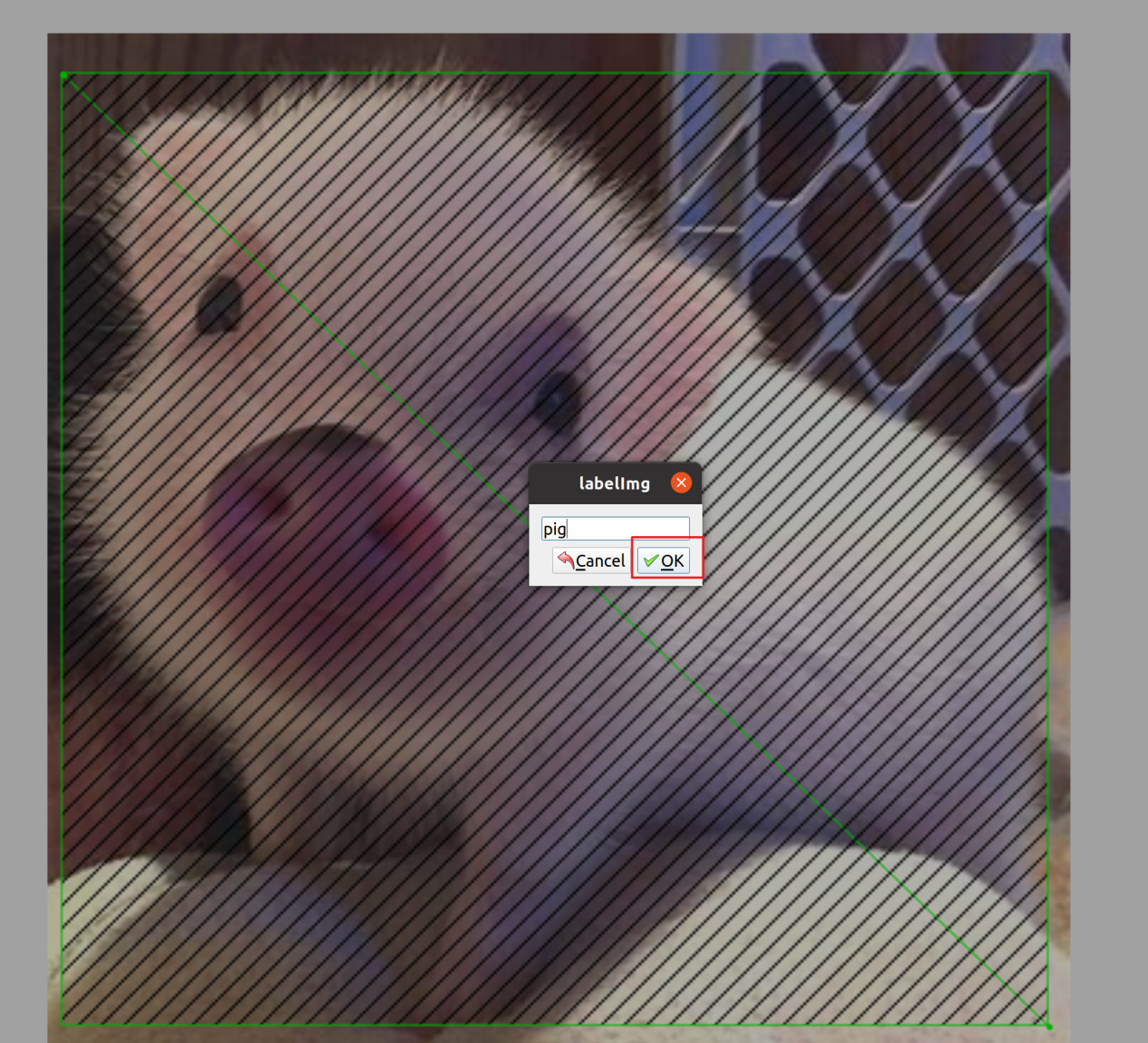

- 开始标注

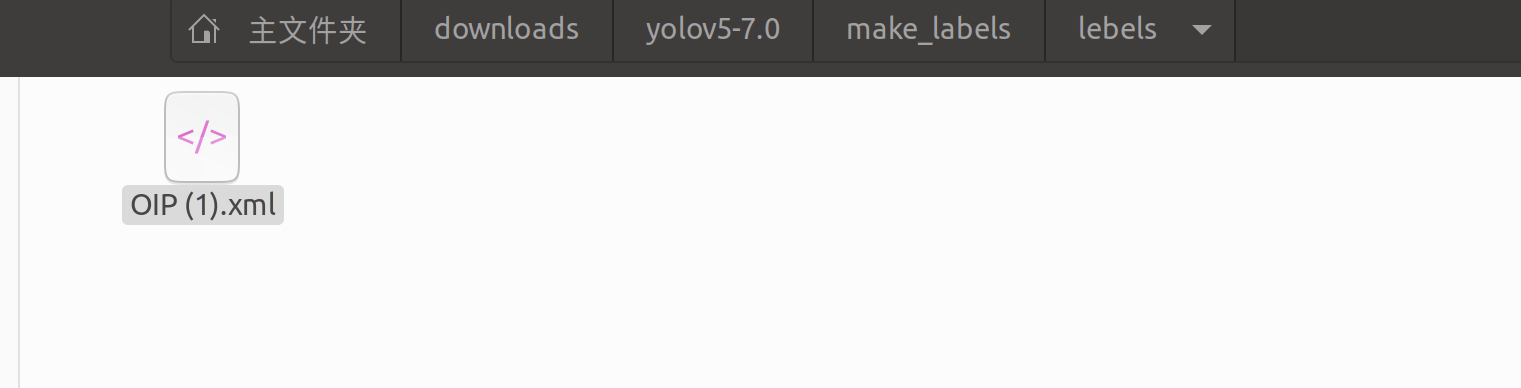

- 标签文件就自动生成了

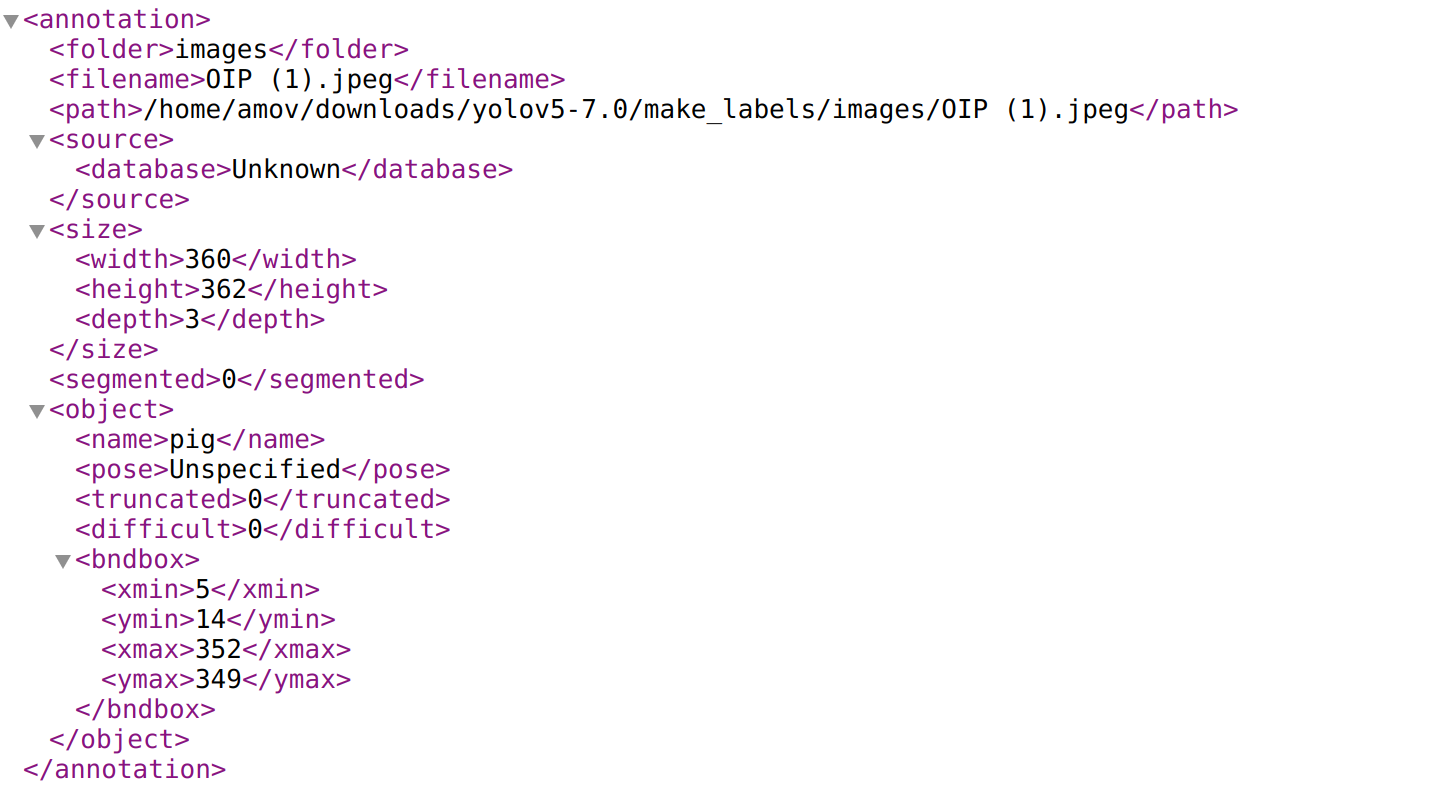

内容如下:

标注文件的互相转化

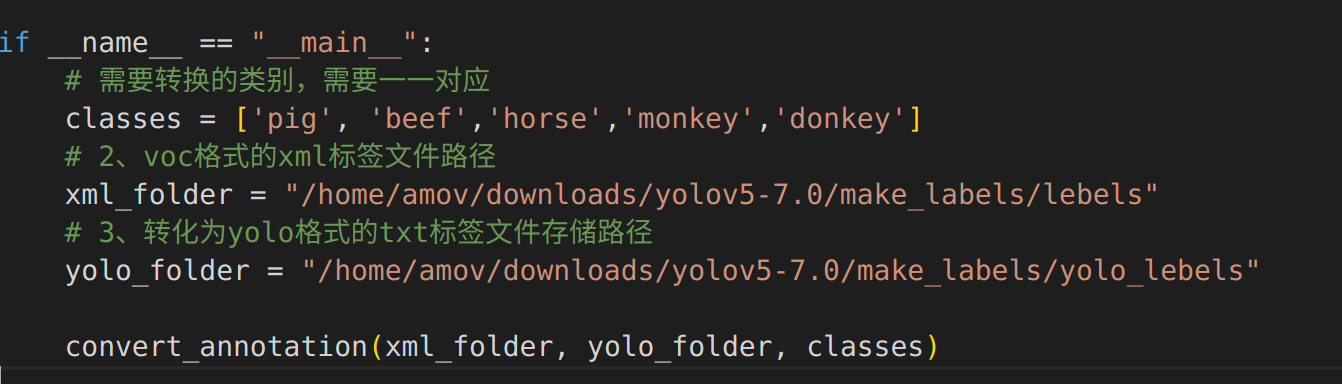

- voc转yolo代码

import xml.etree.ElementTree as ET import pickle import os from os import listdir, getcwd from os.path import join def convert(size, box): x_center = (box[0] + box[1]) / 2.0 y_center = (box[2] + box[3]) / 2.0 x = x_center / size[0] y = y_center / size[1] w = (box[1] - box[0]) / size[0] h = (box[3] - box[2]) / size[1] return (x, y, w, h) def convert_annotation(xml_files_path, save_txt_files_path, classes): xml_files = os.listdir(xml_files_path) print(xml_files) for xml_name in xml_files: print(xml_name) xml_file = os.path.join(xml_files_path, xml_name) out_txt_path = os.path.join(save_txt_files_path, xml_name.split('.')[0] + '.txt') out_txt_f = open(out_txt_path, 'w') tree = ET.parse(xml_file) root = tree.getroot() size = root.find('size') w = int(size.find('width').text) h = int(size.find('height').text) for obj in root.iter('object'): difficult = obj.find('difficult').text cls = obj.find('name').text if cls not in classes or int(difficult) == 1: continue cls_id = classes.index(cls) xmlbox = obj.find('bndbox') b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text), float(xmlbox.find('ymax').text)) # b=(xmin, xmax, ymin, ymax) print(w, h, b) bb = convert((w, h), b) out_txt_f.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n') if __name__ == "__main__": # 需要转换的类别,需要一一对应 classes = ['pig', 'beef','horse','monkey','donkey'] # 2、voc格式的xml标签文件路径 xml_folder = "/home/amov/downloads/yolov5-7.0/make_labels/lebels" # 3、转化为yolo格式的txt标签文件存储路径 yolo_folder="/home/amov/downloads/yolov5-7.0/make_labels/yolo_lebels" convert_annotation(xml_folder, yolo_folder, classes)

向转化函数传入xml目录,yolo目录,和类别即可

- yolo转voc代码

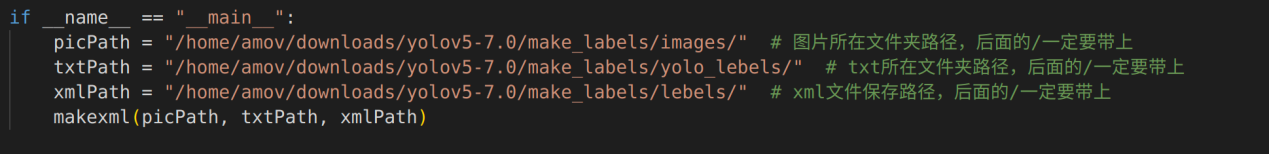

from xml.dom.minidom import Document import os import cv2 # def makexml(txtPath, xmlPath, picPath): # txt所在文件夹路径,xml文件保存路径,图片所在文件夹路径 def makexml(picPath, txtPath, xmlPath): # txt所在文件夹路径,xml文件保存路径,图片所在文件夹路径 # 此函数用于将yolo格式txt标注文件转换为voc格式xml标注文件 # 在自己的标注图片文件夹下建三个子文件夹,分别命名为picture、txt、xml dic = {'0': "pig", # 创建字典用来对类型进行转换 '1': "beef", # 此处的字典要与自己的classes.txt文件中的类对应,且顺序要一致 '2': "horse", '3': "monkey", '4': "donkey", } files = os.listdir(txtPath) for i, name in enumerate(files): xmlBuilder = Document() annotation = xmlBuilder.createElement("annotation") # 创建annotation标签 xmlBuilder.appendChild(annotation) txtFile = open(txtPath + name) txtList = txtFile.readlines() img = cv2.imread(picPath + name[0:-4] + ".jpg") Pheight, Pwidth, Pdepth = img.shape folder = xmlBuilder.createElement("folder") # folder标签 foldercontent = xmlBuilder.createTextNode("driving_annotation_dataset") folder.appendChild(foldercontent) annotation.appendChild(folder) # folder标签结束 filename = xmlBuilder.createElement("filename") # filename标签 filenamecontent = xmlBuilder.createTextNode(name[0:-4] + ".jpg") filename.appendChild(filenamecontent) annotation.appendChild(filename) # filename标签结束 size = xmlBuilder.createElement("size") # size标签 width = xmlBuilder.createElement("width") # size子标签width widthcontent = xmlBuilder.createTextNode(str(Pwidth)) width.appendChild(widthcontent) size.appendChild(width) # size子标签width结束 height = xmlBuilder.createElement("height") # size子标签height heightcontent = xmlBuilder.createTextNode(str(Pheight)) height.appendChild(heightcontent) size.appendChild(height) # size子标签height结束 depth = xmlBuilder.createElement("depth") # size子标签depth depthcontent = xmlBuilder.createTextNode(str(Pdepth)) depth.appendChild(depthcontent) size.appendChild(depth) # size子标签depth结束 annotation.appendChild(size) # size标签结束 for j in txtList: oneline = j.strip().split(" ") object = xmlBuilder.createElement("object") # object 标签 picname = xmlBuilder.createElement("name") # name标签 namecontent = xmlBuilder.createTextNode(dic[oneline[0]]) picname.appendChild(namecontent) object.appendChild(picname) # name标签结束 pose = xmlBuilder.createElement("pose") # pose标签 posecontent = xmlBuilder.createTextNode("Unspecified") pose.appendChild(posecontent) object.appendChild(pose) # pose标签结束 truncated = xmlBuilder.createElement("truncated") # truncated标签 truncatedContent = xmlBuilder.createTextNode("0") truncated.appendChild(truncatedContent) object.appendChild(truncated) # truncated标签结束 difficult = xmlBuilder.createElement("difficult") # difficult标签 difficultcontent = xmlBuilder.createTextNode("0") difficult.appendChild(difficultcontent) object.appendChild(difficult) # difficult标签结束 bndbox = xmlBuilder.createElement("bndbox") # bndbox标签 xmin = xmlBuilder.createElement("xmin") # xmin标签 mathData = int(((float(oneline[1])) * Pwidth + 1) - (float(oneline[3])) * 0.5 * Pwidth) xminContent = xmlBuilder.createTextNode(str(mathData)) xmin.appendChild(xminContent) bndbox.appendChild(xmin) # xmin标签结束 ymin = xmlBuilder.createElement("ymin") # ymin标签 mathData = int(((float(oneline[2])) * Pheight + 1) - (float(oneline[4])) * 0.5 * Pheight) yminContent = xmlBuilder.createTextNode(str(mathData)) ymin.appendChild(yminContent) bndbox.appendChild(ymin) # ymin标签结束 xmax = xmlBuilder.createElement("xmax") # xmax标签 mathData = int(((float(oneline[1])) * Pwidth + 1) + (float(oneline[3])) * 0.5 * Pwidth) xmaxContent = xmlBuilder.createTextNode(str(mathData)) xmax.appendChild(xmaxContent) bndbox.appendChild(xmax) # xmax标签结束 ymax = xmlBuilder.createElement("ymax") # ymax标签 mathData = int(((float(oneline[2])) * Pheight + 1) + (float(oneline[4])) * 0.5 * Pheight) ymaxContent = xmlBuilder.createTextNode(str(mathData)) ymax.appendChild(ymaxContent) bndbox.appendChild(ymax) # ymax标签结束 object.appendChild(bndbox) # bndbox标签结束 annotation.appendChild(object) # object标签结束 f = open(xmlPath + name[0:-4] + ".xml", 'w') xmlBuilder.writexml(f, indent='\t', newl='\n', addindent='\t', encoding='utf-8') f.close() if __name__ == "__main__": picPath = "/home/amov/downloads/yolov5-7.0/make_labels/images/" # 图片所在文件夹路径,后面的/一定要带上 txtPath = "/home/amov/downloads/yolov5-7.0/make_labels/yolo_lebels/" # txt所在文件夹路径,后面的/一定要带上 xmlPath = "/home/amov/downloads/yolov5-7.0/make_labels/lebels/" # xml文件保存路径,后面的/一定要带上 makexml(picPath, txtPath, xmlPath)

将图片目录,yolo标注目录,和xml目录传入函数即可

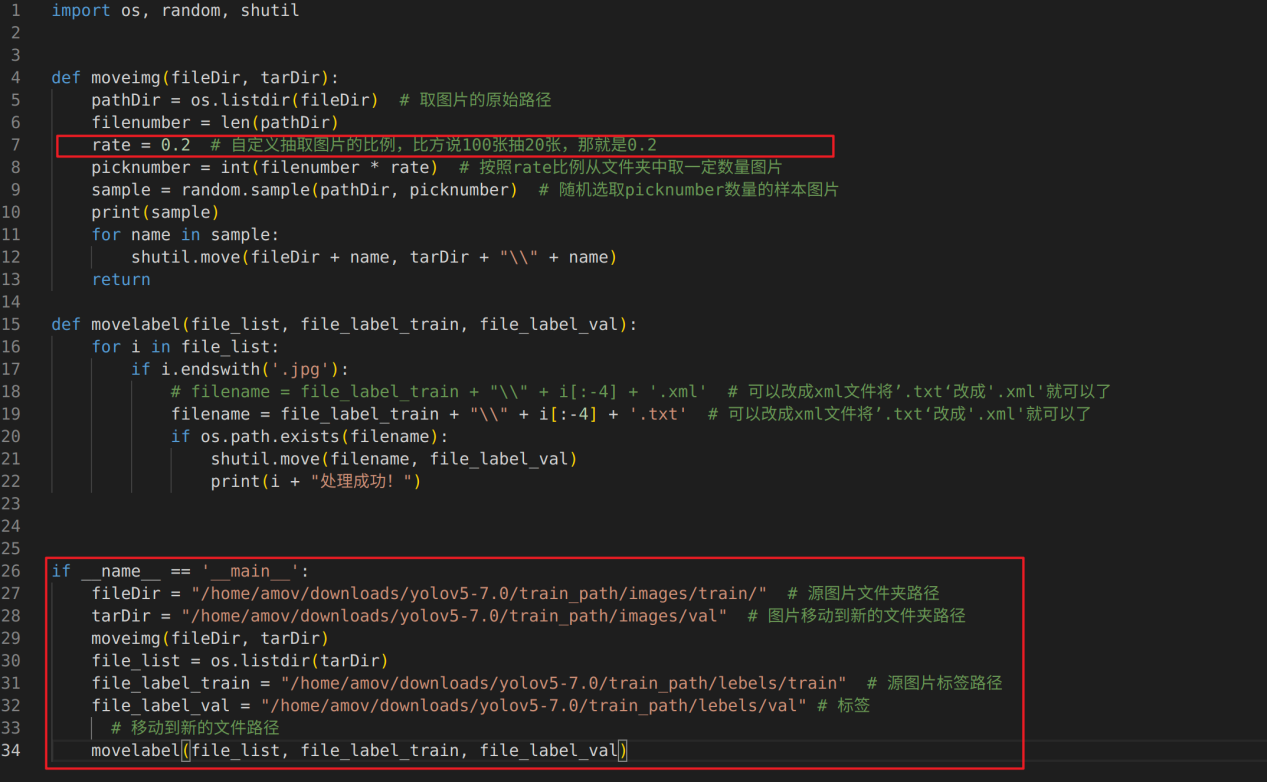

划分数据集和验证集

import os, random, shutil def moveimg(fileDir, tarDir): pathDir = os.listdir(fileDir) # 取图片的原始路径 filenumber = len(pathDir) rate = 0.2 # 自定义抽取图片的比例,比方说100张抽10张,那就是0.1 picknumber = int(filenumber * rate) # 按照rate比例从文件夹中取一定数量图片 sample = random.sample(pathDir, picknumber) # 随机选取picknumber数量的样本图片 print(sample) for name in sample: shutil.move(fileDir + name, tarDir + "\\" + name) return def movelabel(file_list, file_label_train, file_label_val): for i in file_list: if i.endswith('.jpg'): # filename = file_label_train + "\\" + i[:-4] + '.xml' # 可以改成xml文件将’.txt‘改成'.xml'就可以了 filename = file_label_train + "\\" + i[:-4] + '.txt' # 可以改成xml文件将’.txt‘改成'.xml'就可以了 if os.path.exists(filename): shutil.move(filename, file_label_val) print(i + "处理成功!") if __name__ == '__main__': fileDir = "/home/amov/downloads/yolov5-7.0/train_path/images/train/" # 源图片文件夹路径 tarDir = "/home/amov/downloads/yolov5-7.0/train_path/images/val" # 图片移动到新的文件夹路径 moveimg(fileDir, tarDir) file_list = os.listdir(tarDir) file_label_train = "/home/amov/downloads/yolov5-7.0/train_path/lebels/train" # 源图片标签路径 file_label_val = "/home/amov/downloads/yolov5-7.0/train_path/lebels/val" # 标签 # 移动到新的文件路径 movelabel(file_list, file_label_train, file_label_val)

注意

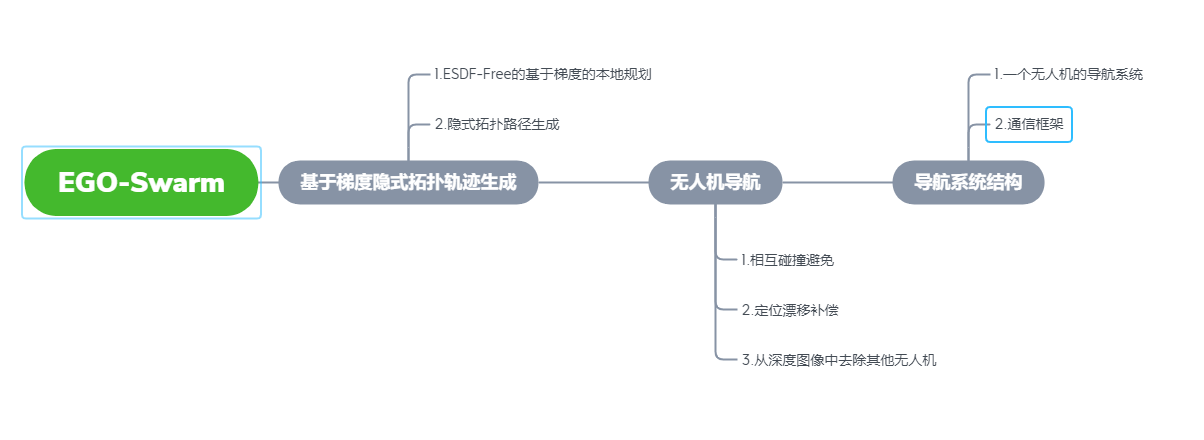

一般会设置80%训练集和20%验证集,划分数据集的代码会抽取所有的数据集中的20%作为验证集,剩余的80%作为训练集ego_planner_swarm 模块介绍

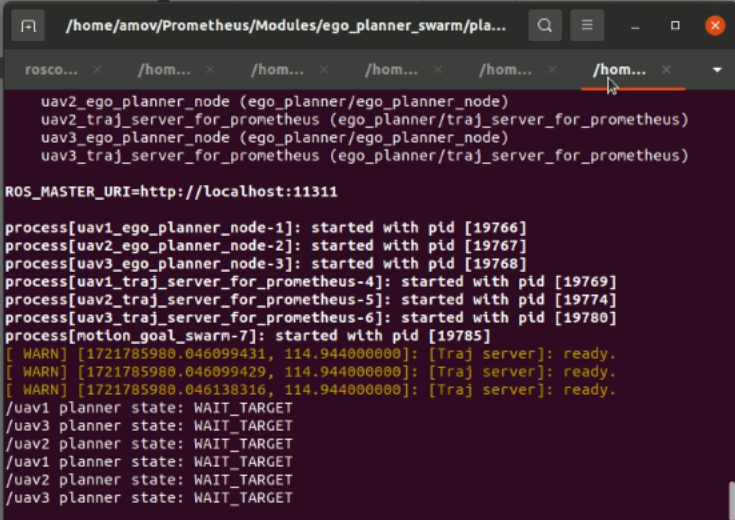

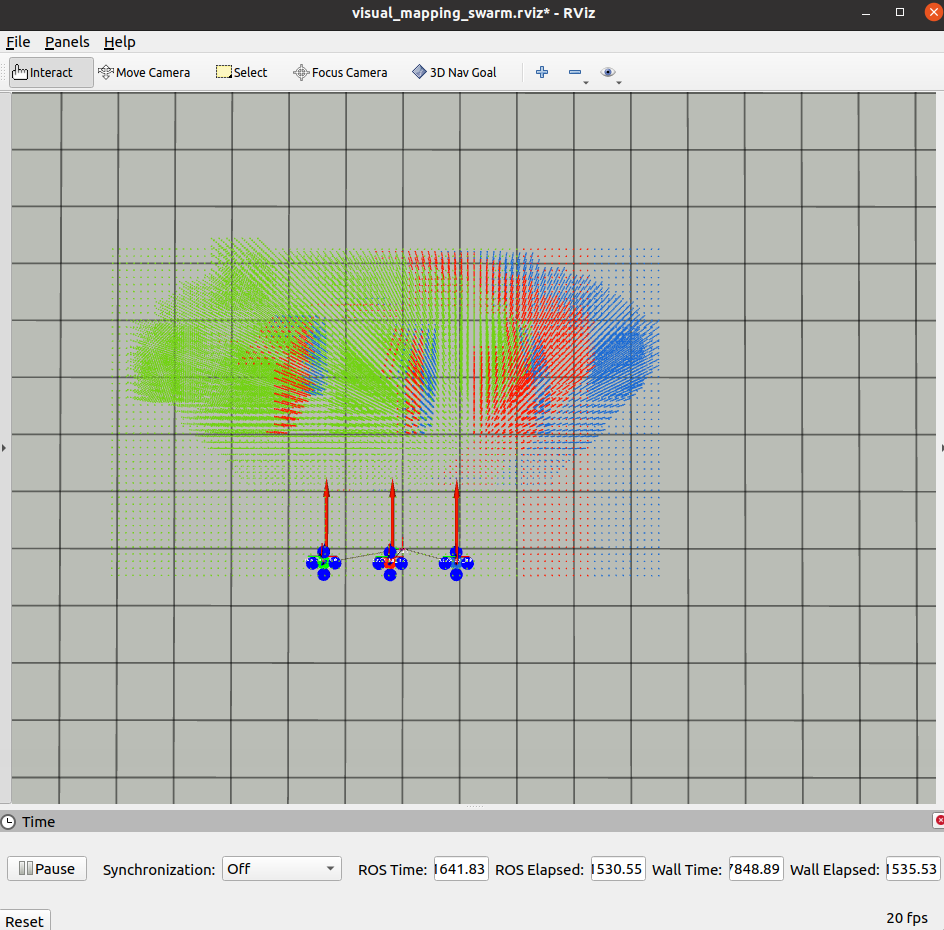

ego_planner_swarm 是 ego-planner 的扩展模块,专为多台无人机的协作和自主导航设计。该模块旨在帮助多个无人机在复杂和动态的环境中进行协同工作和自主决策,提升它们的自主性和效率。相关源代码位于 /home/amov/Prometheus/Modules/ego_planner_swarm 文件夹下。具体特点和功能包括:

- 高度自主决策 : 无人机能够实时感知环境变化并自主调整飞行策略,确保任务高效完成。 - 协同导航 : 无人机能够接收来自更高优先级无人机的轨迹信息,并将其存储起来,以便在需要时参考这些轨迹来为自己规划出更加安全的飞行路径。 - 去中心化架构 : 完全自主与分散式设计,每台无人机独立决策,无需中央控制,提升了系统的灵活性和鲁棒性。目录

教学与实践

扩展阅读 3.1 EGO-Swarm优势 3.2 A*算法原理

ego_planner_swarm 模块介绍

ego_planner_swarm 是 ego-planner 的扩展模块,专为多台无人机的协作和自主导航设计。该模块旨在帮助多个无人机在复杂和动态的环境中进行协同工作和自主决策,提升它们的自主性和效率。相关源代码位于 /home/amov/Prometheus/Modules/ego_planner_swarm 文件夹下。具体特点和功能包括:

- 高度自主决策 : 无人机能够实时感知环境变化并自主调整飞行策略,确保任务高效完成。 - 协同导航 : 无人机能够接收来自更高优先级无人机的轨迹信息,并将其存储起来,以便在需要时参考这些轨迹来为自己规划出更加安全的飞行路径。 - 去中心化架构 : 完全自主与分散式设计,每台无人机独立决策,无需中央控制,提升了系统的灵活性和鲁棒性。目录

教学与实践

扩展阅读 3.1 EGO-Swarm优势 3.2 A*算法原理

关键话题与参数介绍

发布话题和订阅话题中均带有命名空间/uav~,无人机编号不同则对应的命名空间不同,单机时默认为:/uav1

订阅话题

/broadcast_bspline (traj_utils/Bspline)

无人机当前时刻及未来一段时间内的飞行轨迹

/uav1/mavros/local_position/odom (nav_msgs/Odometry)

无人机里程计数据

/uav1/octomap_point_cloud_centers (sensor_msgs/PointCloud2)

无人机点云数据

/uav1/prometheus/motion_planning/goal (geometry_msgs/PoseStamped)

无人机目标点

发布话题

/broadcast_bspline (traj_utils/Bspline)

每台无人机当前时刻及未来一段时间内的飞行轨迹

/uav1/planning/bspline (traj_utils/Bspline)

一号无人机规划的B样条轨迹

/uav1_ego_planner_node/grid_map/occupancy_inflate (sensor_msgs/PointCloud2)

无人机膨胀后的点云数据

/uav1/prometheus/command (prometheus_msgs/UAVCommand)

无人机控制指令

/uav1_ego_planner_node/global_list (visualization_msgs/Marker)

无人机规划的全局点合集,用于RVIZ显示

/uav1_ego_planner_node/goal_point (visualization_msgs/Marker)

无人机终点,用于RVIZ显示

/uav1_ego_planner_node/optimal_list (visualization_msgs/Marker)

无人机优化的轨迹,用于RVIZ显示

参数

uav_id :

参数说明: 无人机编号

单位:

数据类型: int

默认值: 1

备注: 无

map_size_x_ :

参数说明: 规划范围,x 方向

单位: 米

数据类型: double

默认值: 50.0

备注:

map_size_y_ :

参数说明: 规划范围,y 方向

单位: 米

数据类型: double

默认值: 50.0

备注:

map_size_z_ :

参数说明: 规划范围,z 方向

单位: 米

数据类型: double

默认值: 3.0

备注:

odometry_topic :

参数说明: 订阅的里程计话题

单位:

消息类型: nav_msgs/Odometry

默认值: /mavros/local_position/odom

备注: 在advanced_param.xml文件中加了前缀 /uav* ,可根据自身需求进行替换

cloud_topic :

参数说明: 订阅的点云话题

单位:

消息类型: sensor_msgs/PointCloud2

默认值: /uav1/octomap_point_cloud_centers

备注:

max_vel :

参数说明: 最大飞行速度

单位: m/s

数据类型: double

默认值: 0.8

备注:

max_acc :

参数说明: 最大加速度

单位: m/s^2

数据类型: double

默认值: 6.0

备注:

planning_horizon :

参数说明: 规划范围

单位: m

数据类型: double

默认值: 7.5

备注: 一般设置为传感器的1.5倍

yaw_init :

参数说明: 偏航角初始值

单位: rad

数据类型: double

默认值: 0.0

备注:

fsm/thresh_replan_time :

参数说明: 重规划时间

单位: rad

数据类型: double

默认值: 1.0

备注:

fsm/thresh_no_replan_meter :

参数说明: 重规划阈值

单位: m

数据类型: double

默认值: 1.0

备注: 在阈值范围内,停止规划

grid_map/resolution :

参数说明: 地图分辨率

单位:

数据类型: double

默认值: 1.0

备注:

grid_map/local_update_range_x :

参数说明: x 方向截断距离

单位: m

数据类型: double

默认值: 5.5

备注: y z 方向同理

grid_map/obstacles_inflation :

参数说明: 障碍物膨胀距离

单位: m

数据类型: double

默认值: 0.5

备注: 为保证飞行安全,膨胀距离最小设置为无人机最大尺寸的一半

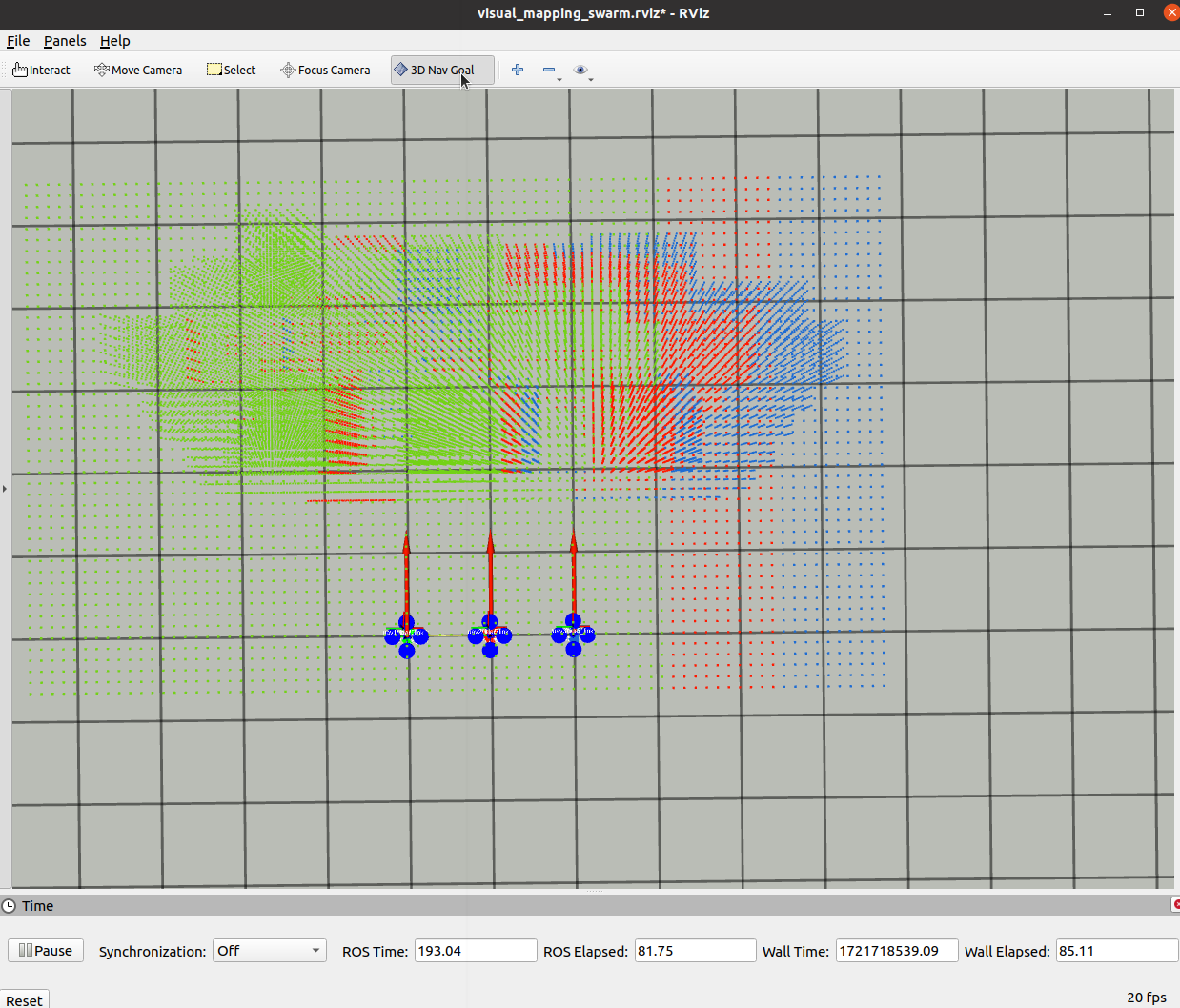

单机避障

仿真Demo-D435i视觉避障

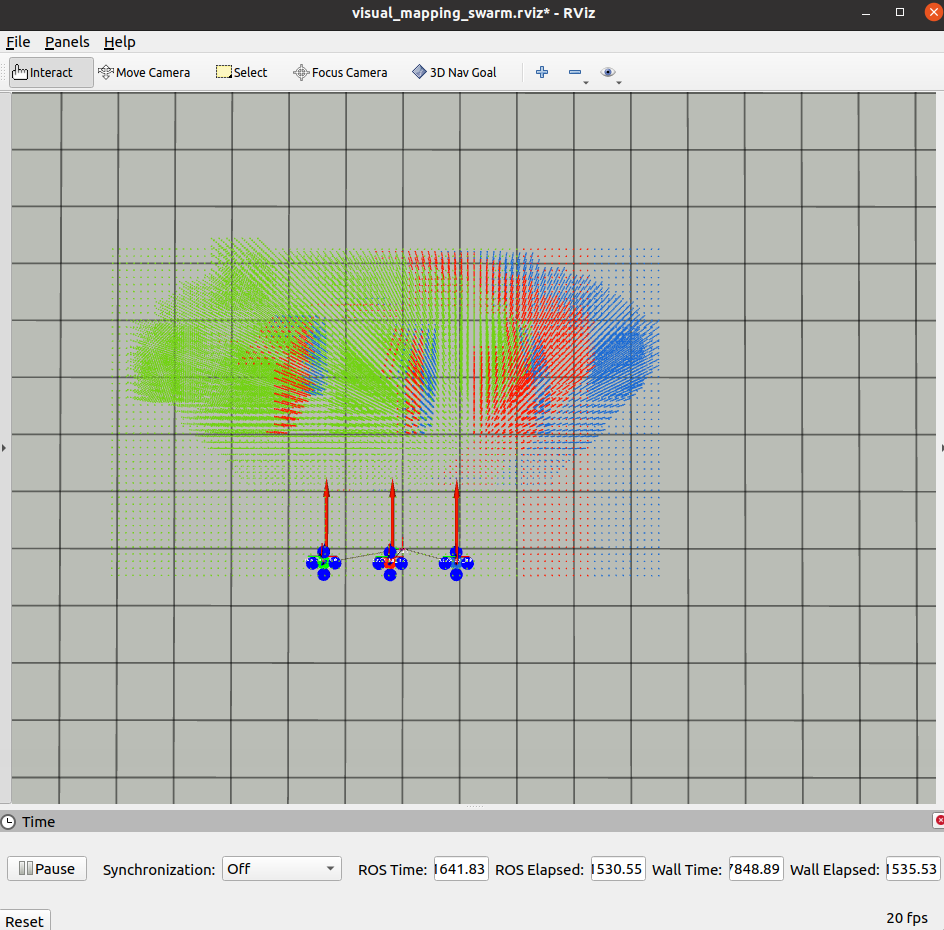

效果展示

提示

运行Demo前请将该模块编译编译代码如下:

cd ~/Prometheus catkin_make --source Modules/ego_planner_swarm --build build/ego_planner_swarm仿真脚本启动流程

将FS-i6s遥控器开机并通过USB接口接入电脑

输入以下命令启动二维激光雷达集群避障仿真demo

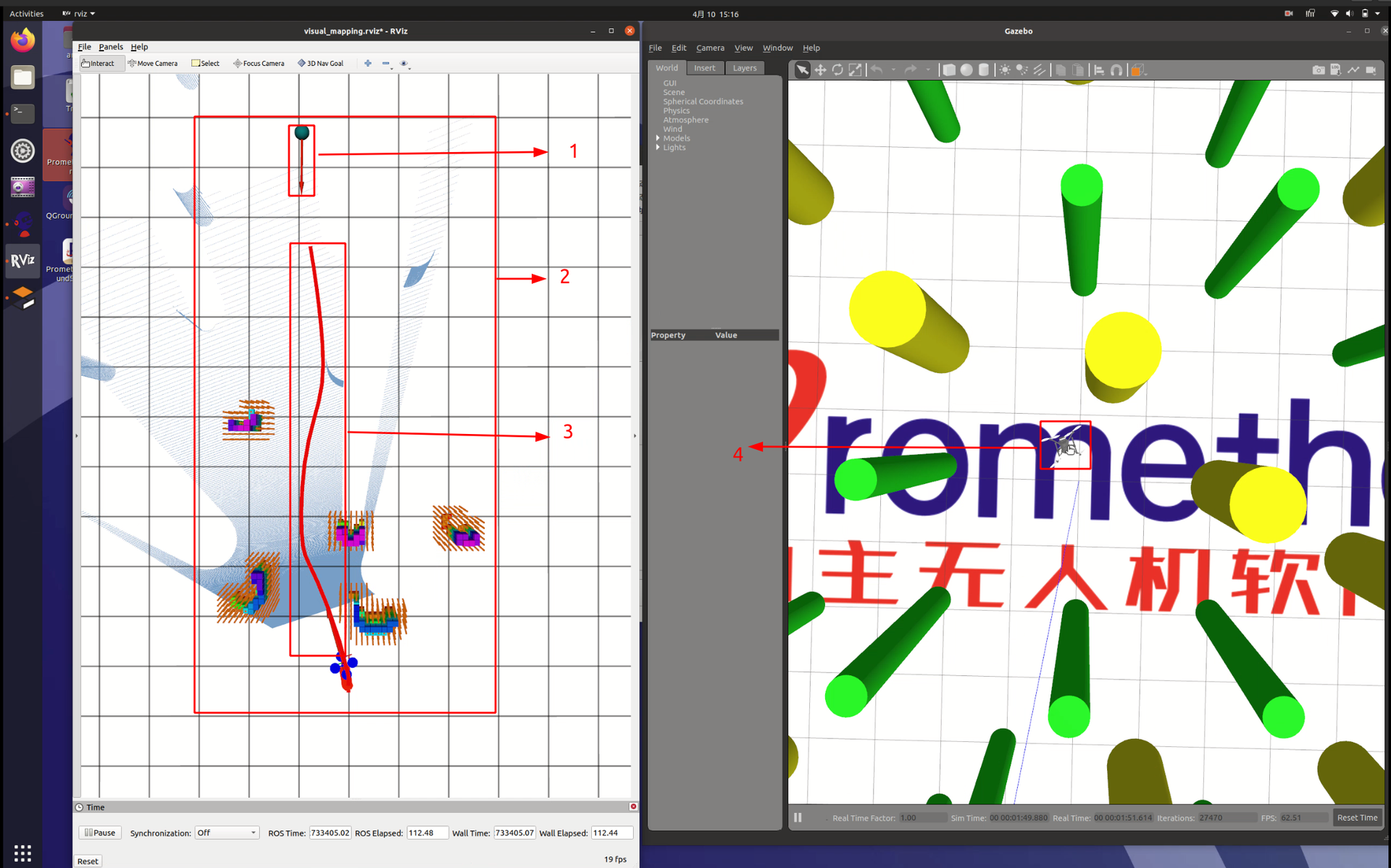

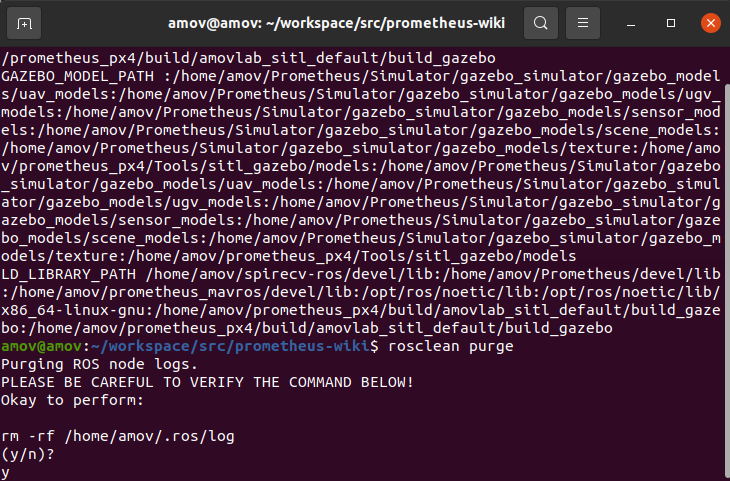

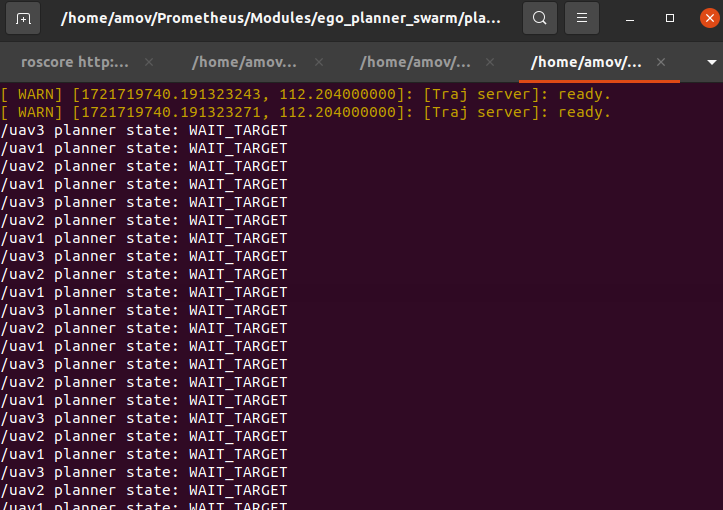

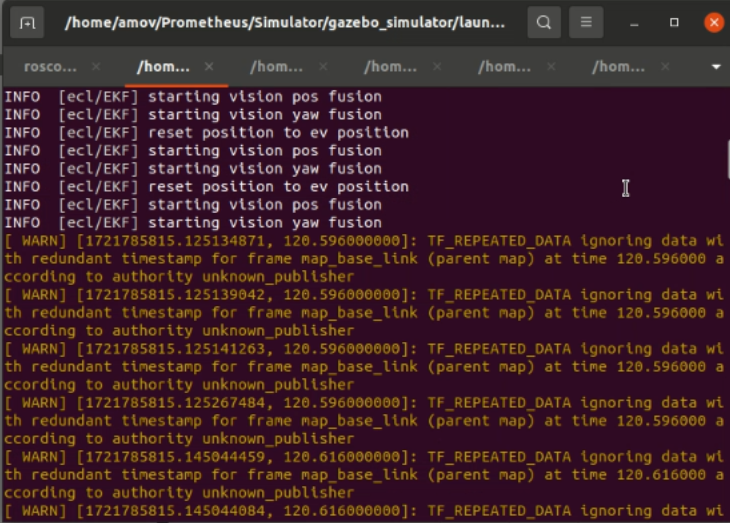

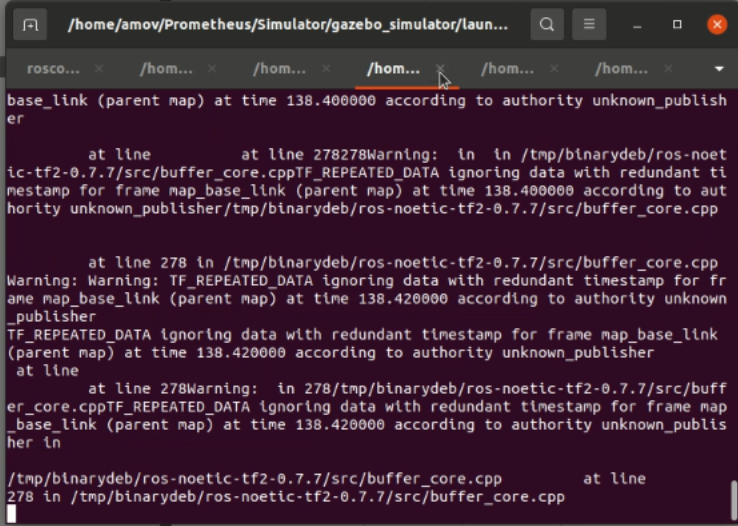

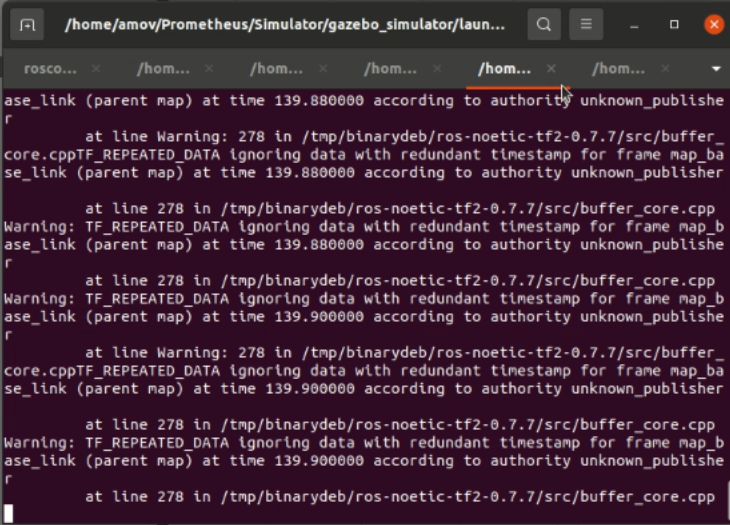

cd ~/Prometheus/Scripts/simulation/ego_planner/ # 第一次启动该脚本时,需要添加可执行权限 chmod +x ego_planner_p450_d435i.sh ./ego_planner_p450_d435i.sh检查终端运行是否正常

- ROS主节点

- 下图所示为正常运行

- PX4仿真

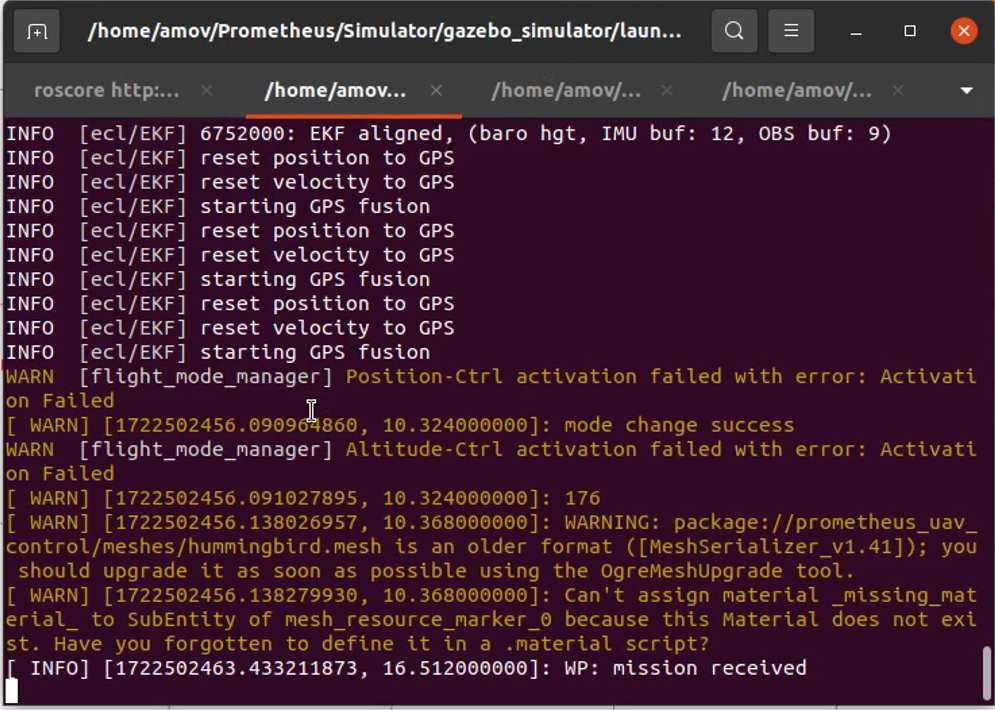

- 下图所示为正常运行

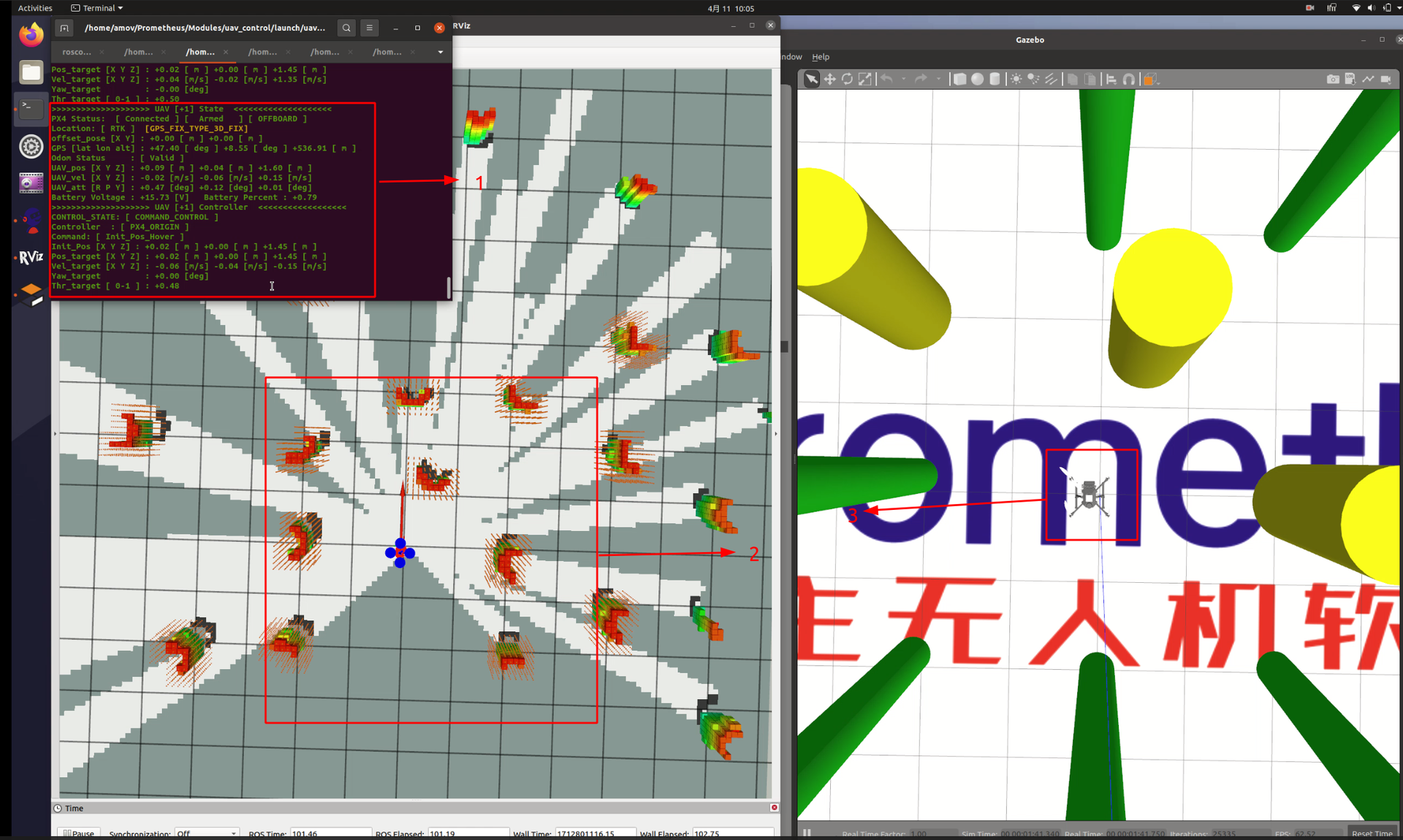

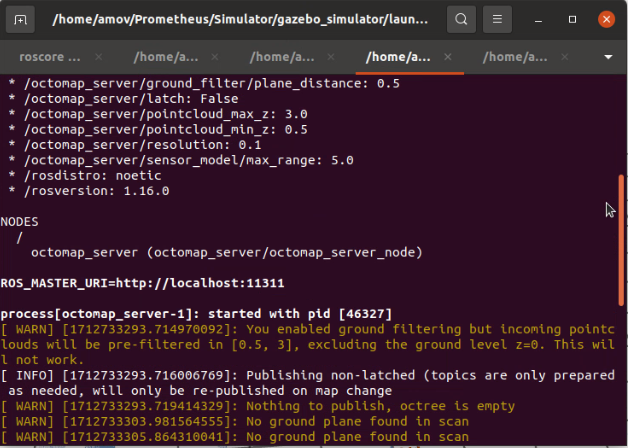

- Prometheus控制

- 下图所示为正常运行

- Octomap建图

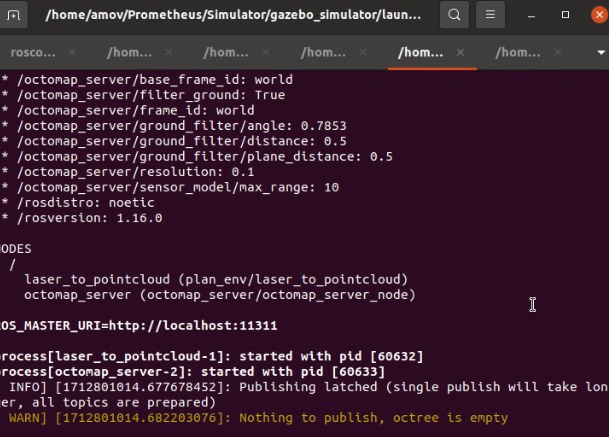

- 下图所示为正常运行

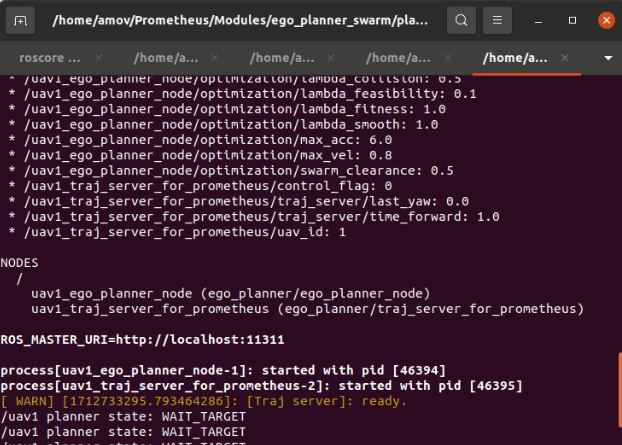

- Ego-planner规划避障

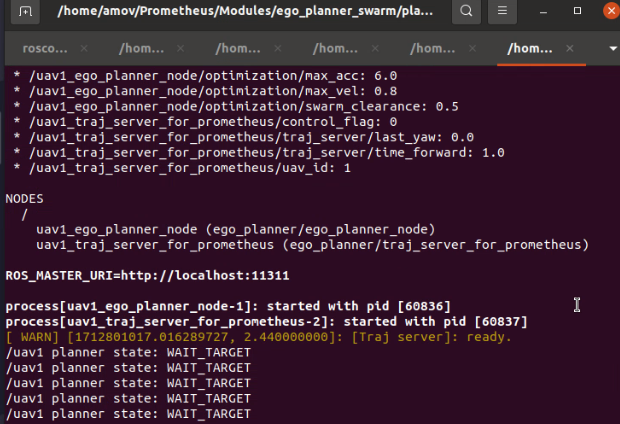

- 下图所示为正常运行

开始仿真

- 遥控器拨动SW-A,解锁无人机

- 拨动SW-B,到中间,进入Prometheus的RC_POS_CONTROL控制

- 拨动SW-B,到最下面,进入Prometheus的COMMAND_CONTROL控制,无人机会自主起飞

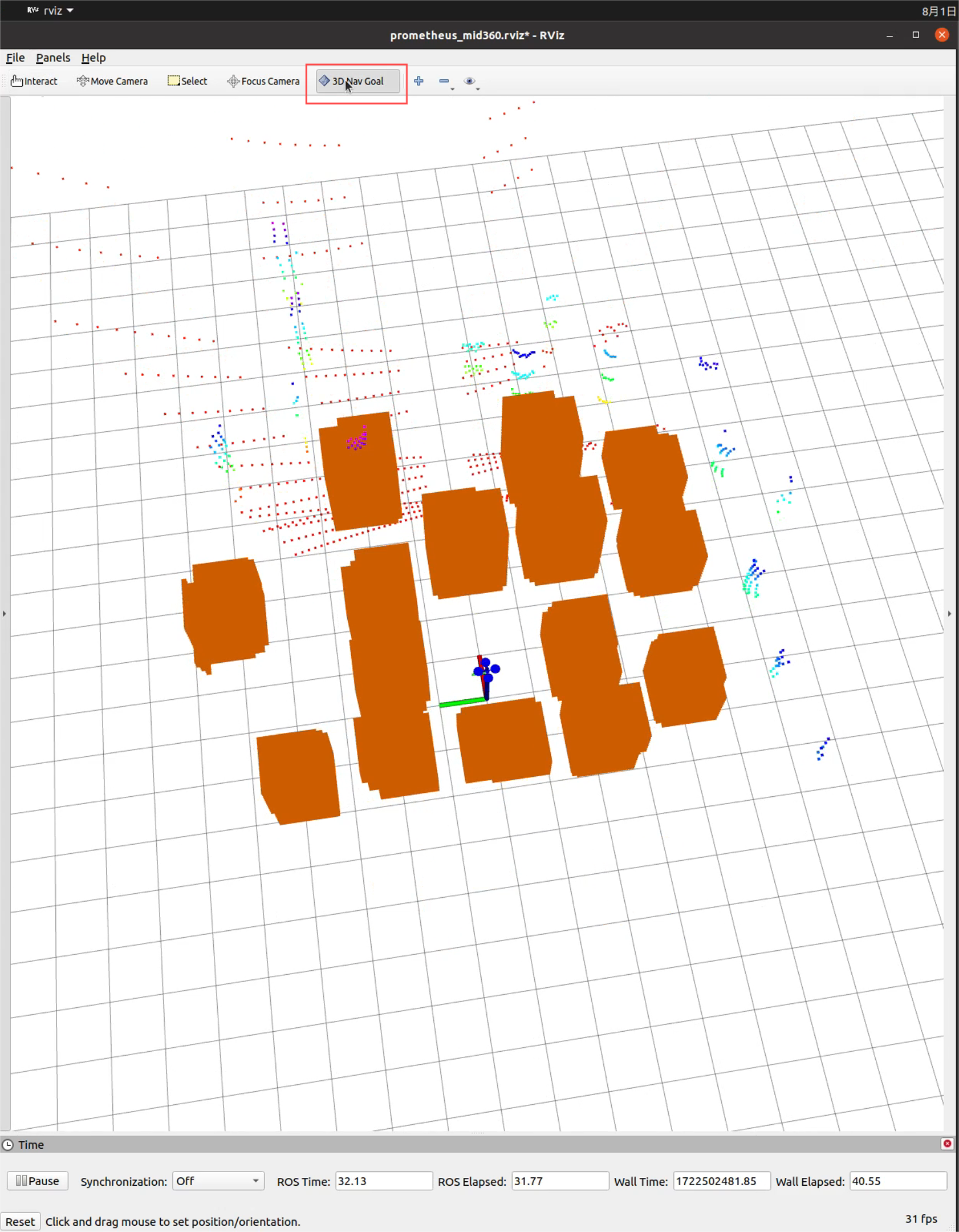

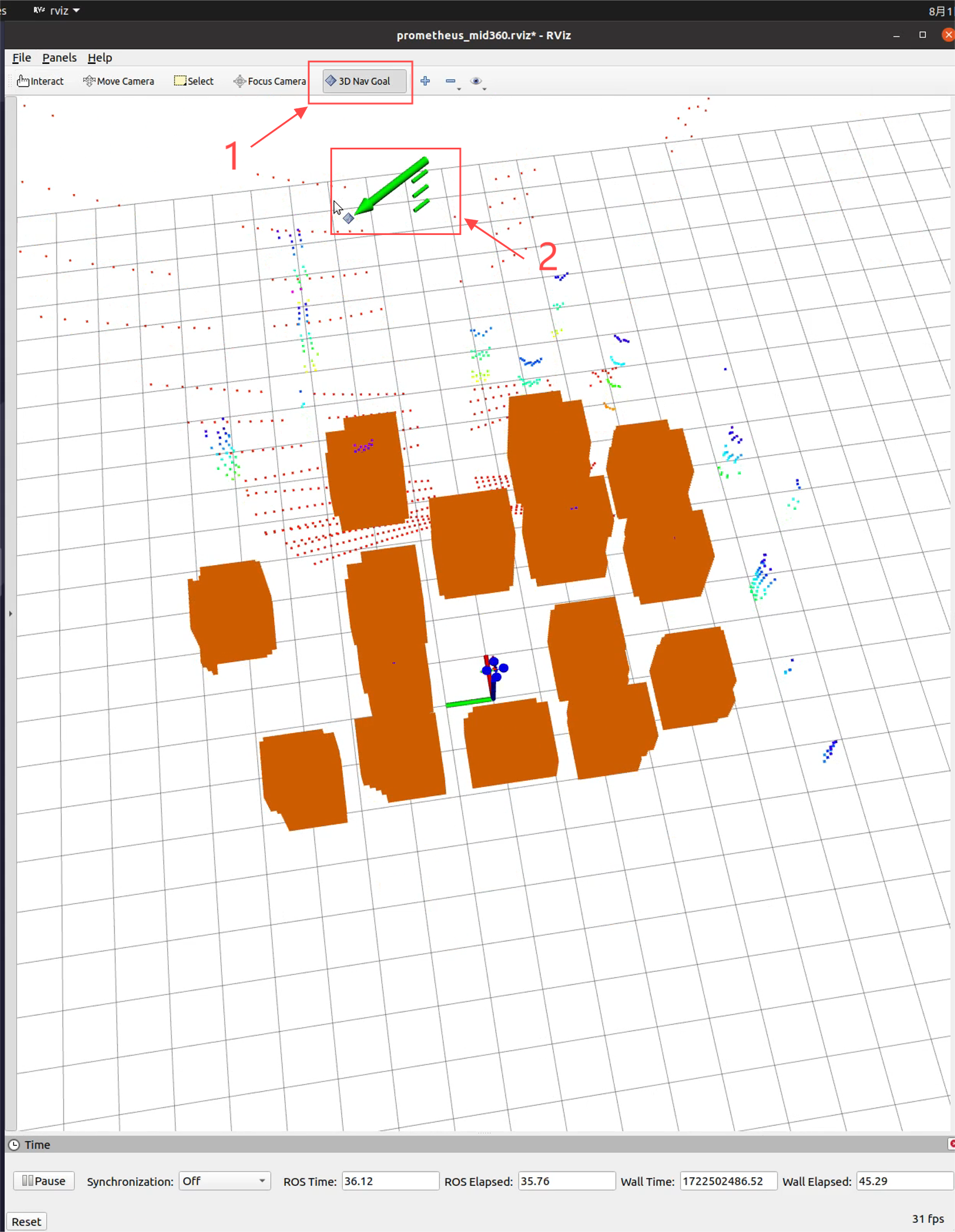

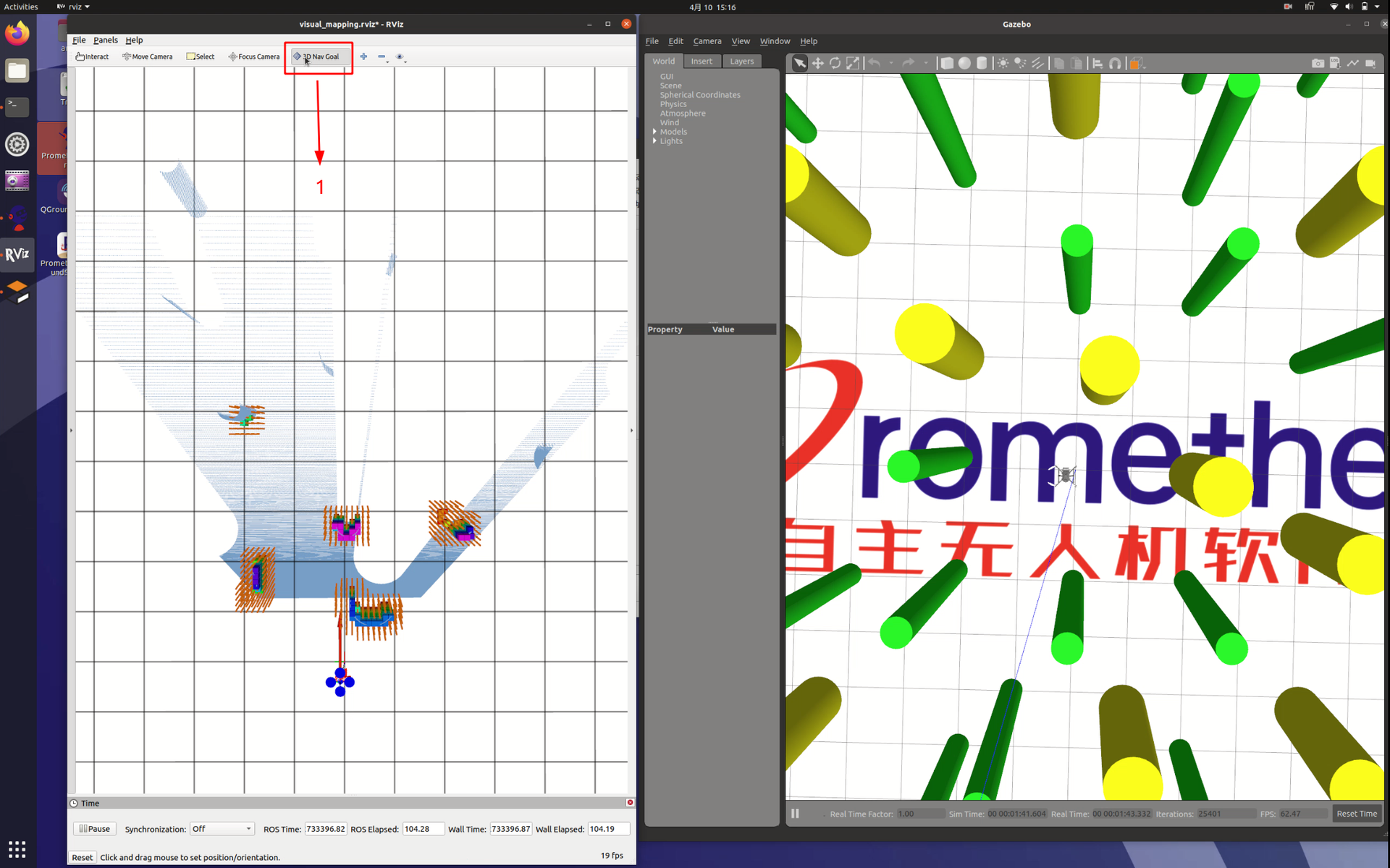

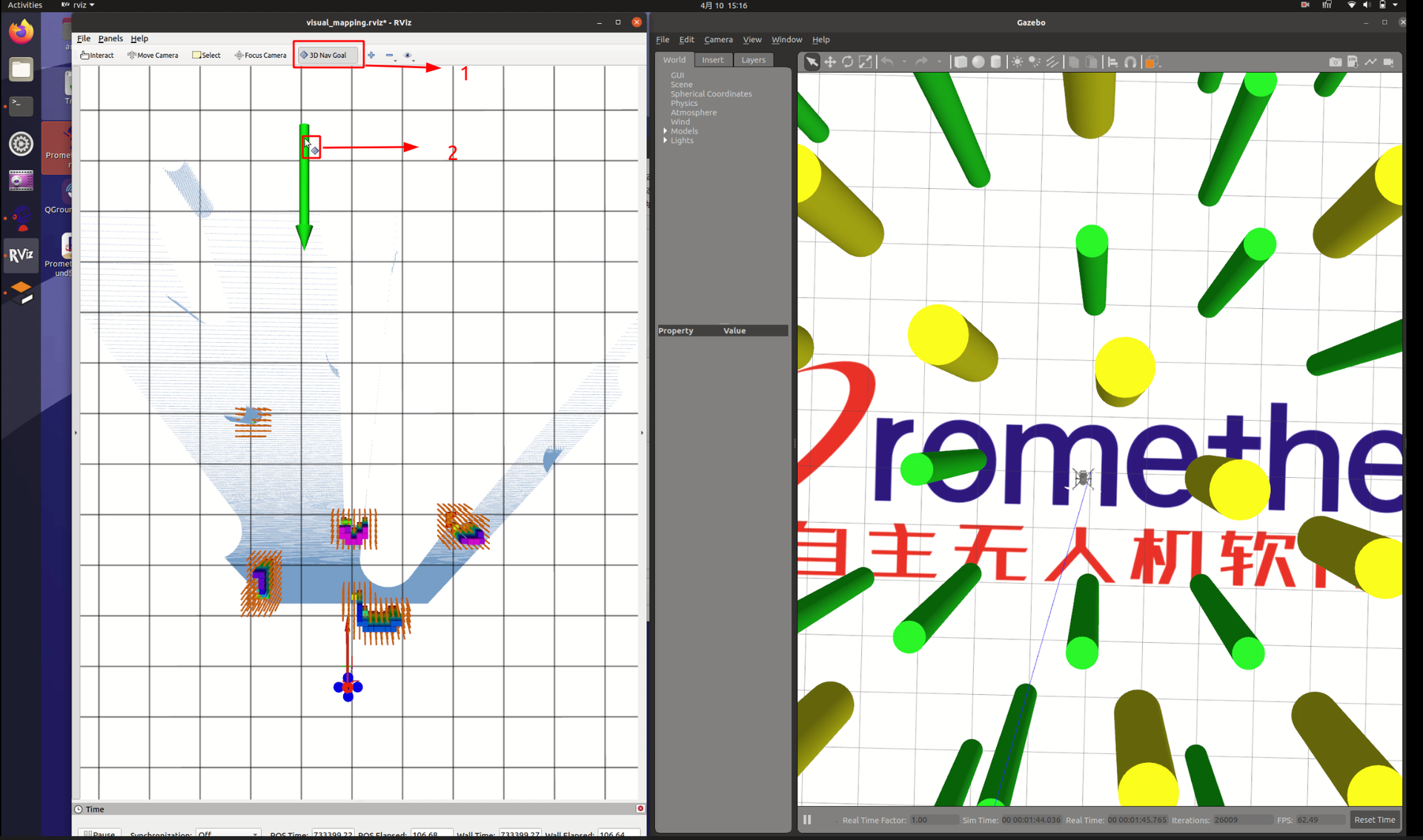

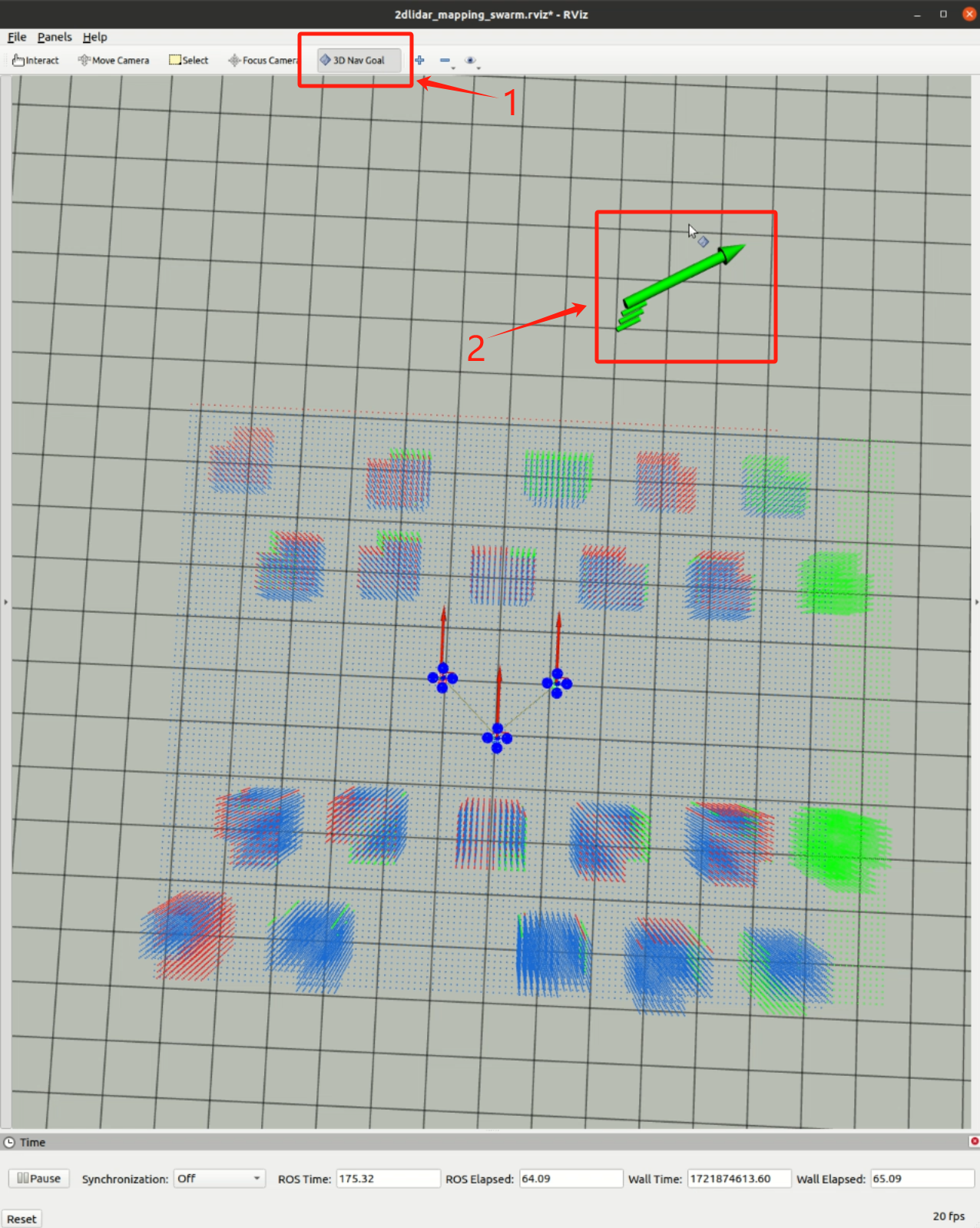

- 选择 3D Nav Goal

- 选择后鼠标的图表会发生变化

- 开始指点

- 鼠标左键点击目标点,然后不松开,拖向无人机方向(如下图一绿色箭头,提供目标X和Y的位置),然后按住鼠标左键的同时,按下鼠标右键,在画面内向上划,可以提供Z的高度,如下图二所示

注意:如果不按住鼠标左键,在画面内向上划,提供Z的高度,那么Z的高度默认为0,则会出现到达不了目标点的情况!

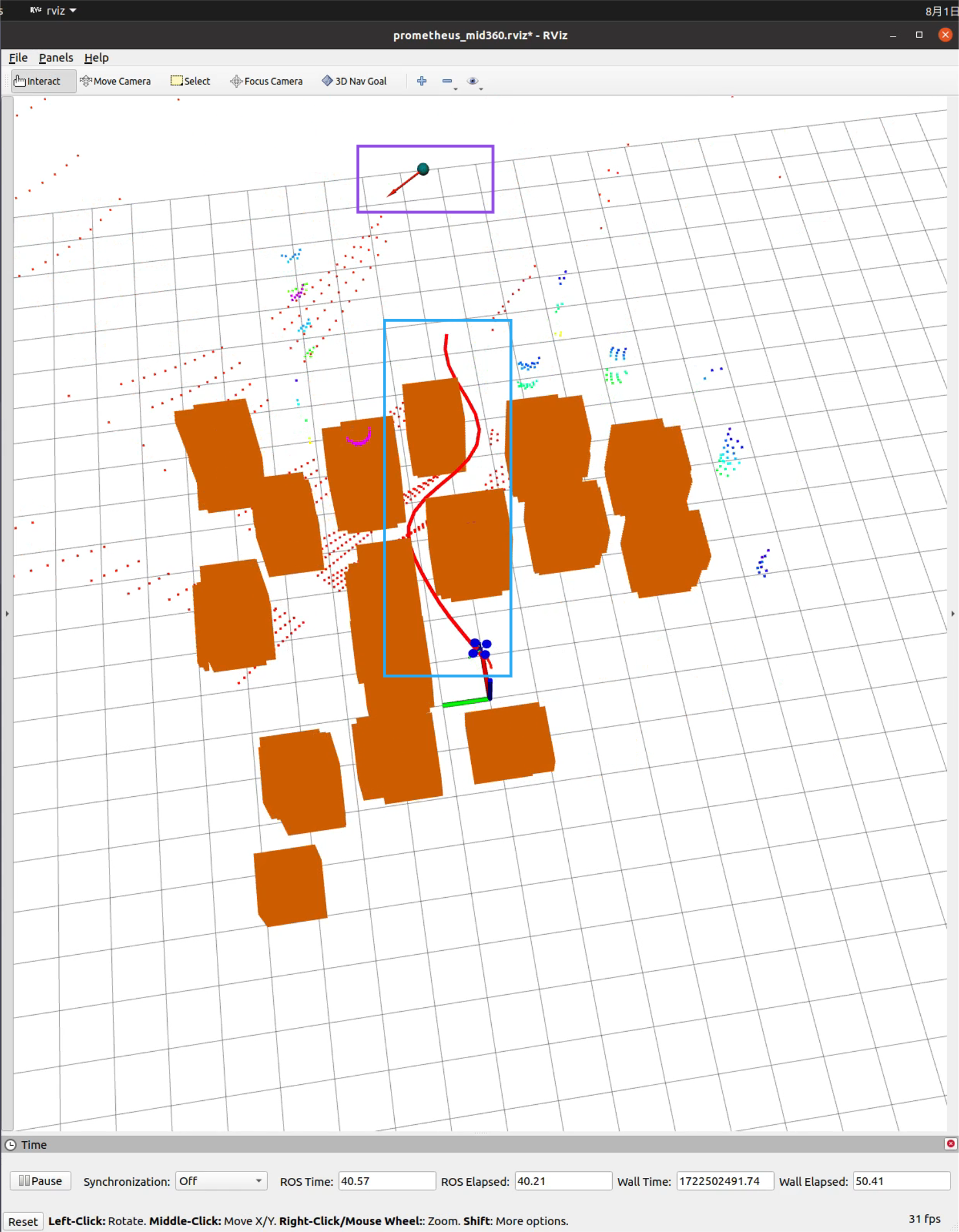

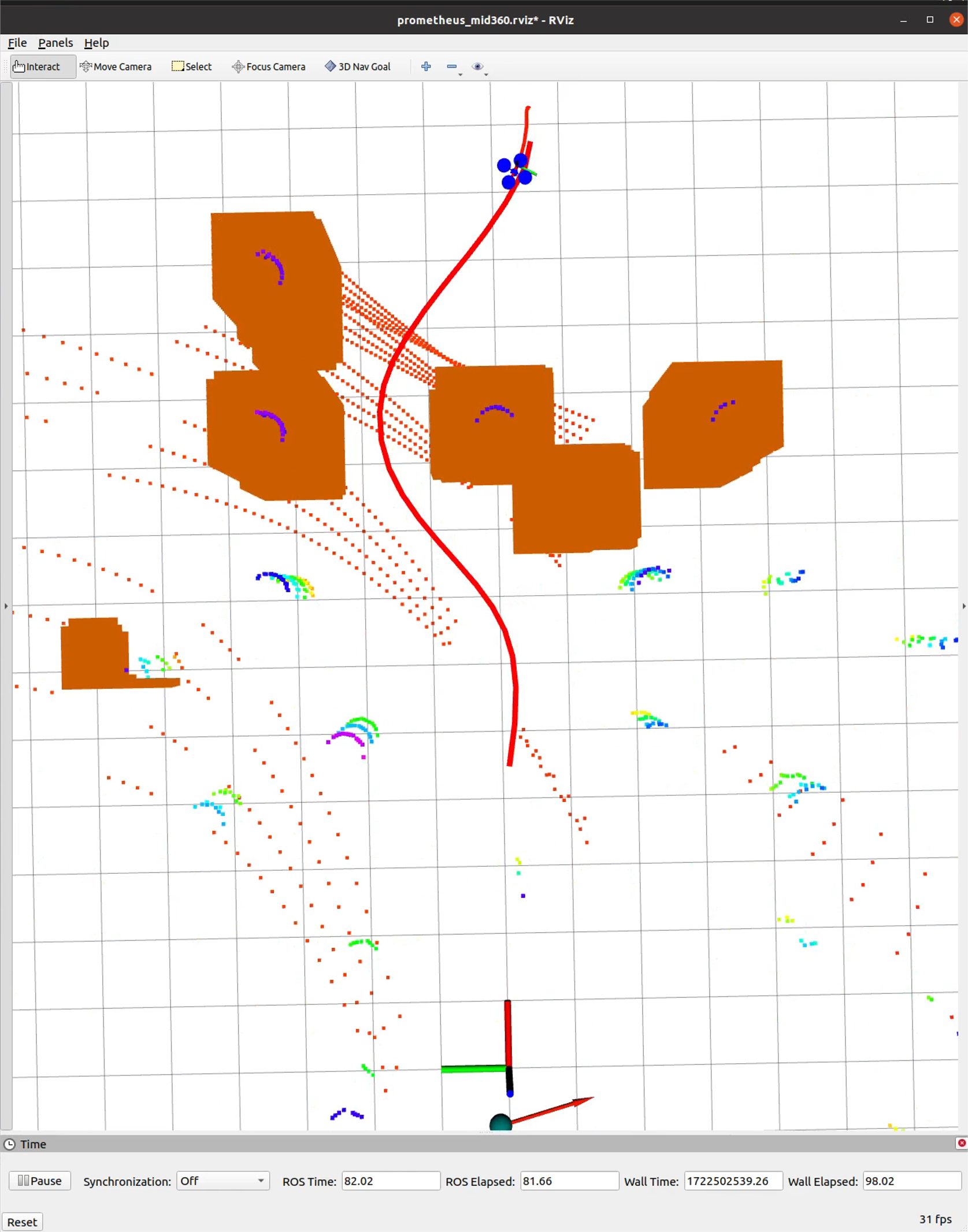

- 开始自主规划避障

- 到达后再次规划

- 按照步骤再次指点规划

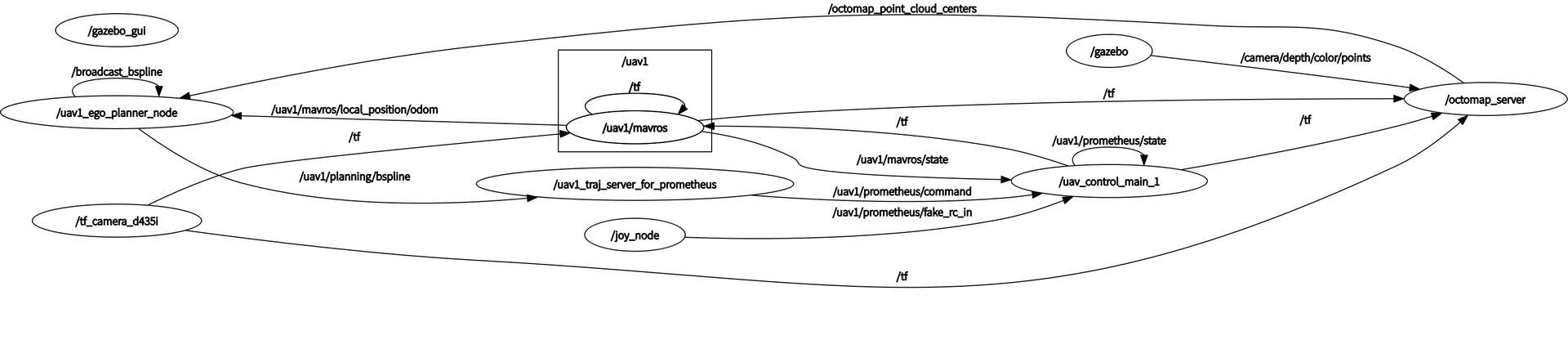

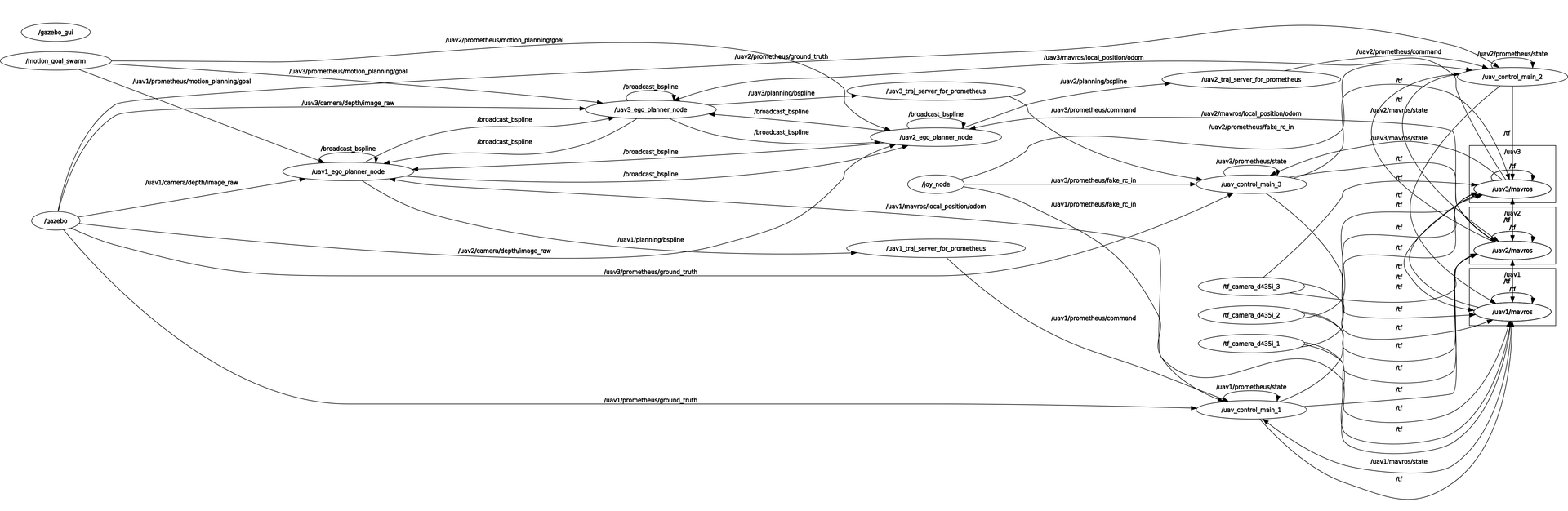

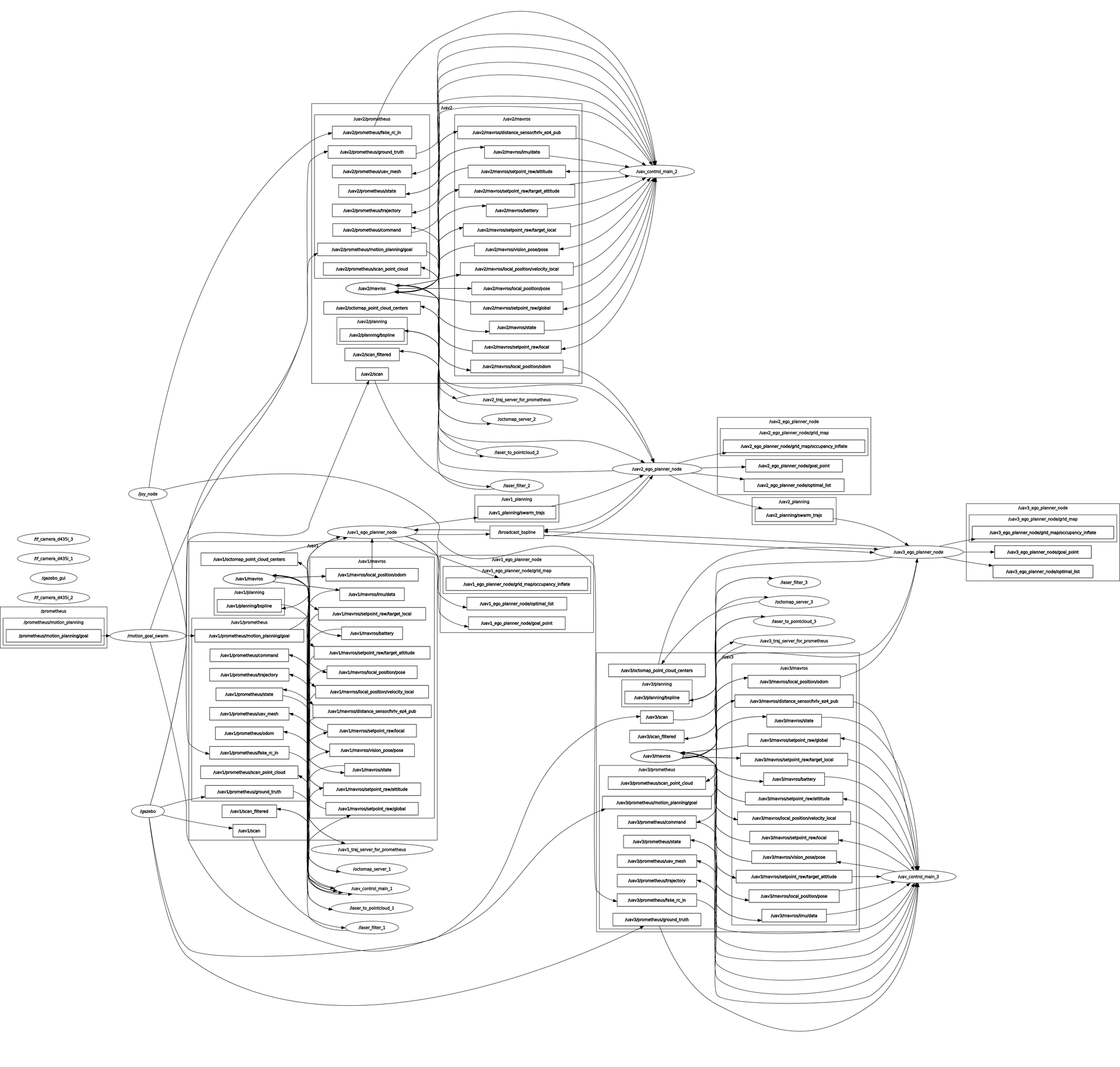

节点运行图

起飞降落例程主要包含

/joy_node、/uav1/mavros、/uav_control_main_1、/octomap_server、/gazebo、/uav1_ego_planner_node、/uav1_traj_server_for_prometheus等ROS节点。

/joy_node节点为遥控器ROS驱动节点,用以获取遥控器数据,通过话题uav1/prometheus/fake_rc_in将遥控器数据传输给/uav_control_main_1节点。

/uav1/mavros节点为飞控ROS驱动节点,与飞控进行数据交互。在仿真中,该驱动节点与模拟飞控进行数据交互。

/uav_control_main_1节点为Prometheus项目中最基础的ROS节点,所有Prometheus项目的功能模块都通过该节点与无人机进行数据交互。

/octomap_server节点为建图服务节点,通过仿真D435i点云数据来进行建图。

/gazebo节点为gazebo ROS驱动节点,为/octomap_server节点提供局部点云数据,来进行建图

/uav1_ego_planner_node节点为ego_planner规划节点,通过/octomap_server节点的话题数据进行建图,输出/uav1/planning/bspline,来进行路线规划

/uav1_traj_server_for_prometheus节点为轨迹生成节点,由B样条(bspline)生成轨迹,转化为command命令控制无人机飞行从节点运行图中,我们可以看到有如下的数据话题

- /uav1/prometheus/command:无人机控制接口,对应的消息为

prometheus_msgs/UAVCommand- /uav1/prometheus/state:无人机状态,对应的消息为

prometheus_msgs/UAVState- /uav1/prometheus/fake_rc_in:仿真模拟PX4遥控器数据

- /camera/depth/color/points:局部点云话题输入

- /octomap_point_cloud_centers:点云信息,仿真中由map_generator产生

- /broadcast_bspline:广播的B样条

- /uav1/planning/bspline:发布的B样条

建议阅读

/Prometheus/Modules/common/prometheus_msgs/msg内对应的消息文件,了解上面提到的消息详细定义。代码讲解

脚本位于

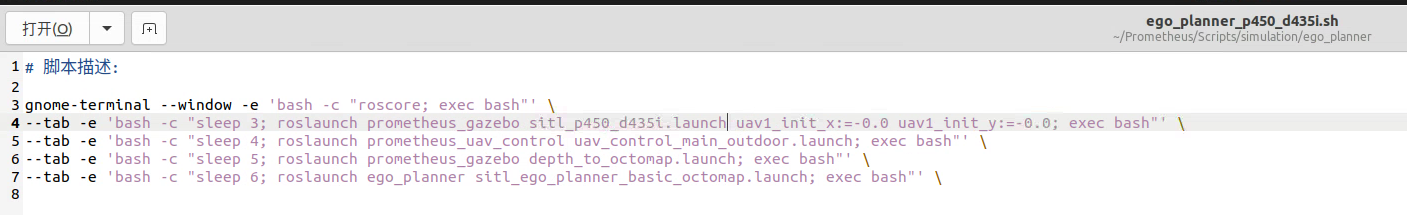

/home/amov/Prometheus/Scripts/simulation/ego_planner/ego_planner_p450_d435i.sh,打开规划脚本如下

除了运行ros必备启动的roscore,脚本依次运行了四个launch文件

1.sitl_p450_d435i.launch

2.uav_control_main_outdoor.launch

3.depth_to_octomap.launch

4.sitl_ego_planner_basic_octomap.launch

依次查看

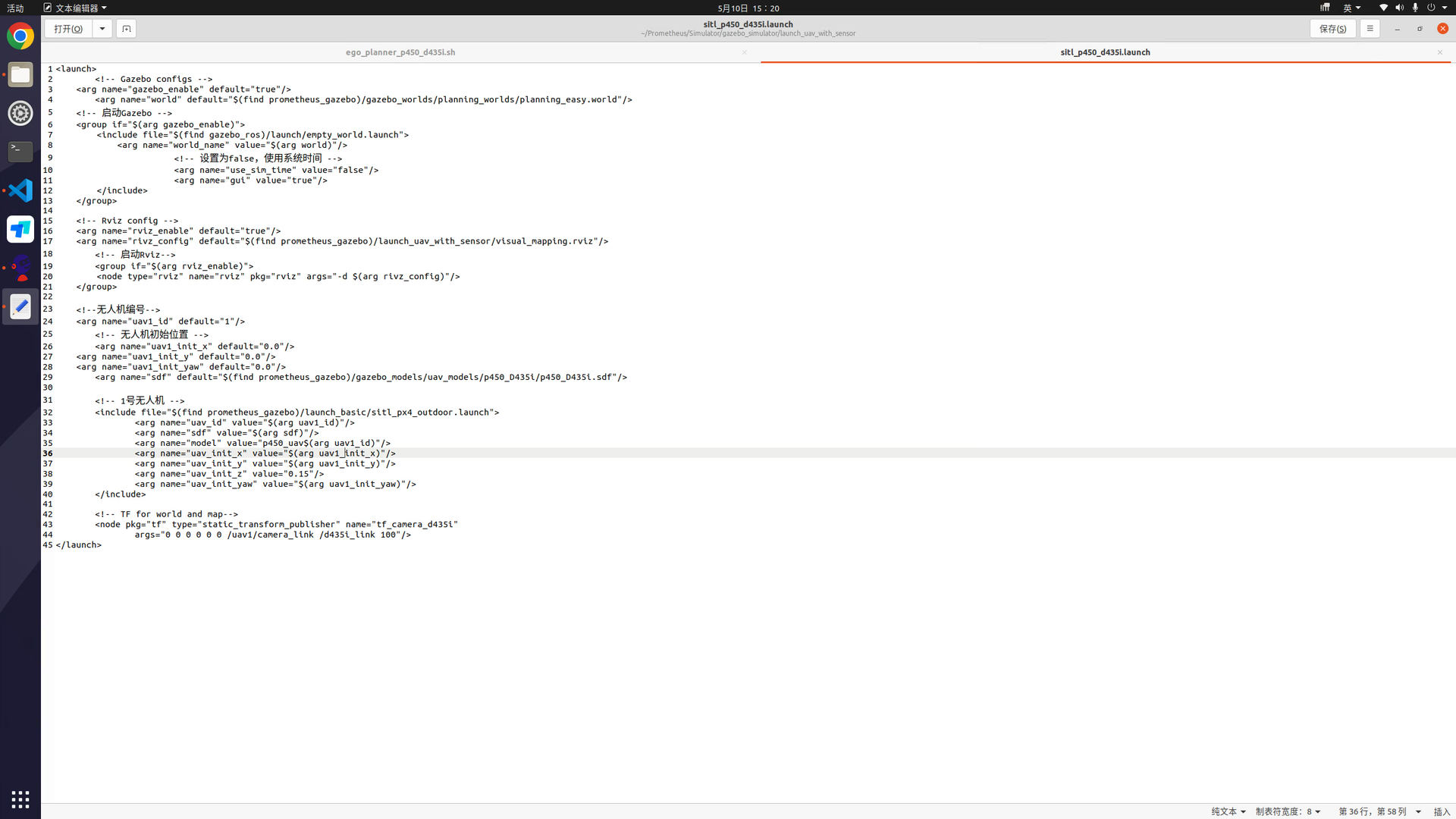

1.sitl_p450_d435i.launch

启动prometheus_gazebo下gazebo环境,带有仿真D435i的无人机模型,以及rviz

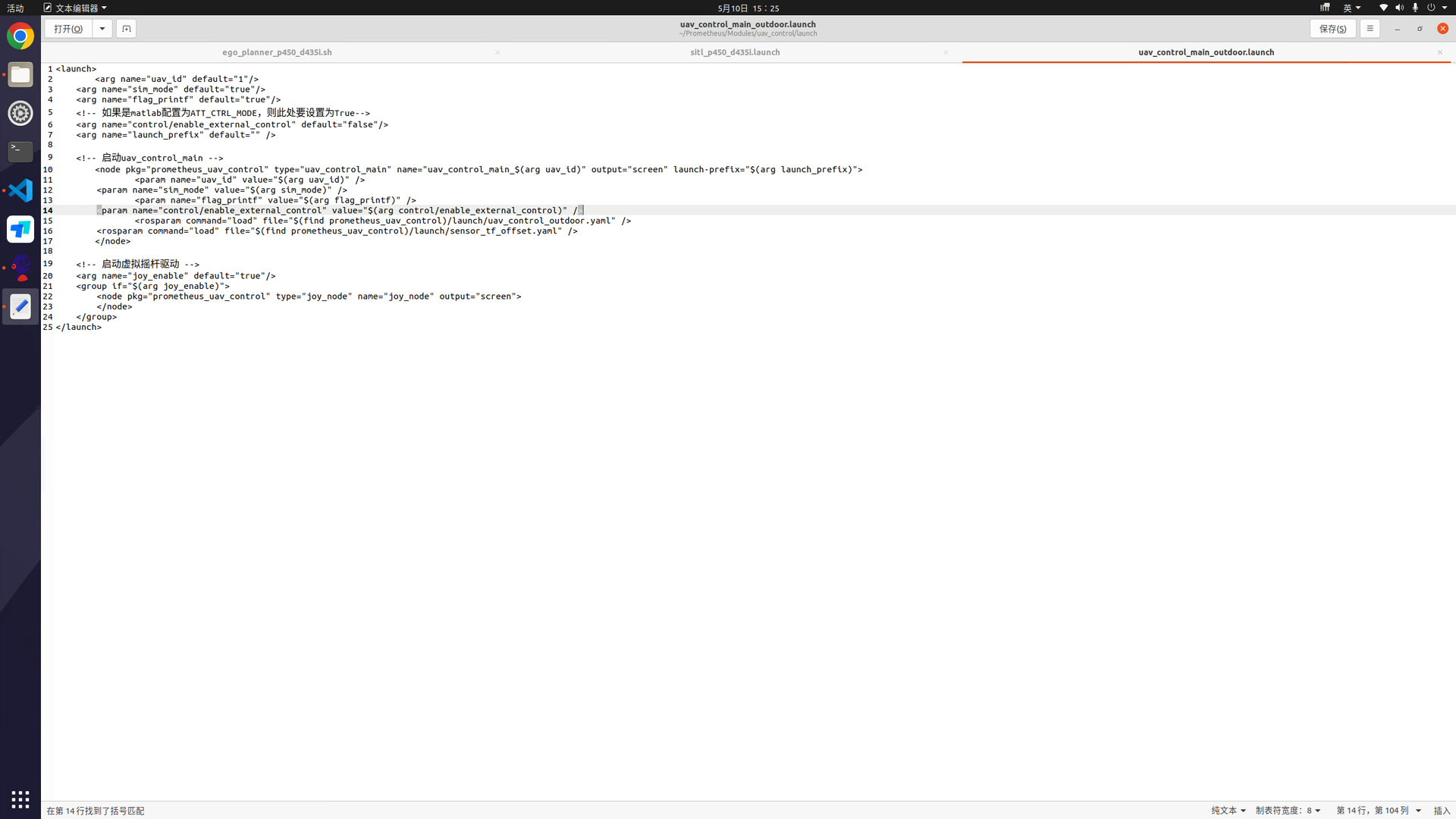

2.uav_control_main_outdoor.launch

在prometheus_uav_control,启动UAV1控制节点,Prometheus下控制,为后面路径规划发送控制指令做准备

3.depth_to_octomap.launch

在prometheus_gazebo下启动octomap建图服务,为后面ego规划做准备。octomap_server是ROS中一个基于octomap的功能包,具有将点云地图转化为基于Octree的OctoMap的功能。

在ROS中,octomap_server和octomap_map都是用于构建三维地图的软件包。octomap_server软件包提供了一种将输入数据转换为OctoMap格式的方法。它可以将来自激光雷达或深度摄像头等传感器的数据转换为三维点云,并使用这些点云构建OctoMap。octomap_server还可以将OctoMap数据发布为ROS中的OctoMap消息,以便其他ROS节点可以使用它们。octomap_map软件包提供了一种使用OctoMap数据构建环境模型的方法。它可以订阅来自octomap_server的OctoMap消息,并使用该消息构建一个三维地图。该地图可以用于机器人的定位、路径规划和避障等任务。octomap_server用于构建OctoMap数据,而octomap_map用于将OctoMap数据转换为实际可用的地图。

可以查看octomap_server讲解来深入了解octomap

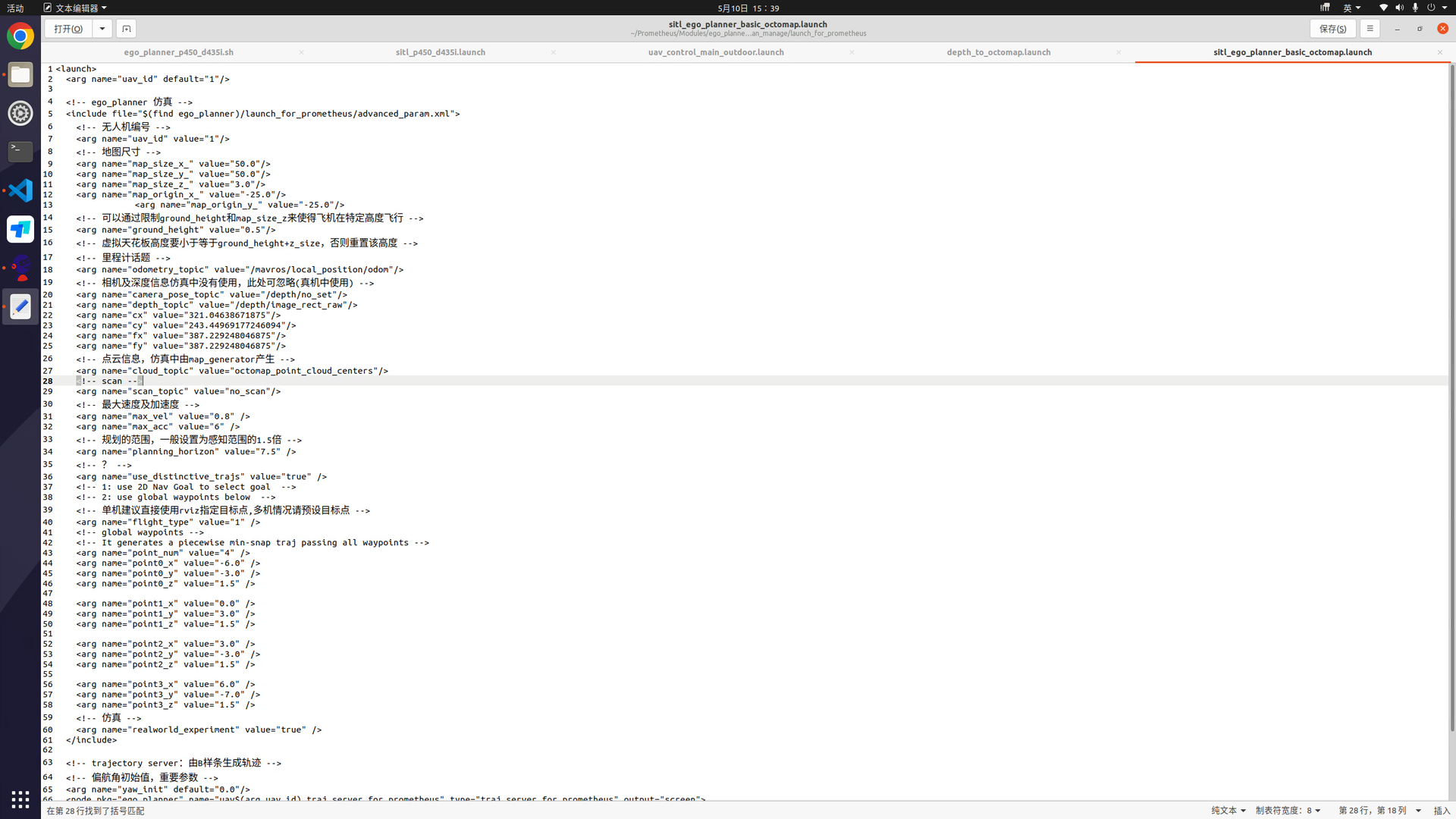

4.sitl_ego_planner_basic_octomap.launch

在ego_planner包下启动ego_planner 仿真,并由B样条生成轨迹,发送控制指令给无人机,控制飞行。其中包含两部分

/uav1_ego_planner_node和/uav1_traj_server_for_prometheus,前者

/uav1_ego_planner_node进行ego_planner规划,相关源代码参见ego_planner_node.cpp ,ego_replan_fsm.cpp,planner_manager.cpp,路径:/home/amov/Prometheus/Modules/ego_planner_swarm/plan_manage/src/。EGO-Planner是一个无ESDF(欧几里得符号距离场)的基于梯度的局部路径规划框架,EGO-Planner由基于梯度的样条优化器和后细化两部分组成。

可以查看EGO-Planner代码讲解来深入了解EGO-Planner

后者

/uav1_traj_server_for_prometheus订阅ego_planner规划结果,由B样条(bspline)生成轨迹,转化为command命令控制无人机飞行。其源代码为traj_server_for_prometheus.cpp,路径:/home/amov/Prometheus/Modules/ego_planner_swarm/plan_manage/src_for_prometheus/操作演示视频

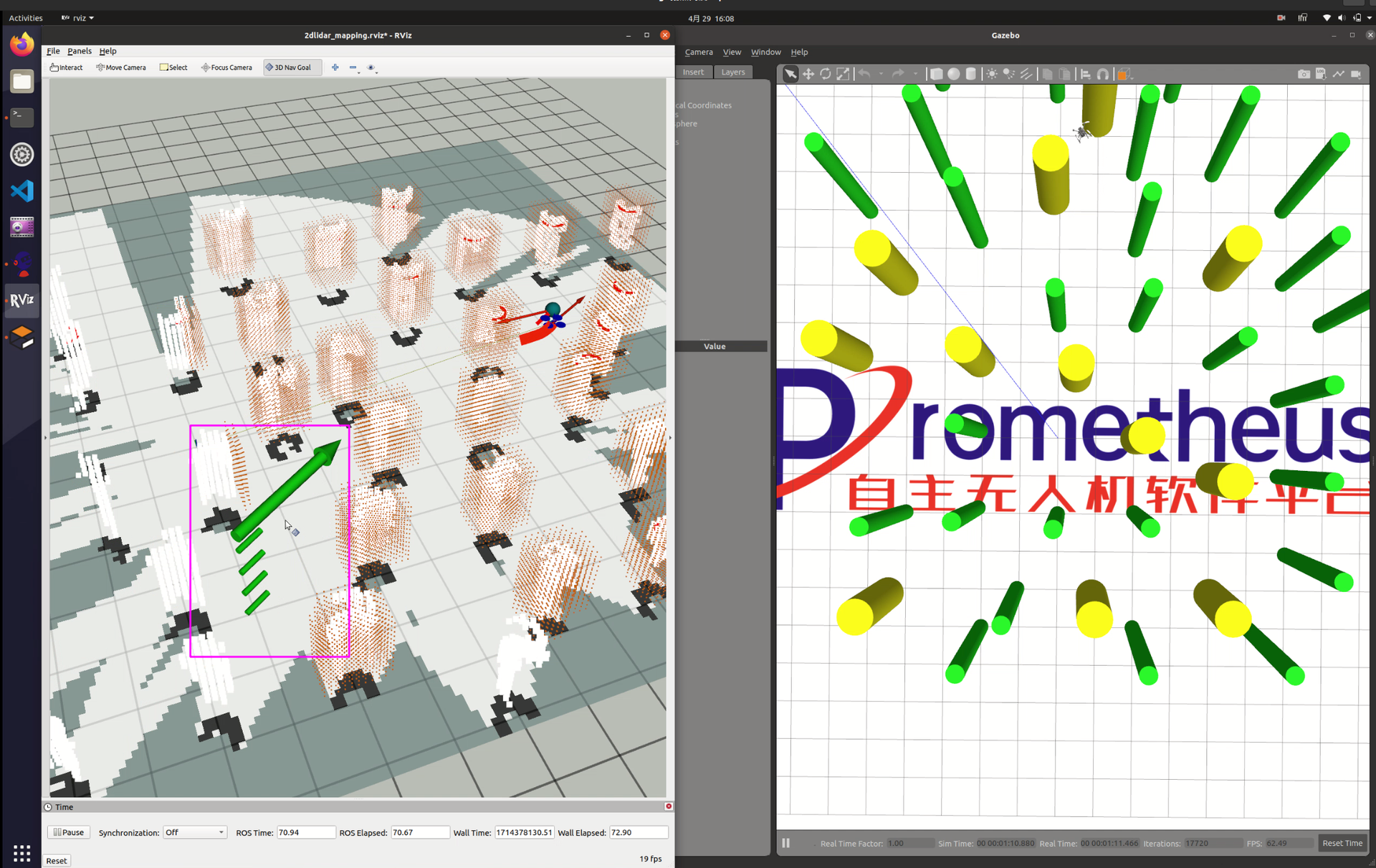

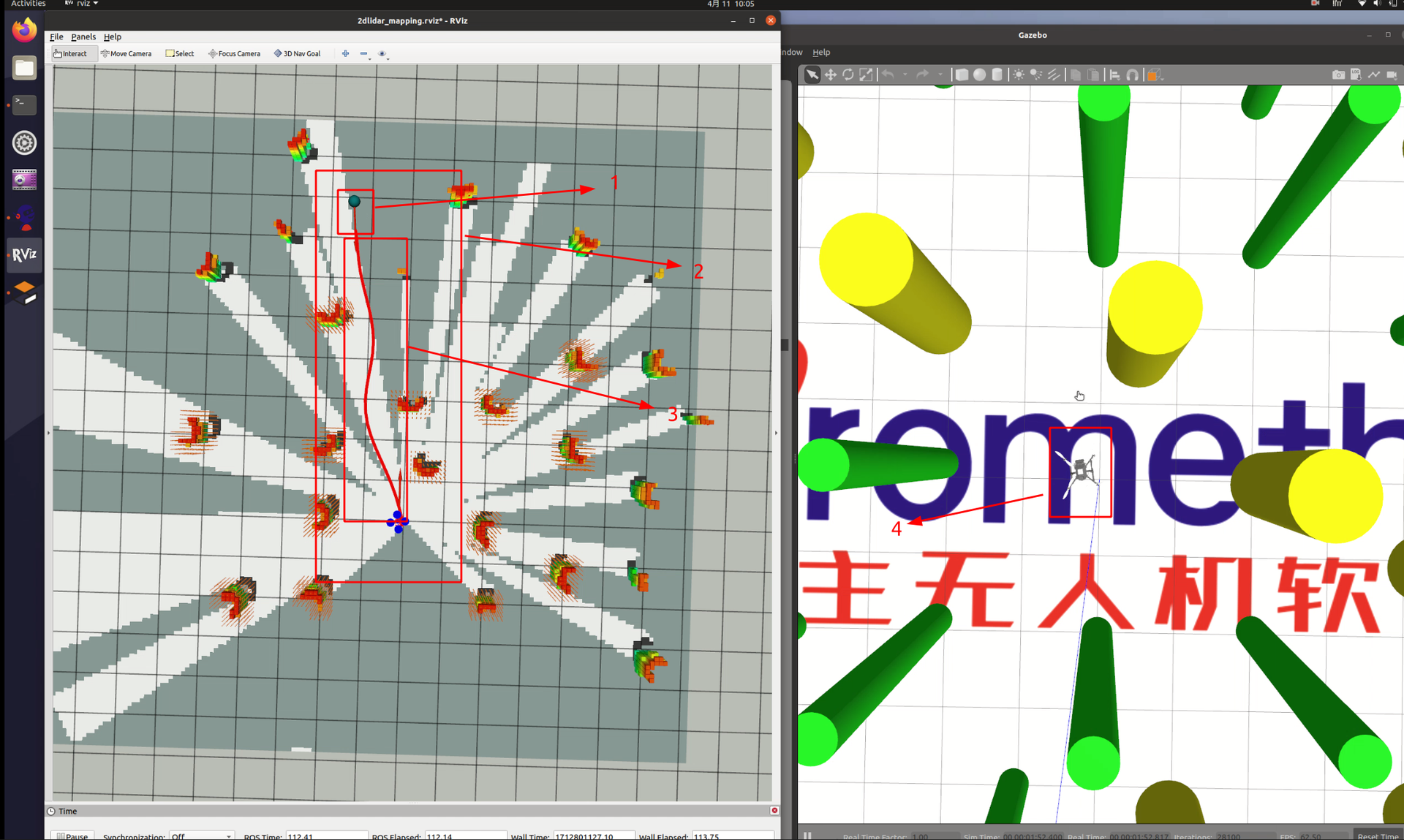

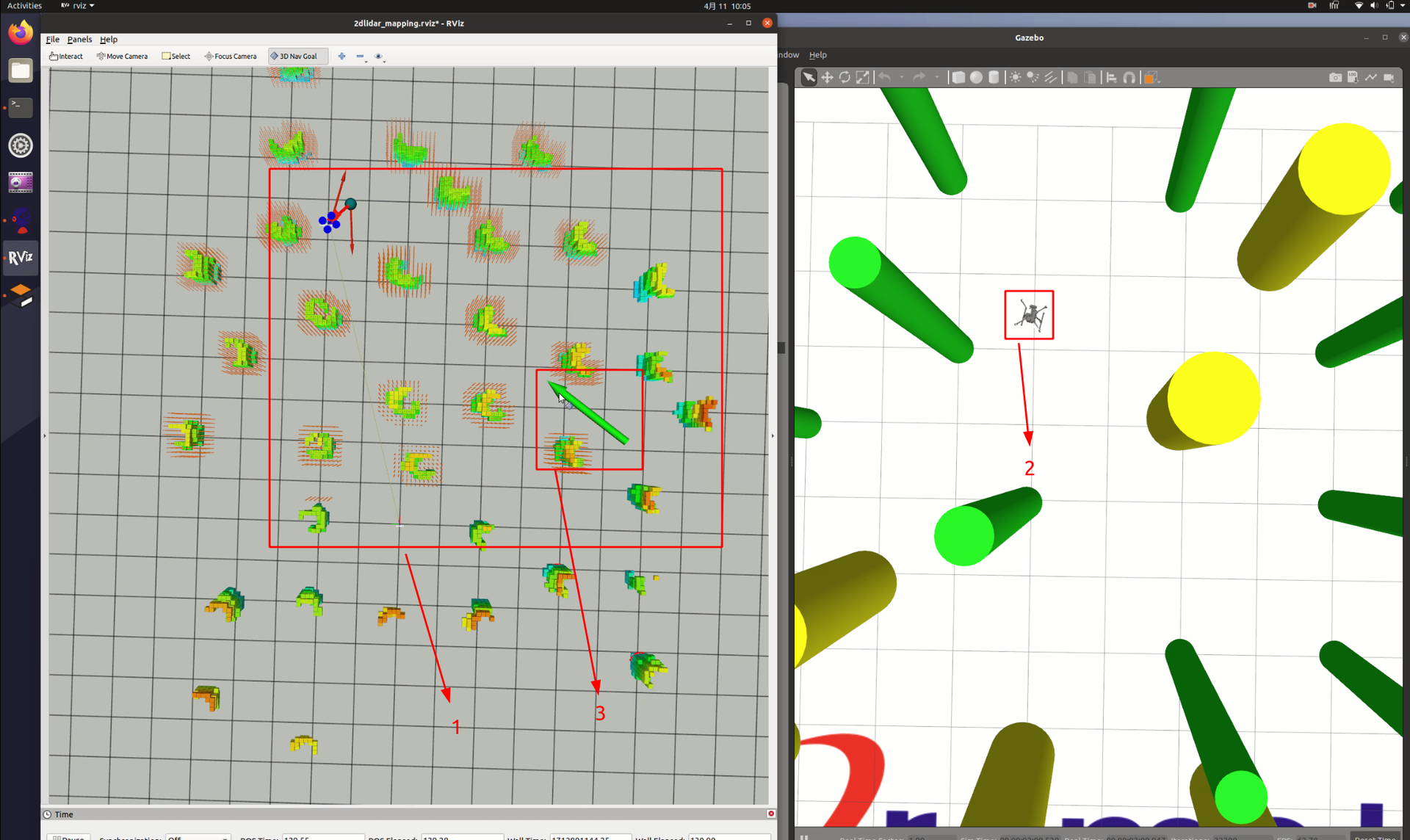

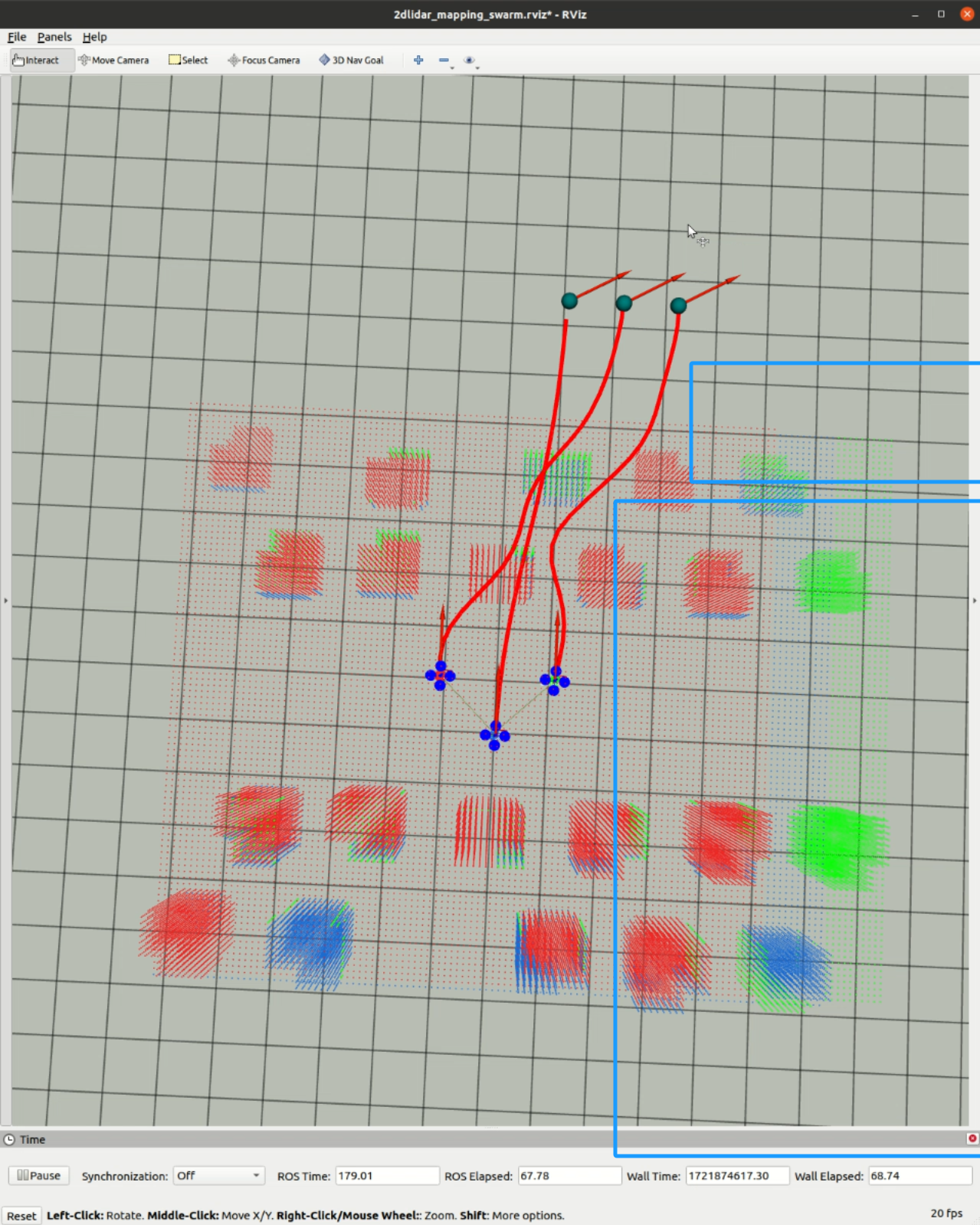

仿真Demo-二维激光雷达避障

效果展示

提示

运行Demo前请将该模块编译编译代码如下:

cd ~/Prometheus catkin_make --source Modules/ego_planner_swarm --build build/ego_planner_swarm仿真脚本启动流程

将FS-i6s遥控器开机并通过USB接口接入电脑

输入以下命令启动二维激光雷达集群避障仿真demo

cd ~/Prometheus/Scripts/simulation/ego_planner/ # 第一次启动该脚本时,需要添加可执行权限 chmod +x ego_planner_p450_2dlidar.sh ./ego_planner_p450_2dlidar.sh检查终端运行是否正常

- ROS主节点

- 下图所示为正常运行

- PX4仿真

- 下图所示为正常运行

- Prometheus控制

- 下图所示为正常运行

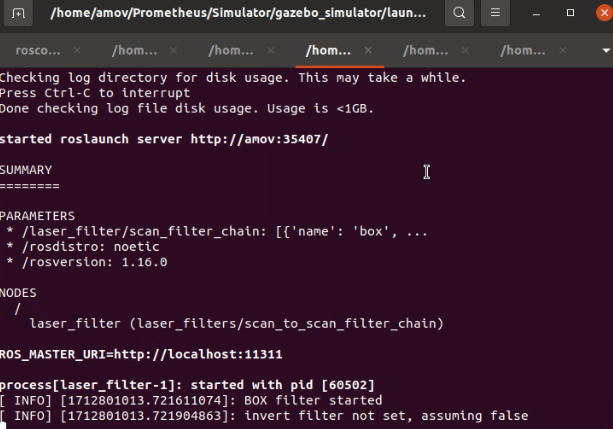

- 雷达驱动

- 下图所示为正常运行

- Octomap建图

- 下图所示为正常运行

- Ego-planner规划避障

- 下图所示为正常运行

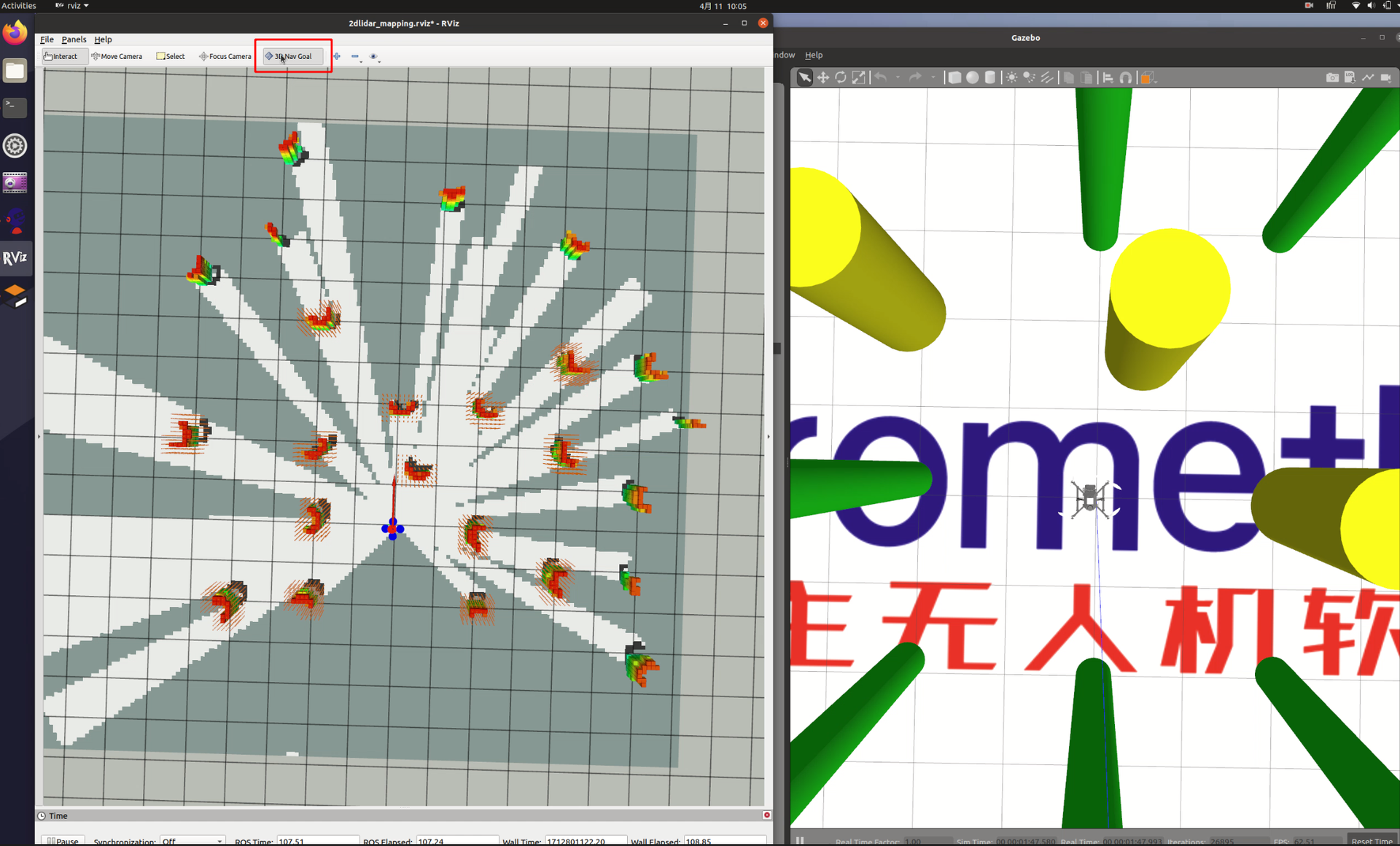

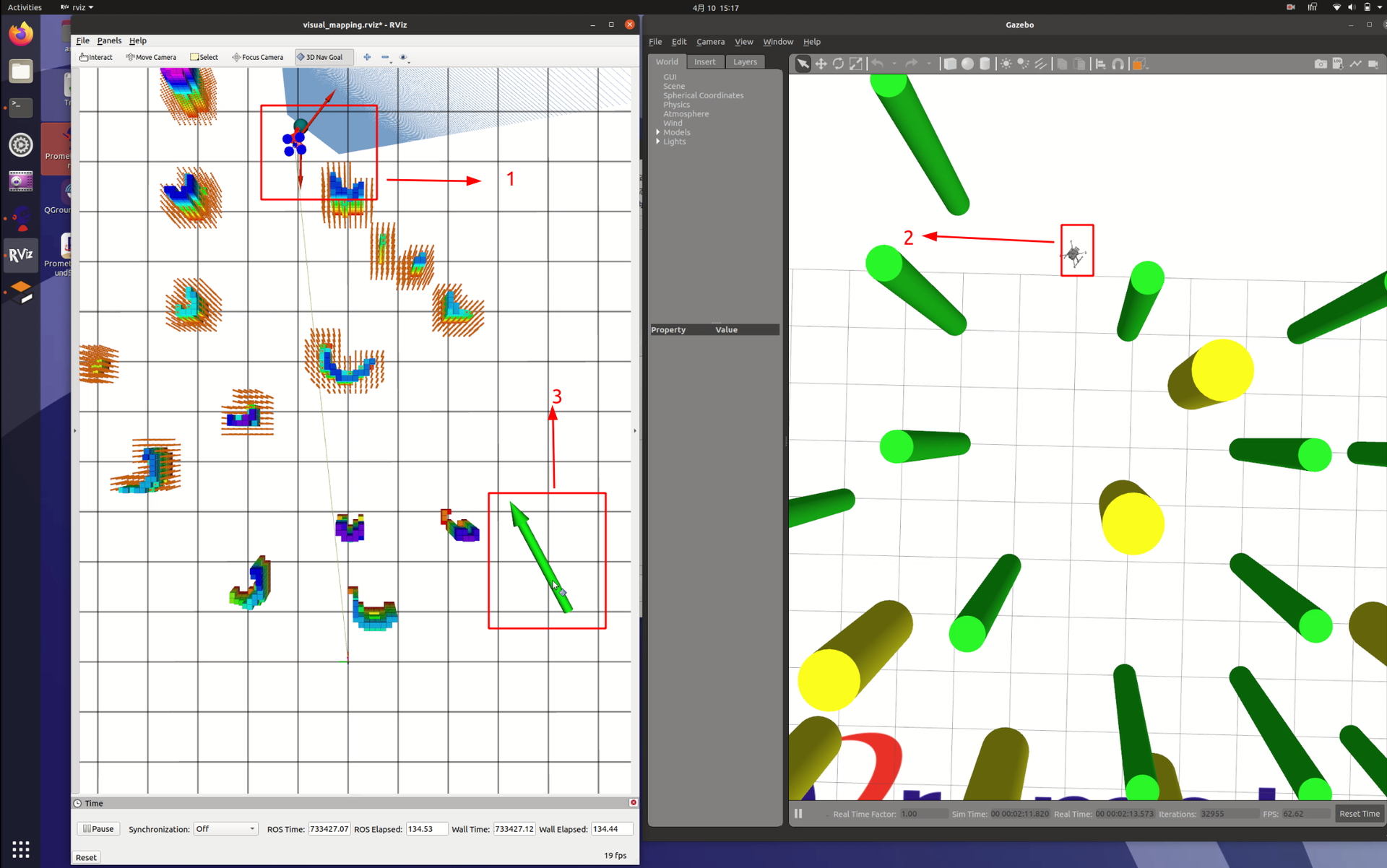

开始仿真

- 遥控器拨动SW-A,解锁无人机

- 拨动SW-B,到中间,进入Prometheus的RC_POS_CONTROL控制

- 拨动SW-B,到最下面,进入Prometheus的COMMAND_CONTROL控制,无人机会自主起飞

- 选择 3D Nav Goal

- 选择后鼠标的图表会发生变化

- 开始指点

- 鼠标左键点击目标点,然后不松开,拖向无人机方向(如下图一绿色箭头,提供目标X和Y的位置),然后按住鼠标左键的同时,按下鼠标右键,在画面内向上划,可以提供Z的高度,如下图二所示

注意:如果不按住鼠标左键,在画面内向上划,提供Z的高度,那么Z的高度默认为0,则会出现到达不了目标点的情况!

- 开始自主规划避障

- 到达后再次规划

- 按照步骤再次指点规划

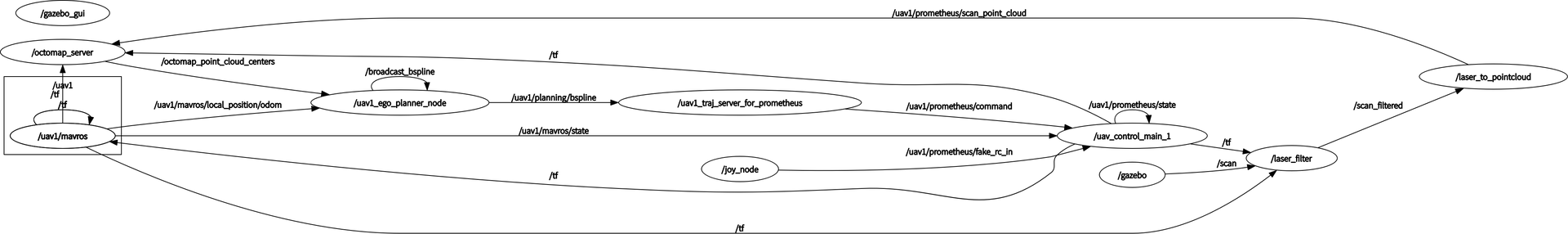

节点运行图

起飞降落例程主要包含

/joy_node、/uav1/mavros、/uav_control_main_1、/octomap_server、/gazebo、/laser_filter、/laser_to_pointcloud、/uav1_ego_planner_node、/uav1_traj_server_for_prometheus等ROS节点。

/joy_node节点为遥控器ROS驱动节点,用以获取遥控器数据,通过话题uav1/prometheus/fake_rc_in将遥控器数据传输给/uav_control_main_1节点。

/uav1/mavros节点为飞控ROS驱动节点,与飞控进行数据交互。在仿真中,该驱动节点与模拟飞控进行数据交互。

/uav_control_main_1节点为Prometheus项目中最基础的ROS节点,所有Prometheus项目的功能模块都通过该节点与无人机进行数据交互。

/gazebo节点为gazebo ROS驱动节点,为/octomap_server节点提供点云数据,来进行建图

/laser_filter节点为ROS感知模块节点,它提供了一系列滤波器,用于处理来自激光雷达传感器的数据。这些滤波器可以帮助你消除噪声、平滑扫描或者根据需要进行其他定制化操作。为/laser_to_pointcloud节点提供滤波后雷达数据

/laser_to_pointcloud节点为plan_env节点,将扫描的雷达数据LaserScan 转为 sensor_msgs::PointCloud2 点云格式,为后续/octomap_server建图做数据提供

/octomap_server节点为建图服务节点,通过仿真雷达数据转换出的点云数据来进行建图。

/uav1_ego_planner_node节点为ego_planner规划节点,通过/octomap_server节点的话题数据进行建图,输出/uav1/planning/bspline,来进行路线规划

/uav1_traj_server_for_prometheus节点为轨迹生成节点,由B样条(bspline)生成轨迹,转化为command命令控制无人机飞行从节点运行图中,我们可以看到有如下的数据话题

- /uav1/prometheus/command:无人机控制接口,对应的消息为

prometheus_msgs/UAVCommand- /uav1/prometheus/state:无人机状态,对应的消息为

prometheus_msgs/UAVState- /uav1/prometheus/fake_rc_in:仿真模拟PX4遥控器数据

- /scan 仿真雷达扫描出的雷达数据

- /scan_filter 滤波器滤波后的雷达数据

- /uav1/prometheus/scan_point_cloud 雷达数据转换为点云数据输出

- /octomap_point_cloud_centers:点云信息,仿真中由map_generator产生

- /broadcast_bspline:广播的B样条

- /uav1/planning/bspline:发布的B样条

建议阅读

/Prometheus/Modules/common/prometheus_msgs/msg内对应的消息文件,了解上面提到的消息详细定义。代码讲解

脚本位于

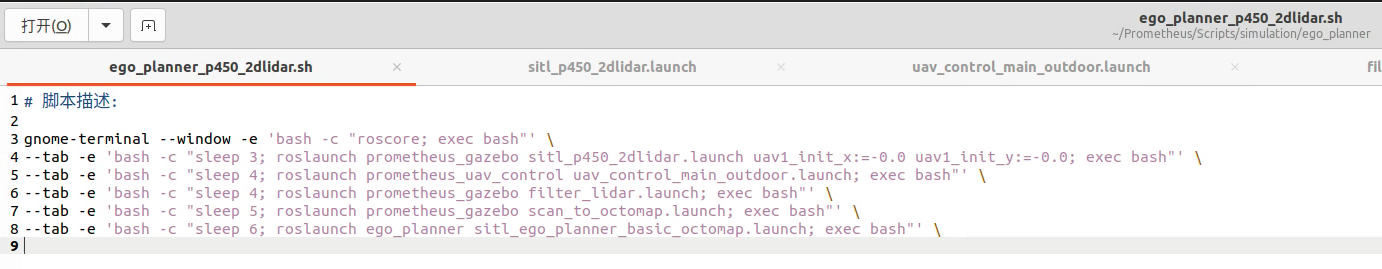

/home/amov/Prometheus/Scripts/simulation/ego_planner/ego_planner_p450_2dlidar.sh,打开规划脚本如下

除了运行ros必备启动的roscore,脚本依次运行了五个launch文件

1.sitl_p450_2dlidar.launch

2.uav_control_main_outdoor.launch

3.filter_lidar.launch

4.scan_to_octomap.launch

5.sitl_ego_planner_basic_octomap.launch

依次查看

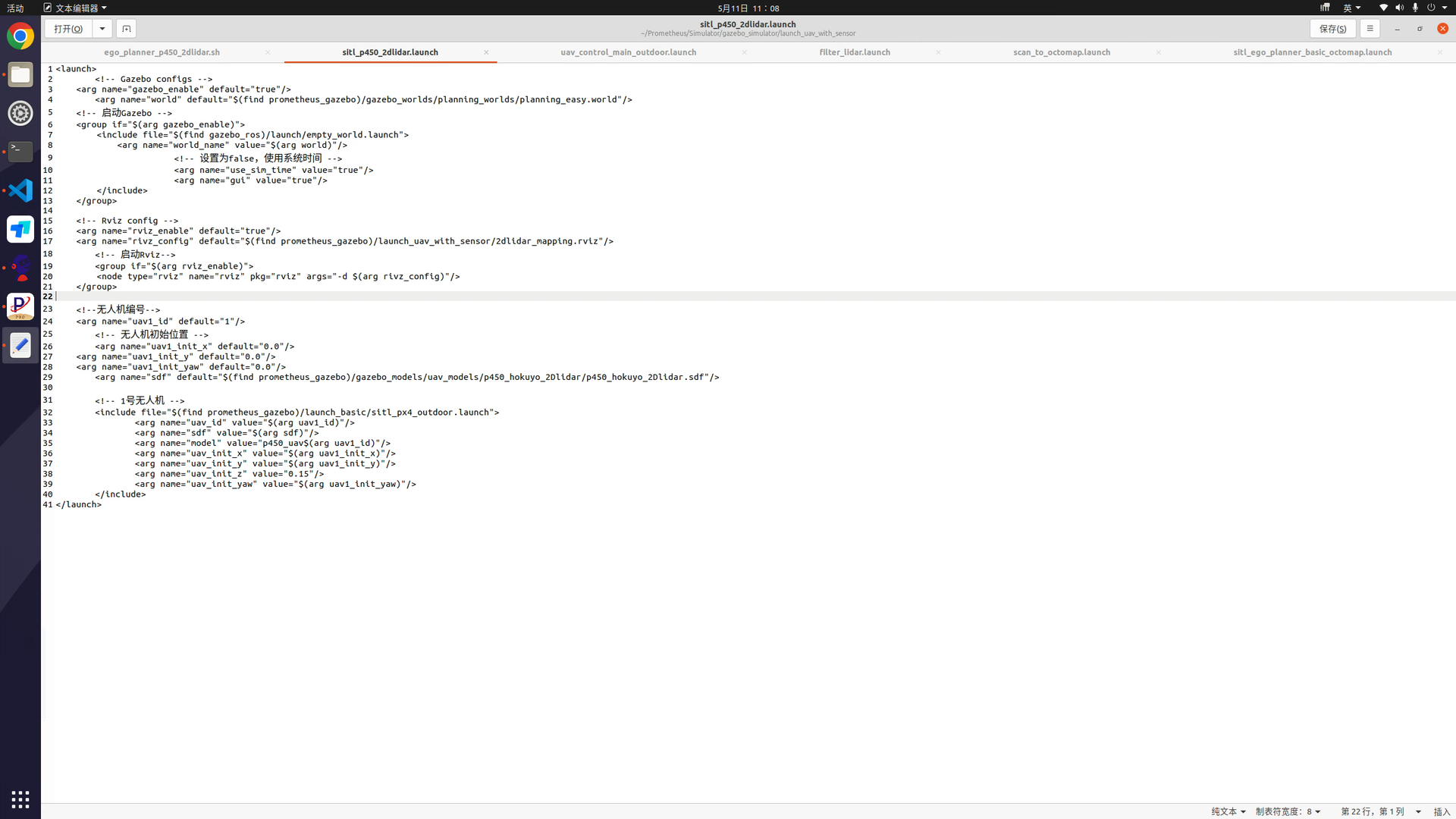

1.sitl_p450_2dlidar.launch

启动prometheus_gazebo下gazebo环境,带有仿真二维激光雷达的无人机模型,以及rviz

2.uav_control_main_outdoor.launch

在prometheus_uav_control,启动UAV1控制节点,Prometheus下控制,为后面路径规划发送控制指令做准备

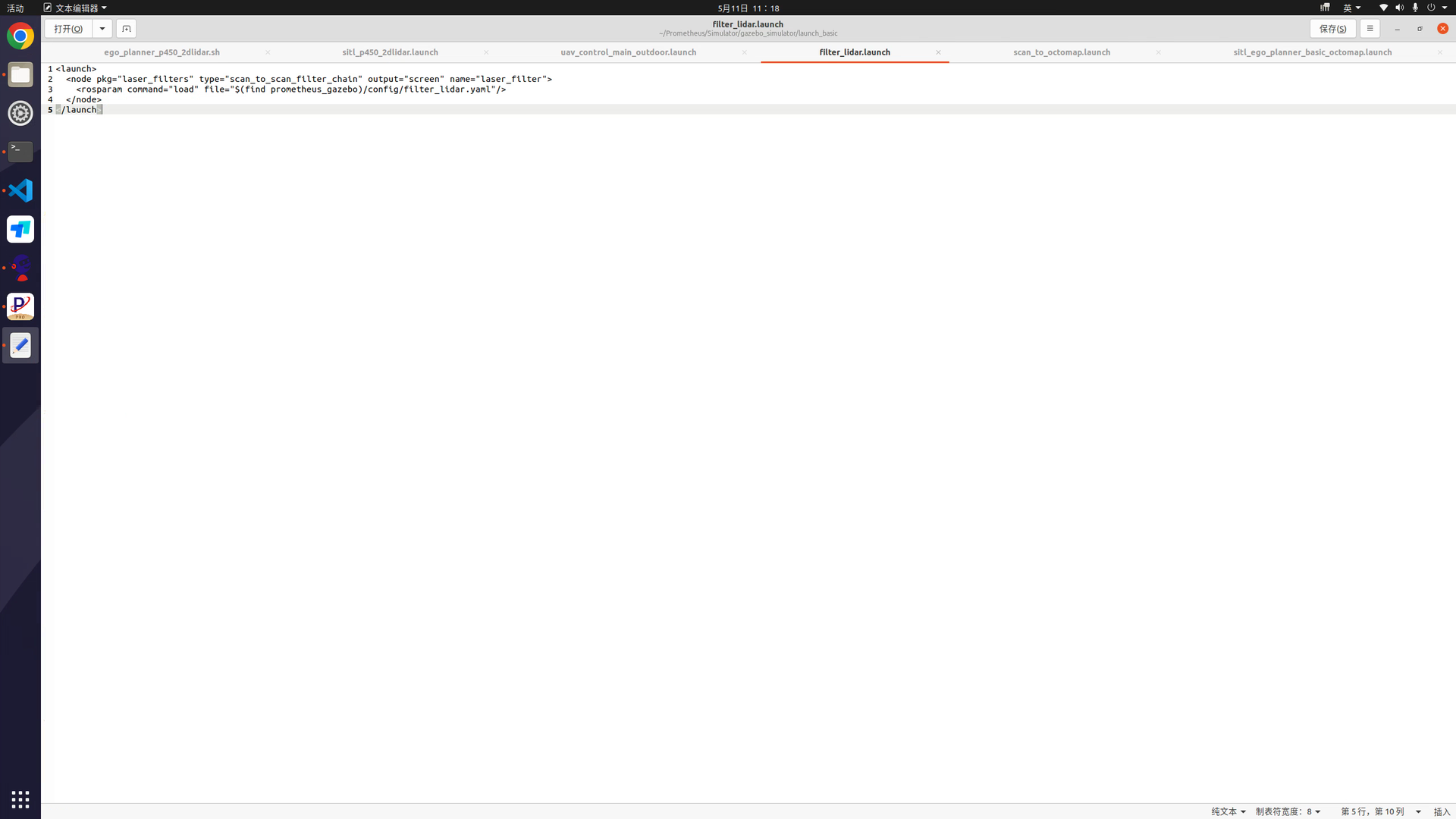

3.filter_lidar.launch

在prometheus_gazebo下启动laser filter,laser_filters是ROS感知模块的一部分,它提供了一系列滤波器,用于处理来自激光雷达传感器的数据。这些滤波器可以帮助你消除噪声、平滑扫描或者根据需要进行其他定制化操作。

可以查看laser filter讲解来深入了解laser filter

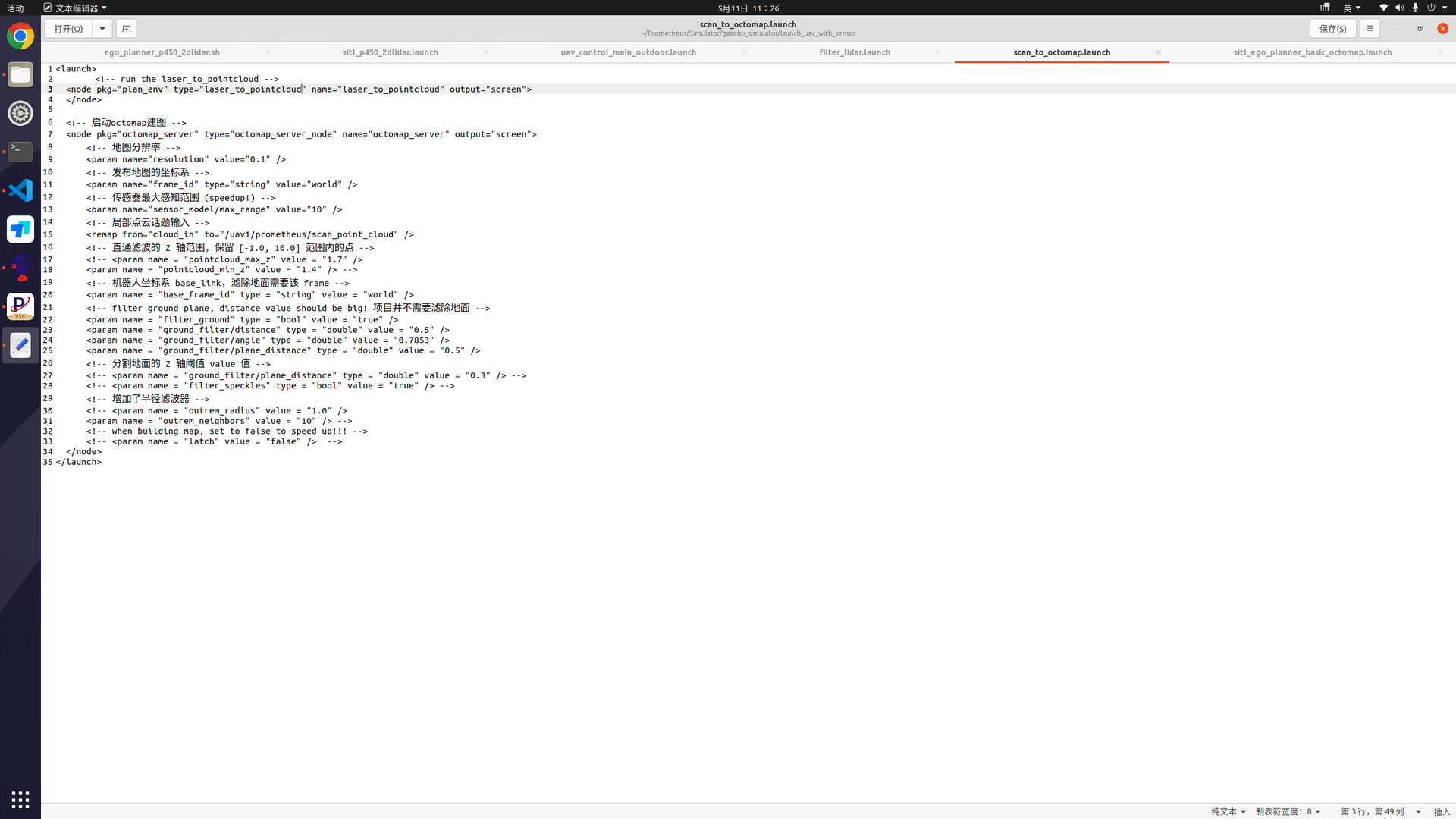

4.scan_to_octomap.launch

在prometheus_gazebo下启动octomap建图服务,为后面ego规划做准备。octomap_server是ROS中一个基于octomap的功能包,具有将点云地图转化为基于Octree的OctoMap的功能。

在ROS中,octomap_server和octomap_map都是用于构建三维地图的软件包。octomap_server软件包提供了一种将输入数据转换为OctoMap格式的方法。它可以将来自激光雷达或深度摄像头等传感器的数据转换为三维点云,并使用这些点云构建OctoMap。octomap_server还可以将OctoMap数据发布为ROS中的OctoMap消息,以便其他ROS节点可以使用它们。octomap_map软件包提供了一种使用OctoMap数据构建环境模型的方法。它可以订阅来自octomap_server的OctoMap消息,并使用该消息构建一个三维地图。该地图可以用于机器人的定位、路径规划和避障等任务。octomap_server用于构建OctoMap数据,而octomap_map用于将OctoMap数据转换为实际可用的地图。

可以查看octomap_server讲解来深入了解octomap

5.sitl_ego_planner_basic_octomap.launch

在ego_planner包下启动ego_planner 仿真,并由B样条生成轨迹,发送控制指令给无人机,控制飞行。其中包含两部分

/uav1_ego_planner_node和/uav1_traj_server_for_prometheus,前者

/uav1_ego_planner_node进行ego_planner规划,相关源代码参见ego_planner_node.cpp ,ego_replan_fsm.cpp,planner_manager.cpp,路径:/home/amov/Prometheus/Modules/ego_planner_swarm/plan_manage/src/。EGO-Planner是一个无ESDF(欧几里得符号距离场)的基于梯度的局部路径规划框架,EGO-Planner由基于梯度的样条优化器和后细化两部分组成。

可以查看EGO-Planner代码讲解来深入了解EGO-Planner

后者

/uav1_traj_server_for_prometheus订阅ego_planner规划结果,由B样条(bspline)生成轨迹,转化为command命令控制无人机飞行。其源代码为traj_server_for_prometheus.cpp,路径:/home/amov/Prometheus/Modules/ego_planner_swarm/plan_manage/src_for_prometheus/操作演示视频

仿真Demo-MID360雷达避障

效果展示

提示

运行Demo前请将该模块编译编译代码如下:

cd ~/Prometheus catkin_make --source Modules/ego_planner_swarm --build build/ego_planner_swarm仿真脚本启动流程

将FS-i6s遥控器开机并通过USB接口接入电脑

输入以下命令启动二维激光雷达集群避障仿真demo

cd ~/Prometheus/Scripts/simulation/ego_planner/ # 第一次启动该脚本时,需要添加可执行权限 chmod +x ego_panner_p600_mid360.sh ./ego_panner_p600_mid360.sh检查终端运行是否正常

- ROS主节点

- 下图所示为正常运行

- PX4仿真

- 下图所示为正常运行

- Prometheus控制

- 下图所示为正常运行

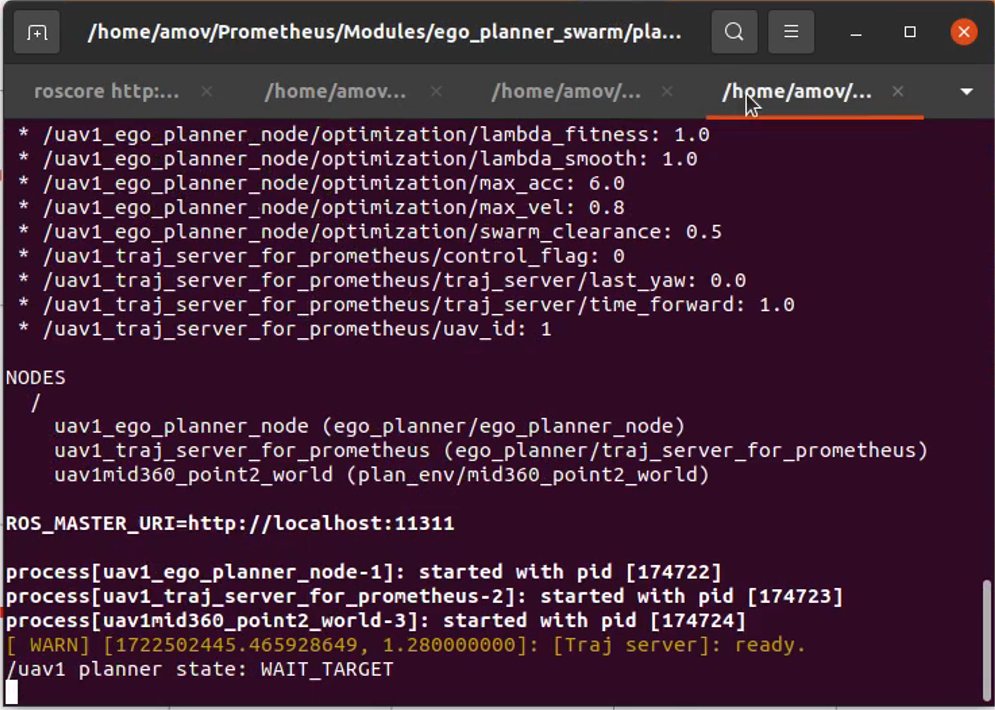

- Ego-planner规划避障

- 下图所示为正常运行

开始仿真

- 遥控器拨动SW-A,解锁无人机

- 拨动SW-B,到中间,进入Prometheus的RC_POS_CONTROL控制

- 拨动SW-B,到最下面,进入Prometheus的COMMAND_CONTROL控制,无人机会自主起飞

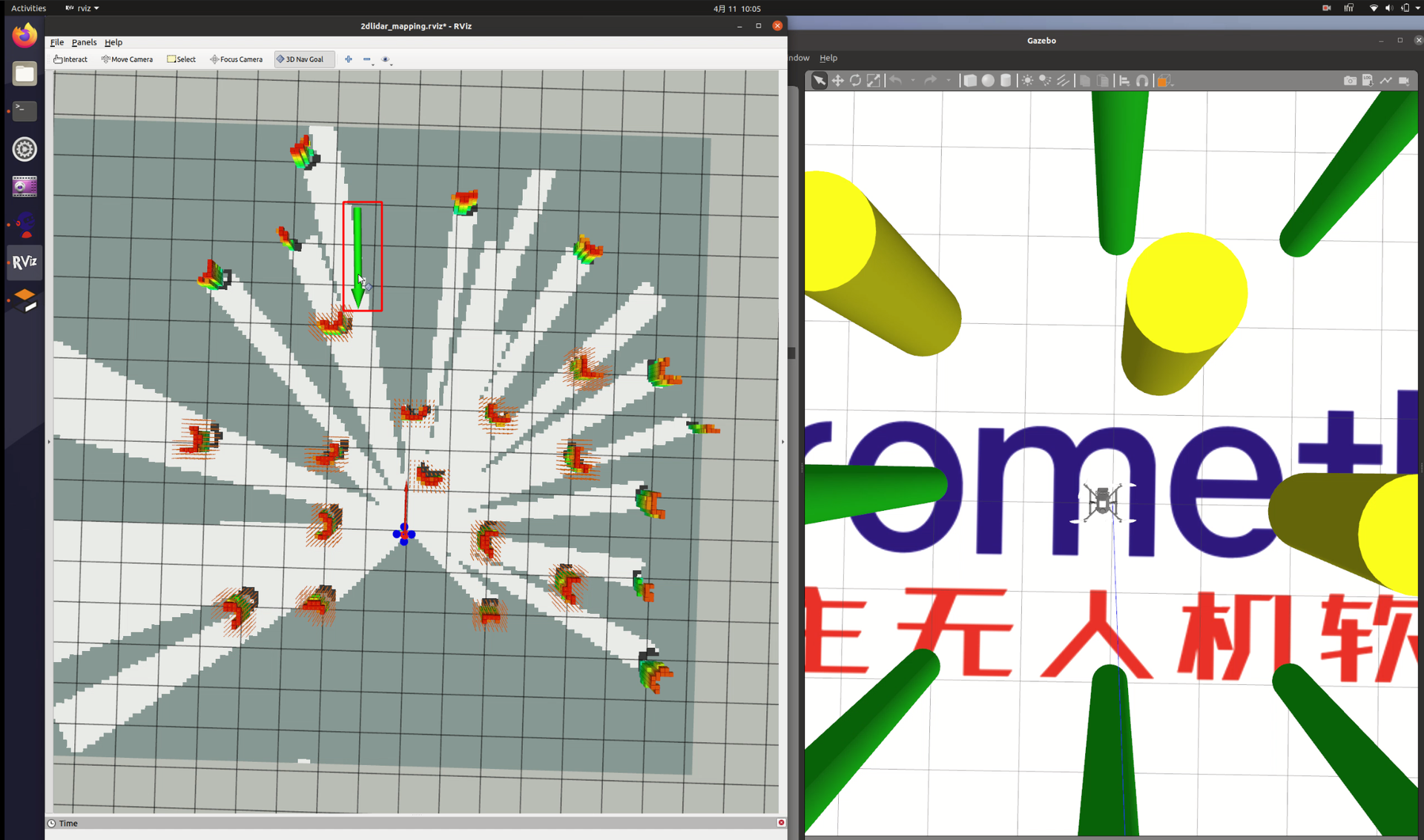

- 选择 3D Nav Goal

- 选择后鼠标的图表会发生变化

- 开始指点

- 鼠标左键点击目标点,然后不松开,拖向无人机方向(如下图一绿色箭头,提供目标X和Y的位置),然后按住鼠标左键的同时,按下鼠标右键,在画面内向上划,可以提供Z的高度,如下图二所示

注意:如果不按住鼠标左键,在画面内向上划,提供Z的高度,那么Z的高度默认为0,则会出现到达不了目标点的情况!

- 开始自主规划避障

- 到达后再次规划

- 按照步骤再次指点规划

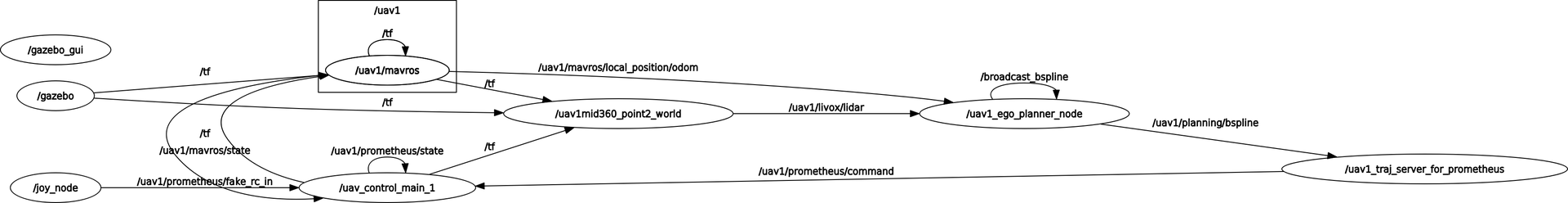

节点运行图

起飞降落例程主要包含

/gazebo、/joy_node、/uav1/mavros、/uav_control_main_1、/uav1mid360_point2_world、/uav1_ego_planner_node、/uav1_traj_server_for_prometheus等ROS节点

/gazebo节点为gazebo ROS驱动节点,为/laserMapping节点提供点云数据,可来进行建图、定位

/joy_node节点为遥控器ROS驱动节点,用以获取遥控器数据,通过话题uav1/prometheus/fake_rc_in将遥控器数据传输给/uav_control_main_1节点

/uav1/mavros节点为飞控ROS驱动节点,与飞控进行数据交互。在仿真中,该驱动节点与模拟飞控进行数据交互

/uav_control_main_1节点为Prometheus项目中最基础的ROS节点,所有Prometheus项目的功能模块都通过该节点与无人机进行数据交互

/uav1_ego_planner_node节点是将雷达从倾斜数据转到world系下

/uav1_ego_planner_node节点为ego_planner规划节点,通过/octomap_server节点的话题数据进行建图,输出/uav1/planning/bspline,来进行路线规划

/uav1_traj_server_for_prometheus节点为轨迹生成节点,由B样条(bspline)生成轨迹,转化为command命令控制无人机飞行从节点运行图中,我们可以看到有如下的数据话题

- /uav1/prometheus/command:无人机控制接口,对应的消息为

prometheus_msgs/UAVCommand- /uav1/mavros/state:无人机状态,对应的消息为

mavros_msgs/State- /uav1/prometheus/fake_rc_in:仿真模拟PX4遥控器数据

- /livox/lidar 仿真中Mid360雷达扫描出的雷达数据

- /broadcast_bspline:广播的B样条

- /uav1/planning/bspline:发布的B样条

- /uav1/mavros/local_position/odom: 无人机位置数据

- /uav1/livox/lidar:雷达转换后的点云数据

建议阅读

/Prometheus/Modules/common/prometheus_msgs/msg内对应的消息文件,了解上面提到的消息详细定义。代码讲解

脚本位于

/home/amov/Prometheus/Scripts/simulation/ego_planner/ego_panner_p600_mid360.sh,打开规划脚本如下UAV_ID=1 gnome-terminal --window -e 'bash -c "roscore; exec bash"' \ --tab -e 'bash -c "sleep 3; roslaunch prometheus_gazebo sitl_outdoor_1uav_P600_mid360.launch uav1_id:='$UAV_ID' uav1_init_x:=-0.0 uav1_init_y:=-0.0; exec bash"' \ --tab -e 'bash -c "sleep 4; roslaunch prometheus_uav_control uav_control_main_outdoor_mid60.launch uav_id:='$UAV_ID'; exec bash"' \ --tab -e 'bash -c "sleep 4; roslaunch ego_planner sitl_ego_planner_mid360.launch; exec bash"' \除了运行ros必备启动的roscore,脚本依次运行了三个launch文件

sitl_outdoor_1uav_P600_mid360.launch

uav_control_main_outdoor_mid60.launch

sitl_ego_planner_mid360.launch

依次查看

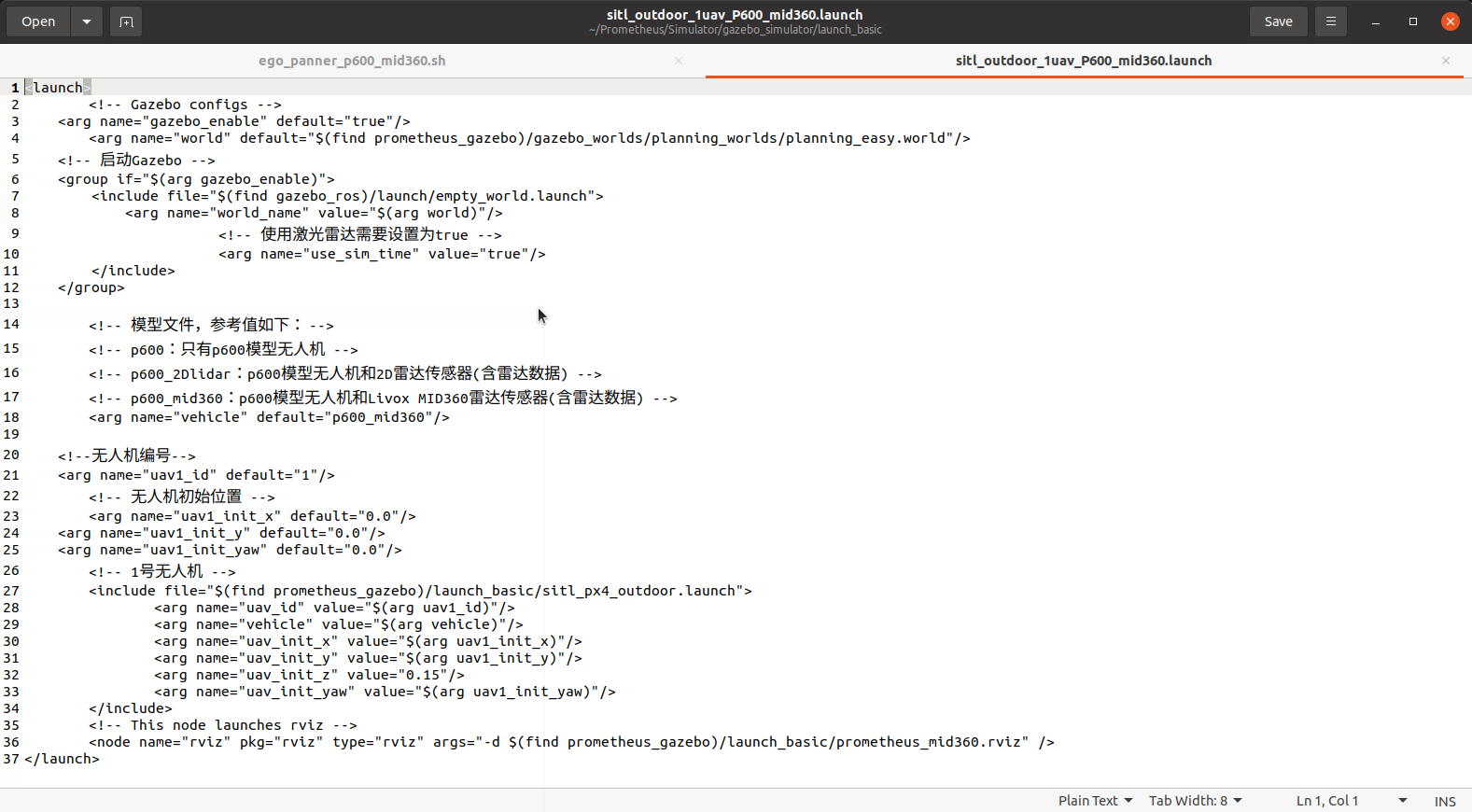

1.sitl_outdoor_1uav_P600_mid360.launch

启动prometheus_gazebo下gazebo环境,带有仿真Mid360激光雷达的无人机模型,以及rviz

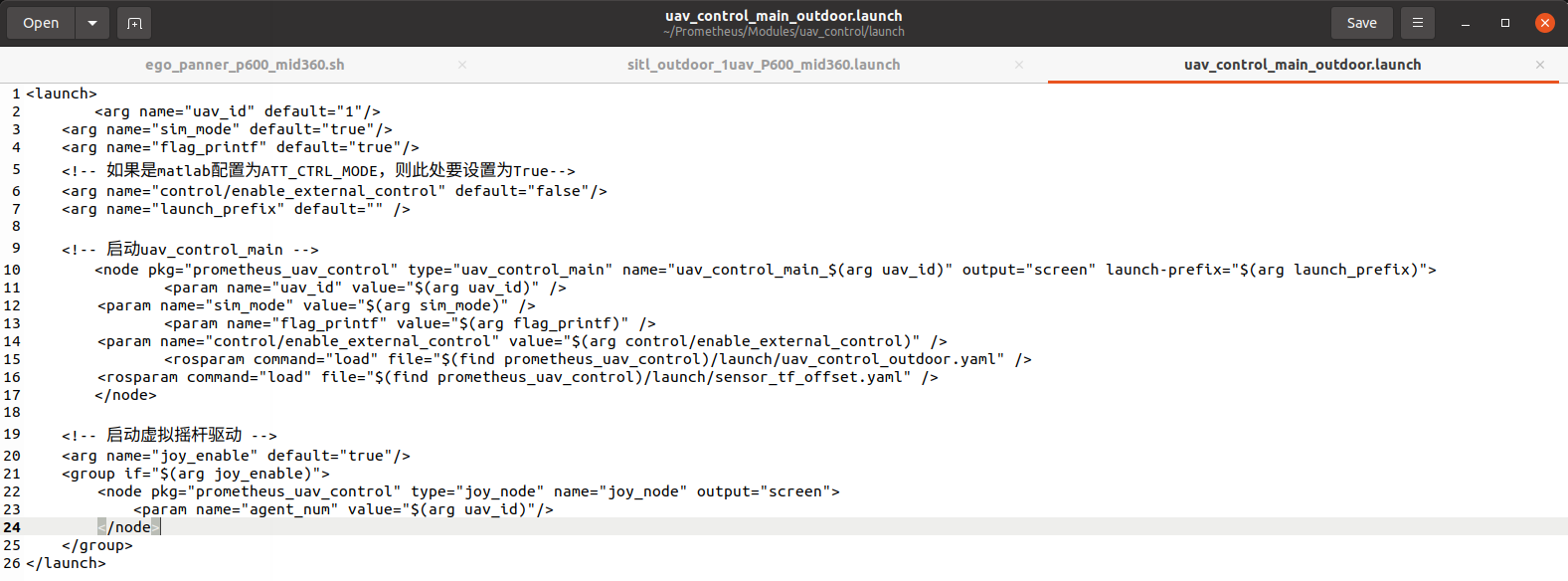

2.uav_control_main_outdoor.launch

在prometheus_uav_control,启动UAV1控制节点,Prometheus下控制,为后面路径规划发送控制指令做准备

3.sitl_ego_planner_mid360.launch

<launch> <arg name="uav_id" default="1"/> <!-- ego_planner 仿真 --> <include file="$(find ego_planner)/launch_for_prometheus/advanced_param_p600.xml"> <!-- 无人机编号 --> <arg name="uav_id" value="$(arg uav_id)"/> <!-- 地图尺寸 --> <arg name="map_size_x_" value="100.0"/> <arg name="map_size_y_" value="100.0"/> <arg name="map_size_z_" value="3.0"/> <arg name="map_origin_x_" value="-25.0"/> <arg name="map_origin_y_" value="-25.0"/> <!-- 可以通过限制ground_height和map_size_z来使得飞机在特定高度飞行 --> <arg name="ground_height" value="0.5"/> <!-- 虚拟天花板高度要小于等于ground_height+z_size,否则重置该高度 --> <!-- 里程计话题 --> <arg name="odometry_topic" value="/mavros/local_position/odom"/> <!-- 相机及深度信息仿真中没有使用,此处可忽略(真机中使用) --> <arg name="camera_pose_topic" value="/depth/no_set"/> <arg name="depth_topic" value="/depth/image_rect_raw"/> <arg name="cx" value="321.04638671875"/> <arg name="cy" value="243.44969177246094"/> <arg name="fx" value="387.229248046875"/> <arg name="fy" value="387.229248046875"/> <!-- 点云信息,仿真中由map_generator产生 --> <!--arg name="cloud_topic" value="/uav$(arg uav_id)/octomap_point_cloud_centers"/--> <arg name="cloud_topic" value="/uav1/livox/lidar"/> <!-- scan --> <arg name="scan_topic" value="no_scan"/> <!-- 最大速度及加速度 --> <arg name="max_vel" value="0.8" /> <arg name="max_acc" value="6" /> <!-- 规划的范围,一般设置为感知范围的1.5倍 --> <arg name="planning_horizon" value="7.5" /> <!-- ? --> <arg name="use_distinctive_trajs" value="true" /> <!-- 1: use 2D Nav Goal to select goal --> <!-- 2: use global waypoints below --> <!-- 单机建议直接使用rviz指定目标点,多机情况请预设目标点 --> <arg name="flight_type" value="1" /> <!-- global waypoints --> <!-- It generates a piecewise min-snap traj passing all waypoints --> <arg name="point_num" value="4" /> <arg name="point0_x" value="-6.0" /> <arg name="point0_y" value="-3.0" /> <arg name="point0_z" value="1.5" /> <arg name="point1_x" value="0.0" /> <arg name="point1_y" value="3.0" /> <arg name="point1_z" value="1.5" /> <arg name="point2_x" value="3.0" /> <arg name="point2_y" value="-3.0" /> <arg name="point2_z" value="1.5" /> <arg name="point3_x" value="6.0" /> <arg name="point3_y" value="-7.0" /> <arg name="point3_z" value="1.5" /> <!-- 仿真 --> <arg name="realworld_experiment" value="true" /> </include> <!-- trajectory server:由B样条生成轨迹 --> <!-- 偏航角初始值,重要参数 --> <arg name="yaw_init" default="0.0"/> <node pkg="ego_planner" name="uav$(arg uav_id)_traj_server_for_prometheus" type="traj_server_for_prometheus" output="screen"> <param name="uav_id" value="$(arg uav_id)"/> <param name="control_flag" value="0"/> <param name="traj_server/time_forward" value="1.0"/> <param name="traj_server/last_yaw" value="$(arg yaw_init)"/> </node> <node pkg="plan_env" name="uav$(arg uav_id)mid360_point2_world" type="mid360_point2_world" output="screen"/> </launch>在ego_planner包下启动ego_planner 仿真,并由B样条生成轨迹,发送控制指令给无人机,控制飞行。其中包含两部分

/uav1_ego_planner_node和/uav1_traj_server_for_prometheus,前者